8 PROCEDIMIENTOS DE COMPARACIÓN MÚLTIPLE

Cuando el resultado de un ANOVA es significativo, lo único que puede afirmarse es que no todas las medias poblacionales de los grupos comparados son iguales entre sí. No obstante, en esta primera instancia no es posible conocer las particularidades de las diferencias, excepto si el experimento consta únicamente de dos tratamientos.

Cuando se tienen más de dos tratamientos, se requieren procedimientos adicionales que permitan precisar las conclusiones. Para ello, se emplean procedimientos de comparación múltiple (PCM), también conocidos tradicionalmente como pruebas post hoc.

En sentido estricto, esta denominación se refiere a las pruebas realizadas a posteriori —tras observar los resultados significativos del ANOVA—, en contraposición con las que el investigador hubiera planeado a priori —antes de conocer los resultados—.

Esta distinción, sin embargo, puede resultar problemática en la práctica contemporánea, pues sugiere que la naturaleza de un procedimiento depende del momento en que se formula la comparación.

Los PCM están diseñados para contrastar simultáneamente varias hipótesis acerca de las medias de las poblaciones involucradas en un experimento.

A pesar de que se encuentran entre las herramientas de mayor uso en investigación experimental, la opinión de los estadísticos alrededor de estos procedimientos dista de ser unánime. La miríada de propuestas constituye un primer indicio de ello. La instauración de un encuentro bienal dedicado exclusivamente a los PCM1 muestra que se trata de un campo en constante desarrollo y que está lejos de considerarse cerrado.

En esta sección se discuten inicialmente tres elementos transversales a los PCM clásicos:

La definición y el control de diferentes tasas de error que surgen por la evaluación simultánea de múltiples hipótesis.

El uso de contrastes o combinaciones lineales de medias que representan comparaciones entre grupos de tratamientos.

La realización del proceso inferencial mediante intervalos de confianza simultánea.

Seguidamente, se presentan los PCM clásicos de uso más frecuente, dejando constancia una vez más de que son muchísimos los procedimientos existentes para este fin.

Merece un comentario especial la Nueva Prueba de Rangos Múltiples de Duncan o simplemente Prueba de Duncan (1955), que por muchos años fue una de las más usadas, especialmente en el área agraria.

En el presente texto no se incluye esta prueba, siguiendo la recomendación de autores como Day y Quinn (1989), Rafter, Abell y Braselton (2002) y Ozcaya y Ercan (2012), quienes desaconsejan su uso, debido a que no controla la tasa de error por familia.

Luego, se describen algunos métodos basados en el ajuste del valor p y otros más basados en el control de la tasa de falsos descubrimientos.

A continuación, se presenta un método de comparación de cada uno de los tratamientos contra la media general.

Finalmente se evalúan algunos métodos para comparación de medias en situación de heterocedasticidad bajo distintos esquemas inferenciales.

8.1 Tasas de error

En el contexto de los experimentos diseñados —cuando se tienen \(k\) tratamientos, con \(k>2\)— surge la posibilidad de plantear y responder múltiples preguntas sobre las medias de los tratamientos, mediante el contraste de múltiples hipótesis.

Así, para un experimento con cuatro tratamientos, como el del ejemplo 7.1, pueden realizarse todas las posibles comparaciones entre pares de medias (pairwise comparisons), contrastando los seis juegos de hipótesis siguientes:

\[

\mu_{\text{A}} \text{ vs. }\mu_{\text{B}}:\quad H_0:\mu_{\text{A}} =\mu_{\text{B}},\quad H_a:\mu_{\text{A}} \ne\mu_{\text{B}}

\] \[

\mu_{\text{A}} \text{ vs. }\mu_{\text{C}}:\quad H_0:\mu_{\text{A}} =\mu_{\text{C}},\quad H_a:\mu_{\text{A}} \ne\mu_{\text{C}}

\] \[

\mu_{\text{A}} \text{ vs. }\mu_{\text{D}}:\quad H_0:\mu_{\text{A}} =\mu_{\text{D}},\quad H_a:\mu_{\text{A}} \ne\mu_{\text{D}}

\] \[

\mu_{\text{B}} \text{ vs. }\mu_{\text{C}}:\quad H_0:\mu_{\text{B}} =\mu_{\text{C}},\quad H_a:\mu_{\text{B}} \ne\mu_{\text{C}}

\] \[

\mu_{\text{B}} \text{ vs. }\mu_{\text{D}}:\quad H_0:\mu_{\text{B}} =\mu_{\text{D}},\quad H_a:\mu_{\text{B}} \ne\mu_{\text{D}}

\] \[

\mu_{\text{C}} \text{ vs. }\mu_{\text{D}}:\quad H_0:\mu_{\text{C}} =\mu_{\text{D}},\quad H_a:\mu_{\text{C}} \ne\mu_{\text{D}}

\]

Al decidir sobre cualquier juego de hipótesis existe la probabilidad de errar, bien sea rechazando una hipótesis nula que es cierta (error tipo I) o dejando de rechazar una hipótesis nula falsa (error tipo II) (cf. tabla 3.4).

Al contrastar simultáneamente múltiples juegos de hipótesis, surge un concepto adicional:

Aunque en escenarios en los que contrastan múltiples juegos de hipótesis siguen estando presentes las probabilidades de error tipo I y II, las conceptualizaciones se construyen alrededor del error tipo I, dado que es el que el usuario puede controlar directamente.

Luego, la definición 8.1 se refiere a la tasa de error tipo I por familia.

Para diferenciar la tasa de error por familia del tradicional error tipo I que surge al contrastar un único juego de hipótesis, resulta conveniente la siguiente definición:

La tasa de error por comparación es el riesgo de error tipo I de una comparación particular. Es la probabilidad a la que se ha hecho referencia en los capítulos precedentes. En el presente contexto se denota \(\alpha_\text{c}.\)

La tasa de error por familia es el riesgo de cometer error tipo I en al menos una de las comparaciones que conforman una familia. Se denota \(\alpha_\text{f}\) o TEF (FWER: Familywise Error Rate). Cuando no existe riesgo de ambigüedad se denota simplemente por \(\alpha.\)

En el contexto de experimentos con un solo factor —como los que se desarrollan en el capítulo 7—, se consideran habitualmente todas las comparaciones entre los tratamientos. En tal sentido, a menudo se habla indistintamente de tasa de error por familia o tasa de error por experimento.

No obstante, en experimentos con más de un factor —como los que se desarrollan en el capítulo 10— pueden surgir múltiples familias dentro de un mismo experimento.

Cuando se realizan múltiples comparaciones, se incrementa la posibilidad de detectar diferencias que en realidad no existen (error tipo I), como consecuencia del número de pruebas evaluadas. Los PCM buscan superar este inconveniente, mediante la aplicación de ajustes o correcciones.

En general, la TEF depende de la tasa de error por comparación y del número de comparaciones. Mientras mayor sea el número de tratamientos de un experimento, mayor es el número de posibles comparaciones entre estos y —si no se realizara ningún tipo de corrección— mayor sería también la TEF.

El número de comparaciones por pares que pueden realizarse en un experimento conformado por \(k\) tratamientos está determinado por las combinaciones de \(k\) en 2, así:

\[

\begin{align}

\binom{k}{2}&=\dfrac{k!}{2!(k-2)!}\\[1.4em]

&=\frac{k(k-1)(k-2)!}{2!(k-2)!}\\[1.4em]

&=\frac{k(k-1)}{2}

\end{align}

\]

Para ilustrar cuál sería la TEF si no se usara ningún tipo de corrección y las comparaciones por pares fueran independientes, considérese inicialmente la probabilidad de cometer un error tipo I en una comparación específica. Esta es la tasa de error por comparación fijada por el usuario: \(\alpha_\text{c}.\)

La probabilidad de no cometer error tipo I al realizar una comparación es el complemento \((1-\alpha_\text{c}).\)

Al realizar \(m\) comparaciones independientes, la probabilidad de no cometer error tipo I en ninguna de ellas es \((1-\alpha_\text{c})^m.\)

La probabilidad de cometer al menos un error tipo I cuando se realizan \(m\) comparaciones independientes es \(1-(1-\alpha_\text{c})^m.\)

Luego, si en un experimento se realizaran \(m\) comparaciones independientes, cada una de ellas con una tasa de error por comparación \(\alpha_\text{c}\) y no se aplicara ningún tipo de corrección, la TEF estaría dada por:

\[

\text{TEF}\equiv \alpha_\text{f}\equiv\alpha=1-(1-\alpha_\text{c})^m

\]

La tabla 8.1 muestra las TEF para experimentos con \(k\) en el rango entre 2 y 10, si las comparaciones por pares fueran independientes y no se aplicara ningún tipo de corrección.

| Número de tratamientos | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 |

|---|---|---|---|---|---|---|---|---|---|

| Número de comparaciones | 1 | 3 | 6 | 10 | 15 | 21 | 28 | 36 | 45 |

| Tasa de error por familia | 0.05 | 0.143 | 0.265 | 0.401 | 0.537 | 0.659 | 0.762 | 0.842 | 0.901 |

Aunque las TEF reales son menores que las presentadas en la tabla 8.1, por la falta de independencia entre las comparaciones por pares, estas seguirán siendo mayores que las tasas de error por comparación. El único caso en el que la TEF es igual a la tasa de error por comparación es aquel en el que se comparan dos medias, no requiriéndose, por tanto, ningún tipo de corrección.

En general, mediante los PCM se aplican ajustes para el control de la TEF. Desde luego, esto afecta las tasas de error por comparación, llevándolas a niveles muy bajos, con la consiguiente disminución de la potencia de las pruebas.

Aunque esta es una estrategia ampliamente aceptada, ello no significa que exista consenso sobre la validez de la misma, siendo destacables las posiciones contrarias de autores como Cox (1965), O’Brien (1983) y Saville (1990), quienes conceden mayor importancia a la tasa de error por comparación y a la potencia de las pruebas individuales.

8.2 Contrastes de medias

Aunque pueden plantearse infinitas combinaciones lineales de medias que satisfagan la condición necesaria para ser contrastes (que la suma de los coeficientes \(c_i\) sea cero), resultan de interés práctico aquellos contrastes que expresan la comparación entre dos grupos de medias.

Los contrastes constituyen la forma más general de comparación de medias. Mediante los contrastes se comparan grupos de medias, en lugar de medias individuales.

Considérese un experimento con cinco tratamientos e igual número de réplicas, con medias poblacionales \(\mu_1,\) \(\mu_2,\) \(\mu_3,\) \(\mu_4\) y \(\mu_5.\) La comparación entre las medias de los tratamientos 1 y 3 y las de los tratamientos 2, 4 y 5 puede expresarse mediante la siguiente hipótesis:

\[

\begin{align}

H_0&:\frac{\mu_1+\mu_3}{2}=\frac{\mu_2+\mu_4+\mu_5}{3}\\[1.4em]

H_0&:3\mu_1+3\mu_3=2\mu_2+2\mu_4+2\mu_5\\[1.4em]

H_0&:3\mu_1+3\mu_3-2\mu_2-2\mu_4-2\mu_5=0\\[1.4em]

\end{align}

\]

La combinación lineal \(\xi=3\mu_1-2\mu_2+3\mu_3-2\mu_4-2\mu_5\) es el contraste que representa la comparación entre las medias del grupo de tratamientos 1, 3 y las del grupo 2, 4, 5.

La comparación entre los dos grupos puede expresarse de manera simplificada, así:

\[

H_0:\xi=0 \text{ vs. } H_a:\xi\ne0

\]

Al plantear un contraste no es necesario que los grupos comparados estén conformados por el mismo número de medias, como tampoco es necesario que todas las medias participen en el contraste, pudiendo asignárseles coeficiente cero a las medias que no participan.

El contraste para comparar la media del tratamiento 1 contra las medias de los tratamientos 3, 4 y 5 se escribe así:

\[

\begin{align}

\xi =& 3\mu_1+0\mu_2-\mu_3-\mu_4-\mu_5\\[1.4em]

=& 3\mu_1-\mu_3-\mu_4-\mu_5

\end{align}

\]

La comparación entre pares de medias es un contraste particular en el que el primer grupo está conformado por una sola media y el segundo grupo también.

El contraste para comparar la media del tratamiento 2 contra la media del tratamiento 5 se escribe así:

\[

\begin{align}

\xi=&0\mu_1+1\mu_2+0\mu_3+0\mu_4-1\mu_5\\[1.4em]

=&\mu_2-\mu_5

\end{align}

\]

Los contrastes constituyen la forma más general de comparación de medias.

Las comparaciones por pares son contrastes particulares.

La posibilidad de comparar grupos de medias introduce un elemento adicional que debe considerarse en los PCM. En un experimento con \(k\) tratamientos, el número de comparaciones no está limitado a las \(\frac{k(k − 1)}{2}\) comparaciones entre pares de medias, sino que pueden realizarse comparaciones adicionales entre grupos de medias.

Como una forma de limitar el número de comparaciones entre grupos de medias, suele recomendarse considerar únicamente conjuntos de contrastes ortogonales o independientes, lo que impone una cota máxima de \(k−1\) comparaciones.

En experimentos con igual número de réplicas, dos contrastes son ortogonales o independientes si la suma de los productos cruzados de sus correspondientes coeficientes es cero.

\[

\text{Sean }\xi_1: c_1\mu_1+c_2\mu_2+\dotsb+c_k\mu_k\quad\text{y}\quad\xi_2: c_1'\mu_1+c_2'\mu_2+\dotsb+c_k'\mu_k

\] \[

\xi_1 \text{ y } \xi_2 \text{ son ortogonales o independientes si y solo si } \sum\limits_{i=1}^k c_ic_i'=0

\]

Existen varias razones para desaconsejar esta práctica:

La restricción de ortogonalidad puede llevar a que el usuario desestime comparaciones de interés.

En la búsqueda del conjunto de los \(k-1\) contrastes ortogonales pueden surgir comparaciones que no sean de interés práctico.

Existen procedimientos de comparación múltiple que permiten realizar cualquier número de comparaciones, manteniendo controlada la TEF.

En consecuencia, se recomienda considerar todos los contrastes que sean de interés, sin importar si representan o no un conjunto de contrastes ortogonales.

En la práctica investigativa, la comparación entre grupos de medias o por contrastes es una herramienta mucho menos conocida y utilizada que la comparación entre pares de medias.

Son muy pocos los estudios en los que se utilizan comparaciones entre dos grupos de medias, sin considerar, desde luego, las comparaciones por pares, como casos particulares de los contrastes.

En tal sentido, más que advertir sobre el riesgo de realizar demasiados contrastes —que es un riesgo controlable—, debería estimularse el uso de esta herramienta en los casos en los que pudiera aportar información relevante.

Los contrastes deben plantearse a priori, de manera tal que exista algún aspecto diferenciador entre los grupos, a la vez que los tratamientos que conformen cada grupo tengan algo en común, que le dé sentido a la media conjunta de tales tratamientos y a la interpretación de la diferencia entre las medias conjuntas de los grupos.

En un experimento para control de plagas, podría ser pertinente realizar un contraste entre biopesticidas y pesticidas químicos.

En un experimento de evaluación de variedades, un contrate entre grupos de diferentes orígenes o grupos de diferentes hábitos de crecimiento podría suministrar información valiosa.

8.2.1 Contrastes entre tratamientos con diferente número de réplicas

Cuando no todos los tratamientos tienen el mismo número de réplicas, los coeficientes para los contraste se obtienen planteando el juego de hipótesis a partir de medias ponderadas dentro de cada grupo.

Para ilustrarlo, supóngase las siguientes réplicas para un experimento con 5 tratamientos:

| Tratamiento | Réplicas |

|---|---|

| Tto1 | 5 |

| Tto2 | 7 |

| Tto3 | 3 |

| Tto4 | 5 |

| Tto5 | 4 |

La hipótesis nula correspondiente a la comparación entre el grupo de tratamientos 1, 2 y 3 y el grupo de tratamientos 4 y 5 se expresa así:

\[

\begin{align}

H_0&:\frac{5\mu_1+7\mu_2+3\mu_3}{15}=\frac{5\mu_4+4\mu_5}{9}\\[1.4em]

H_0&:\frac{5\mu_1+7\mu_2+3\mu_3}{15}-\frac{5\mu_4+4\mu_5}{9}=0&\\[1.4em]

H_0&:\frac{5}{15}\mu_1+\frac{7}{15}\mu_2+\frac{3}{15}\mu_3-\frac{5}{9}\mu_4-\frac{4}{9}\mu_5=0

\end{align}

\]

Luego, los coeficientes del correspondiente contraste, son:

\(c_1=\frac{5}{15},\) \(c_2=\frac{7}{15},\) \(c_3=\frac{3}{15},\) \(c_4=-\frac{5}{9}\) y \(c_5=-\frac{4}{9}.\)

8.3 Intervalos de confianza simultánea

Los intervalos de confianza y las pruebas de hipótesis son las dos caras de la moneda de un mismo proceso inferencial, por la relación uno a uno que existe entre pruebas de hipótesis de dos colas e intervalos de confianza (cf. nota 4.1, sección Sección 4.5 y numeral 8 del decálogo sobre pruebas de hipótesis). En consecuencia, los PCM también puede abordarse mediante intervalos de confianza simultánea, ya sea para diferencias de medias (comparaciones por pares) o para contrastes.

En este contexto es particularmente relevante observar si el intervalo de confianza contiene el cero. Un intervalo de confianza para \(\mu_1−\mu_2\) que contenga al cero indica que no hay diferencia estadísticamente significativa entre \(\mu_1\) y \(\mu_2.\) Las diferencias estadísticamente significativas se verán reflejadas por intervalos con ambos límites negativos o ambos positivos. Un intervalo de confianza para \(\mu_1−\mu_2\) en el que ambos límites sean positivos indica que \(\mu_1\) supera significativamente a \(\mu_2,\) mientras que un intervalo de confianza para \(\mu_1−\mu_2\) con límites negativos indica que \(\mu_2\) supera significativamente a \(\mu_1\) (cf. nota 5.1).

Al comparar grupos de medias mediante contrastes, la interpretación de los correspondientes intervalos de confianza es análoga a la presentada anteriormente, pero en lugar de comparar \(\mu_1\) contra \(\mu_2,\) se compara el grupo de medias que entran con signo positivo en el contraste contra el grupo de medias que entran con signo negativo.

Un intervalo de confianza del \(100(1−\alpha)\,\%\) para la diferencia \(\mu_1−\mu_2\) se interpreta de la forma habitual: “Se tiene una confianza del \(100(1−\alpha)\,\%\) en que \(\mu_1\) supera a \(\mu_2\) en una cantidad que está entre el límite inferior y el límite superior” (cf. nota 5.1).

No obstante, por la misma razón por la que la TEF se infla con relación a la tasa de error por comparación cuando se realizan múltiples pruebas de hipótesis, la confianza global del conjunto de intervalos es menor que las confianzas individuales, requiriéndose, por tanto, un ajuste o corrección para la confianza global del conjunto de intervalos.

Cuando se cuenta con un conjunto de intervalos para diferencias de medias (o diferencias de grupos de medias), cuya confianza global sea \((1 − \alpha)100\,\%,\) se dice que “se tiene una confianza del \(100(1−\alpha)\,\%\) en que todas las diferencias de medias se encuentran dentro de los límites de sus correspondientes intervalos”.

La probabilidad de que al menos uno de los intervalos no contenga la diferencia real es \(\alpha.\)

Así, si se realizara una corrección tal que diera lugar a una confianza global del 95 % para el conjunto de intervalos de confianza que conforman un experimento, se tendría una confianza del 95 % en que tales intervalos incluyeran las diferencias reales entre las medias o, en otras palabras, la probabilidad de que al menos una de las diferencias reales estuviera por fuera de su intervalo sería 0.05.

La confianza simultánea es la contraparte conceptual, en términos de intervalos, de la TEF. En el marco de los PCM clásicos, solamente los procedimientos que controlan la TEF pueden llevar asociados intervalos de confianza simultánea.

Entre angloparlantes, la denominación simultaneous confidence intervals es suficiente. No obstante, al proponer una traducción es importante preguntarse a cuál sustantivo hace referencia la simultaneidad: a los intervalos o a la confianza.

El aspecto central de este concepto tiene que ver con el hecho de que pueda asignársele una confianza global o simultánea al conjunto de intervalos; no al hecho de obtener todos los intervalos al mismo tiempo.

Luego, una traducción acorde con este espíritu sería intervalos de confianza simultánea.

Al referirse a los procedimientos que generan estos intervalos, Hochberg y Tamhane (1987) los denominan simultaneous confidence procedures. Cuando se refieren a un procedimiento particular, lo denominan a simultaneous confidence procedure. Esto ratifica que la simultaneidad se refiere a la confianza no a los intervalos ni a los procedimientos que los generan.

En consecuencia, aunque la traducción “intervalos de confianza simultáneos” es la más extendida en español, preferimos utilizar intervalos de confianza simultánea por recoger mejor el espíritu de la simultaneidad.

8.4 Prueba de la diferencia mínima significativa

La prueba de la diferencia mínima significativa-DMS (Least Significant Difference-LSD), propuesta por Fisher en 1935, constituyó una de las primeras alternativa para la comparación de medias.

Al tratarse de una reescritura de la prueba de \(t\) presentada en la sección 5.2.1, en este contexto, también se le denomina prueba de \(t\).

En el contexto del ANOVA, la comparación de dos medias se plantea mediante el siguiente juego de hipótesis:

\[

H_0: \mu_1=\mu_2\Leftrightarrow\mu_1-\mu_2=0

\] \[

H_a: \mu_1\ne\mu_2\Leftrightarrow\mu_1-\mu_2\ne0

\]

Puesto que una de las condiciones del ANOVA es la homogeneidad de varianzas (cf. sección 6.3), sería posible contrastar estas hipótesis usando la prueba de \(t\) para comparación de medias de dos poblaciones normales con varianzas homogéneas (cf. sección 5.2.1).

El estadístico de prueba usado para dicha comparación es (cf. expresión 5.5):

\[

t_\text{c}=\frac{\overline{X}_1-\overline{X}_2}

{\sqrt{S_\text{p}^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}}

\overset {H_0}\thicksim t_{\left(n_1+n_2-2\right)},

\]

donde la varianza combinada se calcula así (cf. expresión 5.3):

\[

S_\text{p}^2=\frac{(n_1-1)S_1^2+(n_2-1)S_2^2}{n_1+n_2-2}

\]

En el contexto del ANOVA, el equivalente de la varianza combinada es el \(\text{CME},\) que corresponde a la media ponderada por los grados de libertad de las varianzas dentro de tratamientos (cf. secciones 6.1.9 y 6.2.5):

\[

\text{CME}=\frac{(r_1-1)S_1^2+(r_2-1)S_2^2+\dotsb+(r_k-1)S_k^2}

{n-k}

\]

Por consiguiente, adaptando la nomenclatura, el estadístico de prueba puede escribirse así:

\[

t_\text{c}=\frac{\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}}

{\sqrt{\text{CME}\left(\frac{1}{r_1}+\frac{1}{r_2}\right)}}

\overset {H_0}\thicksim t_{\left(n-k\right)}

\]

Para una prueba de dos colas, como la planteada, el criterio de rechazo es el siguiente (cf. tabla 5.3 y figura 5.6):

\[

\text{rechaza } H_0\text{ si }|t_\text{c}|\ge t_{\alpha/2(n-k)}

\]

Remplazando el símbolo del estadístico de prueba por su expresión se tiene:

\[

\text{si }\left|\dfrac{\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}}

{\sqrt{\text{CME}\left(\frac{1}{r_1}+\frac{1}{r_2}\right)}}\right|

\ge t_{\alpha/2(n-k)}\Rightarrow \text{rechaza } H_0 \text{ con un nivel }\alpha

\]

Hasta este punto, lo que se tiene es una prueba de \(t\) igual a la presentada en la sección 5.2.1, no difiriendo más que en la notación.

Este criterio se reescribe de una forma que permite su posterior simplificación y que resulta más interpretable y generalizable:

\[

\text{si }\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|\ge

t_{\alpha/2(n-k)}{\sqrt{\text{CME}\left(\frac{1}{r_1}+\frac{1}{r_2}\right)}}

\Rightarrow \text{rechaza } H_0

\]

Cuando los tratamientos comparados tienen el mismo número de réplicas, la anterior expresión se simplifica así:

\[

\text{si }\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|\ge

t_{\alpha/2(n-k)}\sqrt{\dfrac{2\text{CME}}{r}}

\Rightarrow \text{rechaza } H_0

\]

Bajo los supuestos del ANOVA, las medias muestrales son variables aleatorias independientes y normalmente distribuidas con media \(\mu_i\) y varianza \(\frac{σ^2}{r}:\)

\[

\overline{Y}_{i\bullet}\thicksim N\left(\mu_i,\;\frac{σ^2}{r}\right),\quad i=1, 2, \dotsc, k

\]

La diferencia entre dos medias muestrales es a su vez una variable aleatoria normal:

\[

\left(\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right)\thicksim N\left(\mu_1-\mu_2,\;\frac{2σ^2}{r}\right)

\]

El estimador de la desviación estándar de la diferencia de medias se denomina error estándar de la diferencia de medias. Este se denota y calcula así:

\[

S_{\overline{Y}_{1}-\overline{Y}_{2}} =\sqrt{\dfrac{2\text{CME}}{r}}

\]

Luego, el criterio de comparación de medias puede escribirse de manera compacta así:

\[

\text{si }\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|\ge

t_{\alpha/2(\text{gle})}S_{\overline{Y}_{1}-\overline{Y}_{2}}

\Rightarrow \text{rechaza } H_0 \text{ con un nivel }\alpha

\]

A la expresión del lado derecho de la desigualdad se le denomina diferencia mínima significativa (DMS), puesto que es la diferencia mínima que debe existir entre dos medias muestrales para poder declarar significancia con un nivel \(\alpha.\) De ahí surge el nombre de la prueba.

El criterio de comparación de dos medias mediante la prueba de la diferencia mínima significativa se expresa así:

\[

\text{si }\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|\ge

\text{DMS}

\Rightarrow \text{rechaza } H_0 \text{ con un nivel de significancia }\alpha

\]

La DMS es la mínima diferencia que debe observarse entre dos medias muestrales para declarar con un nivel de significancia \(\alpha\) que las correspondientes medias poblacionales difieren.

Mientras menor sea la DMS, más probable será declarar diferencias significativas, es decir, mayor será la potencia de las pruebas.

En consecuencia, la potencia de las pruebas está determinada por los diferentes elementos que conforman la DMS: \(\alpha,\) \(\text{gle},\) \(\text{CME}\) y \(r:\)

\[

\text{DMS}=t_{\alpha/2(\text{gle})}\sqrt{\dfrac{2\text{CME}}{r}}

\]

A continuación se detalla el efecto de cada uno de estos componentes. En todos los casos es posible realizar una interpretación aritmética directa —considerando su posición en la expresión— así como una interpretación intuitiva —teniendo en cuenta su papel en la prueba—:

1. Efecto de \(\alpha.\) La figura 8.1, correspondiente a la parte derecha de una distribución \(t,\) muestra que mientras menor sea \(\alpha,\) mayor será su correspondiente valor crítico2, lo que incrementa la DMS y reduce la potencia.

La relación inversa entre las probabilidades de error tipo I y tipo II, para una muestra fija en términos de tamaño y variabilidad, es una característica propia de todas las pruebas de hipótesis. Esta relación se explora en detalle en la sección 3.9.2.2.

2. Efecto de los grados de libertad del error. La figura 8.2, correspondiente a la parte derecha de dos distribuciones \(t\) con diferente número de grados de libertad, muestra que, mientras mayor sea el número de grados de libertad del error, menor será su correspondiente valor crítico, lo que da lugar a un menor valor de la DMS y, por tanto, a una mayor potencia.

En términos de la forma de la distribución, esto se explica por el incremento de la condición leptocúrtica de la distribución \(t\) a medida que sus grados de libertad disminuyen. Mientras más pesadas sean las colas de la distribución (más área en las colas), más se desplazará el correspondiente valor crítico hacia la derecha.

En términos de la prueba, la disminución en la potencia se explica por la mayor incertidumbre que acompaña los procesos inferenciales cuando la estimación del error experimental está basada en un menor número de elementos independientes.

Los grados de libertad del error constituyen el elemento central de la ecuación de los recursos propuesta por Mead, Gilmour y Mead (2012) (cf. ?sec-mead), que sirve como guía para elegir el número de réplicas en un ensayo.

3. Cuadrado medio del error. El \(\text{CME}\), al aparecer en el numerador de la DMS, se relaciona directamente con esta. Mientras menor sea el \(\text{CME},\) menor será la DMS y, por ende, mayor la potencia.

Lógicamente, mientras menor sea la variabilidad entre unidades experimentales asociadas a un mismo tratamiento, la prueba será más sensible y podrá declarar diferencias significativas a partir de diferencias menores.

4. Número de réplicas. Por su parte, el número de réplicas, al aparecer en el denominador de la DMS, se relaciona inversamente con esta. A mayor número de réplicas, menor será la DMS y, por tanto, mayor la potencia.

Esto es consistente con la prescripción de incrementar el tamaño de muestra (número de réplicas en el presente contexto) para aumentar la potencia.

La tabla 8.2 resume el efecto de los diferentes componentes de la DMS en su magnitud y, por tanto, en la potencia de las pruebas. Las relaciones que allí se presentan son válidas para todos los procedimientos de comparación múltiple.

| Componente de la DMS | Efecto en la DMS | Efecto en la potencia |

|---|---|---|

| \(\downarrow\;\alpha\) | \(\uparrow\;\) DMS | \(\downarrow\; (1-\beta)\) |

| \(\uparrow\;\text{gle}\) | \(\downarrow\;\) DMS | \(\uparrow\; (1-\beta)\) |

| \(\downarrow\;\text{CME}\) | \(\downarrow\;\) DMS | \(\uparrow\; (1-\beta)\) |

| \(\uparrow\;r\) | \(\downarrow\;\) DMS | \(\uparrow\; (1-\beta)\) |

A continuación, se ilustra el proceso de aplicación de la prueba DMS, para realizar las seis posibles comparaciones entre los pares de medias del ejemplo 7.1, con un nivel de significancia \(\alpha=0.05.\)

\[

\begin{align}

\text{DMS}&=t_{\alpha/2(\text{gle})}\sqrt{\dfrac{2\text{CME}}{r}}\\[1.4em]

&=t_{0.025(8)}\sqrt{\dfrac{2\times 0.025}{3}}\\[1.4em]

&=2.3060 \times 0.1291\\[1.4em]

&=0.2977

\end{align}

\]

En cada comparación, si la diferencia absoluta entre un par de medias muestrales es mayor o igual que la DMS (0.2977), se rechaza la correspondiente hipótesis nula con un nivel de significancia del 5 %. Las medias muestrales aparecen en la última columna de la tabla 7.1.

\[

\begin{align}

\mu_{\text{A}}\text{ vs. } \mu_{\text{B}}&:\quad \left|\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{B} \bullet}\right|=

\left|4.1-3.2\right|=0.9>0.2977\quad*\\[0.5em]

\mu_{\text{A}}\text{ vs. } \mu_{\text{C}}&:\quad \left|\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{C} \bullet}\right|=

\left|4.1-3.8\right|=0.3>0.2977\quad*\\[0.7em]

\mu_{\text{A}}\text{ vs. } \mu_{\text{D}}&:\quad \left|\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{D} \bullet}\right|=

\left|4.1-3.9\right|=0.2<0.2977\quad\text{ns}\\[0.7em]

\mu_{\text{B}}\text{ vs. } \mu_{\text{C}}&:\quad \left|\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{C} \bullet}\right|=

\left|3.2-3.8\right|=0.6>0.2977\quad*\\[0.7em]

\mu_{\text{B}}\text{ vs. } \mu_{\text{D}}&:\quad \left|\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{D} \bullet}\right|=

\left|3.2-3.9\right|=0.7>0.2977\quad*\\[0.7em]

\mu_{\text{C}}\text{ vs. } \mu_{\text{D}}&:\quad \left|\overline{Y}_{\text{C}\bullet}-\overline{Y}_{\text{D} \bullet}\right|=

\left|3.8-3.9\right|=0.1<0.2977\quad\text{ns}

\end{align}

\]

En cada una de las comparaciones anteriores se contrasta un juego de hipótesis sobre las correspondientes medias poblacionales. Así, la primera comparación permite decidir sobre el juego de hipótesis:

\[

H_0: \mu_{\text{A}}=\mu_{\text{B}}

\] \[

H_a: \mu_{\text{A}}\ne\mu_{\text{B}}

\]

Este juego de hipótesis se representa de manera compacta mediante la expresión \(\mu_{\text{A}}\text{ vs. } \mu_{\text{B}}\).

Aunque esta señalización no suele aparecer en los resultados de las pruebas —en las que usualmente se presentan solo las medias muestrales, omitiendo toda referencia a las medias poblacionales— es importante tenerla presente, a fin de evitar interpretaciones erróneas.

El hecho de que en los resultados se presente únicamente las medias muestrales puede llevar a pensar que son estas las que se comparan. Esto, desde luego, carece de interés. Las medias muestrales casi siempre son diferentes. Es totalmente irrelevante responder si 4.1 difiere de 3.9 (desde luego, difieren); lo que interesa averiguar es si la diferencia entre dichas medias muestrales es de una magnitud tal que permita afirmar con baja probabilidad de error que las correspondientes medias poblacionales son diferentes.

Los procesos inferenciales que se realizan mediante la DMS son equivalentes a los ilustrados en la sección 5.2, donde se utilizan medias muestrales para inferir sobre medias poblacionales.

En los casos en los que la diferencia entre las medias muestrales es mayor o igual que 0.2977, se rechaza la hipótesis nula al 5 %, lo cual se denota mediante un asterisco; en los demás casos, puede usarse la etiqueta \(\text{ns}\) o no usar ninguna marca.

Así, por ejemplo, puede afirmarse, con una probabilidad de error máxima de 0.05 que \(\mu_{\text{A}}\) es diferente de \(\mu_{\text{B}},\) mientras que no es posible afirmar con una probabilidad máxima de error de 0.05 que exista diferencia entre \(\mu_{\text{A}}\) y \(\mu_{\text{D}}.\)

Lo anterior, desde luego, deberá expresarse y discutirse acorde con cada contexto. Para el ejemplo 7.1 podría afirmarse con una probabilidad máxima de error de 0.05 que el pH medio de la pulpa de guanábana, empacada con el sistema \(\text{A}\) difiere del pH medio de la pulpa de guanábana empacada con el sistema \(\text{B},\) mientras que no es posible afirmar con una probabilidad máxima de error de 0.05 que el pH medio de la pulpa de guanábana, empacada con el sistema \(\text{A}\) difiera del pH medio bajo el sistema \(\text{D}.\)

Los resultados de los contrastes suelen agruparse —usando un código de letras— en una tabla en la que se organizan las medias, ya sea de manera ascendente o descendente. La elección entre uno u otro orden responde a criterios de presentación. Con frecuencia se utiliza el orden descendente para destacar los tratamientos con mayores promedios.

Se asigna una letra común a los tratamientos cuyas medias no difieren significativamente. Por el contrario, los tratamientos cuyas medias difieren significativamente no tendrán ninguna letra común3.

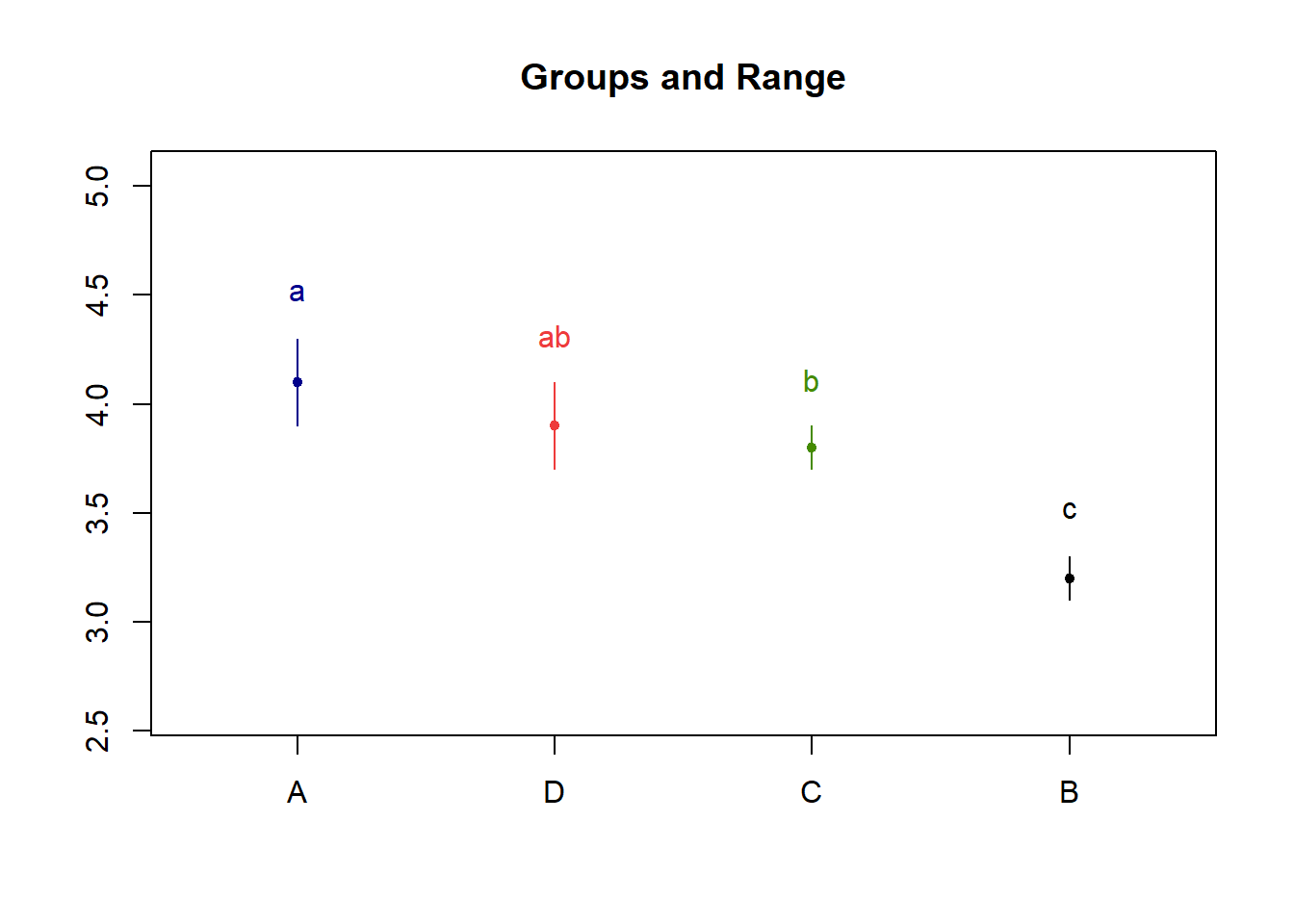

La tabla 8.3 muestra dicho resumen o agrupación para las medias de los tratamientos del ejemplo 7.1.

| Tratamiento | \(\overline{Y}_{i\bullet}\) | Grupos |

|---|---|---|

| \(\text{A}\) | 4.1 | a |

| \(\text{D}\) | 3.9 | ab |

| \(\text{C}\) | 3.8 | b |

| \(\text{B}\) | 3.2 | c |

La tabla 8.3 debe acompañarse de la siguiente leyenda:

Las medias de los tratamientos con alguna letra común no difieren al 5 %, según la prueba DMS.

Es necesario tener precaución con la forma en la que se escribe la leyenda acompañante de este tipo de tablas.

Es muy común ver leyendas como la siguiente:

Las medias de los tratamientos con letras distintas difieren al 5 %, según la prueba DMS.

Aunque aparentemente se trata de la misma leyenda, expresada de manera diferente, no lo es y lo que allí se indica es incorrecto.

Con base en lo que se dice en esta última leyenda se concluiría que, dado que el tratamiento \(\text{A}\) y el tratamiento \(\text{D}\) van acompañados de letras diferentes (a y b), los pH medios de tales tratamientos difieren significativamente.

Desde luego, ni es esta la conclusión correcta ni era esto lo que se pretendía expresar.

La tabla 8.3 permite captar rápidamente el orden de los valores de pH. También se observa que no hay diferencia significativa entre el pH medio de los tratamientos \(\text{A}\) y \(\text{D}\) (comparten la letra a), ni entre el pH medio de los tratamientos \(\text{D}\) y \(\text{C}\) (comparten la letra b). Entre los demás pares de tratamientos, la DMS permite declarar diferencia significativa al 5 %.

La tabla 8.3 también permite visualizar rápidamente que el pH medio del tratamiento \(\text{B}\) es significativamente menor que el de todos los demás tratamientos.

Los resultados agrupados en los que hay tratamientos con más de una letra pueden generar desconcierto, al considerarse que reflejan una violación al principio de transitividad, el cual establece que si \(\text{A}=\text{B}\) y \(\text{B}=\text{C}\), entonces \(\text{A}=\text{C}.\)

La información condensada en la tabla 8.3 conlleva la aceptación de que \(\mu_{\text{A}}\) no es diferente de \(\mu_{\text{D}}\). Asimismo, se acepta que \(\mu_{\text{D}}\) no es diferente de \(\mu_{\text{C}}.\) Sin embargo, se rechaza que \(\mu_{\text{A}}\) sea igual a \(\mu_{\text{C}}.\)

Suele hablarse de grupos homogéneos en referencia a grupos de medias con una letra común, es decir, un grupo de medias entre las cuales no existe diferencia estadísticamente significativa.

En el presente ejemplo, los tratamientos \(\text{A}\) y \(\text{D}\) conforman un grupo homogéneo, mientras que los tratamientos \(\text{D}\) y \(\text{C}\) conforman otro grupo homogéneo.

Las letras indicadoras que aparecen en la última columna de la tabla 8.3 señalan la membresía de un tratamiento a un grupo determinado, pudiendo suceder que un tratamiento pertenezca a varios grupos simultáneamente, lo cual puede representarse mediante un diagrama de grupos homogéneos traslapantes (figura 8.3).

En la figura 8.3 se ilustra que \(\mu_{\text{D}}\) forma parte del mismo grupo que \(\mu_{\text{C}}\) y también comparte grupo con \(\mu_{\text{A}}\). Sin embargo, \(\mu_{\text{C}}\) no comparte grupo con \(\mu_{\text{A}}.\)

El paquete agricolae para R incluye funciones para realizar los PCM más populares. La función LSD.test implementa la prueba de la diferencia mínima significativa.

Las funciones de agricolae que se utilizan para la realización de diferentes PCM comparten una serie de argumentos comunes:

y: Objeto de la claseaovolmcon el modelo ajustado del ANOVA.trt: Nombre de los tratamientos. Debe especificarse entre comillas.group: Variable lógica que indica si los resultados deben presentarse de manera resumida en formato de grupos homogéneos, como el de la tabla 8.3. Por defecto,group = TRUE.console: Variable lógica que indica si los resultados deben presentarse en consola. Por defecto,console = FALSE.

El siguiente fragmento de código ilustra el uso de la función LSD.test, incluyendo en las tres primeras líneas los pasos preliminares necesarios, como se ilustró en el desarrollo del ejemplo 7.1. El objeto anova que se genera en la línea 3 es el que se utiliza como argumento principal de la función LSD.test en la línea 5:

Antes de analizar los resultados, vale la pena realizar algunos comentarios sobre la sintaxis de las funciones de este paquete.

Aunque existen otras maneras de alimentar la información del modelo en la función, la más práctica es la expuesta en el fragmento anterior, es decir, la que consiste en ajustar previamente el ANOVA, cuyos resultados se utilizan como primer argumento, lo que permite extraer de allí casi toda la información necesaria para la realización de la prueba.

Todas las funciones que forman parte de este paquete trabajan por defecto con un nivel de significancia del 5 % (alpha = 0.05).

Salvo que los resultados únicamente constituyan un paso intermedio de un proceso posterior, lo usual es querer visualizarlos en consola. Dado que el valor por defecto del argumento console es FALSE, se hace necesario especificar console = TRUE para que estos se muestren en la consola.

Los resultados son los siguientes:

Study: anova ~ "tto"

LSD t Test for pH

Mean Square Error: 0.025

tto, means and individual ( 95 %) CI

pH std r se LCL UCL Min Max Q25 Q50 Q75

A 4.1 0.2 3 0.09128709 3.889492 4.310508 3.9 4.3 4.00 4.1 4.20

B 3.2 0.1 3 0.09128709 2.989492 3.410508 3.1 3.3 3.15 3.2 3.25

C 3.8 0.1 3 0.09128709 3.589492 4.010508 3.7 3.9 3.75 3.8 3.85

D 3.9 0.2 3 0.09128709 3.689492 4.110508 3.7 4.1 3.80 3.9 4.00

Alpha: 0.05 ; DF Error: 8

Critical Value of t: 2.306004

least Significant Difference: 0.2977039

Treatments with the same letter are not significantly different.

pH groups

A 4.1 a

D 3.9 ab

C 3.8 b

B 3.2 cEn la primera parte aparece información de carácter general:

- Mean Square Error: \(\text{CME}=0.025\)

- Alpha: \(\alpha=0.05\)

- DF Error: \(\text{gle}=8\)

- Critical value of t: \(t_{0.025(8)}=2.306004\)

- Least Significant Difference: \(\text{DMS}=0.2977039\)

También en la primera parte se presenta información descriptiva para cada uno de los tratamientos (media, desviación estándar, número de réplicas, entre otros). Esta información puede ser útil para caracterizar los datos, aunque no es central en el contexto de los PCM.

Asimismo, se presentan intervalos de confianza individuales para cada tratamiento, cuya interpretación en este contexto requiere especial precaución.

En el contexto del ANOVA, bajo el supuesto de homogeneidad de varianzas, los procesos inferenciales se fundamentan en el estimador conjunto de la varianza (\(\text{CME}\)), no en estimaciones individuales.

En la salida de la función LSD.test se presentan intervalos de confianza para la media de cada tratamiento, construidos a partir del error estándar individual, lo que rompe el marco conceptual del ANOVA basado en una varianza común.

Por tal motivo, estos intervalos no deben considerarse —ni siquiera como guía— para la comparación de tratamientos.

En la parte final aparece el resumen de grupos homogéneos como el que se mostró en la tabla 8.3.

Asimismo, los resultados de la función LSD.test pueden usarse como argumento de la función plot para generar un gráfico que permite visualizar la posición de la media de cada tratamiento, su variabilidad, en términos del recorrido, y las letras usadas para definir los diferentes grupos, tal y como lo ilustra el siguiente fragmento de código:

out.LSD <- LSD.test(anova, "tto")

plot(out.LSD)

box()

Teniendo en cuenta que la DMS no es más que una reexpresión de la prueba de \(t,\) puede obtenerse el valor p asociado con esta prueba, de acuerdo con lo indicado en la sección 5.2.1.1 (cf. tabla 5.3 y figura 5.6).

Para comparar, por ejemplo, las medias de los tratamientos 1 y 2, el estadístico de prueba es:

\[

t_\text{c}=\frac{\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}}

{\sqrt{\dfrac{2\,\text{CME}}{r}}}

\overset {H_0}\thicksim t_{\left(\text{gle}\right)}

\]

Por consiguiente, el valor p se calcula así:

\[

2\, P\left(t_\text{(gle)}>|t_\text{c}|\right)

\]

Para el ejemplo 7.1 se obtiene la siguiente expresión general del estadístico de prueba:

\[

\begin{align}

t_\text{c}&=\frac{\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}}

{\sqrt{\dfrac{2\,\text{CME}}{r}}}\\[1.4em]

&=\frac{\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}}

{\sqrt{\dfrac{2\times 0.025}{3}}}\\[1.4em]

&=\frac{\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}}

{0.129099}\\[1.4em]

\end{align}

\]

La tabla 8.4 muestra el estadístico de prueba para los diferentes contrastes entre pares de medias y sus correspondientes valores p.

| Comparación | \(t_\text{c}\) | Valor p |

|---|---|---|

| \(\mu_{\text{A}}\text{ vs. } \mu_{\text{B}}\) | 6.971394 | 0.000116 |

| \(\mu_{\text{A}}\text{ vs. } \mu_{\text{C}}\) | 2.323798 | 0.048630 |

| \(\mu_{\text{A}}\text{ vs. } \mu_{\text{D}}\) | 1.549199 | 0.159927 |

| \(\mu_{\text{B}}\text{ vs. } \mu_{\text{C}}\) | −4.647596 | 0.001650 |

| \(\mu_{\text{B}}\text{ vs. } \mu_{\text{D}}\) | −5.422195 | 0.000629 |

| \(\mu_{\text{C}}\text{ vs. } \mu_{\text{D}}\) | −0.774599 | 0.460855 |

La comparación de los valores p con el nivel de significancia elegido \((\alpha=0.05)\) produce las mismas conclusiones que la comparación de la diferencia de medias muestrales con la DMS.

Nótese que solamente las comparaciones \(\mu_\text{B}\text{ vs. } \mu_\text{C}\) y \(\mu_\text{C}\text{ vs. } \mu_\text{D}\) tienen asociados valores p mayores que 0.05, coincidiendo con diferencias entre medias muestrales menores que la DMS y, por tanto, con la ausencia de diferencias significativas al 5 %.

8.4.1 Intervalos de Confianza DMS

En adición a las pruebas de hipótesis, también es posible generar intervalos de confianza para las diferencias de medias, usando la metodología descrita en sección 5.2.1.2, bastando con adaptar la notación.

Así, un intervalo de confianza del 95 % para la diferencia entre \(\mu_1\) y \(\mu_2\) está dado por:

\[

\begin{align}

\text{IC}_{95\%}:&\left(\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right)\pm t_{0.025(\text{gle})}

\sqrt{\dfrac{2\,\text{CME}}{r}}\\[1.4em]

=&\left(\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right)\pm \text{DMS}

\end{align}

\]

Nótese que para la construcción del intervalo no se trabaja con la diferencia absoluta entre las medias, sino que se tiene en cuenta el sentido de la diferencia.

Aunque un intervalo de confianza del \(100(1−\alpha)\,\%\) para \(\mu_1−\mu_2\) brinda la misma información que un intervalo de confianza del \(100(1−\alpha)\,\%\) para \(\mu_2−\mu_1\) (cf. tip 5.1), para su interpretación, debe tenerse presente a qué diferencia particular le corresponde un intervalo dado.

A continuación, se presentan los seis posibles intervalos de confianza del 95 % para las diferencias de medias del ejemplo 7.1.

\[

\begin{align}

\mu_{\text{A}}-\mu_{\text{B}}&: \left(\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{B} \bullet}\right)

\pm \text{DMS}=0.9 \pm 0.2977&:&[0.6023,\,1.1977]\:&*\\[0.5em]

\mu_{\text{A}}-\mu_{\text{C}}&: \left(\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{C} \bullet}\right)

\pm \text{DMS}=0.3\pm 0.2977&:&[0.0023,\,0.5977]&*\\[0.7em]

\mu_{\text{A}}-\mu_{\text{D}}&: \left(\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{D} \bullet}\right)

\pm \text{DMS}=0.2\pm 0.2977&:&[-0.0977,\,0.4977]&\text{ns}\\[0.7em]

\mu_{\text{B}}-\mu_{\text{C}}&: \left(\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{C} \bullet}\right)

\pm \text{DMS}=-0.6\pm 0.2977&:&[-0.8977,\,-0.3023]&*\\[0.7em]

\mu_{\text{B}}-\mu_{\text{D}}&: \left(\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{D} \bullet}\right)

\pm \text{DMS}=-0.7\pm 0.2977&:&[-0.9977,\,-0.4023]&*\\[0.7em]

\mu_{\text{C}}-\mu_{\text{D}}&: \left(\overline{Y}_{\text{C}\bullet}-\overline{Y}_{\text{D} \bullet}\right)

\pm \text{DMS}=-0.1\pm 0.2977&:&[-0.3977,\,0.1977]&\text{ns}

\end{align}

\]

La significancia se determina a través del intervalo de confianza, verificando si contiene el cero (cf. sección 8.3). Además de la coincidencia de resultados —en términos de significancia— entre pruebas de hipótesis e intervalos de confianza, los intervalos de confianza aportan información sobre el sentido y la magnitud de las diferencias.

Así, por ejemplo, al comparar \(\mu_\text{A}\) y \(\mu_\text{B}\) mediante el juego de hipótesis, se concluye con una probabilidad máxima de error de 0.05 que \(\mu_\text{A}\) es diferente de \(\mu_\text{B}.\) Mediante el intervalo de confianza para \(\mu_\text{A}-\mu_\text{B},\) adicionalmente puede afirmarse con una confianza del 95 % que el pH medio del tratamiento \(\text{A}\) supera el pH medio del tratamiento \(\text{B}\) en una cantidad que está entre 0.6023 y 1.1977.

Es innegable que las pruebas de hipótesis gozan de mayor popularidad que los intervalos de confianza.

Esto puede deberse en parte al desconocimiento de los intervalos de confianza como alternativa inferencial en el contexto de los PCM, pero también a la capacidad de resumen y facilidad interpretativa que brindan los esquemas agrupados como el de la tabla 8.3.

Así, por ejemplo, para un experimento con \(k=10\), el resultado basado en intervalos consta de 45 líneas, mientras que su correspondiente resumen como grupos homogéneos se presenta en 10 líneas.

Asimismo, vale la pena anotar que no todos los PCM permiten generar intervalos de confianza (cf. sección 8.10).

Los intervalos de confianza muestran de manera completa toda la información de cada una de las comparaciones. La tabla de grupos homogéneos la resume.

El intervalo de confianza para la diferencia de medias puede escribirse en términos de la DMS:

\[

\text{IC}_{95\%}: \left(\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right)\pm \text{DMS}

\]

Esta expresión destaca cómo la relación entre la DMS y la diferencia de medias muestrales determina la significancia de una comparación:

Si \(\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|\ge\text{DMS},\) la diferencia es significativa y —puesto que la DMS representa el semirradio del intervalo de confianza del \(100(1−\alpha)\,\%\)— el intervalo de confianza no contiene el cero.

Si \(\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|<\text{DMS},\) la diferencia no es significativa y el intervalo de confianza del \(100(1−\alpha)\,\%\) contiene el cero.

En otras palabras, la comparación mediante la DMS y la evaluación del intervalo de confianza son criterios completamente equivalentes.

Para obtener en R los intervalos de confianza para las diferencias de medias, con base en la prueba DMS, se usa la función LSD.test, incluyendo la opción group = FALSE.

LSD.test(anova, "tto", group = FALSE, console = TRUE)

Study: anova ~ "tto"

LSD t Test for pH

Mean Square Error: 0.025

tto, means and individual ( 95 %) CI

pH std r se LCL UCL Min Max Q25 Q50 Q75

A 4.1 0.2 3 0.09128709 3.889492 4.310508 3.9 4.3 4.00 4.1 4.20

B 3.2 0.1 3 0.09128709 2.989492 3.410508 3.1 3.3 3.15 3.2 3.25

C 3.8 0.1 3 0.09128709 3.589492 4.010508 3.7 3.9 3.75 3.8 3.85

D 3.9 0.2 3 0.09128709 3.689492 4.110508 3.7 4.1 3.80 3.9 4.00

Alpha: 0.05 ; DF Error: 8

Critical Value of t: 2.306004

Comparison between treatments means

difference pvalue signif. LCL UCL

A - B 0.9 0.0001 *** 0.602296146 1.1977039

A - C 0.3 0.0486 * 0.002296146 0.5977039

A - D 0.2 0.1599 -0.097703854 0.4977039

B - C -0.6 0.0016 ** -0.897703854 -0.3022961

B - D -0.7 0.0006 *** -0.997703854 -0.4022961

C - D -0.1 0.4609 -0.397703854 0.1977039De nuevo, la parte relevante de los resultados aparece al final, debajo del encabezado Comparison between treatments means. Esta salida incluye los valores p de las pruebas de hipótesis de cada una de las comparaciones por pares (cf. tabla 8.4) y los intervalos de confianza del 95 % (por defecto alpha = 0.05) para las diferencias de medias, donde LCL (lower confidence limit) corresponde al límite inferior y UCL (upper confidence limit) al superior.

group

El argumento group determina la manera en la que se presentan los resultados de los PCM generados por las funciones de agricolae:

8.4.2 Contrastes DMS

Un contraste es una combinación lineal de medias que permite comparar dos grupos de tratamientos (cf. sección 8.2).

A partir de un contraste puede formularse un juego de hipótesis para comparar las medias de los dos grupos, así:

\[

H_0:\xi=0,\quad H_a:\xi\ne0

\]

La prueba DMS permite evaluar este juego de hipótesis, comparando el valor estimado del contraste con un valor de referencia.

El estimador de un contraste está dado por una combinación lineal equivalente de las medias muestrales:

\[

\widehat\xi=\sum\limits_{i=1}^k c_i\widehat\mu_i=\sum\limits_{i=1}^k c_i\overline{Y}_{i\bullet}

\]

De manera análoga a la utilizada para obtener el error estándar de la diferencia de medias, se calcula el error estándar del contraste estimado:

\[

S_\widehat\xi=\sqrt{\text{CME}\sum\limits_{i=1}^k{\frac{c_i^2}{r_i}}}

\]

Nótese que para el caso particular de un contraste en el que cada grupo esté conformado por una media, esto es, para la comparación entre un par de medias, se tendrá un coeficiente \(+1,\) otro coeficiente \(−1\) y el resto de coeficientes \(0.\) En tal caso, el error estándar del contraste estimado coincide con el error estándar de la diferencia de medias.

Supóngase un contraste para comparar la primera y la segunda media de un grupo de tratamientos:

\[

\begin{align}

S_\widehat\xi=&\sqrt{\text{CME}\left(\frac{(+1)^2}{r_1}+\frac{(-1)^2}{r_2}+\frac{(0)^2}{r_3}+\dotsb+\frac{(0)^2}{r_k}\right)}\\[1.4em]

=&\sqrt{\text{CME}\left(\frac{1}{r_1}+\frac{1}{r_2}\right)}\\[1.4em]

\end{align}

\]

La diferencia mínima significativa para el contraste está dada por:

\[

\begin{align}

\text{DMS}_{\xi}&=t_{\alpha/2(\text{gle})}S_{\widehat\xi}\\[1.4em]

&=t_{\alpha/2(\text{gle})}\sqrt{\text{CME}\sum\limits_{i=1}^k\dfrac{c_i^2}{r_i}}\\[1.4em]

\end{align}

\]

El criterio de rechazo se expresa así:

\[

\text{si }\left|\widehat\xi\right|\ge\text{DMS}_\xi

\Rightarrow \text{rechaza } H_0 \text{ con un nivel de significancia }\alpha

\]

En su forma completa, este criterio se escribe así:

\[

\text{si }\left|\sum\limits_{i=1}^k c_i\overline{Y}_{i\bullet}\right|\ge t_{\alpha/2(\text{gle})}\sqrt{\text{CME}\sum\limits_{i=1}^k\dfrac{c_i^2}{r_i}}

\Rightarrow \text{rechaza } H_0 \text{ con un nivel }\alpha

\]

Obsérvese que cada contraste se evalúa con una DMS particular, acorde con sus coeficientes y, por consiguiente, con su error estándar.

El hecho de que todas las comparaciones por pares se evalúen con una única DMS se debe a que todas pueden expresarse como contrastes con un coeficiente \(+1,\) otro \(−1\) y el resto \(0,\) lo que da lugar a un error estándar común.

Supóngase que en el ejemplo 7.1, los tratamientos \(\text{A}\) y \(\text{D}\) son sistemas de empaque con atmósfera modificada, mientras que el tratamiento \(\text{C}\) es un sistema de empaque al vacío. Esta característica diferencial le da sentido a una comparación entre estos dos grupos.

El correspondiente contraste se expresa así:

\[

\xi= +0.5\mu_\text{A}+0\mu_\text{B}-1\mu_\text{C}+0.5\mu_\text{D}\Rightarrow 0.5\mu_\text{A}-1\mu_\text{C}+0.5\mu_\text{D}

\]

El estimador del contraste para la comparación planteada \((\text{A},\text{D}\text{ vs. }\text{C})\) es:

\[

\begin{align}

\widehat\xi=& 0.5\overline{Y}_\text{A}-1\overline{Y}_\text{C}+0.5\overline{Y}_\text{D}\\[1.4em]

=&0.5\times 4.1-1\times 3.8+0.5\times3.9=0.2\\[1.4em]

\end{align}

\]

Para un nivel de significancia de 0.05, el valor crítico superior de \(t\) es:

\[

t_{\alpha/2(\text{gle})}=t_{0.025(8)}=2.306004

\]

El error estándar del contraste estimado se calcula así:

\[

\begin{align}

S_\widehat\xi=&\sqrt{\text{CME}\sum\limits_{i=1}^k \frac{c_i^2}{r_i}}\\[1.4em]

=&\sqrt{0.025\dfrac{(0.5)^2+(-1)^2+(0.5)^2}{3} }=0.1118034

\end{align}

\]

Por tanto, la DMS para el contraste es:

\[

\begin{align}

\text{DMS}_{\xi}&=t_{\alpha/2(\text{gle})}S_{\widehat\xi}\\[1.4em]

&=t_{\alpha/2(\text{gle})}\sqrt{\text{CME}\sum\limits_{i=1}^k\dfrac{c_i^2}{r_i}}\\[1.4em]

&=2.306004\times0.1118034=0.2578

\end{align}

\]

Puesto que el valor absoluto del contraste estimado es menor que la DMS para el correspondiente contraste \((0.2 < 0.2578),\) no se rechaza la hipótesis nula con un nivel de significancia del 5 %. Esto indica que no puede concluirse, con baja probabilidad de error, que el pH medio de la pulpa de guanábana en los sistemas de empaque basados en atmósfera modificada (tratamientos \(\text{A}\) y \(\text{D}\)) difiera del pH medio de la pulpa de guanábana en el sistema de empaque al vacío (tratamiento \(\text{C}\)).

Este resultado ilustra cómo las comparaciones grupales incorporan otros matices y enfoques en lo referente a la comparación de medias.

Para el presente ejemplo, aunque puede afirmarse, con baja probabilidad de error, que el pH medio de la pulpa de guanábana difiere entre uno de los sistemas de empaque con atmósfera modificada (tratamiento \(\text{A}\)) y el sistema de empaque al vacío (tratamiento \(\text{C}\)), no es posible generalizar para afirmar con baja probabilidad de error que el pH medio de la pulpa de guanábana difiere entre los sistemas de empaque basados en atmósfera modificada y el sistema de empaque al vacío.

De manera análoga a como se calculó el valor p para las comparaciones por pares, puede calcularse el valor p para el contraste.

El estadístico de prueba para el contraste se define así:

\[

\begin{align}

t_\text{c}=\dfrac{\widehat\xi}{\sqrt{\text{CME}\sum\limits_{i=1}^k\dfrac{c_i^2}{r_i}}}\overset{H_0}\thicksim t_{\text{(gle)}}\\[1.4em]

t_\text{c}=\dfrac{0.2}{0.1118034}=1.78885

\end{align}

\]

Valor p: 2 * pt(1.78885, 8, lower.tail = FALSE) = 0.111435.

En consecuencia, no se rechaza la hipótesis nula con un nivel de significancia del 5 %.

Es posible obtener un intervalo de confianza del \(100(1−\alpha)\,\%\) para el contraste, con base en la siguiente expresión:

\[

\begin{align}

\text{IC}_{(1−\alpha)100\,\%}&:\quad\widehat\xi\pm\text{DMS}_\xi\\[1.4em]

&:\quad\widehat\xi\pm t_{\alpha/2\text{(gle)}}\sqrt{\text{CME}\sum\limits_{i=1}^k\frac{c_i^2}{r_i}}\\[1.4em]

\end{align}

\]

Un intervalo de confianza del 95 % para el contraste planteado \((\mu_{\text{A}, \text{D}}-\mu_{\text{C}})\) está dado por:

\[

0.2\pm 0.2578:\quad[-0.0578,\;0.4578]

\]

Este resultado es coherente con el obtenido anteriormente: puesto que el intervalo de confianza del 95 % para la diferencia de medias de los dos grupos contiene el cero, no se rechaza la hipótesis nula al 5 %.

Para realizar contrastes en R, es fundamental asegurarse de que el orden que se tiene en mente para la asignación de los coeficientes a los tratamientos coincida con el orden interno que R asigna a los tratamientos. Si no fuera así, se estaría evaluando un contraste diferente al deseado.

En general, R ordena los tratamientos alfabéticamente. Si algunos tratamientos tienen nombres numéricos y otros alfanuméricos, los números van antes que las letras, pero los tratamientos con nombre numérico no se ordenan según su valor numérico, sino como cadenas de caracteres.

Así, un factor cuyos niveles fueran a, 3, 25 y 100, tendría el siguiente orden interno:

[1] "100" "25" "3" "a" No obstante, si en el caso anterior el nombre del último tratamiento iniciara con un espacio, se tendría el siguiente ordenamiento:

[1] " a" "100" "25" "3" Cuando todos los nombres son estrictamente numéricos, sí se tiene en cuenta el valor numérico para la ordenación, así:

[1] "3" "4" "25" "100"En vista de que hay muchas posibilidades de errar en la definición de los coeficientes, se recomienda verificar el orden interno que R ha asignado a los tratamientos antes de evaluar cualquier contraste.

Esta verificación puede realizarse mediante la función levels{base}:

levels(data$tto)[1] "A" "B" "C" "D"Para evaluar en R el contraste propuesto anteriormente \((\mu_{\text{A}, \text{D}}-\mu_{\text{C}}),\) se usa la función glht{multcomp}, con el vector de coeficientes del contraste en el argumento linfct.

La línea 1 ajusta el modelo sin intercepto. Para ello se agrega - 1 en la parte derecha del modelo. Este modelo se emplea como primer argumento de la función glht.

La línea 2 define el vector de coeficientes acorde con el orden interno de los tratamientos: \(c_1=0.5, c_2=0, c_3=-1, c_4=0.5\). Mediante la función t (transposición), este vector se convierte en una matriz fila, lo que permite asignarle un nombre al contraste.

La línea 3 le asigna un nombre a la fila de la matriz de coeficientes, el cual se usa en las salidas como identificador del contraste.

La línea 4 ejecuta la prueba del contraste.

anova.c <- aov(pH ~ tto - 1, data = data)

k <- t(c(0.5, 0, -1, 0.5))

rownames(k) <- "A y D vs. C"

summary(multcomp::glht(anova.c, linfct = k))

Simultaneous Tests for General Linear Hypotheses

Fit: aov(formula = pH ~ tto - 1, data = data)

Linear Hypotheses:

Estimate Std. Error t value Pr(>|t|)

A y D vs. C == 0 0.2000 0.1118 1.789 0.111

(Adjusted p values reported -- single-step method)En la sección 8.1 se presentó el concepto de tasa de error por familia (TEF), y se ilustró la manera en la que esta se infla al realizar más de una comparación.

Este es el problema fundamental de los PCM: se requiere incorporar un mecanismo que controle esta situación, manteniendo la TEF en un nivel que no exceda el definido por el usuario.

¿Cuál es el mecanismo que permite controlar la inflación de la TEF en la DMS?

En la literatura clásica se describe una variante de la prueba DMS, denominada DMS protegida o DMS protegida de Fisher4, que consiste en realizar las comparaciones entre medias únicamente si el ANOVA resulta significativo. Se supone que la significancia del ANOVA brinda protección contra la inflación de la TEF.

Acorde con Hochberg y Tamhane (1987), este procedimiento brinda protección únicamente en sentido débil, es decir, cuando la hipótesis nula global del ANOVA es cierta, pero no bajo otras condiciones.

Esto conduce a una situación paradójica: si todas las medias son iguales, que es el caso en el que la prueba protege contra la inflación de la TEF, lo esperable es que el ANOVA no resulte significativo y, en consecuencia, no se realicen comparaciones por pares.

En el escenario de la hipótesis alternativa, el ANOVA probablemente será significativo y se tendría interés en realizar comparaciones por pares; sin embargo, en tal caso no se dispone de protección contra la inflación de la TEF.

La realidad es que, ya sea que se realice la DMS “protegida” o la DMS sin considerar el resultado del ANOVA, esta prueba no proporciona un adecuado control de la TEF en el sentido general requerido en los PCM.

En tal sentido, resulta cuestionable incluso catalogar la DMS como un PCM.

Asimismo, los intervalos construidos con base en la DMS (cf. sección 8.4.1) no conforman un conjunto de intervalos de confianza simultánea con una confianza global del \(100(1−\alpha)\,\%\); simplemente se tienen seis intervalos con confianzas individuales del \(100(1−\alpha)\,\%\).

En consecuencia, la DMS no debe utilizarse como PCM… al menos no en la forma básica expuesta en esta sección. Sin embargo, es posible ajustarla para pasar de una “protección” meramente aparente a un verdadero control de la TEF, mediante las estrategias que se exponen en las secciones 8.9 y 8.10.

8.5 Prueba de Tukey

Esta prueba —también conocida como Diferencia Significativa Honesta (DSH) (Honestly Significant Difference–HSD) o Diferencia Significativa Honesta de Tukey— fue propuesta por John W. Tukey en 19535.

Acorde con Benjamini y Braun (2002), Tukey tiene todos los méritos para ser considerado uno de los pioneros en el campo de las comparaciones múltiples, habiendo moldeado en gran parte los procedimientos de inferencia simultánea, no solo en lo que a su desarrollo matemático se refiere, sino también desde su filosofía y aplicaciones prácticas.

En su artículo La filosofía de las comparaciones múltiples, Tukey se enfoca en analizar y responder varias preguntas trascendentales: ¿qué queremos que hagan las comparaciones múltiples?, ¿por qué queremos que hagan eso? y ¿cómo pueden presentarse los resultados? (Tukey, J. W. 1991).

La prueba DSH de Tukey permite realizar las \(k(k-1)/2\) posibles comparaciones entre pares de medias manteniendo controlada la TEF.

Esta prueba se basa en la distribución de la variable aleatoria \(q\), denominada recorrido estudentizado. En este texto se utiliza el término recorrido estudentizado (traducción de studentized range), manteniendo la distinción adoptada previamente entre recorrido (range) y rango (rank). (cf. advertencia 2.1)

El recorrido estudentizado es una función probabilística continua, similar a la normal, la ji cuadrado, la \(t\) o la \(F\), aunque menos conocida que estas por no tener un ámbito de aplicación tan amplio en el contexto inferencial.

Aunque no fue Tukey quien desarrolló esta distribución, sí fue quien la popularizó, mediante su inclusión en la prueba de la diferencia significativa honesta.

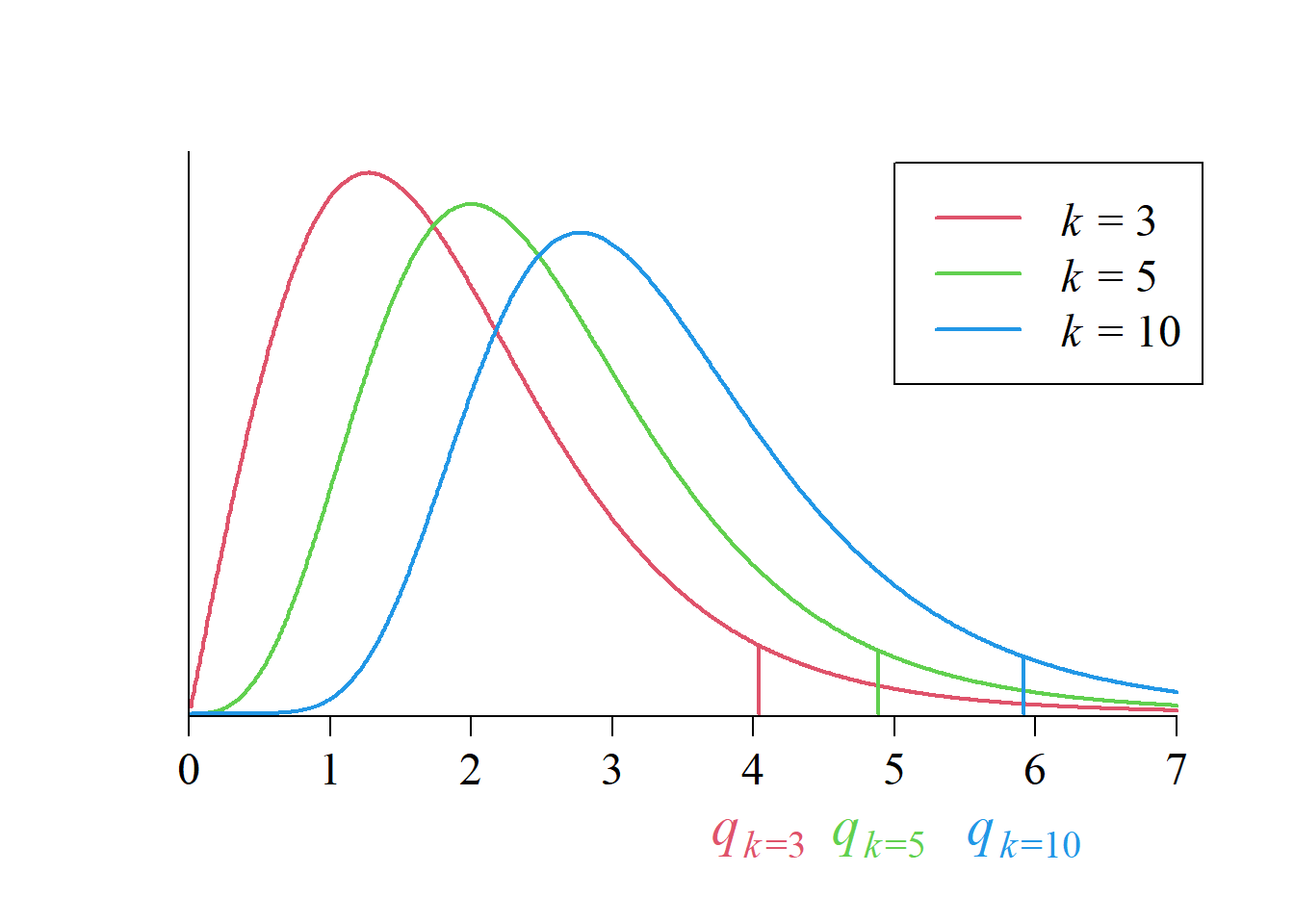

Se trata de una función asimétrica a la derecha, cuyo soporte son los reales positivos. Su forma depende de sus parámetros \(k\) —que representa el número de medias que se comparan— y \(\text{gle}\) —que representa los grados de libertad del error—.

La figura 8.4, correspondiente a tres miembros de la familia con \(\text{gle}=8,\) muestra el efecto del parámetro \(k\) sobre la forma de la distribución y, por tanto, sobre el valor crítico de \(q.\)

A mayor \(k,\) mayor será el número de posibles comparaciones por pares y, en consecuencia, mayor será la inflación potencial de la TEF, requiriéndose, por tanto, un mayor control sobre esta.

La figura 8.4 ilustra que dicho control se ejerce mediante un incremento en el valor crítico de \(q.\)

Aunque el parámetro de la distribución es \(k,\) el valor crítico resultante controla la TEF asociada a las \(k(k-1)/2\) posibles comparaciones por pares.

Este comportamiento refleja que la prueba de Tukey incorpora de manera implícita el número total de comparaciones en la determinación del valor crítico, en lugar de ajustar cada comparación de manera individual.

En el caso particular en que \(k=2\), siendo \(k(k-1)/2=1,\) no existe inflación de la TEF y, por tanto, no se requiere ajuste alguno. En este escenario, la prueba de Tukey coincide con la DMS.

De hecho, todos los procedimientos de comparación múltiple coinciden cuando \(k=2.\)

La variable aleatoria \(q\) se define como la razón entre la diferencia de la mayor y la menor de las medias muestrales y el estimador de la desviación estándar común de cada media muestral, denominado error estándar.

El error estándar se denota y calcula de la siguiente manera:

\[

S_{\overline{Y}}=\sqrt{\frac{\text{CME}}{r}}

\]

A partir de \(q,\) se define una diferencia significativa honesta (DSH), que debe ser igualada o superada por el valor absoluto de la diferencia entre dos medias muestrales para que la correspondiente comparación se declare significativa.

El criterio de rechazo de la prueba de Tukey se expresa de forma análoga al de la DMS, así:

\[

\text{si }\left|\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right|\ge\text{DSH}\Rightarrow \text{ rechaza } H_0

\]

Este criterio es formalmente idéntico al de la prueba de la DMS, siendo la DSH el único elemento que difiere.

La DSH se define como el producto entre el valor crítico superior del recorrido estudentizado y el error estándar.

Cuando los tratamientos tienen el mismo número de réplicas, la DSH viene dada por:

\[

\text{DSH}=q_{\alpha(k,\,\text{gle})}\sqrt{\dfrac{\text{CME}}{r}}

\]

Durante mucho tiempo, la prueba de Tukey se presentó en el formato para igual número de réplicas, acompañada de diferentes alternativas para adaptarla a la comparación de grupos con diferente número de réplicas.

Kramer (1956) propuso la siguiente adaptación para el cálculo del error estándar cuando los tratamientos no están basados en el mismo número de réplicas:

\[

S_{\overline{Y}}=\sqrt{\dfrac{\text{CME}}{2}\left(\frac{1}{r_1}+\frac{1}{r_2} \right)}

\]

Esto equivale a calcular el error estándar empleando la media armónica de las réplicas de los dos tratamientos comparados.

A la prueba basada en esta adaptación suele llamársele prueba de Tukey-Kramer. No obstante, Dunnett (1980a) hace notar que esta adaptación ya había sido propuesta por Tukey en 19536. Consecuentemente, autores como Abdi y Williams (2010) obvian toda referencia a Kramer.

Dunnett (1980a), quien evaluó mediante simulación varias propuestas para comparar medias cuando se tienen varianzas homogéneas y diferente número de réplicas, concluye en favor de la denominada prueba de Tukey-Kramer, por proporcionar intervalos de confianza conservadores.

Este autor desaconseja métodos alternativos, tales como el uso de la media armónica global de todas las réplicas. Hayter (1984) demuestra matemáticamente que la prueba de Tukey-Kramer es conservadora en todos los casos.

A continuación se ilustra la comparación por pares de las medias del ejemplo 7.1, usando un nivel de significancia \(\alpha = 0.05,\) que corresponde al nivel al cual se controla la TEF.

En este caso, dado que todos los tratamientos tienen igual número de réplicas, se obtiene una DSH común con base en la siguiente expresión:

\[

\text{DSH}=q_{\alpha(k,\,\text{gle})}\sqrt{\dfrac{\text{CME}}{r}}

\]

El valor crítico del recorrido estudentizado con \(k\) grupos y \(\text{gle},\) que tradicionalmente se obtenía en tablas, puede hallarse en R, mediante la función qtukey{stats}, en la cual p es el nivel de significancia, nmeans el número de tratamientos, df los grados de libertad del error y lower.tail = FALSE indica que se obtiene el valor crítico superior:

\(q_{\alpha(k,\,\text{gle})}=q_{0.05(4,\,8)}:\)

qtukey(p = 0.05, nmeans = 4, df = 8, lower.tail = FALSE)[1] 4.52881Obsérvese que, a diferencia del valor crítico de \(t\) en la DMS, el valor crítico de \(q\) depende del número de tratamientos, \(k,\) lo que permite controlar la TEF.

El error estándar viene dado por:

\[

S_{\overline{Y}}=\sqrt{\frac{\text{CME}}{r}}=\sqrt{\frac{0.025}{3}}=0.09129

\]

Luego, la DSH viene dada por:

\[

\text{DSH}=q_{\alpha(k,\,\text{gle})}\sqrt{\dfrac{\text{CME}}{r}}=4.52881\times0.09129=0.4134

\]

Se presentan a continuación los seis posibles contrastes entre pares de medias, cuyo resultado se resume en la tabla 8.5.

\[

\begin{align}

\mu_{\text{A}}\text{ vs. } \mu_{\text{B}}&:\quad \left|\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{B} \bullet}\right|=

\left|4.1-3.2\right|=0.9>0.4134\quad*\\[0.5em]

\mu_{\text{A}}\text{ vs. } \mu_{\text{C}}&:\quad \left|\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{C} \bullet}\right|=

\left|4.1-3.8\right|=0.3<0.4134\quad\text{ns}\\[0.7em]

\mu_{\text{A}}\text{ vs. } \mu_{\text{D}}&:\quad \left|\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{D} \bullet}\right|=

\left|4.1-3.9\right|=0.2<0.4134\quad\text{ns}\\[0.7em]

\mu_{\text{B}}\text{ vs. } \mu_{\text{C}}&:\quad \left|\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{C} \bullet}\right|=

\left|3.2-3.8\right|=0.6>0.4134\quad*\\[0.7em]

\mu_{\text{B}}\text{ vs. } \mu_{\text{D}}&:\quad \left|\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{D} \bullet}\right|=

\left|3.2-3.9\right|=0.7>0.4134\quad*\\[0.7em]

\mu_{\text{C}}\text{ vs. } \mu_{\text{D}}&:\quad \left|\overline{Y}_{\text{C}\bullet}-\overline{Y}_{\text{D} \bullet}\right|=

\left|3.8-3.9\right|=0.1<0.4134\quad\text{ns}

\end{align}

\]

| Tratamiento | \(\overline{Y}_{i\bullet}\) | Grupos |

|---|---|---|

| \(\text{A}\) | 4.1 | a |

| \(\text{D}\) | 3.9 | a |

| \(\text{C}\) | 3.8 | a |

| \(\text{B}\) | 3.2 | c |

Para el presente ejemplo, los resultados de la prueba de Tukey difieren de los de la prueba DMS (cf. tabla 8.3). En particular, la diferencia entre \(\mu_{\text{A}}\) y \(\mu_{\text{C}}\), que resulta significativa bajo la DMS, deja de serlo bajo la prueba de Tukey. Esto se debe a que el control que la prueba de Tukey ejerce sobre la TEF se logra a costa de ser más exigente o conservadora que la prueba DMS en las comparaciones individuales.

Esto quiere decir que, si bien la prueba de Tukey ejerce un mejor control sobre la probabilidad de error tipo I, tiene una menor potencia que la DMS.

El hecho de que la prueba de la DSH exhiba una menor potencia que la DMS en las comparaciones individuales podría hacer dudar sobre su idoneidad.

No obstante, el aspecto esencial en los procedimientos de comparación múltiple es el control de la TEF, lo que descalifica a la prueba de la DMS en estos escenarios.

La disminución de la potencia en las comparaciones individuales es el precio que paga la prueba de la DSH por el control de la TEF.

En R, la prueba de Tukey puede realizarse mediante la función HSD.test{agricolae}, siendo posible asimismo usar un fragmento de código análogo al código 8.1 para generar un gráfico con el recorrido de los tratamientos y las letras de significancia.

HSD.test(anova, "tto", console = TRUE)

Study: anova ~ "tto"

HSD Test for pH

Mean Square Error: 0.025

tto, means

pH std r se Min Max Q25 Q50 Q75

A 4.1 0.2 3 0.09128709 3.9 4.3 4.00 4.1 4.20

B 3.2 0.1 3 0.09128709 3.1 3.3 3.15 3.2 3.25

C 3.8 0.1 3 0.09128709 3.7 3.9 3.75 3.8 3.85

D 3.9 0.2 3 0.09128709 3.7 4.1 3.80 3.9 4.00

Alpha: 0.05 ; DF Error: 8

Critical Value of Studentized Range: 4.52881

Minimun Significant Difference: 0.4134219

Treatments with the same letter are not significantly different.

pH groups

A 4.1 a

D 3.9 a

C 3.8 a

B 3.2 bLa leyenda Minimum Significant Difference que aparece en los resultados —antes del valor 0.4134219— puede generar confusión, al sugerir que se está aplicando la DMS en lugar de la DSH. Sin embargo, este no es el caso.

Las funciones de agricolae siempre utilizan esta leyenda de manera genérica, para referirse a la diferencia mínima requerida entre medias muestrales para declarar significancia, de acuerdo con el procedimiento empleado.

En el contexto de la prueba de Tukey, este valor corresponde a la diferencia significativa honesta (DSH).

Para calcular el valor p asociado con la prueba de Tukey se tiene en cuenta el correspondiente estadístico de prueba genérico7:

\[

q_\text{c}=\dfrac{\left|\overline{Y}_{i\bullet}-\overline{Y}_{i'\bullet} \right|}{\sqrt{ \dfrac{\text{CME}}{r}}}\overset{H_0}\thicksim q_{(k,\,\text{gle})}

\]

Este estadístico mide cuántas veces la diferencia observada entre medias excede el error estándar, de manera análoga al estadístico \(t_\text{c},\) pero evaluado bajo la distribución del recorrido estudentizado.

Usando la función ptukey{stats}, se obtiene el valor p asociado a la cola superior:

ptukey(qc, nmeans = 4, df = 8, lower.tail = FALSE)La tabla 8.6 muestra el estadístico de prueba para los diferentes contrastes entre pares de medias y sus correspondientes valores p.

| Comparación | \(q_\text{c}\) | Valor p |

|---|---|---|

| \(\mu_{\text{A}}\text{ vs. } \mu_{\text{B}}\) | 9.859006 | 0.0005 |

| \(\mu_{\text{A}}\text{ vs. } \mu_{\text{C}}\) | 3.286335 | 0.1714 |

| \(\mu_{\text{A}}\text{ vs. } \mu_{\text{D}}\) | 2.190890 | 0.4550 |

| \(\mu_{\text{B}}\text{ vs. } \mu_{\text{C}}\) | 6.572671 | 0.0072 |

| \(\mu_{\text{B}}\text{ vs. } \mu_{\text{D}}\) | 7.668116 | 0.0028 |

| \(\mu_{\text{C}}\text{ vs. } \mu_{\text{D}}\) | 1.095445 | 0.8638 |

Nótese que los valores p obtenidos mediante la prueba de Tukey son mayores que los correspondientes valores p de la prueba DMS (cf. tabla 8.4). Esto refleja el ajuste que realiza la prueba de Tukey para controlar la TEF, lo que implica un criterio más exigente para declarar significancia.

8.5.1 Intervalos de Confianza de Tukey

Es posible obtener intervalos para todas las posibles diferencias de medias, con una confianza simultánea del \((1 − \alpha)100\,\%,\) sumando y restando la DSH a cada diferencia de medias muestrales:

\[

\begin{align}

\text{IC}_{95\%}:&\left(\overline{Y}_{i\bullet}-\overline{Y}_{i'\bullet} \right)\pm\text{DSH}\\[1.4em]

=&\left(\overline{Y}_{i\bullet}-\overline{Y}_{i'\bullet} \right)\pm q_{\alpha(k,\,\text{gle})}\sqrt{\dfrac{\text{CME}}{2}\left(\dfrac{1}{r_i}+\dfrac{1}{r_{i'} } \right) }

\end{align}

\]

A continuación, se presentan intervalos de confianza del 95 % para las diferencias de medias del ejemplo 7.1.

\[

\begin{align}

\mu_{\text{A}}-\mu_{\text{B}}&: \left(\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{B} \bullet}\right)

\pm \text{DSH}=0.9\pm 0.4134&:[0.4866&,\,1.3134]\:&*\\[0.5em]

\mu_{\text{A}}-\mu_{\text{C}}&: \left(\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{C} \bullet}\right)

\pm \text{DSH}=0.3\pm 0.4134&:[-0.1134&,\,0.7134]\:&\text{ns}\\[0.7em]

\mu_{\text{A}}-\mu_{\text{D}}&: \left(\overline{Y}_{\text{A}\bullet}-\overline{Y}_{\text{D} \bullet}\right)

\pm \text{DSH}=0.2\pm 0.4134&:[-0.2134&,\,0.6134]\:&\text{ns}\\[0.7em]

\mu_{\text{B}}-\mu_{\text{C}}&: \left(\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{C} \bullet}\right)

\pm \text{DSH}=-0.6\pm 0.4134&:[-1.0134&,\,-0.1866]\:&*\\[0.7em]

\mu_{\text{B}}-\mu_{\text{D}}&: \left(\overline{Y}_{\text{B}\bullet}-\overline{Y}_{\text{D} \bullet}\right)

\pm \text{DSH}=-0.7\pm 0.4134&:[-1.1134&,\,-0.2866]\:&*\\[0.7em]

\mu_{\text{C}}-\mu_{\text{D}}&: \left(\overline{Y}_{\text{C}\bullet}-\overline{Y}_{\text{D} \bullet}\right)

\pm \text{DSH}=-0.1\pm 0.4134&:[-0.5134&,\,0.3134]\:&\text{ns}

\end{align}

\]

Nótese que todos los intervalos son más amplios que los correspondientes intervalos DMS. En virtud de ello, los intervalos HSD permiten asignar una confianza global del \(100(1−\alpha)\,\%\) al conjunto de comparaciones.

Para su obtención en R, se usa la siguiente instrucción, con base en la cual se obtienen, además de los intervalos de confianza, los valores p de la correspondiente comparación.

HSD.test(anova, "tto", group = FALSE, console = TRUE)

Study: anova ~ "tto"

HSD Test for pH

Mean Square Error: 0.025

tto, means

pH std r se Min Max Q25 Q50 Q75

A 4.1 0.2 3 0.09128709 3.9 4.3 4.00 4.1 4.20

B 3.2 0.1 3 0.09128709 3.1 3.3 3.15 3.2 3.25

C 3.8 0.1 3 0.09128709 3.7 3.9 3.75 3.8 3.85

D 3.9 0.2 3 0.09128709 3.7 4.1 3.80 3.9 4.00

Alpha: 0.05 ; DF Error: 8

Critical Value of Studentized Range: 4.52881

Comparison between treatments means

difference pvalue signif. LCL UCL

A - B 0.9 0.0005 *** 0.4865781 1.3134219

A - C 0.3 0.1714 -0.1134219 0.7134219

A - D 0.2 0.4550 -0.2134219 0.6134219

B - C -0.6 0.0072 ** -1.0134219 -0.1865781

B - D -0.7 0.0028 ** -1.1134219 -0.2865781

C - D -0.1 0.8638 -0.5134219 0.3134219