5 COMPARACIÓN DE DOS POBLACIONES

La forma más usual de comparar dos poblaciones es a través de sus parámetros. Aunque pueda parecer obvio, cabe señalar que las comparaciones siempre se realizan entre parámetros de la misma naturaleza, es decir, se comparan medias con medias, varianzas con varianzas y proporciones con proporciones.

En este capítulo se presentan los métodos clásicos para la comparación de varianzas y medias en dos poblaciones normales, así como para la comparación de las probabilidades de éxito en dos poblaciones binomiales.

El capítulo concluye con un decálogo sobre pruebas de hipótesis (cf. sección 5.7), en el que se sintetizan los aspectos más relevantes concernientes a la formulación e interpretación de esta herramienta inferencial.

5.1 Comparación de las varianzas de dos poblaciones normales

Aunque la prueba para comparar varianzas es análoga en su escritura a las pruebas para comparar medias1, suele hablarse de pruebas de “diferencias de medias” y pruebas de “homogeneidad de varianzas”.

Los términos usados en cada caso reflejan diferencias conceptuales en la naturaleza de estos parámetros.

Al ser la media un parámetro de posición, podría suceder que dos medias ocuparan la misma posición (medias iguales) o que ocuparan distintas posiciones (medias diferentes).

En contraste, siendo la varianza un parámetro de dispersión, esta no se conceptualiza a través de su posición (aunque pueda representarse mediante un número). Así, al comparar la dispersión de dos poblaciones, puede encontrarse que estas presentan una variabilidad similar (varianzas homogéneas) o que una de ellas exhibe mayor variabilidad que la otra (varianzas heterogéneas).

A la condición propia de un conjunto de poblaciones con varianzas homogéneas se le denomina homocedasticidad. Como contraparte, a la condición de un conjunto de poblaciones con varianzas que no son todas homogéneas, se le conoce como heterocedasticidad.

A pesar de la diferenciación indicada, no es del todo inusual ni es incorrecto hablar de varianzas iguales/diferentes.

5.1.1 Prueba de hipótesis para comparar dos varianzas normales

Considérense dos muestras aleatorias independientes, provenientes de sendas poblaciones normales2:

\(X_{11},X_{12},...,X_{1n_1}\: \text{iid}\: N\left(\mu_1, \sigma_1^2\right)\quad\) y \(\quad X_{21},X_{22},...,X_{2n_2}\: \text{iid}\: N\left(\mu_2, \sigma_2^2\right)\)

Tal y como se ilustró en la sección 4.3.1.1, los siguientes estadísticos siguen distribuciones ji cuadrado.

\[

\frac{(n_1-1)S^2_1}{\sigma_1^2}\thicksim \chi^2_{(n_1-1)} \quad \text{y}\quad \frac{(n_2-1)S^2_2}{\sigma_2^2}\thicksim \chi^2_{(n_2-1)}

\]

En la sección 3.7.4 se mostró que la razón entre dos variables aleatorias ji cuadrado independientes divididas entre sus grados de libertad sigue una distribución \(F.\) En su forma general se expresa así:

\[

\frac{\textcolor{blue}{\chi^2_{(n_1-1)}}}{\textcolor{red}{(n_1-1)}}\Bigg/

\frac{\textcolor{blue}{\chi^2_{(n_2-1)}}}{\textcolor{red}{(n_2-1)}}

\thicksim F_{(n_1-1,\;n_2-1)}

\]

Para el presente caso, la razón adquiere la forma específica:

\[

\frac{\textcolor{blue}{(n_1-1)S^2_1}}{\textcolor{blue}{\sigma_1^2}\textcolor{red}{(n_1-1)}}\Bigg/

\frac{\textcolor{blue}{(n_2-1)S^2_2}}{\textcolor{blue}{\sigma_2^2}\textcolor{red}{(n_2-1)}}\thicksim F_{(n_1-1,\;n_2-1)}

\]

Al simplificarse adquiere la siguiente forma:

\[

\frac{S^2_1}{\sigma_1^2}\Bigg/

\frac{S^2_2}{\sigma_2^2}\thicksim F_{(n_1-1,\;n_2-1)}

\]

Considérese ahora el siguiente juego de hipótesis para comparar las varianzas de las dos poblaciones:

\(H_0:\sigma_1^2=\sigma_2^2\) (varianzas homogéneas)

\(H_a:\sigma_1^2\ne\sigma_2^2\) (varianzas heterogéneas)

Cuando se contrasta un juego de hipótesis para comparar varianzas, lo que en realidad podría probarse es que las varianzas son heterogéneas.

Consecuentemente, a estas pruebas sería más correcto llamarlas de “heterogeneidad de varianzas”. No obstante, lo más común es denominarlas pruebas de “homogeneidad de varianzas”.

En este caso sucede algo análogo a lo que ocurre con las llamadas pruebas de normalidad, que son en realidad pruebas de falta de normalidad (cf. advertencia 4.1).

La hipótesis nula implica que las poblaciones comparadas tienen una varianza común, es decir,

\[

\sigma_1^2=\sigma_2^2=\sigma^2

\]

Bajo la hipótesis nula, el estadístico construido anteriormente adquiere la siguiente forma:

\[

\frac{S^2_1}{\sigma^2}\Bigg/

\frac{S^2_2}{\sigma^2}

={S^2_1}\big/

{S^2_2}

\thicksim F_{(n_1-1,\;n_2-1)}

\]

Esta expresión se usa como estadístico de prueba para contrastar el juego de hipótesis:

\[

F_\text{c}=\frac {S^2_1}

{S^2_2}\overset {H_0}\thicksim F_{(n_1-1,\;n_2-1)}

\]

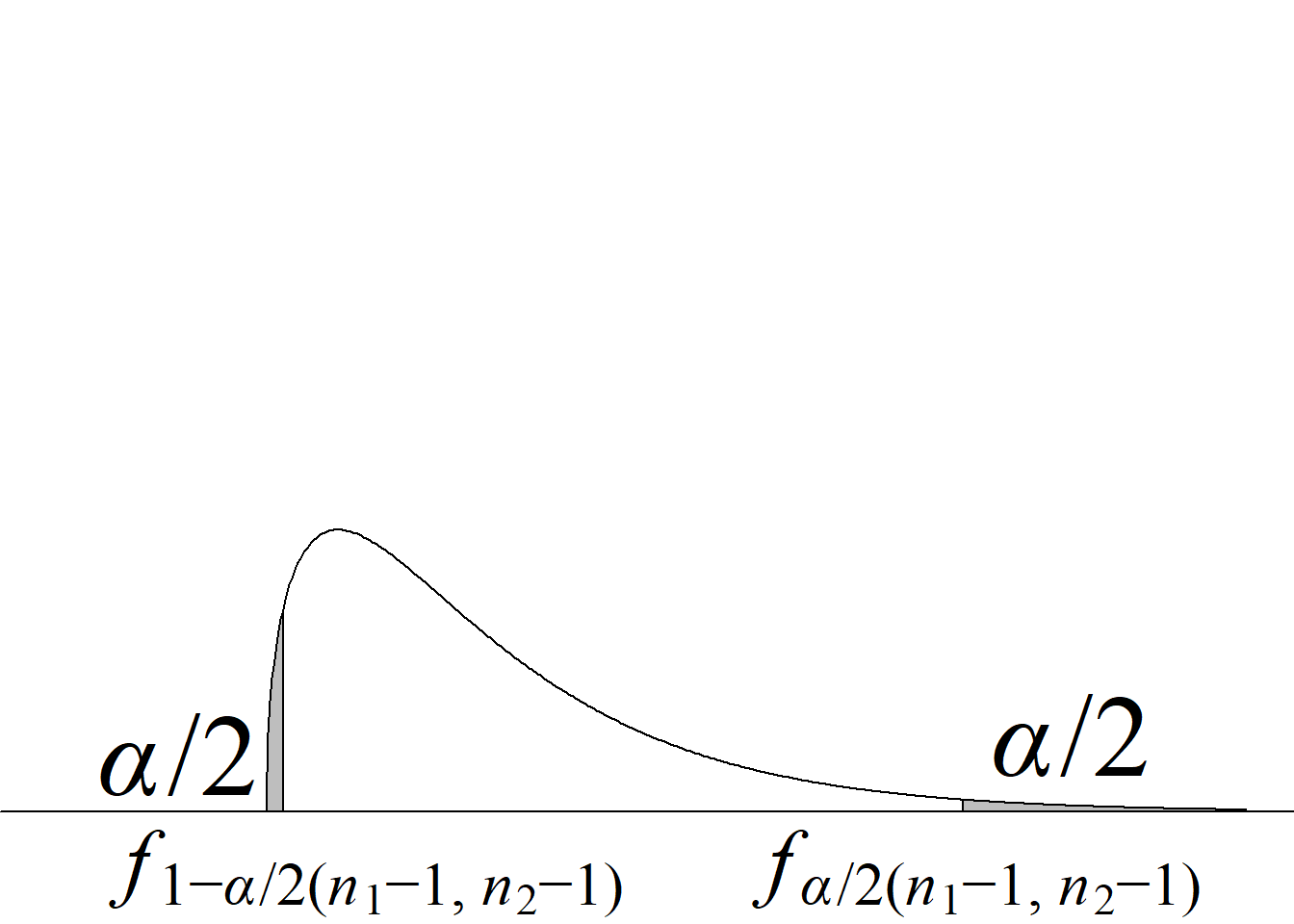

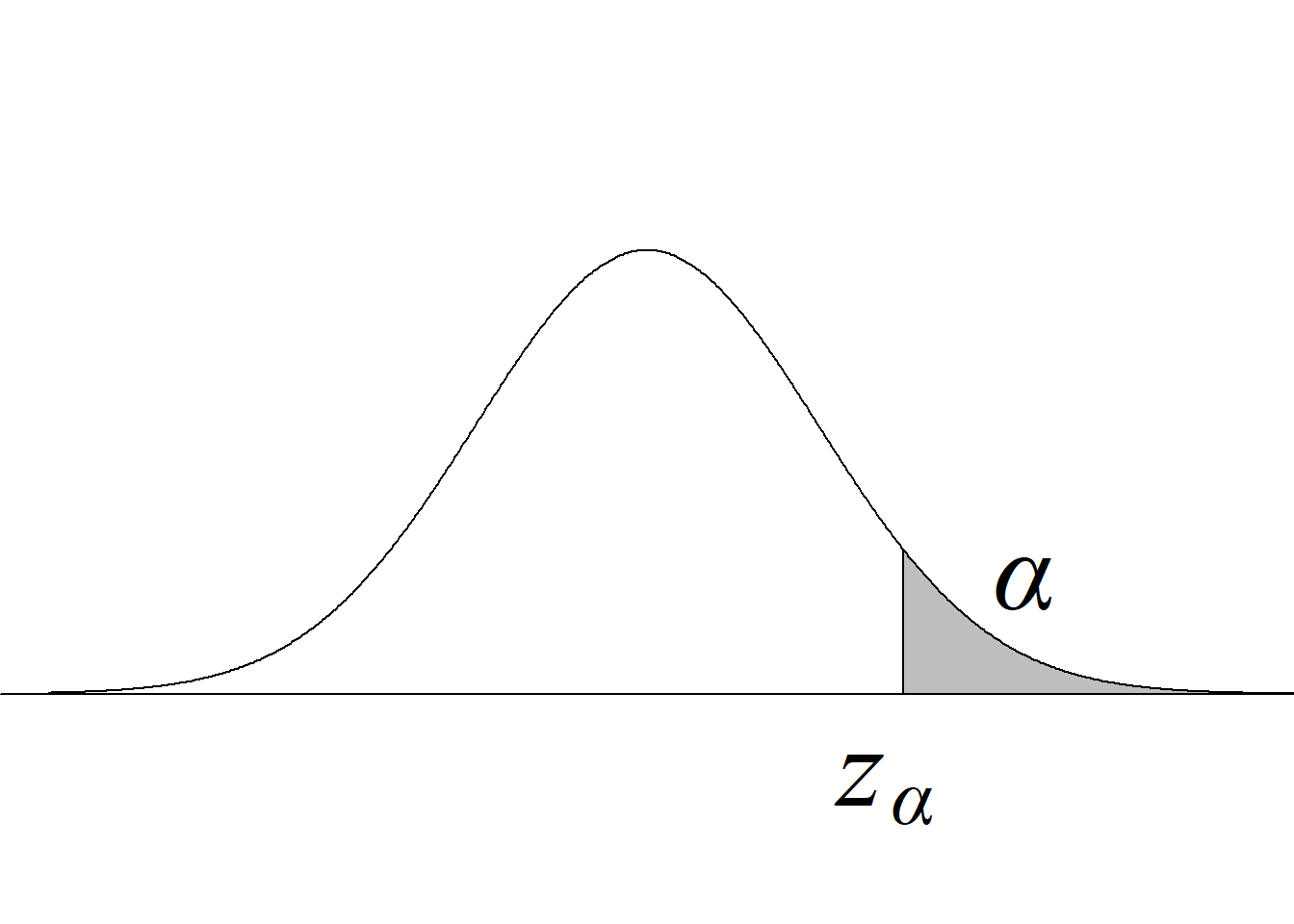

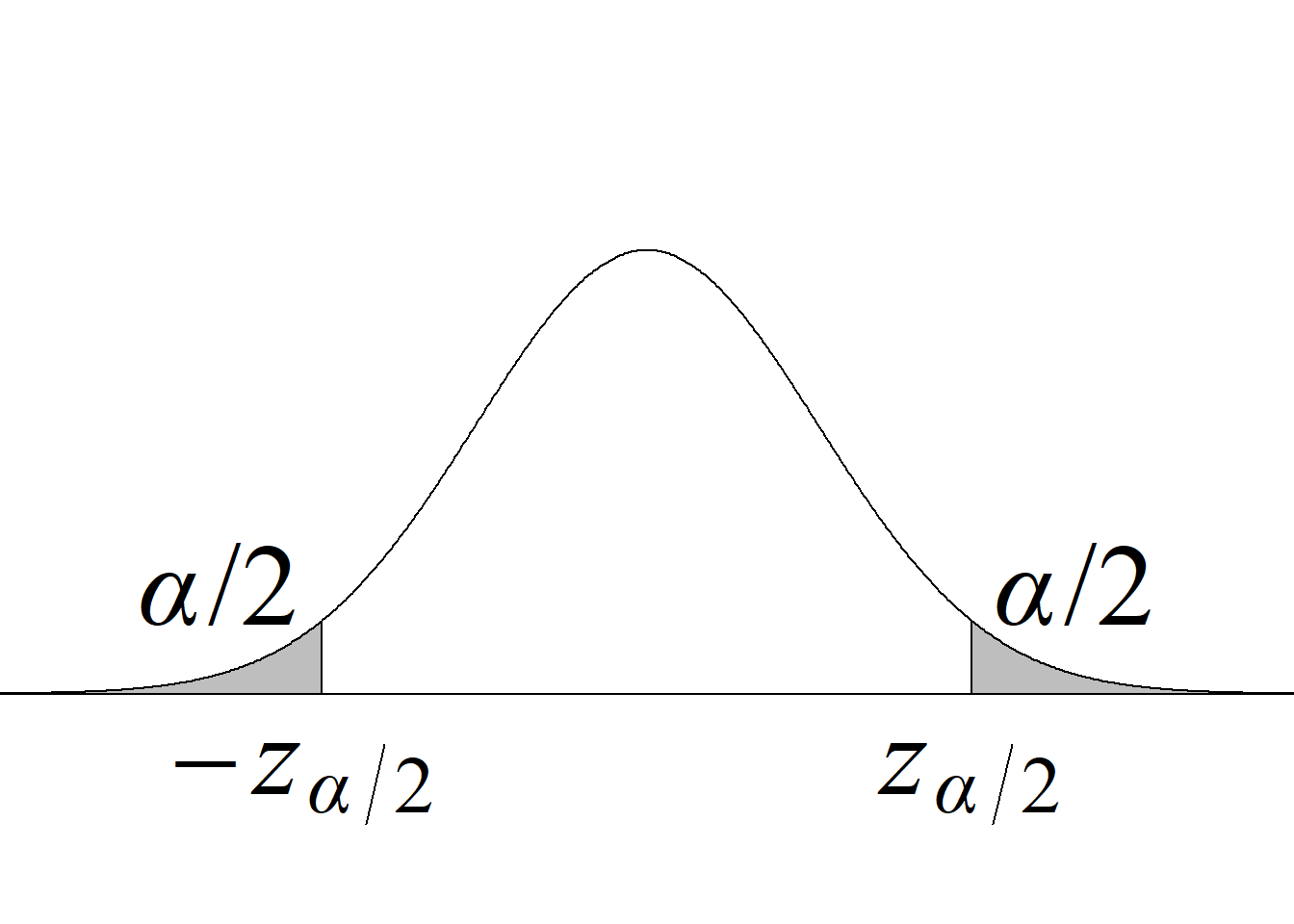

Para el juego de hipótesis planteado y el estadístico de prueba propuesto, la región de rechazo de la hipótesis nula con un nivel de significancia \(\alpha\) se define a partir de los valores críticos de la distribución \(F\) con \((n_1\!\!−\!\!1,\; n_2\!\!−\!\!1)\) gl que dejan áreas de \(\alpha/2\) en cada cola de la distribución.

En este caso, por tratarse de una región de rechazo construida con base en una distribución probabilística asimétrica, no es posible presentar una regla de rechazo simplificada usando valor absoluto.

El criterio de rechazo se escribe así:

Si \(F_\text{c} \le f_{1-\alpha/2(n_1-1,\; n_2-1)}\) o \(F_\text{c} \ge f_{\alpha/2(n_1-1,\; n_2-1)} \Rightarrow\) se rechaza \(H_0\) con un n. s. \(\alpha.\)

Puesto que la asignación de las etiquetas para las poblaciones comparadas es arbitraria, también lo es la construcción del estadístico de prueba, pudiendo tenerse cualquiera de las siguientes versiones para la misma comparación:

\(F_\text{c}=\frac {S^2_1}{S^2_2}\overset {H_0}\thicksim F_{(n_1-1,\;n_2-1)}\quad\) y \(\quad F_\text{c}^*=\frac {S^2_2}{S^2_1}\overset {H_0}\thicksim F_{(n_2-1,\;n_1-1)}\)

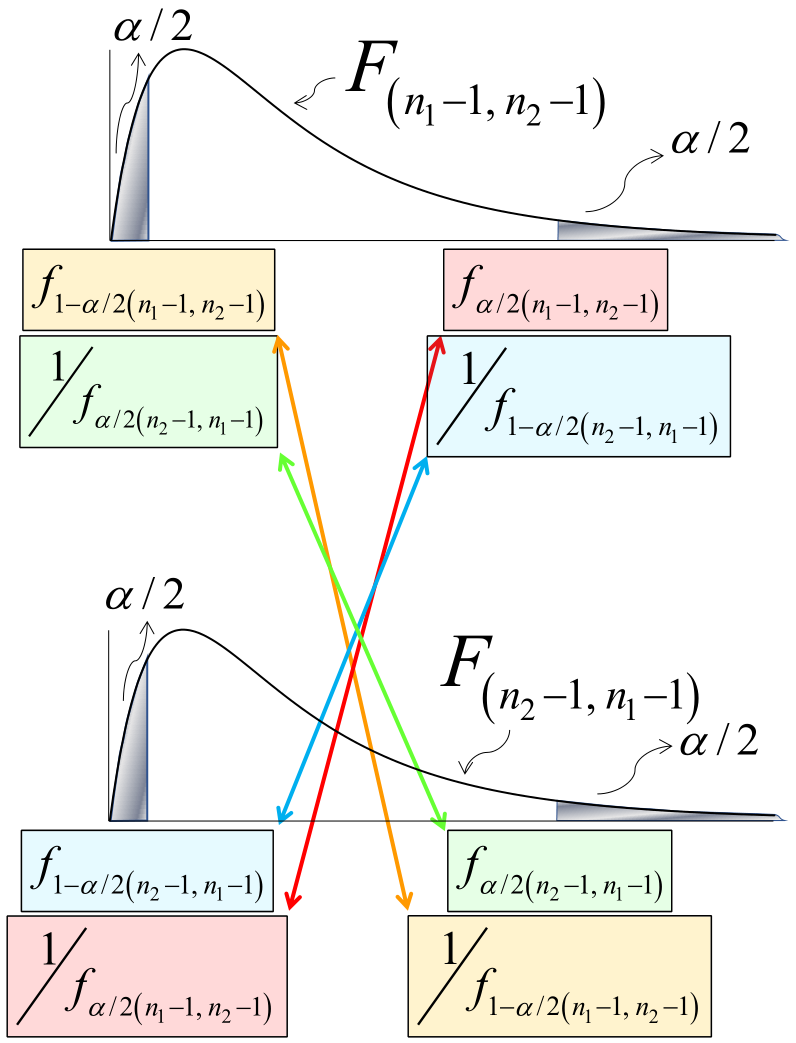

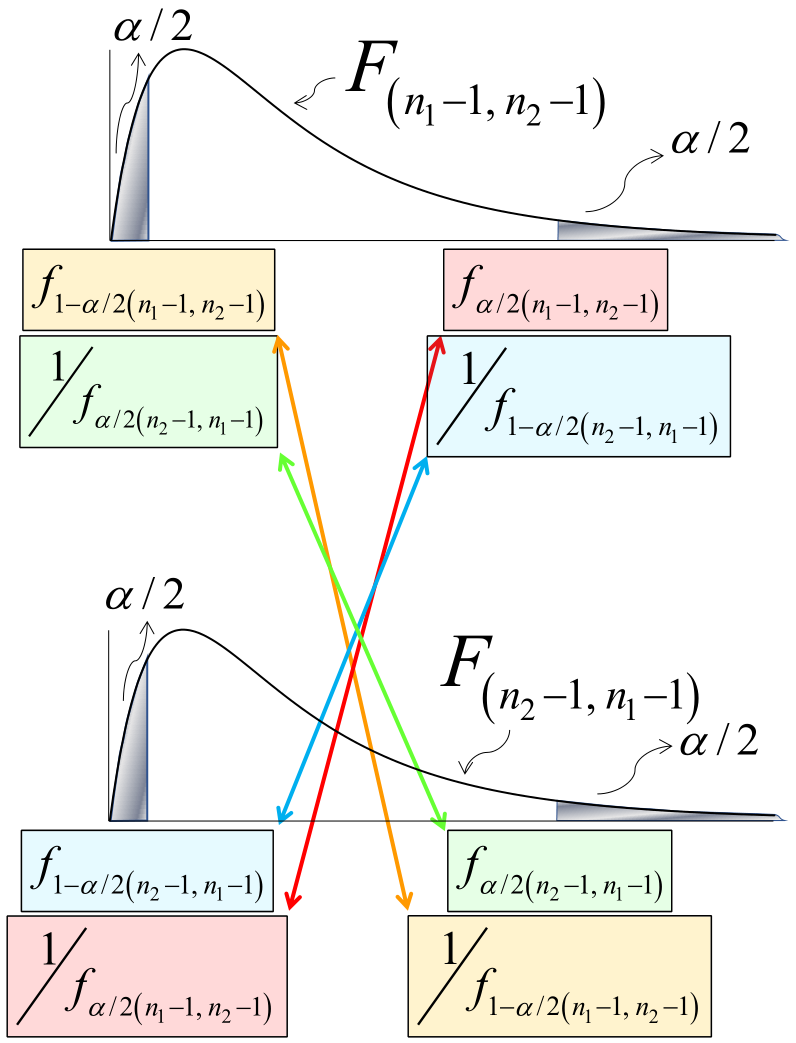

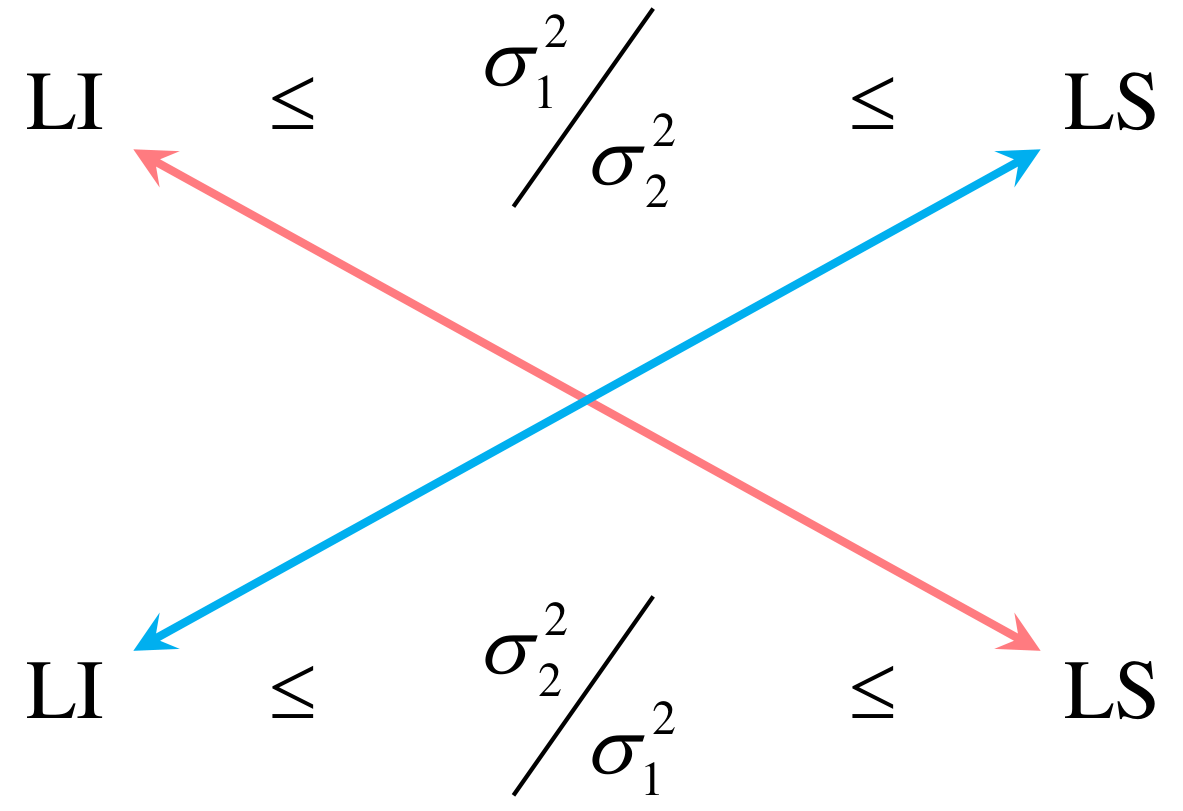

Aunque los estadísticos resultantes son diferentes y también lo es la distribución de referencia (obsérvese el cambio en los grados de libertad), ambas versiones conducen al mismo resultado, en virtud de las relaciones de inversión que se ilustran en la figura 5.1.

En la parte superior de la figura 5.1 se presenta la distribución que seguiría el estadístico \(F_\text{c},\) bajo \(H_0,\) esto es, una distribución \(F\) con \((n_1\!\!−\!\!1,\; n_2\!\!−\!\!1)\) gl, con sus correspondientes regiones de rechazo.

Análogamente, en la parte inferior se muestra el referente distribucional, bajo \(H_0,\) para el estadístico \(F_\text{c}^*,\) con sus correspondientes regiones de rechazo.

Los valores críticos unidos por flechas son inversos multiplicativos que se corresponden con el complemento de \(\alpha\) de la distribución \(F\) con los grados de libertad intercambiados, acorde con la siguiente identidad:

\[

f_{\alpha(n,\;m)}=\frac{1}{f_{1-\alpha(m,\;n)}}

\tag{5.1}\]

A continuación se ilustra esta equivalencia, partiendo del criterio de rechazo con un nivel de significancia \(\alpha\) cuando se usa el estadístico \(F_\text{c}\) y llegando al criterio de rechazo con el mismo nivel de significancia cuando se usa el estadístico \(F_\text{c}^*.\)

El criterio de rechazo de la hipótesis nula con un nivel de significancia \(\alpha\) para una prueba de dos colas cuando se usa el estadístico \(F_\text{c}\) es:

\[

F_\text{c} \le f_{1-\alpha/2(n_1-1,\;n_2-1)}\quad\text{o}\quad F_\text{c} \ge f_{\alpha/2(n_1-1,\;n_2-1)}

\]

Se remplaza \(F_\text{c}\) por la razón de varianzas muestrales, acorde con su definición:

\[

\frac{S_1^2}{S_2^2} \le f_{1-\alpha/2(n_1-1,\;n_2-1)}\quad\text{o}\quad \frac{S_1^2}{S_2^2} \ge f_{\alpha/2(n_1-1,\;n_2-1)}

\]

Puesto que todos los factores que conforman estas desigualdades son positivos, es posible reescribirlas de la siguiente manera, sin alterar su sentido:

\[

\frac{1}{f_{1-\alpha/2(n_1-1,\;n_2-1)}}\le\frac{S_2^2}{S_1^2}\quad\text{o}\quad \frac{1}{f_{\alpha/2(n_1-1,\;n_2-1)}} \ge \frac{S_2^2}{S_1^2}

\]

Usando la identidad 5.1 y la definición de \(F_\text{c}^*,\) este par de desigualdades pueden escribirse así:

\[

f_{\alpha/2(n_2-1,\;n_1-1)}\le F_\text{c}^* \quad\text{o}\quad f_{1-\alpha/2(n_2-1,\;n_1-1)} \ge F_\text{c}^*

\]

Al reorganizar estas desigualdades, se hace evidente que se ha llegado al criterio de partida:

\[

F_\text{c}^* \le f_{1-\alpha/2(n_2-1,\;n_1-1)}\quad\text{o}\quad F_\text{c}^* \ge f_{\alpha/2(n_2-1,\;n_1-1)}

\]

Es indiferente cuál varianza se ubique en el numerador y cuál otra en el denominador para la construcción del estadístico de prueba: el resultado será exactamente el mismo, en términos de significancia.

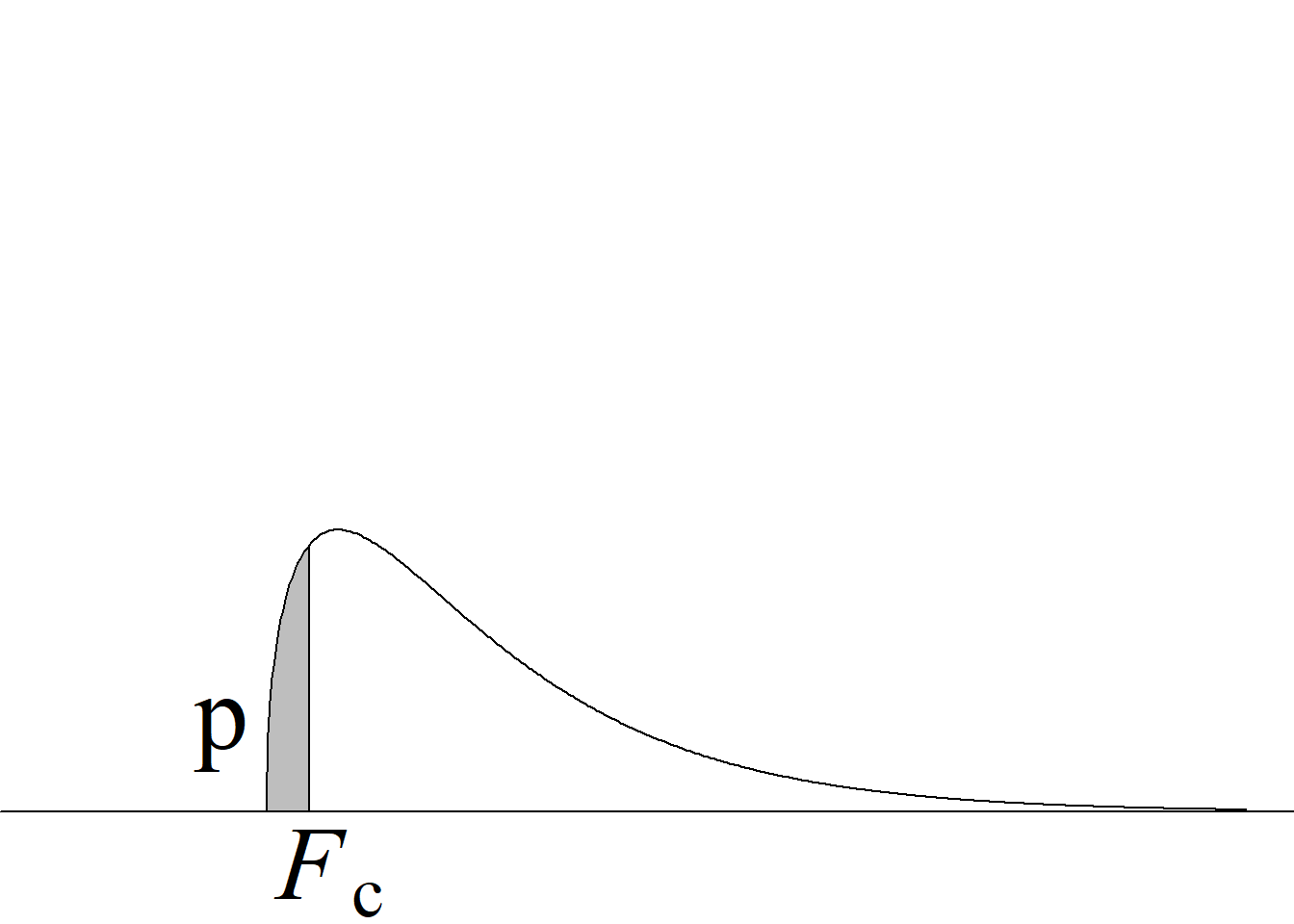

Teniendo en cuenta que para la prueba de homogeneidad de varianzas de dos colas resulta indiferente construir el estadístico de prueba usando cualquiera de las varianzas muestrales en el numerador y la otra en el denominador, y considerando que las tablas de la distribución \(F\) usualmente presentan solo las áreas de la cola derecha, siendo necesario obtener las áreas acumuladas de manera indirecta (mediante la identidad 5.1), ha sido tradicional construir el estadístico de prueba de tal manera que se logre eludir la búsqueda del valor crítico inferior.

Para ello, se calcula el estadístico de prueba como la razón entre la varianza mayor y la varianza menor3, asegurando que su valor siempre sea mayor o igual que la unidad:

\[

F_\text{c}=\frac{\text{máx}\left(S_1^2,\;S_2^2\right)}{\text{mín}\left(S_1^2,\;S_2^2\right)}\equiv \frac{S_{(2)}^2}{S_{(1)}^2}\ge 1

\]

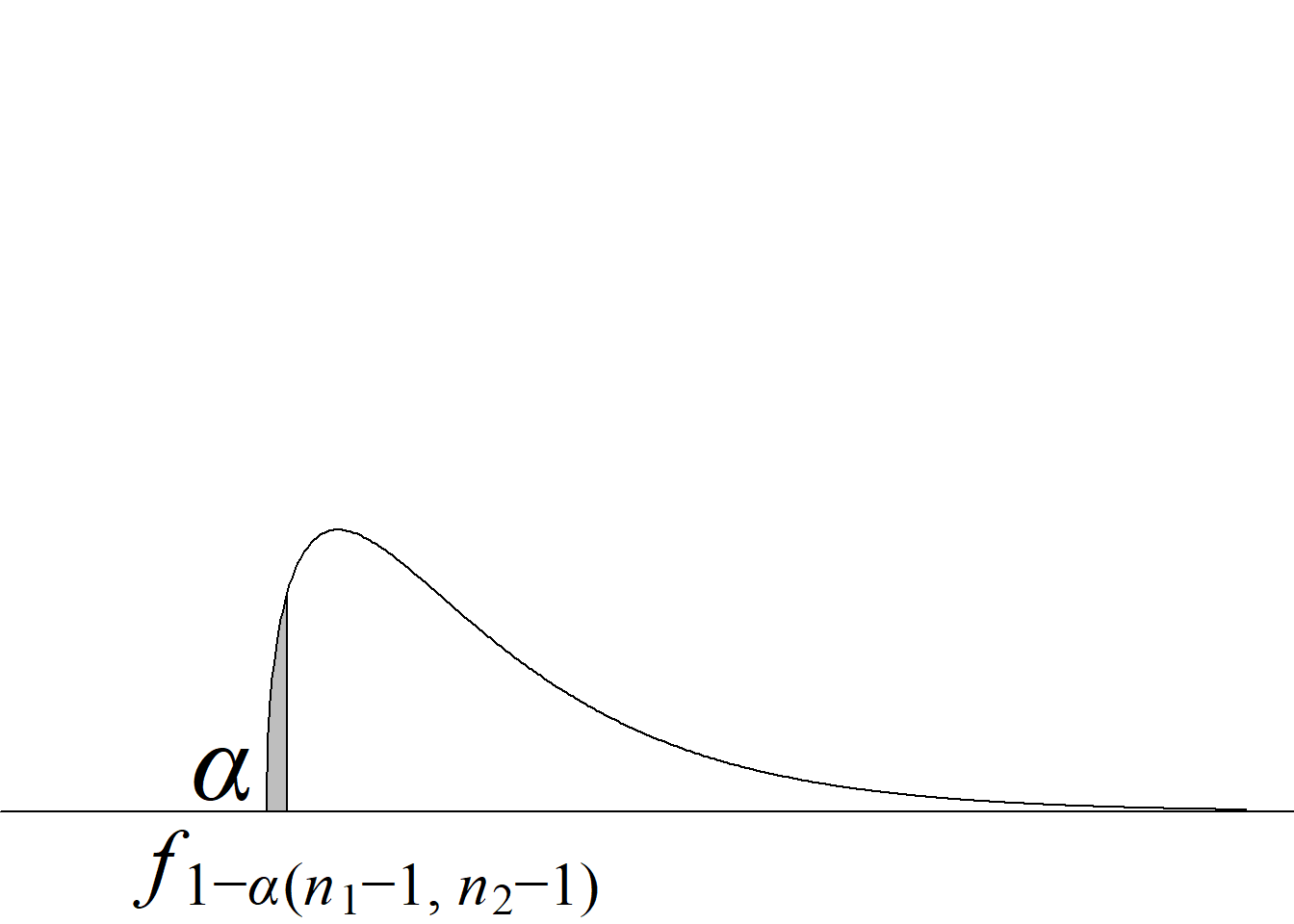

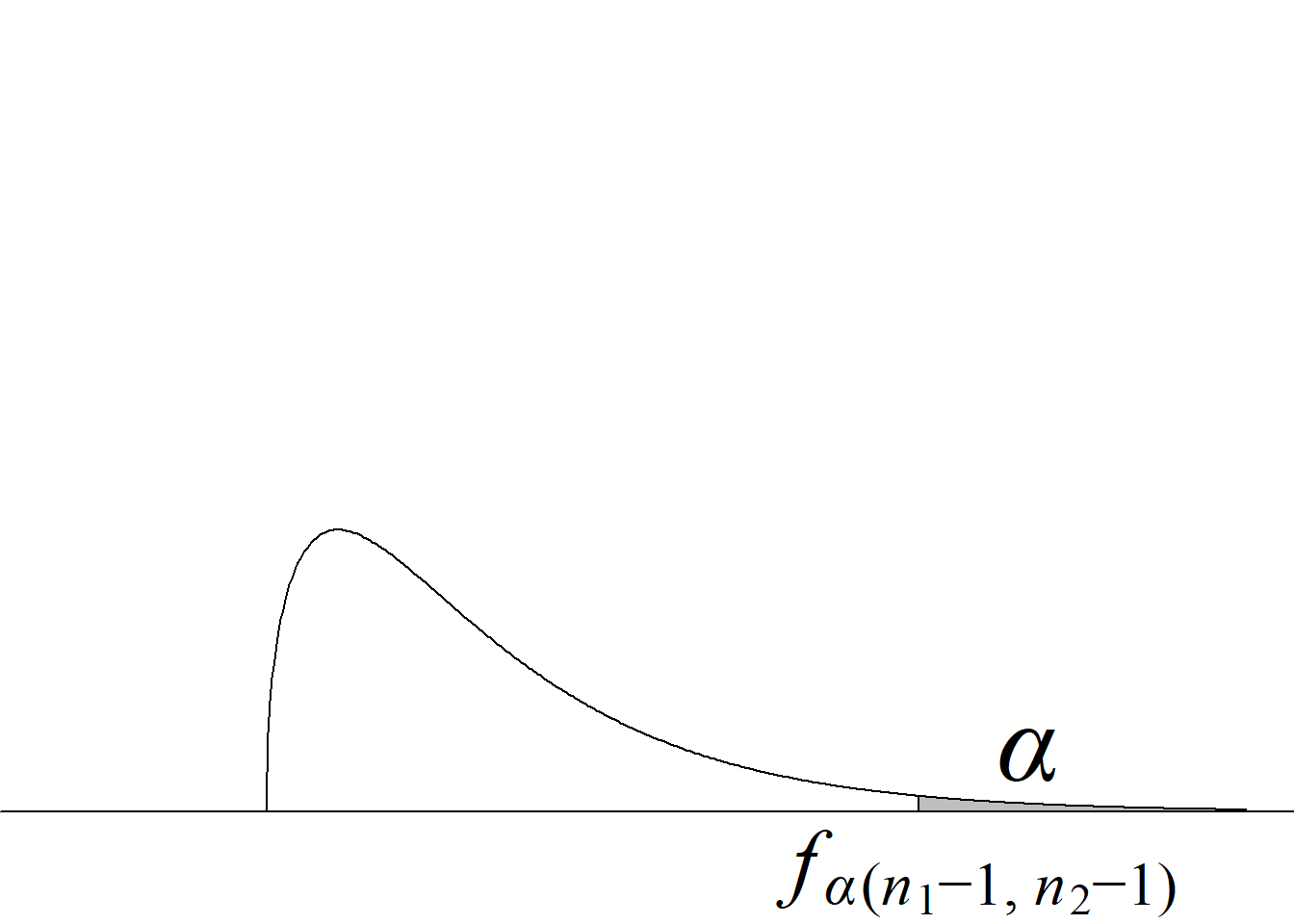

Y, puesto que el valor crítico inferior de la distribución \(F\) para los niveles de significancia usuales, v. gr. \(\alpha = 0.05,\) siempre es menor que 1 para cualquier miembro de la familia \(F,\) bastará con comparar el estadístico de prueba con el valor crítico superior, tal y como se ilustra en la figura 5.2.

Si el estadístico de prueba es mayor o igual que el valor crítico superior, se rechaza la hipótesis nula con un nivel de significancia \(\alpha;\) en caso contrario, no se rechaza la hipótesis nula con un nivel de significancia \(\alpha,\) sin que sea necesario verificar la región crítica inferior.

En resumen, la estrategia de calcular el estadístico de prueba como la razón entre la varianza mayor y la menor hacía más expedita la evaluación cuando el trabajo se realizaba de forma manual, pues permitía contrastar una prueba de dos colas verificando únicamente el valor crítico superior, que era el que solía aparecer tabulado.

Este “ahorro”, sin embargo, es irrelevante hoy en día en que los procesos están automatizados. Y aunque algunos programas estadísticos mantienen esta reminiscencia, otros más, como R, se despreocupan de estos detalles y proceden a calcular siempre la razón entre la primera y la segunda varianza, acorde con el orden en el que el usuario ingrese los argumentos.

La equivalencia entre \(F_\text{c}\) y \(F_\text{c}^*\) se satisface únicamente para pruebas de dos colas.

Al contrastar pruebas de una cola, es necesario calcular el estadístico de prueba respetando el orden planteado en el juego de hipótesis.

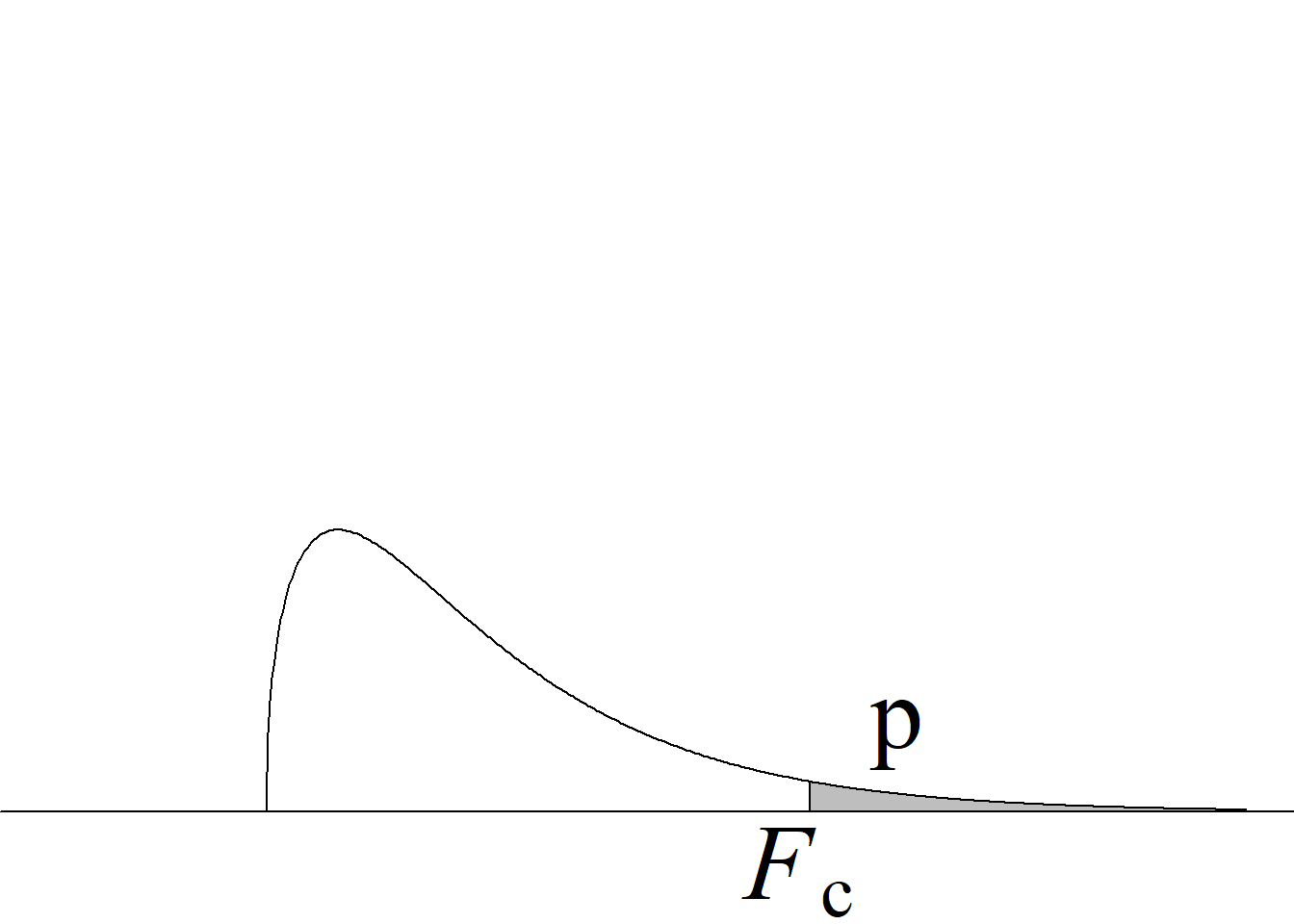

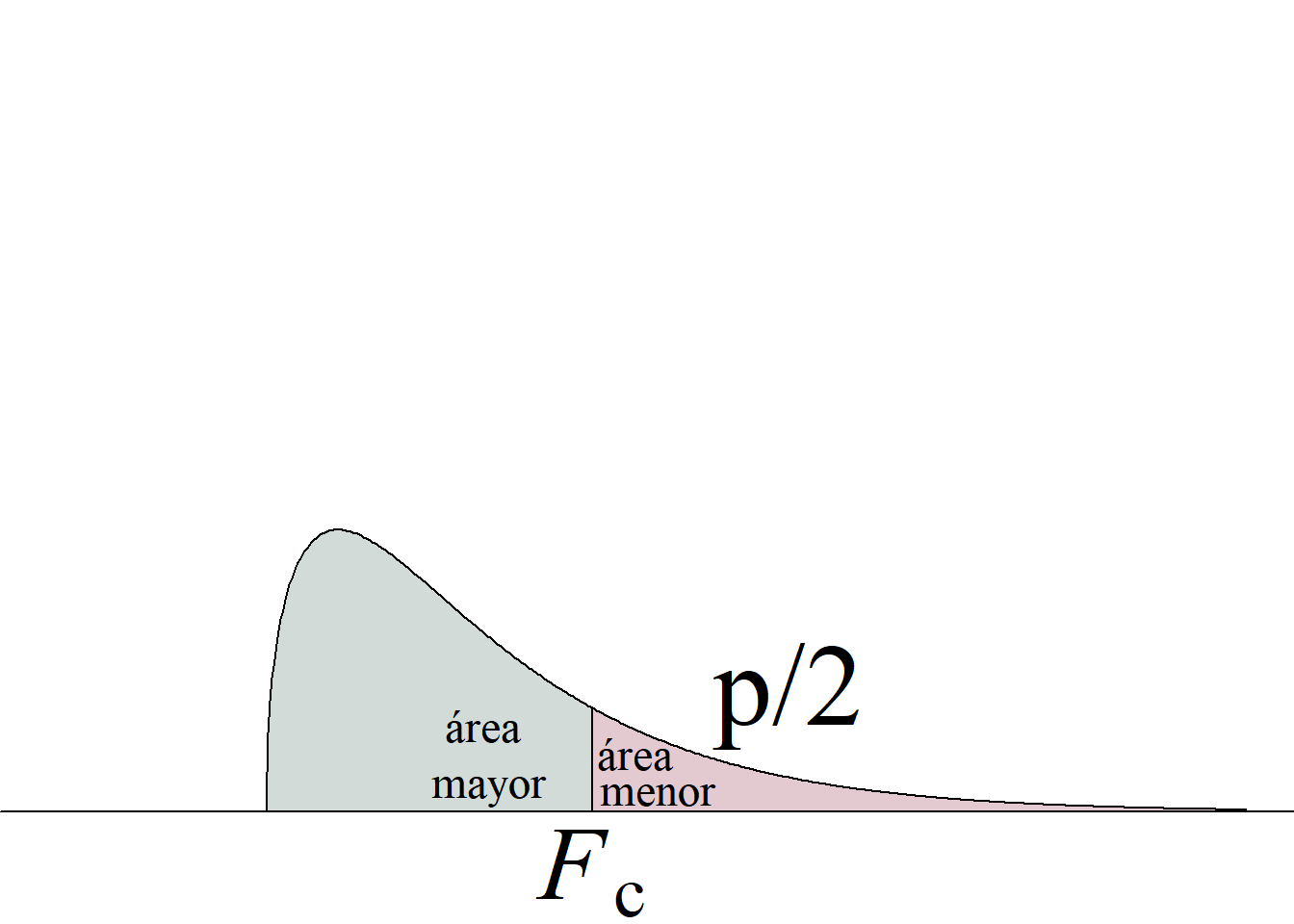

La tabla 5.1 y la figura 5.3 resumen los criterios de rechazo para diferentes tipos de pruebas.

| Tipo de prueba | Criterio de rechazo de \(H_0\) para un nivel de significancia \(\alpha\) | Valor p |

|---|---|---|

Cola izquierda \(H_0:\sigma_1^2\ge\sigma^2_2\) |

\(F_\text{c}\le f_{1-\alpha (n_1-1,\;n_2-1)}\) |

\(P\left(F_{(n_1-1,\;n_2-1)} < F_\text{c}\right)\) |

Cola derecha \(H_0:\sigma_1^2\le\sigma^2_2\) |

\(F_\text{c}\ge f_{\alpha (n_1-1,\;n_2-1)}\) |

\(P\left(F_{(n_1-1,\;n_2-1)}> F_\text{c}\right)\) |

Dos colas \(H_0:\sigma_1^2=\sigma^2_2\) \(H_a:\sigma_1^2\ne\sigma_2^2\) |

\(F_\text{c} \le f_{1-\alpha/

2(n_1-1,\;n_2-1)}\) o |

\(2\,\text{mín}\Big(P\big(F_{(n_1-1,\;n_2-1)}<F_\text{c}\big),\) |

5.1.2 Intervalo de confianza para la razón de dos varianzas normales

El juego de hipótesis para comparar varianzas puede expresarse equivalentemente en términos de un juego de hipótesis para la razón de las varianzas, así:

\[

H_0: \sigma_1^2=\sigma_2^2 \quad \Leftrightarrow \quad \sigma_1^2/\sigma_2^2=1

\]

\[

H_a: \sigma_1^2\ne\sigma_2^2 \quad\Leftrightarrow \quad \sigma_1^2/\sigma_2^2\ne1

\]

Un intervalo de confianza del \(100(1−\alpha)\,\%\) para la razón \(\sigma_1^2/\sigma_2^2\) se construye así:

\[

\left[\frac{S_1^2/S_2^2}{f_{\alpha/2(n_1-1,\; n_2-1)}},\;\; \frac{S_1^2/S_2^2}{f_{1-\alpha/2(n_1-1,\; n_2-1)}}\right]

\]

Si una muestra da lugar al rechazo de la hipótesis nula con un nivel de significancia \(\alpha,\) el correspondiente intervalo de confianza del \(100(1−\alpha)\,\%\) para la razón \(\sigma_1^2/\sigma_2^2\) no incluye la unidad; equivalentemente, cuando no es posible rechazar la hipótesis nula con un nivel de significancia \(\alpha,\) el respectivo intervalo de confianza del \(100(1−\alpha)\,\%\) para la razón \(\sigma_1^2/\sigma_2^2\) incluye el 1.

Rechazar que la razón de varianzas es 1 equivale a rechazar que las varianzas son iguales u homogéneas.

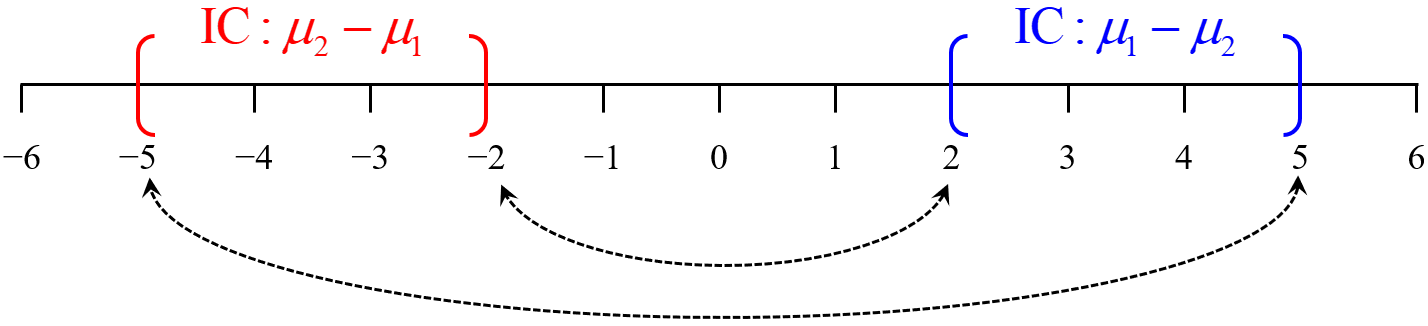

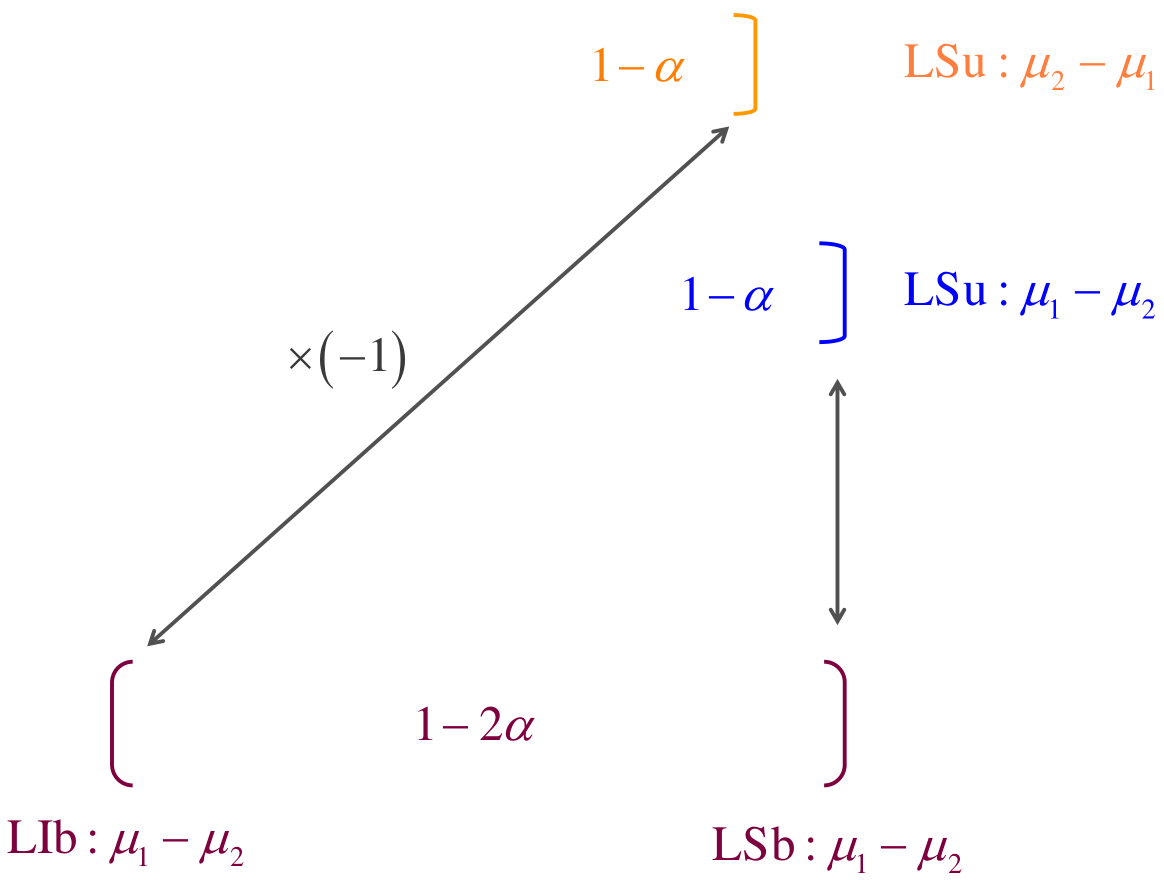

Aunque el intervalo de confianza del \(100(1−\alpha)\,\%\) para la razón \(\sigma_1^2/\sigma_2^2\) no coincide numéricamente con el intervalo de confianza del \(100(1−\alpha)\,\%\) para la razón \(\sigma_2^2/\sigma_1^2\), ambos intervalos son informacionalmente equivalentes, puesto que el límite inferior de uno de los intervalos es el inverso multiplicativo del límite superior del otro y viceversa, tal y como se ilustra en la figura 5.4, donde los inversos multiplicativos se encuentran unidos por una flecha.

Los intervalos de confianza unilaterales del \(100(1−\alpha)\,\%\) para la razón \(\sigma_1^2/ \sigma_2^2\) se obtienen así:

Para \(H_0: \sigma_1^2 \ge \sigma_2^2\,\) vs. \(H_a: \sigma_1^2 < \sigma_2^2,\) \(\quad\quad\text{LS}=\frac{S_1^2/S_2^2}{f_{1-\alpha(n_1-1,\; n_2-1)}}\)

Para \(H_0: \sigma_1^2 \le \sigma_2^2\,\) vs. \(H_a: \sigma_1^2 > \sigma_2^2,\) \(\quad\quad\text{LI}=\frac{S_1^2/S_2^2}{f_{\alpha(n_1-1,\; n_2-1)}}\)

Ejemplo 5.1

Se desea comparar la precisión de dos métodos para determinación de magnesio en suelos, con un nivel de significancia del 5 %.

Usando una muestra homogenizada de suelo, se realizan 14 determinaciones independientes por el método \(\text{A}\) y 11 determinaciones independientes por el método \(\text{B},\) obteniéndose los resultados que se presentan en la tabla 5.2.

| Método A | 1.48 | 0.21 | 0.56 | 0.36 | 1.27 | 2.01 | 0.84 | 1.08 | 1.46 | 1.24 | 0.96 | 1.27 | 1.63 | 1.49 |

| Método B | 0.88 | 0.43 | 0.67 | 2.80 | 1.12 | 0.36 | 1.21 | 1.45 | 0.56 | 1.33 | 1.01 |

A continuación se resaltan algunas particularidades conceptuales del planteamiento experimental.

Para comparar contenidos de magnesio de diferentes suelos, sería necesario tomar muestras independientes de los dos suelos objetivo y realizar las determinaciones por un único método; seguidamente se realizaría la comparación, mediante una prueba de medias (cf. sección 5.2.2).

Si el interés radicara en comparar los dos métodos, dicha comparación podría enfocarse en la exactitud o en la precisión de los mismos, de manera análoga a lo expuesto en los ejemplos 4.2 y 4.3.

Si se pretendiera comparar la exactitud de los dos métodos, lo único que podría averiguarse es si estos conducen a las mismas determinaciones medias. Sin embargo, en caso de encontrar diferencias, no sería posible saber cuál de los métodos goza de mayor exactitud4, a no ser que se contara con una prueba de oro5.

El ejemplo 5.1 ilustra cómo comparar la precisión de los dos métodos, es decir, la consistencia de las diferentes lecturas alrededor de la media. En estos casos se requiere que los diferentes métodos sean aplicados sobre una muestra homogenizada de suelo, pues de otra manera se estaría incorporando la variabilidad propia del suelo.

Para responder la pregunta planteada, se establece el siguiente juego de hipótesis:

\(H_0: \sigma_\text{A}^2=\sigma_\text{B}^2\,\) (las varianzas de los dos métodos son homogéneas)

\(H_a: \sigma_\text{A}^2\ne\sigma_\text{B}^2\,\) (las varianzas de los dos métodos son heterogéneas)

Para el cálculo del estadístico de prueba, se obtienen las varianzas muestrales:

\[

S_\text{A}^2=0.2551,\quad S_\text{B}^2=0.4600

\]

Tal y como se ha indicado, resulta indiferente la posición relativa de las varianzas muestrales en el estadístico de prueba, pudiendo usarse cualquiera de ellas en el numerador y la otra en el denominador, sin que ello altere los resultados. Por consiguiente, cualquiera de los siguientes estadísticos de prueba es válido y conduce al mismo resultado:

\[

F_\text{c}=0.4600/0.2551=1.8032,\quad F_\text{c}^*=0.2551/0.4600=0.5546

\]

La elección del estadístico de prueba determina los grados de libertad de la función probabilística de referencia. Puesto que el estadístico \(F_\text{c}\) usa en el numerador la varianza de la muestra \(\text{B},\) la cual es de tamaño 11 y en el denominador, la varianza de la muestra \(\text{A},\) de tamaño 14, se compara con una distribución \(F\) con 10 y 13 gl; análogamente, el estadístico \(F_\text{c}^*\) se compara con una distribución \(F\) con 13 y 10 gl.

Para usar el método de contraste tradicional al 5 %, se requieren los valores críticos que dejan áreas de 0.025 en las colas de las correspondientes distribuciones.

Si se usa \(F_\text{c},\) estos valores se obtienen así:

Valor crítico inferior: qf(0.025, 10, 13) = 0.2790809.

Valor crítico superior: qf(0.025, 10, 13, lower.tail = F) = 3.249668.

Para \(F_\text{c}^*,\) estos serían los valores críticos:

Valor crítico inferior: qf(0.025, 13, 10) = 0.3077237.

Valor crítico superior: qf(0.025, 13, 10, lower.tail = F) = 3.583191.

El presente ejemplo permite verificar que se satisface la equivalencia de criterios ilustrada en la figura 5.1. Obsérvese que 1/0.2790809=3.583191 y que 1/3.249668=0.3077237.

Cualquiera que sea el estadístico de prueba utilizado, este se ubica en la región de aceptación de su correspondiente distribución de referencia, por lo que no se rechaza la hipótesis nula al 5 %, es decir que no es posible afirmar con baja probabilidad de error que exista diferencia en la precisión de los dos métodos comparados.

Asimismo, puede verificarse que, sin importar cuál estadístico de prueba se use, se obtiene el mismo valor p, el cual se calcula con base en la expresión presentada en la tabla 5.1, para las pruebas de dos colas, así:

Usando \(F_\text{c}:\)

p: 2 * min(pf(1.8032, 10, 13), pf(1.8032, 10, 13, lower.tail = F)) = 0.3167.

Usando \(F_\text{c}^*:\)

p: 2 * min(pf(0.5546, 13, 10), pf(0.5546, 13, 10, lower.tail = F)) = 0.3167.

Un intervalo de confianza del 95% para la razón de varianzas \(\sigma_\text{A}^2/\sigma_\text{B}^2\) se obtiene así:

\[

\left[\frac{S_\text{A}^2/S_\text{B}^2}{f_{\alpha/2(n_\text{A}-1,\; n_\text{B}-1)}},\; \frac{S_\text{A}^2/S_\text{B}^2}{f_{1-\alpha/2(n_\text{A}-1,\; n_\text{B}-1)}}\right]

\]

\[

\left[\frac{0.2551/0.4600}{f_{0.025(13,\; 10)}},\; \frac{0.2551/0.4600}{f_{0.975(13,\; 10)}}\right]

=\left[\frac{0.5546}{3.5832},\; \frac{0.5546}{0.3077}\right]

\]

\[ \text{IC}_{\sigma_\text{A}^2/\sigma_\text{B}^2}:\quad\left[0.1547,\; 1.8024\right] \]

Tal y como era de esperarse, conociendo el resultado del contraste de hipótesis, el intervalo de confianza para la razón de las varianzas contiene el valor 1, por lo que no puede afirmarse con una probabilidad de error menor de 0.05 que los métodos evaluados difieran en precisión.

Invirtiendo los anteriores límites, se obtiene un intervalo de confianza del 95 % para \(\sigma_\text{B}^2/\sigma_\text{A}^2,\) el cual, desde luego, también contiene la unidad:

\[ \text{IC}_{\sigma_\text{B}^2/\sigma_\text{A}^2}:\quad\left[1/1.8024,\; 1/0.1547 \right] =\left[0.5548,\; 6.4641 \right] \]

El siguiente script en R permite reproducir los anteriores resultados. Inicialmente se importan los datos contenidos en el archivo ejemplo 5.1.xlsx y se evalúa el supuesto de normalidad para cada una de las muestras.

data <- readxl::read_excel("ejemplo 5.1.xlsx")

shapiro.test(data$met.A)

Shapiro-Wilk normality test

data: data$met.A

W = 0.96307, p-value = 0.7731shapiro.test(data$met.B)

Shapiro-Wilk normality test

data: data$met.B

W = 0.84597, p-value = 0.03781No se detectan desviaciones severas del supuesto de normalidad para ninguna de las dos muestras. Por tanto, es razonable aplicar la metodología expuesta para la comparación de varianzas.

with(data, var.test(met.A, met.B))

F test to compare two variances

data: met.A and met.B

F = 0.55453, num df = 13, denom df = 10, p-value = 0.3166

alternative hypothesis: true ratio of variances is not equal to 1

95 percent confidence interval:

0.1547587 1.8020382

sample estimates:

ratio of variances

0.55453 ¡Compruébelo usted mismo!

data <- readxl::read_excel("ejemplo 5.1.xlsx")

with(data, var.test(met.B, met.A))La función var.test construye el estadístico de prueba ubicando en el numerador la varianza de la muestra cuya etiqueta aparece como primer argumento de la función, y en el denominador la varianza de la muestra cuya etiqueta aparece como segundo argumento.

Consecuentemente, cuando se use la función var.test para evaluar pruebas de una cola, es necesario asegurarse de que el orden de los argumentos corresponda con el orden en el que está planteado el juego de hipótesis.

Considérense, por ejemplo, dos muestras: una con la etiqueta \(\text{m}302\) y otra con la etiqueta \(\text{m}071\). Y supóngase que se desea probar que la varianza de la primera población es mayor que la varianza de la segunda:

\[

H_0: \sigma_{\text{m}302}^2\le\sigma_{\text{m}071}^2\Rightarrow \sigma_{\text{m}302}^2/\sigma_{\text{m}071}^2\le 1

\]

\[

H_a: \sigma_{\text{m}302}^2>\sigma_{\text{m}071}^2 \Rightarrow \sigma_{\text{m}302}^2/\sigma_{\text{m}071}^2>1

\]

La segunda manera de escribir el juego de hipótesis (como razón de varianzas) muestra que la forma correcta de construir el estadístico de prueba es con \(S_{\text{m}302}^2\) en el numerador y \(S_{\text{m}071}^2\) en el denominador. Para ello, debe escribirse la etiqueta m302 como primer argumento de la función var.test, y la etiqueta m071 como segundo argumento:

var.test(m302, m071, alternative = 'greater')Supóngase ahora que se desea probar que la varianza de la primera población es menor que la varianza de la segunda:

\[

H_0: \sigma_{\text{m}302}^2\ge\sigma_{\text{m}071}^2\Leftrightarrow \sigma_{\text{m}302}^2/\sigma_{\text{m}071}^2\ge 1

\]

\[

H_a: \sigma_{\text{m}302}^2<\sigma_{\text{m}071}^2 \Leftrightarrow \sigma_{\text{m}302}^2/\sigma_{\text{m}071}^2<1

\]

De nuevo, la forma correcta de construir el estadístico de prueba es con \(S_{\text{m}302}^2\) en el numerador y \(S_{\text{m}071}^2\) en el denominador; lo que cambia respecto al caso anterior no es el estadístico de prueba, sino la dirección de la hipótesis alternativa. Para ello, se utiliza la siguiente instrucción en R:

var.test(m302, m071, alternative = 'less')5.2 Comparación de las medias de dos poblaciones normales

La normal es el modelo por excelencia de numerosas poblaciones de campo y, en particular, el parámetro \(\mu\) de esta distribución sirve de modelo a las correspondientes medias de campo (cf. sección 3.9). En consecuencia, la comparación de medias es uno de los métodos inferenciales básicos de mayor uso en la práctica estadística.

Hay dos estrategias para recolectar la información que sirve de sustento a la comparación de medias:

Tomando una muestra independiente de cada una de las poblaciones objetivo.

Usando en cada población una muestra que se relacione elemento a elemento con la muestra de la otra población.

A la primera estrategia se le denomina de muestras independientes; a la segunda, de muestras pareadas.

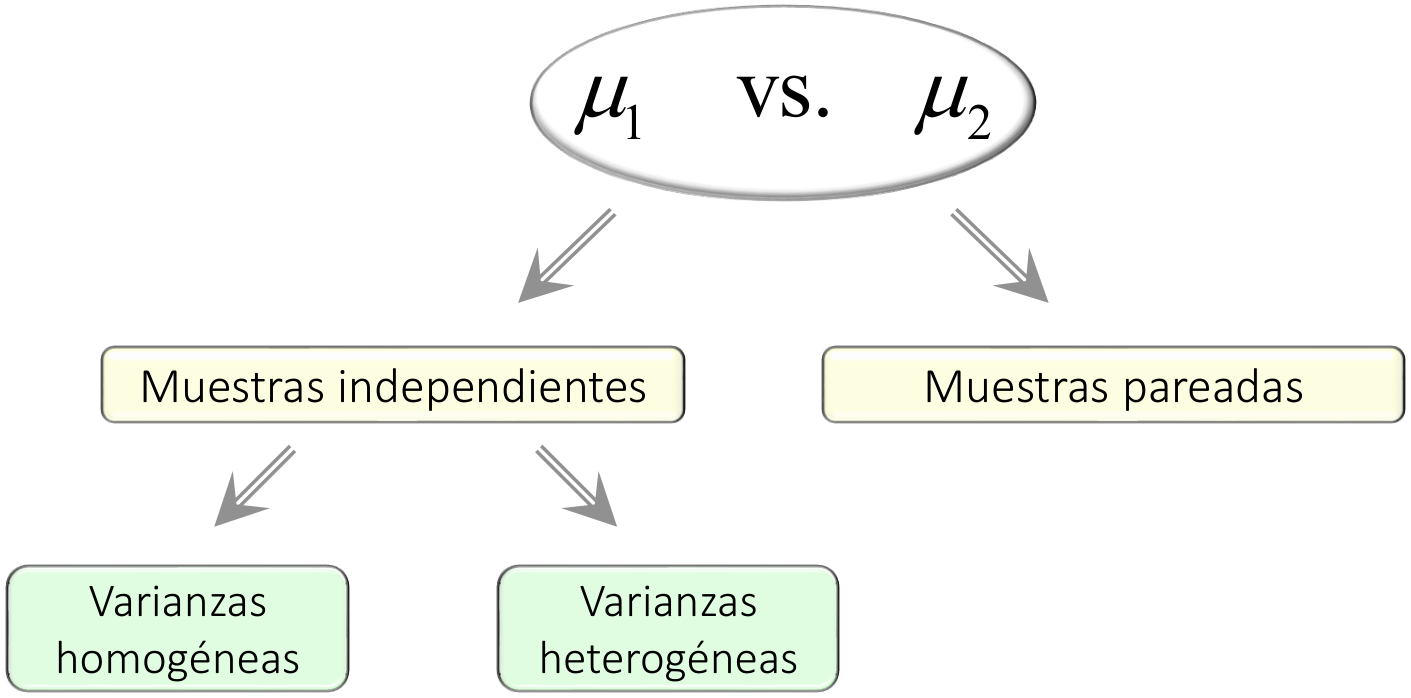

La técnica de comparación de medias basada en muestras independientes cuenta con dos versiones, una de las cuales se usa cuando las varianzas de las poblaciones comparadas son homogéneas, y otra, cuando son heterogéneas.

En adición a estas dos versiones de la prueba de medias, existe una tercera prueba que se usa siempre que se colecte la información mediante muestras pareadas, sin que exista en este caso ningún requerimiento relativo a las varianzas poblacionales.

La figura 5.5 esquematiza estas tres pruebas de comparación de medias.

La comparación de medias utilizando muestras pareadas —cuando ello es viable— suele resultar más efectiva que la correspondiente comparación usando muestras independientes. Esta estrategia se detalla en la sección 5.2.3.

El uso de muestras independientes, por su parte, es la opción que muchos investigadores adoptan por defecto, ya que estas muestras suelen ser las de más fácil obtención en campo.

Cuando se habla de muestras independientes, es importante precisar que la independencia a la que se hace mención es entre muestras. Esta no remplaza ni modifica el requisito de independencia que debe existir entre las lecturas que conforman cada una de las muestras, es decir, dentro de cada muestra (cf. secciones 3.6.2 y 3.9: Muestra).

Aunque en campo no es posible garantizar la independencia de las lecturas que conforman una muestra, esta suele propiciarse mediante la obtención de muestras aleatorias. Por su parte, la independencia entre muestras se da de manera natural cuando no existen vínculos entre los procesos muestrales que se realizan en las dos poblaciones.

En las dos secciones siguientes se presentan las metodologías más populares para la comparación de medias, a partir de muestras independientes. La metodología de la sección 5.2.1, que se denomina prueba de \(t,\) es apta para los casos en que las varianzas poblacionales son homogéneas.

Zimmerman (2004) advierte que el uso de esta prueba en situación de heterocedasticidad afecta las tasas de error tipo I, en particular cuando se tienen diferentes tamaños de muestra. Cuando las mayores varianzas se asocian con los mayores tamaños de muestra, la probabilidad de error tipo I cae por debajo del nivel nominal; cuando sucede a la inversa, se incrementa muy por encima del nivel de significancia nominal .

En la sección 5.2.2 se presenta la prueba de Welch, que permite realizar la comparación de medias cuando las varianzas poblacionales son heterogéneas, manteniendo la tasa de error tipo I en su nivel nominal y disminuyendo simultáneamente la probabilidad de error tipo II (Zimmerman, 2004).

Aunque es lógico razonar que antes de efectuar la prueba de comparación de medias deben evaluarse las varianzas usando la prueba que se presentó en la sección 5.1 —y de hecho ese fue el procedimiento seguido durante mucho tiempo—, estudios como el de Moser y Stevens (1992) analizan otras posibilidades:

Utilizar siempre la prueba de \(t\) sin evaluar previamente homogeneidad de varianzas.

Utilizar siempre la prueba de Welch sin evaluar previamente homogeneidad de varianzas.

Utilizar una u otra prueba, dependiendo del resultado de la prueba de homogeneidad de varianzas.

Estos autores concluyen que —excepto cuando se tienen tamaños de muestra diferentes y se sabe (no cuando se infiere mediante una prueba) que las varianzas poblacionales son iguales— la segunda estrategia, es decir, el uso no condicionado de la prueba de Welch, tiene un mejor desempeño.

Y puesto que en la práctica nunca se conocen las varianzas poblacionales, el uso directo de la prueba de Welch constituye la mejor estrategia en todos los casos.

Zimmerman (2004) realizó un estudio de simulación, calculando las probabilidades asociadas al proceso de elegir una prueba en función de los resultados de la prueba de homogeneidad de varianzas. Concluye que cuando se usa la prueba de Welch de manera no condicionada al resultado de la prueba de homogeneidad de varianzas, la tasa de error tipo I se mantiene muy cerca de su nivel nominal. En contraste, para la mayoría de condiciones evaluadas, su desempeño es mucho peor cuando se usa acoplada a una prueba de homogeneidad de varianzas. Este autor concluye que, cuando se tienen diferentes tamaños de muestra, la estrategia más eficiente consiste en realizar la prueba de Welch no condicionada al resultado de la prueba de homogeneidad de varianzas.

Delacre, Lakens y Leys (2017), quienes discuten el uso de estas pruebas y otra más (la de Yuen) en el ámbito de la investigación en sicología, usándolas tanto de manera directa como condicionada al resultado de la prueba de homogeneidad de varianzas, también concluyen que la mejor estrategia consiste en el uso directo de la prueba de Welch.

Tomando en consideración los argumentos expuestos por estos autores, igualmente recomendamos el uso directo de la prueba de Welch para la comparación de las medias de dos poblaciones normales. De hecho, esta es la prueba de medias que R trae implementada por defecto en la función de t.test{stats}.

La prueba de Welch constituye la mejor estrategia para comparar medias de dos poblaciones normales, sin importar lo que se especule o infiera sobre las varianzas poblacionales.

5.2.1 Comparación de medias, usando muestras independientes, con varianzas homogéneas: Prueba de \(t\)

Reiterando la recomendación de no usar la prueba de \(t\) para la comparación de medias de dos poblaciones normales, consideramos pertinente su exposición, ya que constituye la base conceptual de métodos como el análisis de varianza (cf. sección 6.2) —que puede verse como una generalización de la prueba de \(t\)— y la prueba de la diferencia mínima significativa (cf. sección 8.4) —que es la misma prueba de \(t\) presentada bajo otro formato—.

5.2.1.1 Prueba de hipótesis para la comparación de medias, usando muestras independientes, con varianzas homogéneas

Considérense dos muestras aleatorias independientes, provenientes de sendas poblaciones normales6:

\(X_{11},X_{12},...,X_{1n_1}\: \text{iid}\: N\left(\mu_1, \sigma_1^2\right)\quad\) y \(\quad X_{21},X_{22},...,X_{2n_2}\: \text{iid}\: N\left(\mu_2, \sigma_2^2\right)\)

La media de cada una de estas muestras —que es una combinación lineal de variables aleatorias normales— tiene a su vez distribución normal.

\[

\overline{X}_1\thicksim N\left(\mu_1,\;\sigma_1^2/n_1\right)

\]

\[

\overline{X}_2\thicksim N\left(\mu_2,\;\sigma_2^2/n_2\right)

\]

La diferencia de estas medias es también una variable aleatoria normal:

\[

\left(\overline{X}_1-\overline{X}_2\right)\thicksim N\left(\mu_1-\mu_2,\;\;\frac{\sigma_1^2}{n_1}+\frac{\sigma_2^2}{n_2}\right)

\]

Estandarizando se llega a una normal estándar:

\[

\frac{\Big(\overline{X}_1-\overline{X}_2\Big)-\Big(\mu_1-\mu_2\Big)}

{\sqrt{\frac{\sigma_1^2}{n_1}+\frac{\sigma_2^2}{n_2}}} \thicksim N\left(0,\;1\right)

\]

Si las varianzas poblacionales son iguales7, es decir, si \(\sigma_1^2=\sigma_2^2=\sigma^2,\) la anterior expresión puede escribirse así:

\[

\frac{\Big(\overline{X}_1-\overline{X}_2\Big)-\Big(\mu_1-\mu_2\Big)}

{\sqrt{\sigma^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}} \thicksim N\left(0,\;1\right)

\tag{5.2}\]

Para generar un estadístico de prueba, se requiere remplazar la varianza poblacional, \(\sigma^2,\) con un estimador muestral. Para tal efecto, se usa un promedio ponderado8 de las varianzas muestrales, tomando los denominadores de las varianzas muestrales como factores de ponderación.

\[

S_\text{p}^2=\frac{(n_1-1)S_1^2+(n_2-1)S_2^2}{n_1+n_2-2}

\tag{5.3}\]

Al estimador que se obtiene de esta manera suele denominársele varianza combinada o varianza ponderada. Este último nombre puede resultar más nemotécnico, por estar acorde con el subíndice que se hereda del término en inglés (pooled).

Aunque todo es promediable numéricamente, no todo es conceptualmente promediable (cf. precaución 2.1).

Esta admonición cobra particular relevancia en el presente contexto, en el que \(S^2_\text{p}\) solo tendría sentido como representante de la varianza común de las dos poblaciones si \(\sigma_1^2=\sigma_2^2.\)

En escenarios de heterocedasticidad, \(S^2_\text{p}\) no representaría adecuadamente ni a \(\sigma_1^2\) ni a \(\sigma_2^2,\) por lo cual, la prueba de \(t\) tendría un pobre desempeño en comparación con la prueba de Welch.

Si se remplaza el valor de la varianza poblacional que aparece en el denominador de la expresión 5.2 por el de su estimador combinado (expresión 5.3), se obtiene un estadístico que sigue una distribución \(t\) con grados de libertad correspondientes al denominador de la varianza ponderada:

\[

\frac{\Big(\overline{X}_1-\overline{X}_2\Big)-\Big(\mu_1-\mu_2\Big)}

{\sqrt{S_\text{p}^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}}

\thicksim t_{\left(n_1+n_2-2\right)}

\tag{5.4}\]

Considérese el siguiente juego de hipótesis:

\[

H_0:\mu_1=\mu_2\Leftrightarrow \mu_1-\mu_2=0

\] \[

H_a:\mu_1\ne\mu_2\Leftrightarrow \mu_1-\mu_2\ne0

\]

El estadístico de prueba se obtiene condicionando la expresión 5.4 a que la hipótesis nula sea cierta, es decir, haciendo la diferencia \(\mu_1-\mu_2=0\!:\)

\[

t_\text{c}=\frac{\overline{X}_1-\overline{X}_2}

{\sqrt{S_\text{p}^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}}

\overset {H_0}\thicksim t_{\left(n_1+n_2-2\right)}

\tag{5.5}\]

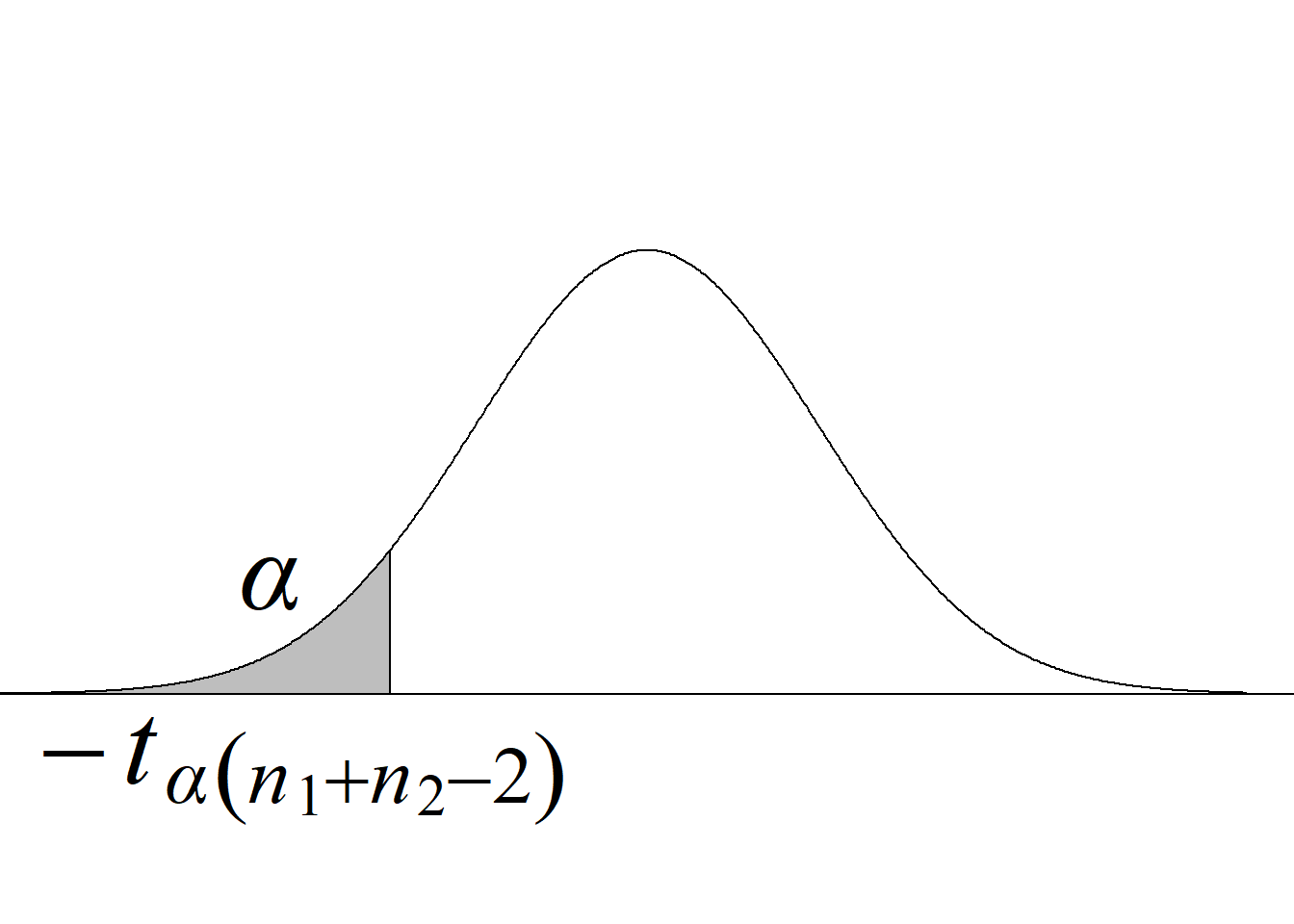

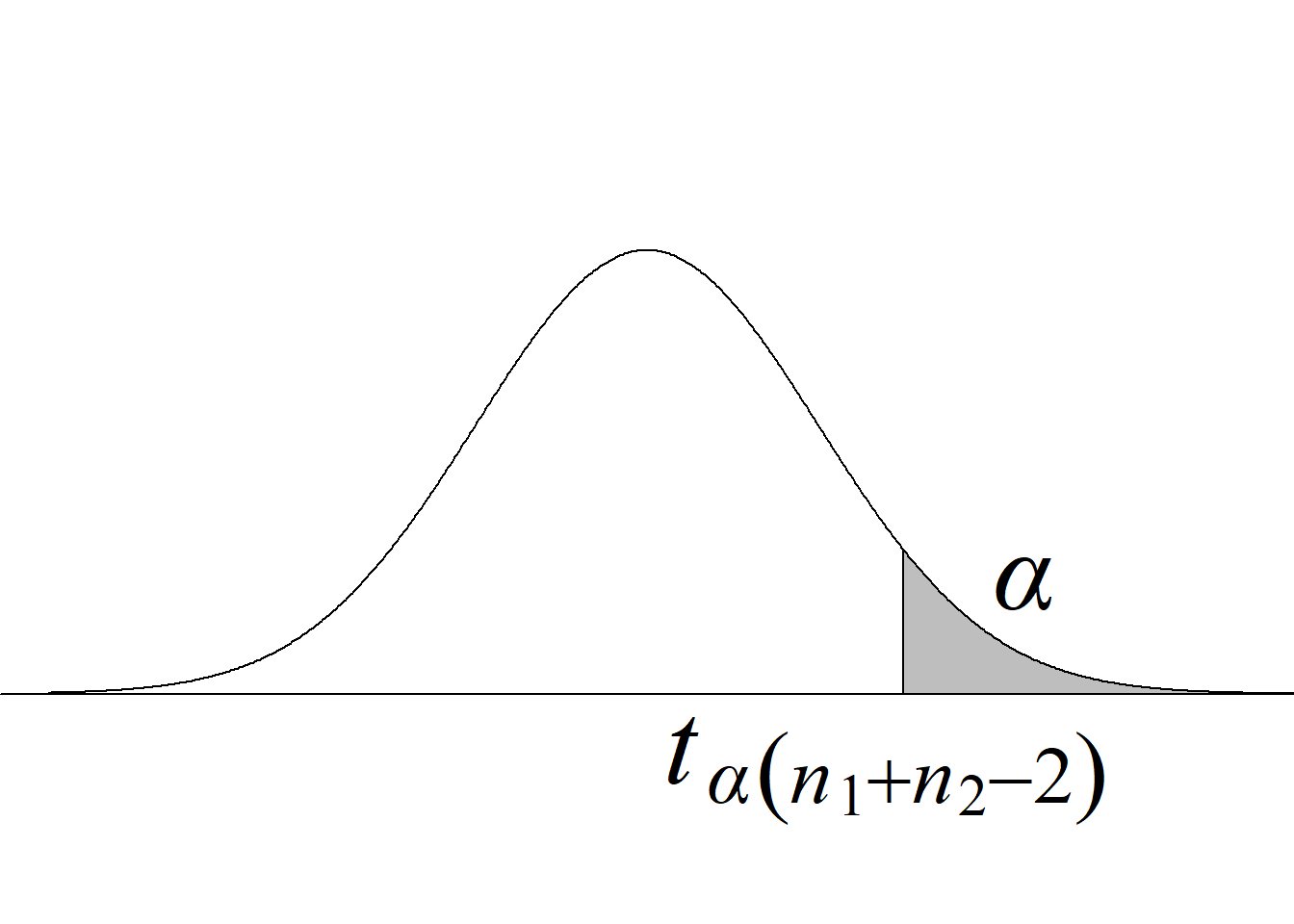

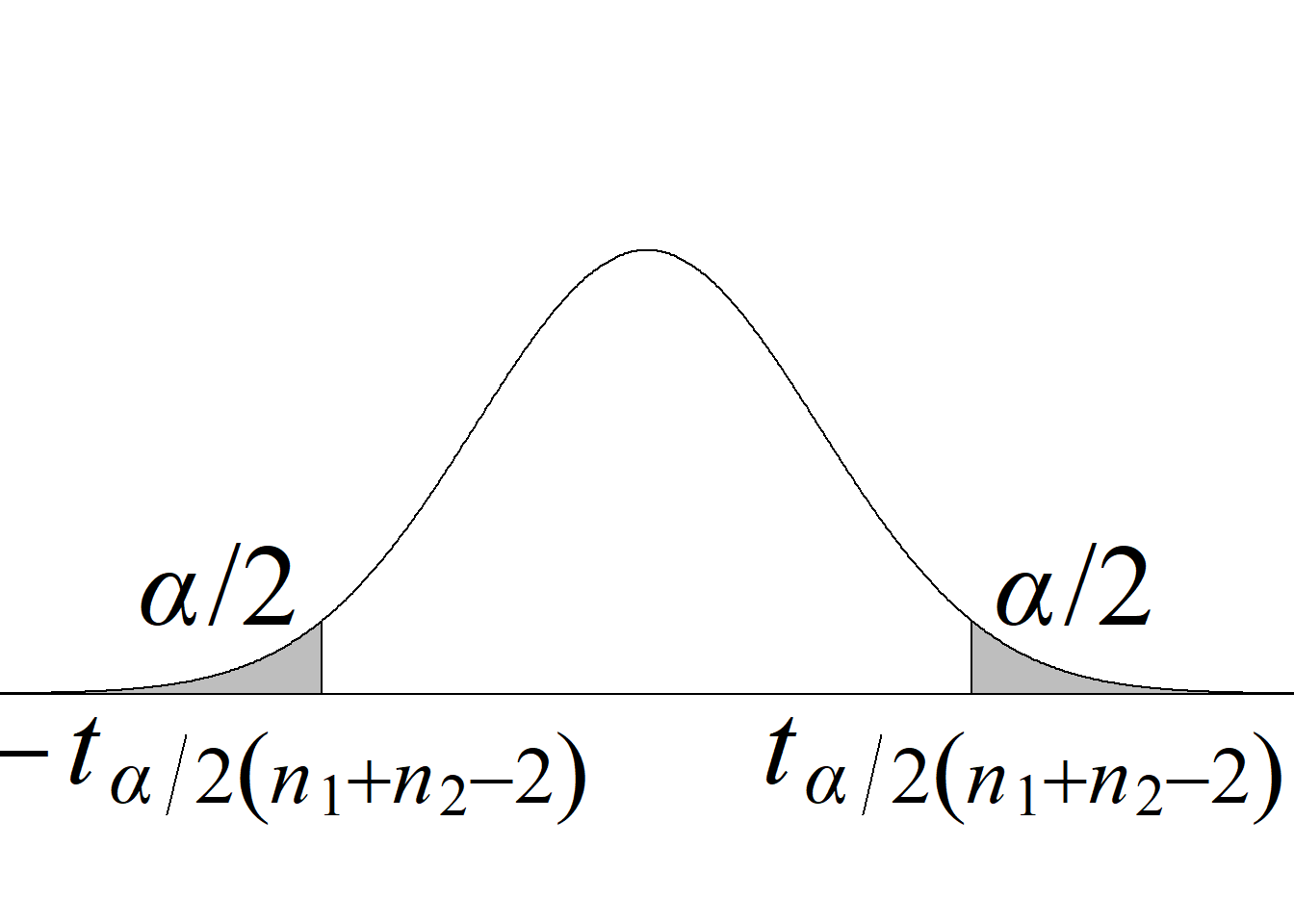

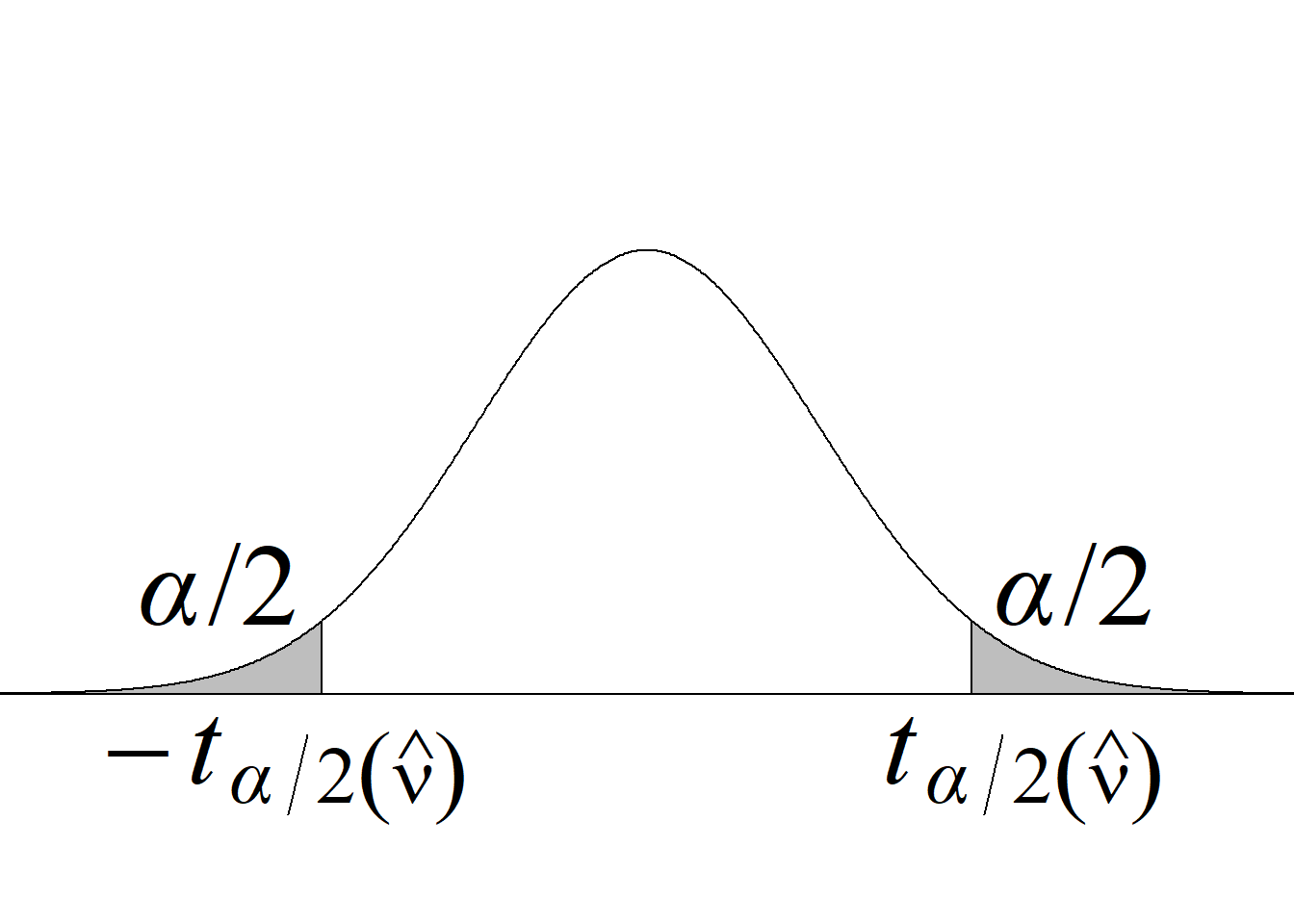

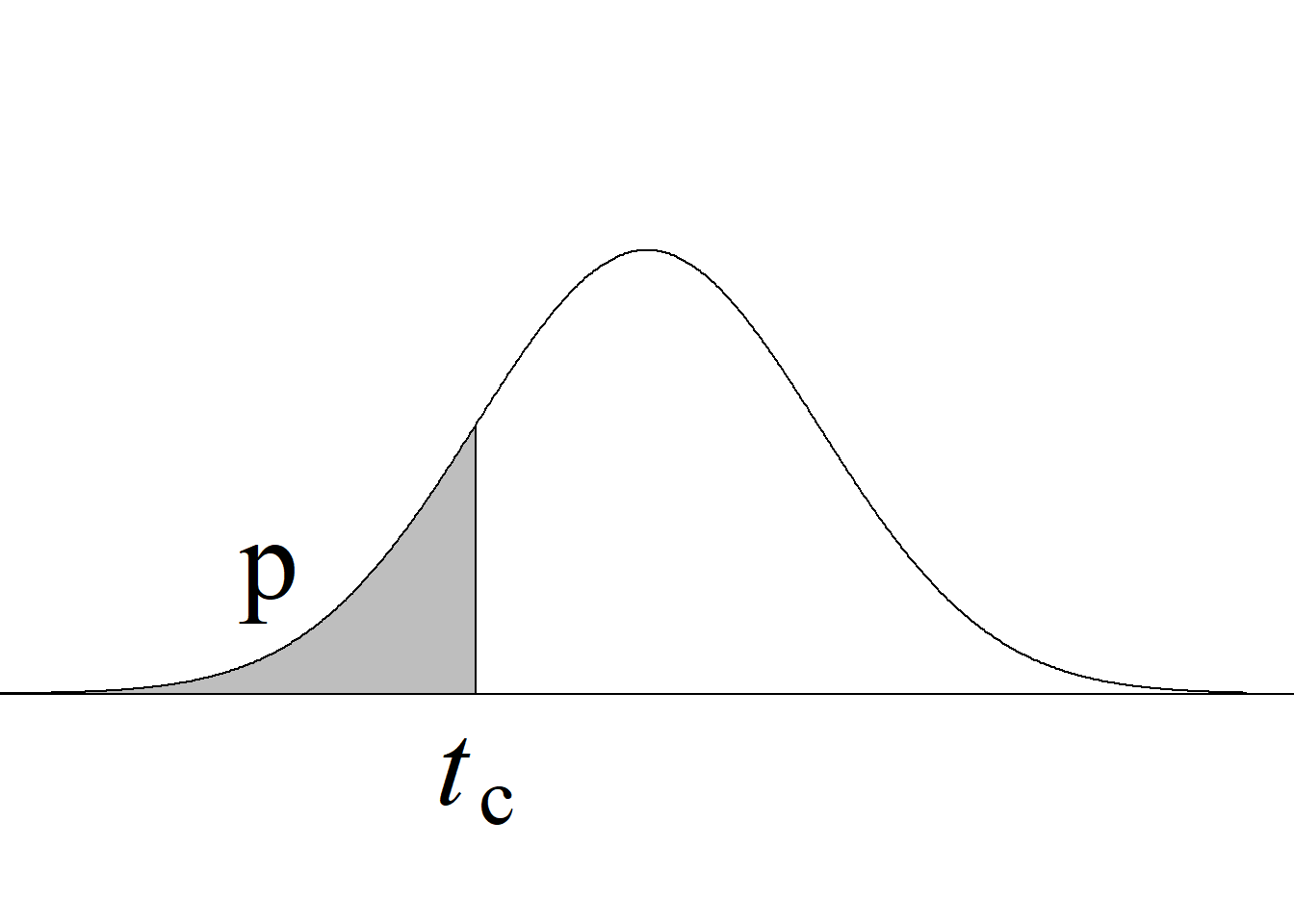

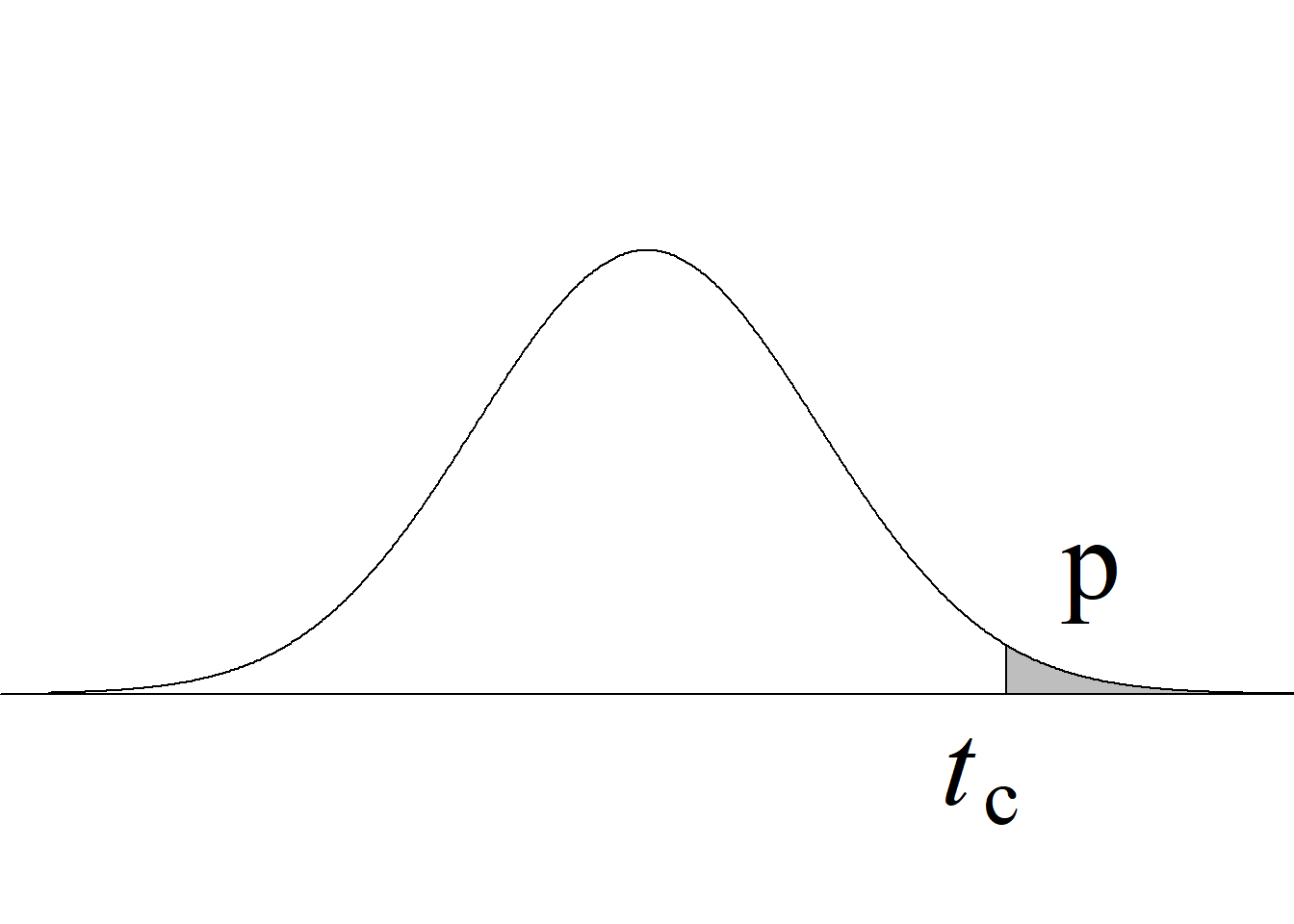

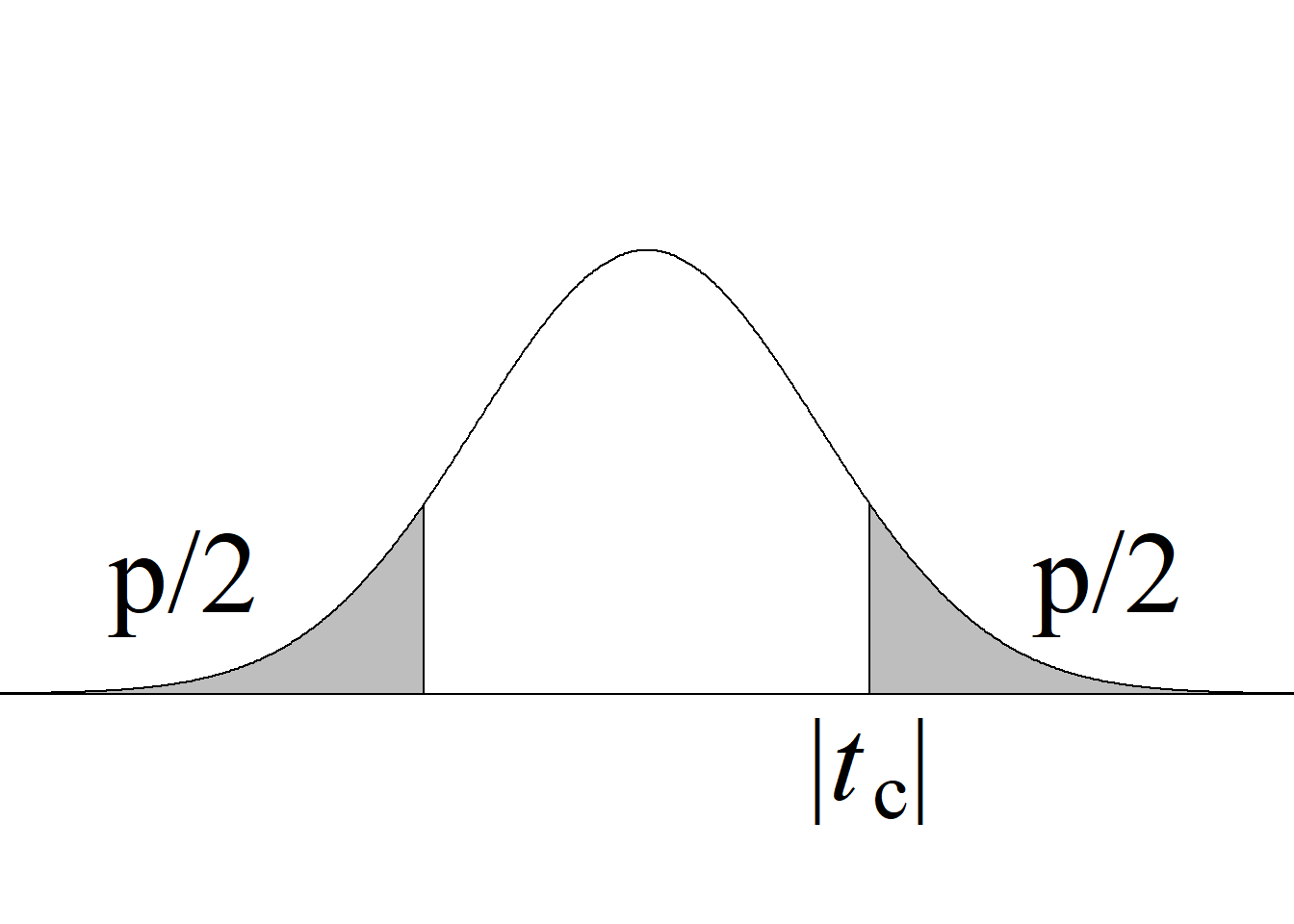

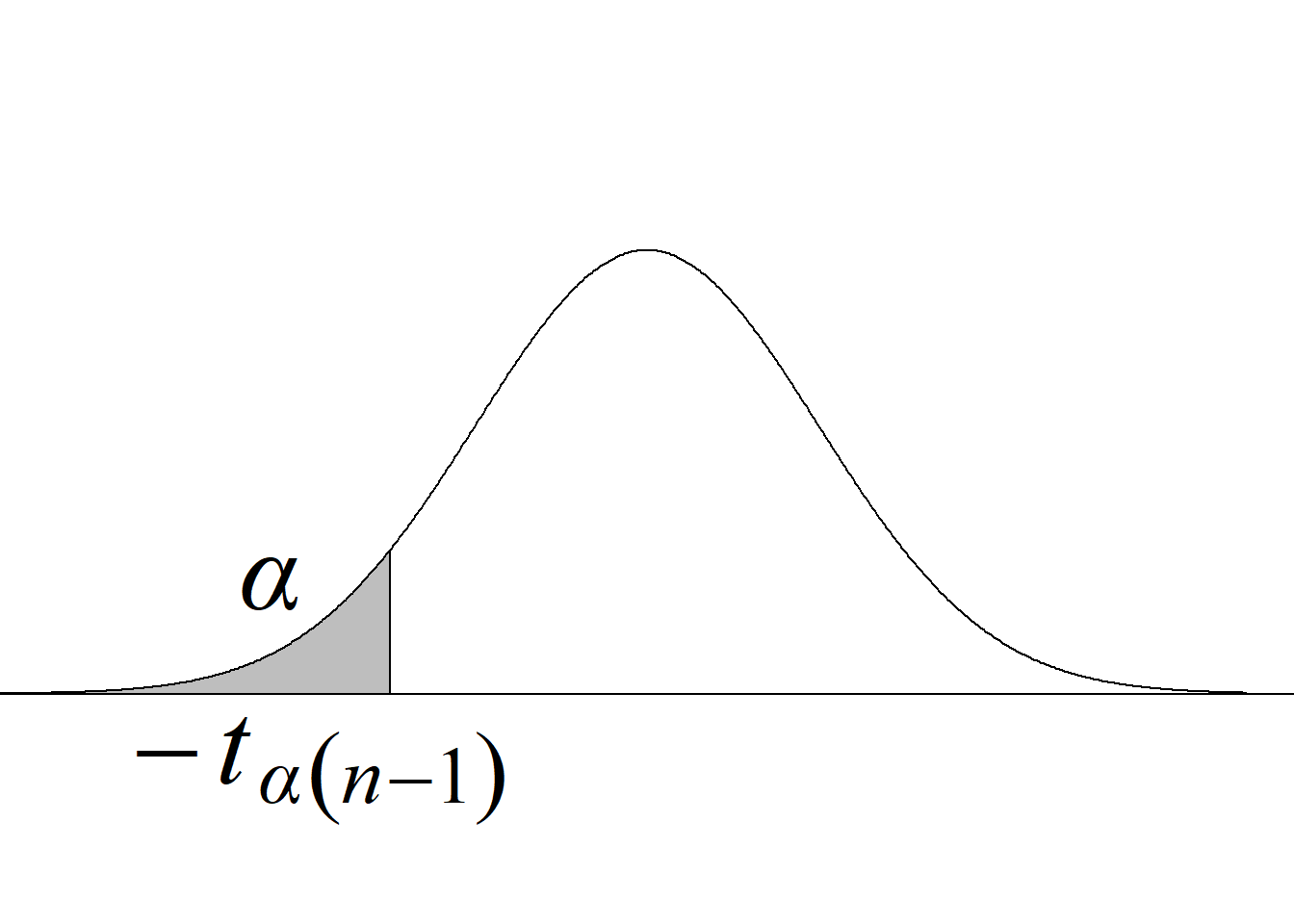

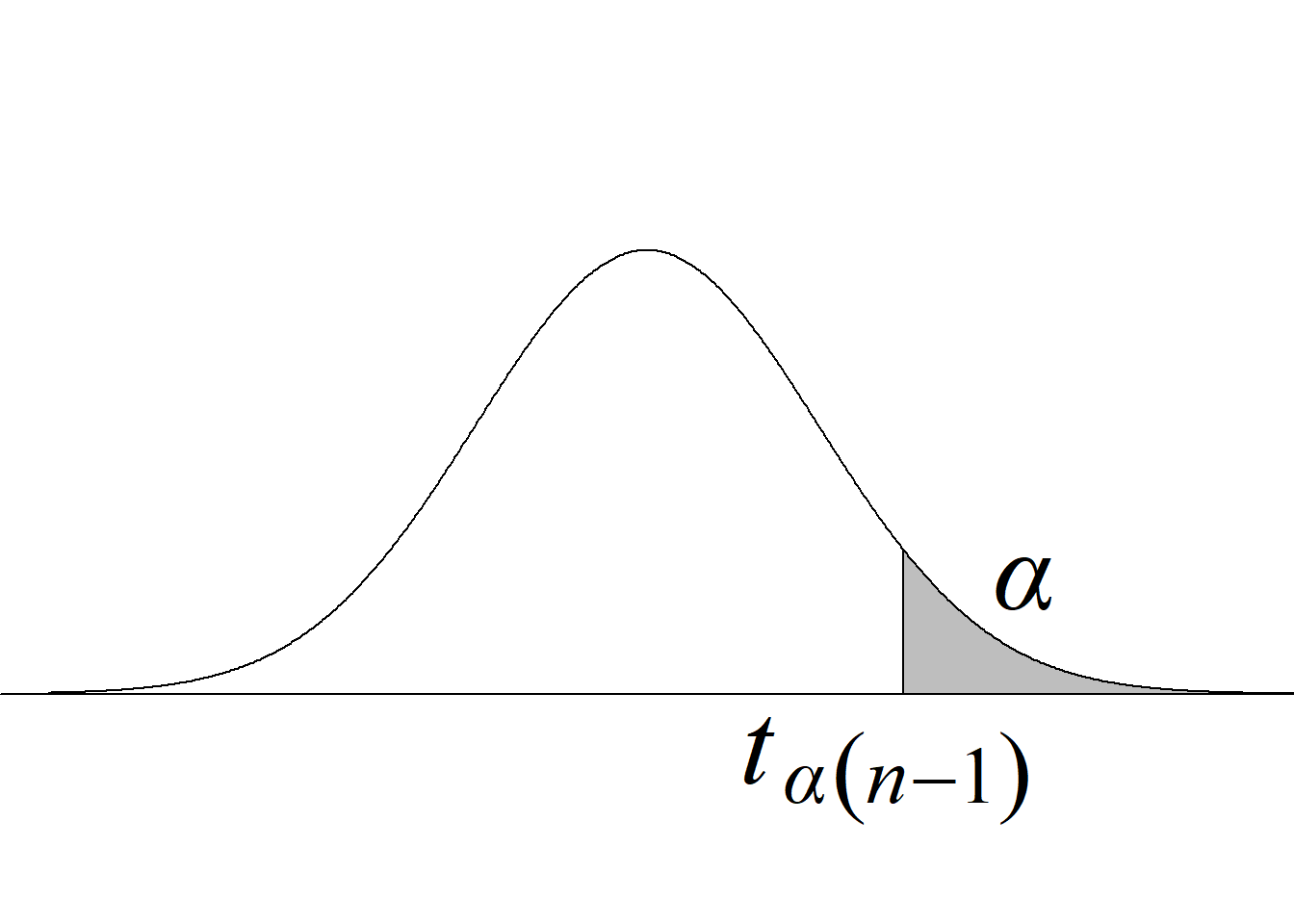

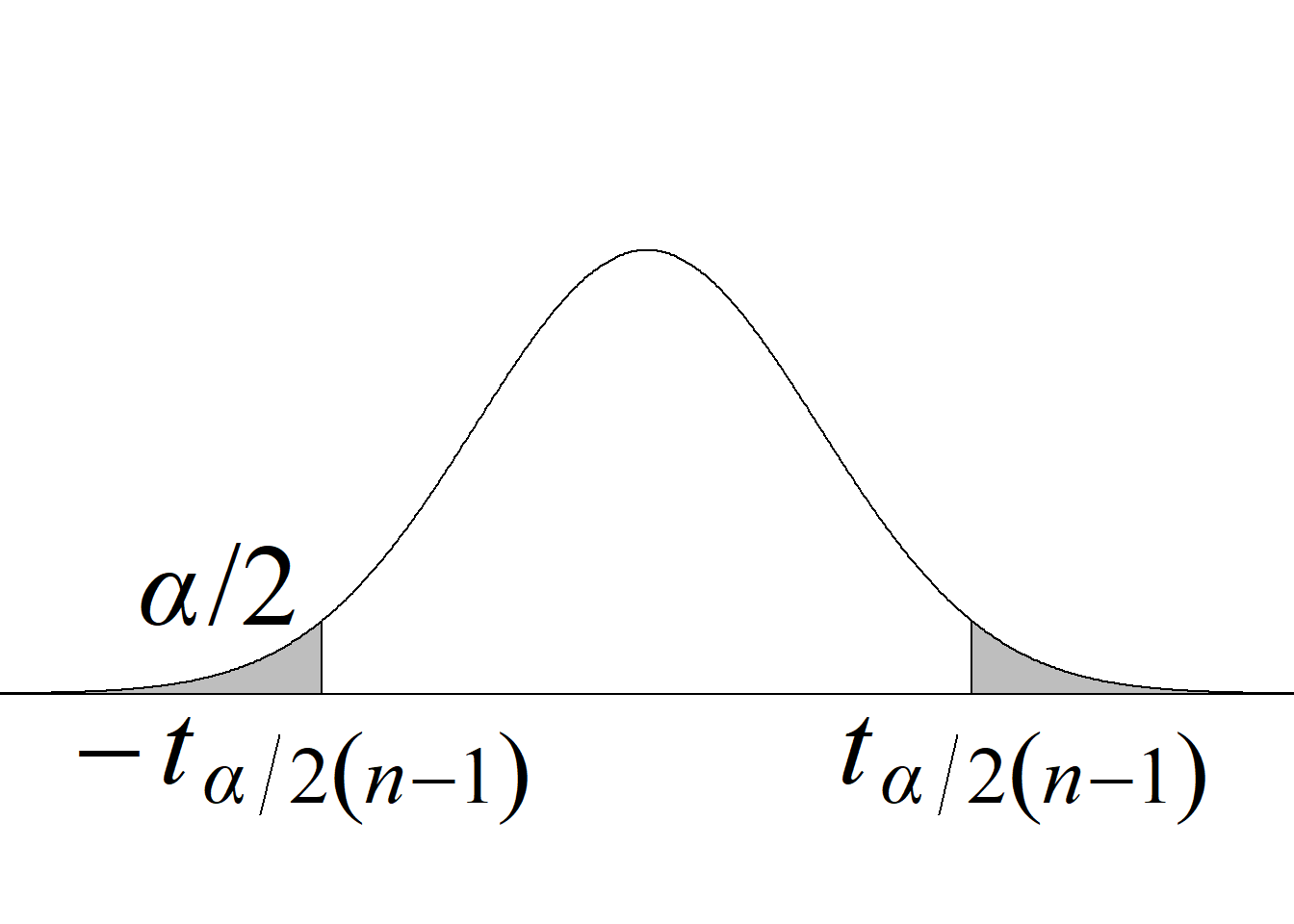

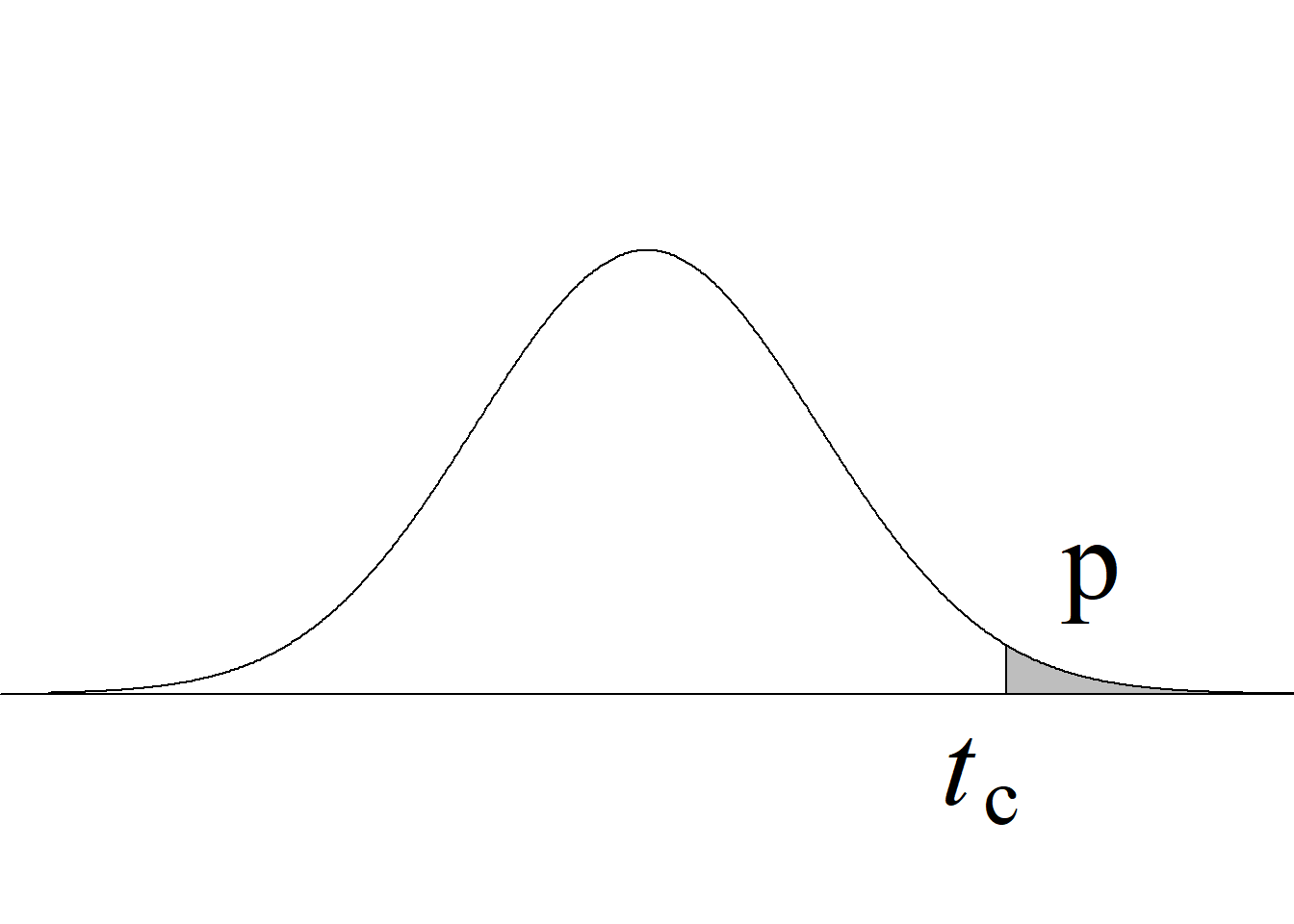

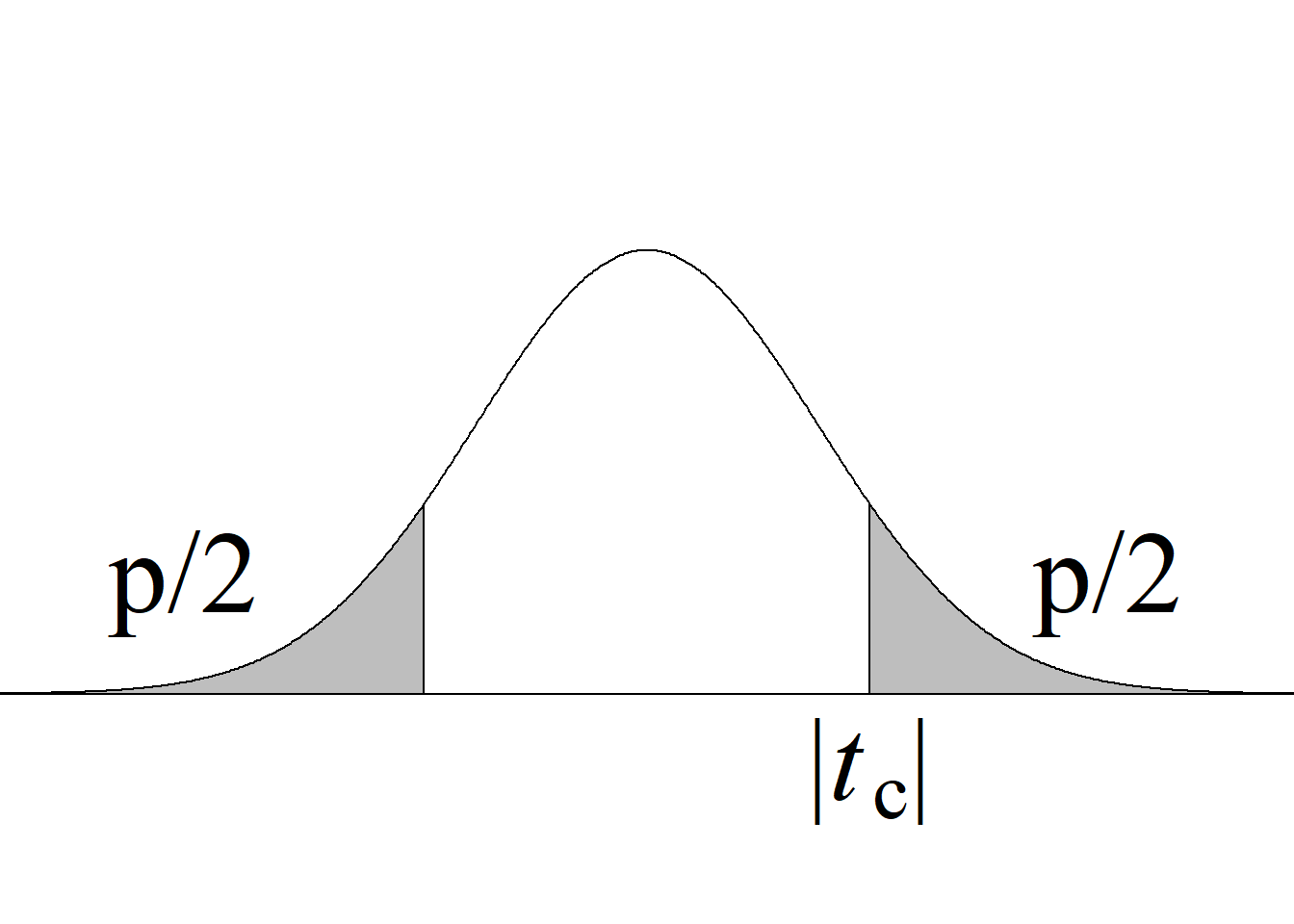

Puesto que, bajo la hipótesis nula, el estadístico de prueba sigue una distribución \(t,\) a la prueba basada en este estadístico se le conoce como prueba de \(t.\) La tabla 5.3 y la figura 5.6 resumen los criterios de rechazo para diferentes tipos de pruebas.

| Tipo de prueba | Criterio de rechazo de \(H_0\) para un nivel de significancia \(\alpha\) | Valor p |

|---|---|---|

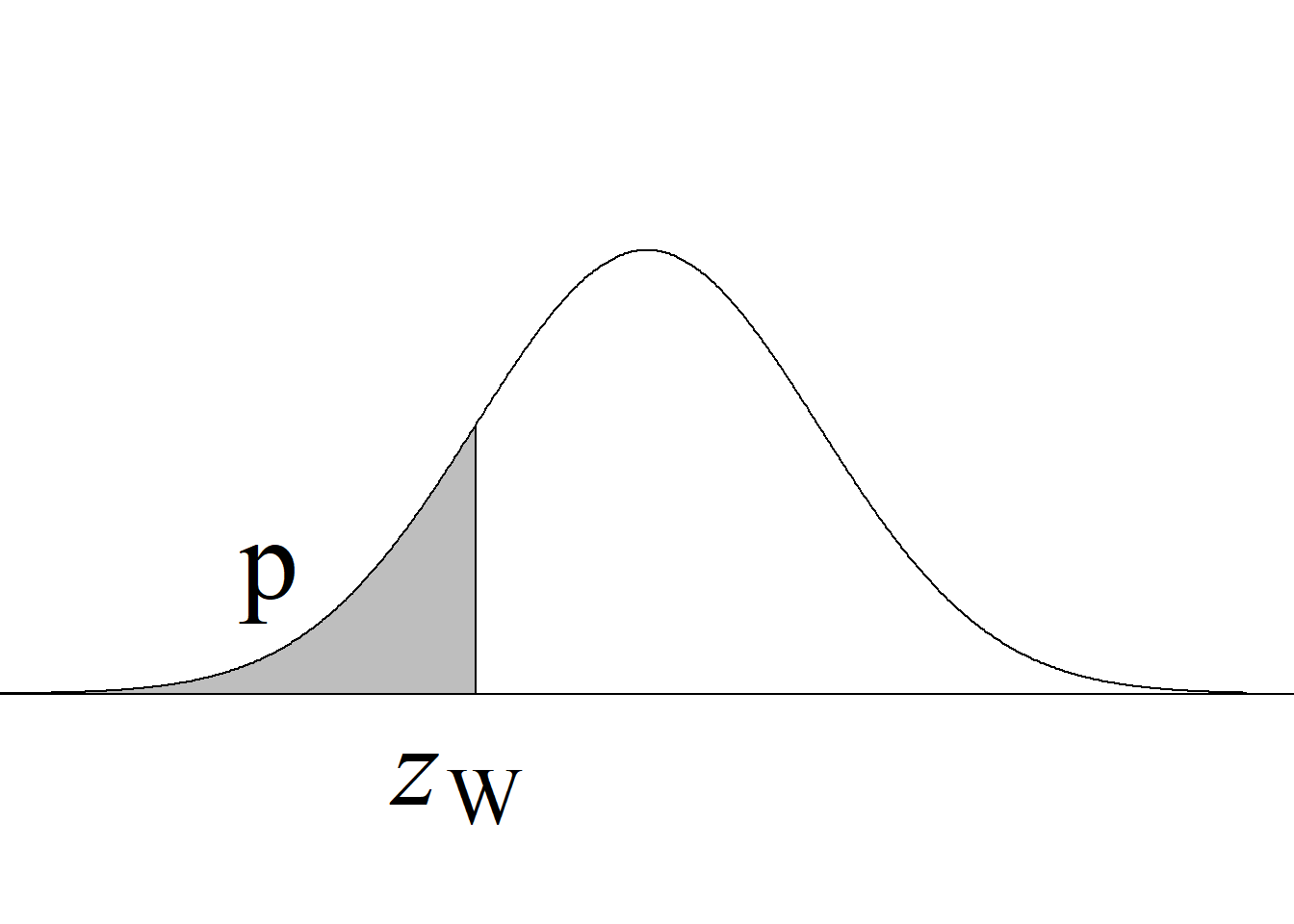

| Cola izquierda \(H_0:\mu_1\ge\mu_2\) \(H_a:\mu_1<\mu_2\) |

\(t_\text{c}\le−t_{\alpha(n_1+n_2-2)}\) |

\(P(t_{(n_1+n_2-2)} < t_\text{c})\) |

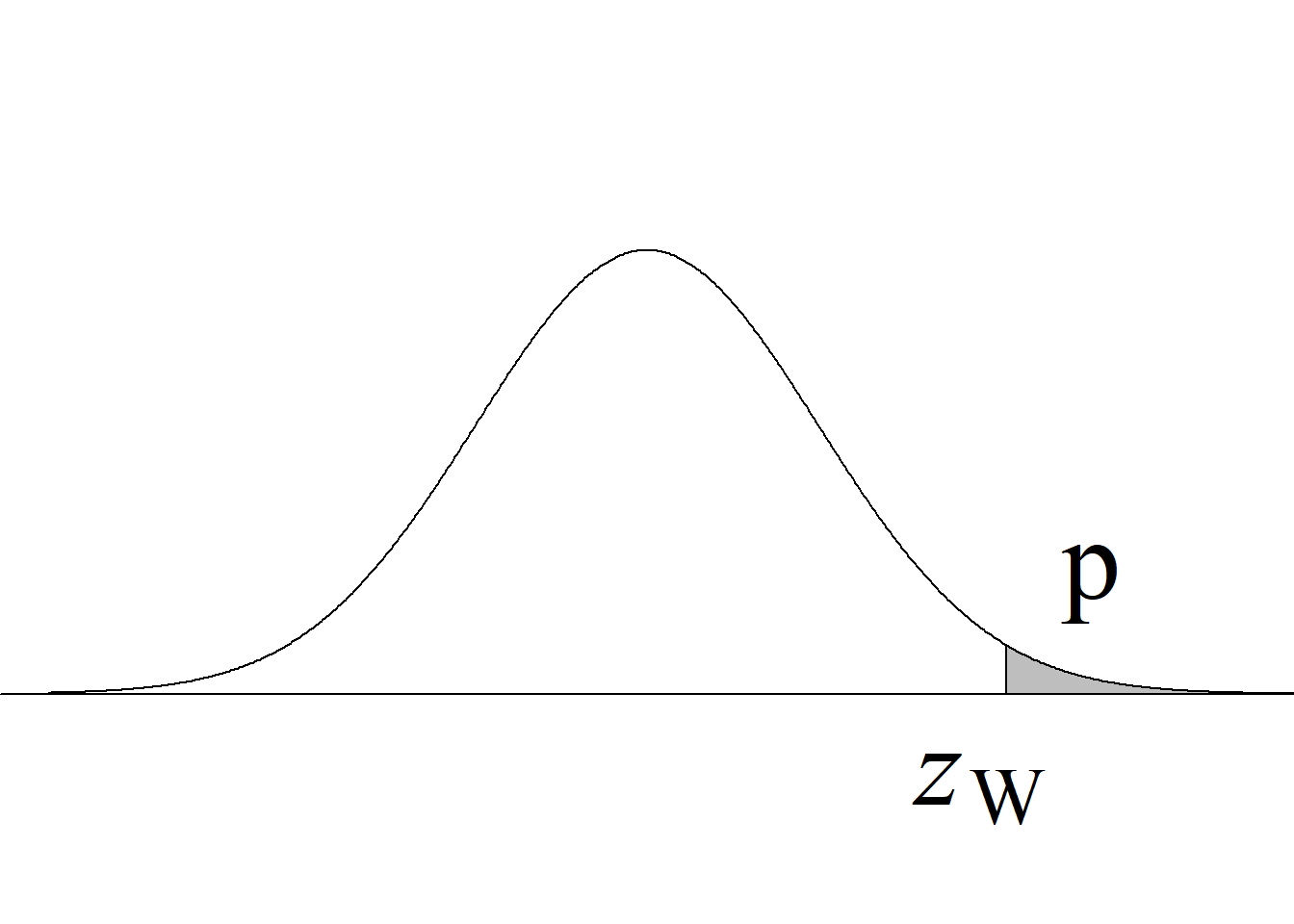

| Cola derecha \(H_0:\mu_1\le\mu_2\) \(H_a:\mu_1>\mu_2\) |

\(t_\text{c}\ge t_{\alpha(n_1+n_2-2)}\) |

\(P(t_{(n_1+n_2-2)} > t_\text{c})\) |

| Dos colas \(H_0:\mu_1=\mu_2\) \(H_a:\mu_1\ne\mu_2\) |

\(|t_\text{c}|\ge t_{\alpha/2(n_1+n_2-2)}\) |

\(2 \, P(t_{(n_1+n_2-2)} > |t_\text{c}|)\) |

5.2.1.2 Intervalo de confianza para la diferencia de dos medias normales, usando muestras independientes, con varianzas homogéneas

El juego de hipótesis para comparar dos medias puede escribirse en términos de la diferencia entre tales medias:

\[

H_0:\mu_1-\mu_2=0

\] \[

H_a:\mu_1-\mu_2\ne0

\]

Consecuentemente, se construye un intervalo de confianza para la diferencia de las medias poblacionales como contraparte del juego de hipótesis para la comparación de medias.

Un intervalo de confianza del \(100(1−\alpha)\,\%\) para la diferencia de dos medias, \(\mu_1 − \mu_2,\) usando muestras independientes, cuando las varianzas poblacionales son homogéneas, está dado por:

\[

\left(\overline{X}_1-\overline{X}_2\right)\pm t_{\alpha/2\left(n_1+n_2-2\right)}

\sqrt{S_\text{p}^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}

\tag{5.6}\]

Interpretación general

Si \(\text{LI}\) y \(\text{LS}\) representan, respectivamente, los límites inferior y superior de un intervalo de confianza del \(100(1−\alpha)\,\%\) para la diferencia \(\mu_1 − \mu_2,\) se tiene una confianza del \(100(1−\alpha)\,\%\) en que la diferencia \(\mu_1 − \mu_2\) está contenida entre \(\text{LI}\) y \(\text{LS}.\)

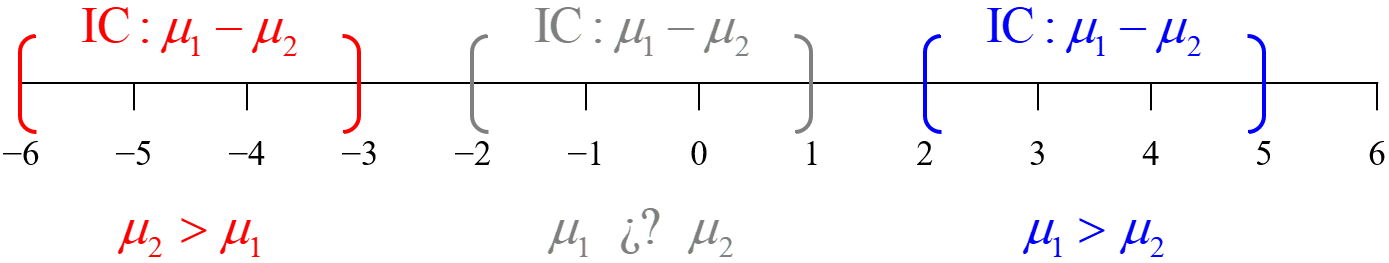

¿¡Y si ambos límites son positivos!?

Un intervalo de confianza para \(\mu_1 − \mu_2\) en el que ambos límites sean positivos es el reflejo de que \(\mu_1\) supera significativamente a \(\mu_2.\) Se tendrá una confianza del \(100(1−\alpha)\,\%\) en que \(\mu_1\) supera a \(\mu_2\) en una cantidad que está entre \(\text{LI}\) y \(\text{LS}\) (cf. figura 5.7).

¿¡Y si ambos límites negativos!?

Un intervalo de confianza para \(\mu_1 − \mu_2\) en el que ambos límites sean negativos es el reflejo de que \(\mu_2\) supera significativamente a \(\mu_1.\) Se tendrá una confianza del \(100(1−\alpha)\,\%\) en que \(\mu_2\) supera a \(\mu_1\) en una cantidad que está entre \(-\text{LS}\) y \(-\text{LI}\) (cf. figura 5.7).

¿¡Y si el límite inferior es negativo y el superior positivo!?

Un intervalo de confianza para \(\mu_1 − \mu_2\) en el que el límite inferior sea negativo y el superior positivo, es decir, que contenga el cero, indica que no hay diferencia estadísticamente significativa entre \(\mu_1\) y \(\mu_2,\) esto es, que la diferencia entre tales parámetros podría ser cero (cf. figura 5.7).

Un intervalo de confianza del \(100(1−\alpha)\,\%\) para \(\mu_1 − \mu_2\), obtenido con base en una muestra particular, brinda la misma información que un intervalo de confianza del \(100(1−\alpha)\,\%\) para \(\mu_2 − \mu_1\), construido con base en esa misma muestra.

En efecto, el límite inferior de uno de los intervalos es el opuesto del límite superior del otro intervalo, es decir, el mismo valor con signo contrario, tal y como lo ilustra la figura 5.8.

No obstante lo anterior, es necesario tener presente a cuál diferencia de medias corresponde un intervalo dado, pues de ello depende su correcta interpretación.

Ejemplo 5.2

Para evaluar el efecto del pH en la síntesis de polihidroxialcanoatos (PHA) por parte de Bacillus megaterium, con glicerol residual como sustrato, a una concentración de 15 g/L y una temperatura de 25 \(^{\circ}\text{C},\) se realizaron 30 ensayos independientes; 15 de ellos a un pH de 7.0 y otros 15 a un pH de 8.0. Los resultados se presentan en la tabla 5.4.

| pH 7.0 | 2.71 | 4.18 | 3.32 | 4.09 | 2.37 | 1.59 | 2.90 | 2.32 | 1.10 | 1.70 | 2.30 | 2.27 | 4.40 | 2.09 | 2.38 |

| pH 8.0 | 0.59 | 2.60 | 0.15 | 1.64 | 1.60 | 2.67 | 1.83 | 0.17 | 1.41 | 2.75 | 2.00 | 2.36 | 2.06 | 3.53 | 2.89 |

Se usa un nivel de significancia del 5 % para evaluar si el contenido medio de PHA se ve afectado por el pH.

Para tal efecto, se plantea el siguiente juego de hipótesis:

\[

H_0: \mu_{\text{pH}7.0}=\mu_{\text{pH}8.0}

\] \[

H_a: \mu_{\text{pH}7.0}\ne\mu_{\text{pH}8.0}

\]

A continuación, se presentan los estadísticos básicos de cada muestra:

| pH 7.0: \(n=15,\quad\overline{X}=2.648,\quad S^2=0.947\) |

| pH 8.0: \(n=15,\quad\overline{X}=1.889,\quad S^2=1.001\) |

Usando la expresión 5.3, se calcula la varianza combinada:

\[

S_\text{p}^2=\frac{(n_1-1)S_1^2+(n_2-1)S_2^2}{n_1+n_2-2}

=\frac{14\times 0.947+14\times 1.001}{15+15-2}=0.974

\]

Cuando se tienen muestras de igual tamaño, cada varianza recibe la misma ponderación; en consecuencia, la varianza combinada coincide con el promedio aritmético de las varianzas.

Seguidamente, se calcula el estadístico de prueba, usando la expresión 5.5:

\[

t_\text{c}=\frac{\overline{X}_1-\overline{X}_2}

{\sqrt{S_\text{p}^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}}

=\frac{2.648-1.889}

{\sqrt{0.974\left(\frac{1}{15}+\frac{1}{15}\right)}}=2.106

\]

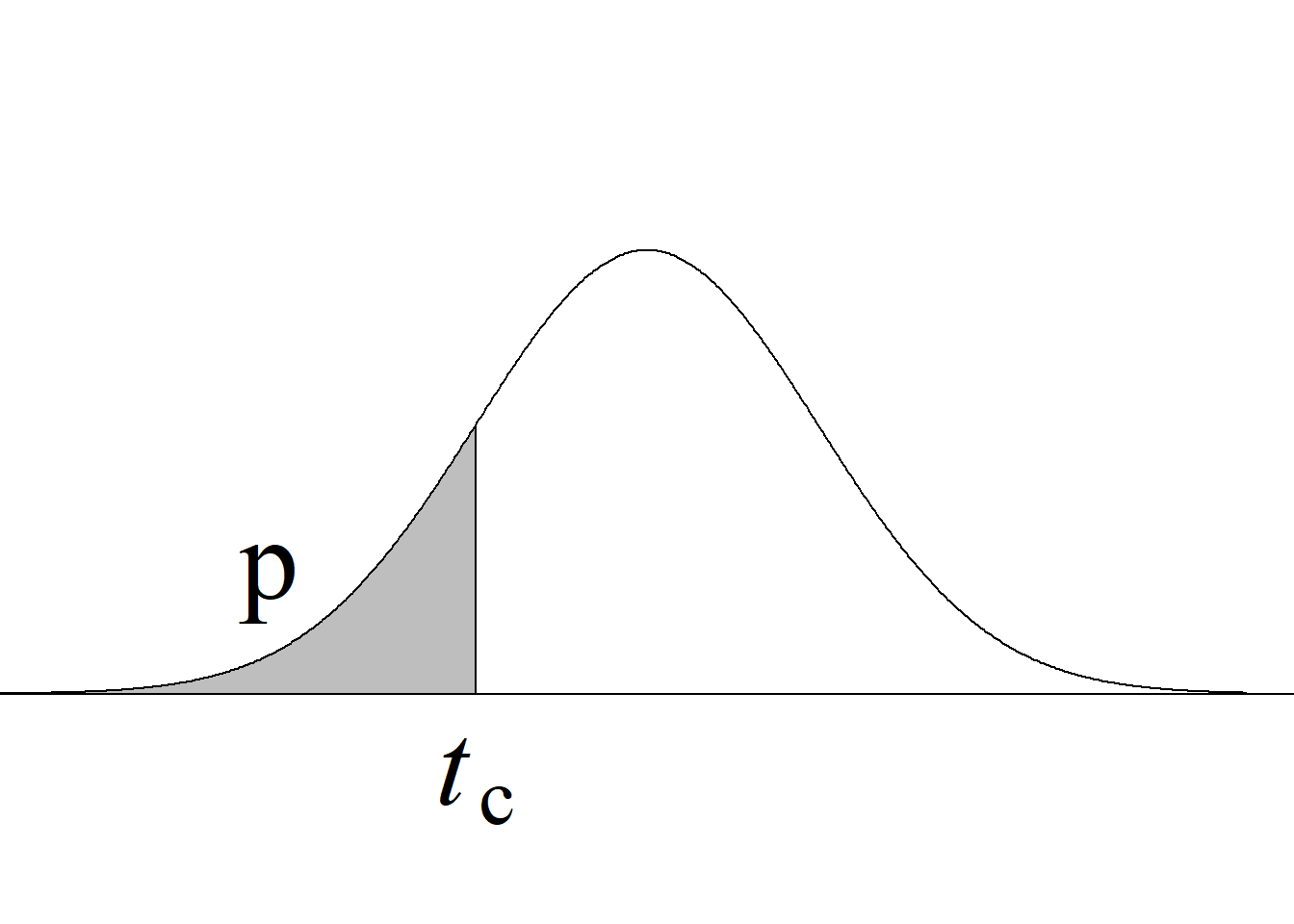

Bajo la hipótesis nula, el estadístico de prueba sigue una distribución \(t\) con 28 gl. Dado que se está evaluando un juego de hipótesis de dos colas, el valor absoluto del estadístico de prueba se compara con el valor crítico superior 0.025 de la distribución \(t\) con 28 gl (cf. tabla 5.3 y figura 5.6 (c)).

qt(0.025, 28, lower.tail = F)[1] 2.048407| \(\,\) Puesto que \(\hspace{-1.5em}\) |

\(|t_\text{c}|\) \(2.106\) |

\(>\) \(>\) |

\(t_{0.025(28)}\) \(2.048\) |

\(\,\) \(\hspace{-1.5em}\Rightarrow\) se rechaza \(H_0\) con \(α = 0.05\) |

Por tanto, puede afirmarse, con una probabilidad máxima de error de 0.05, que la producción media de PHA difiere entre las dos condiciones evaluadas de pH.

Aunque la prueba sea no direccional, puede saberse con cuál de los dos pH se espera una mayor síntesis media de PHA. Para tal efecto, basta con observar las medias muestrales.

En este caso, la media muestral de PHA correspondiente al pH 7.0 es mayor que la correspondiente al pH 8.0. Por lo tanto, puede precisarse que cuando el bioproceso se realiza a pH 7.0 se espera una mayor producción media de PHA que a pH 8.0.

La figura 5.9 muestra los elementos que participan en el contraste, representados en la distribución que sigue el estadístico de prueba bajo la hipótesis nula: \(t\) con 28 gl.

Al tratarse de una prueba de dos colas, la región de rechazo está conformada por los valores que dejan áreas de \(\alpha/2\) en cada una de las colas de la distribución, es decir, los valores menores que −2.048 y los mayores que 2.048. Las correspondientes áreas, que suman 0.05, aparecen sombreadas en color naranja.

Sin importar el orden en el que se tome la diferencia de las medias muestrales para el cálculo del estadístico de prueba, su valor absoluto se ubicará en la región de rechazo. Este orden tampoco afecta el cálculo del valor p, el cual se obtiene con base en la correspondiente expresión para pruebas de dos colas que se presenta en la tabla 5.3. Se usan líneas oblicuas de color vinotinto para representar la correspondiente semiárea.

Puesto que el criterio de rechazo para una prueba de dos colas consiste en rechazar la hipótesis nula si \(|t_\text{c}|\ge t_{\alpha/2(n_1+n_2-2)},\) la conclusión será la misma, sin importar cuál de las medias muestrales actúe como minuendo y cuál otra como sustraendo en el numerador de la expresión 5.5.

Si para calcular el estadístico de prueba del ejemplo 5.2 se hubiera tomado \(\overline{X}_2-\overline{X}_1,\) en lugar de \(\overline{X}_1-\overline{X}_2,\) se habría obtenido un estadístico de prueba con signo contrario, es decir, −2.106, con base en el cual se habría llegado a las mismas conclusiones, ya fuera usando el método tradicional o el valor p.

Esto, sin embargo, no se cumple para pruebas de una cola, en las que sí es necesario tomar las diferencias de las medias muestrales en el orden planteado en el juego de hipótesis.

La diferencia de las medias muestrales que aparece en el numerador del estadístico de prueba de la expresión 5.5 es el estimador de la diferencia de las medias poblacionales bajo la hipótesis nula, cuando el juego de hipótesis se escribe como diferencia de medias:

\[ 1.\quad H_0: \mu_1 - \mu_2 = 0,\, \text{se usa} \;\overline{X}_1-\overline{X}_2 \] \[ 2.\quad H_0: \mu_1 - \mu_2 \ge 0,\, \text{se usa} \;\overline{X}_1-\overline{X}_2 \]

\[ 3.\quad H_0: \mu_1 - \mu_2 \le 0,\, \text{se usa} \;\overline{X}_1-\overline{X}_2 \]

\[ 4.\quad H_0: \mu_2 - \mu_1 = 0,\, \text{se usa} \;\overline{X}_2-\overline{X}_1 \]

\[ 5.\quad H_0: \mu_2 - \mu_1 \ge 0,\, \text{se usa} \;\overline{X}_2-\overline{X}_1 \]

\[ 6.\quad H_0: \mu_2 - \mu_1 \le 0,\, \text{se usa} \;\overline{X}_2-\overline{X}_1 \]

Resulta evidente que solo los casos 1 y 4 —correspondientes a pruebas de dos colas— son equivalentes. En cualquiera de los otros casos, el orden en el que se calcule la diferencia de las medias muestrales debe reflejar el orden en el que se hipotetiza la diferencia entre las medias poblacionales.

Un intervalo de confianza del 95 % para la diferencia media en la producción de PHA, \(\mu_{\text{pH}7.0} − \mu_{\text{pH}8.0},\) se obtiene con base en la expresión 5.6:

\[

\left(2.648-1.889\right)\pm 2.048

\sqrt{0.974\left(\frac{1}{15}+\frac{1}{15}\right)}=

0.759\pm 0.738

\]

\[

\text{IC}_{\mu_{\text{pH}7.0} − \mu_{\text{pH}8.0}}:\quad[0.021,\;1.497]

\]

Con base en el anterior intervalo puede decirse que se tiene una confianza del 95 % en que la síntesis media de PHA por parte de Bacillus megaterium, usando glicerina residual como sustrato en una concentración de 15 g/L, a una temperatura de 25 \(^{\circ}\text{C},\) con un pH de 7.0, supera la síntesis media de PHA, cuando se trabaja a pH de 8.0 en una cantidad que está entre 0.021 y 1.497 mg/L.

5.2.1.3 Uso de R para realizar inferencia sobre la diferencia de dos medias normales, usando muestras independientes, con varianzas homogéneas

El siguiente script de R facilita la realización de los procedimientos inferenciales del ejemplo 5.2.

La primera línea importa la información de la tabla 5.4, la cual está contenida en el archivo ejemplo 5.2.xlsx.

Las líneas 2 y 3 realizan la prueba de Shapiro-Wilk para evaluar la normalidad de cada una de las dos muestras. Este es el resultado de la ejecución de la línea 2:

Shapiro-Wilk normality test

data: data$pH7.0

W = 0.92727, p-value = 0.2483Puesto que p = 0.2483, no se detectan desviaciones severas del supuesto de normalidad para la muestra pH7.0.

Y este es el resultado de la ejecución de la línea 3:

Shapiro-Wilk normality test

data: data$pH8.0

W = 0.94668, p-value = 0.4737Puesto que p = 0.4737, no se detectan desviaciones severas del supuesto de normalidad para la muestra pH8.0.

Para la parte central del contraste se utiliza la función t.test{stats} (línea 4). Entre los argumentos que esta función trae por defecto está que la diferencia de las dos medias es cero (mu = 0), que la confianza es 95 % (conf.level = 0.95) y que las varianzas son heterogéneas (var.equal = FALSE). Puesto que para el presente ejemplo se suponen varianzas homogéneas, es necesario indicarlo explícitamente (var.equal = TRUE).

Se obtiene el siguiente resultado:

Two Sample t-test

data: pH7.0 and pH8.0

t = 2.1053, df = 28, p-value = 0.04436

alternative hypothesis: true difference in means is not equal to 0

95 percent confidence interval:

0.02050979 1.49682355

sample estimates:

mean of x mean of y

2.648000 1.889333 En la función t.test, el valor del primer argumento se usa como minuendo de la diferencia de medias, mientras que el valor del segundo argumento se usa como sustraendo.

De acuerdo con lo indicado anteriormente, el orden en el que se introduzcan los argumentos no altera la decisión inferencial en pruebas de dos colas. No obstante, sí define cuál media actúa como minuendo y cuál como sustraendo en el intervalo de confianza.

Por otra parte, cuando se contrastan pruebas de una cola es esencial ingresar los dos primeros argumentos de la función t.test en correspondencia con el orden de la diferencia planteada.

5.2.2 Comparación de medias, usando muestras independientes, con varianzas heterogéneas (Prueba de Welch)

Considérense dos muestras aleatorias independientes, provenientes de sendas poblaciones normales9:

\(X_{11},X_{12},...,X_{1n_1}\: \text{iid}\: N\left(\mu_1, \sigma_1^2\right)\quad\) y \(\quad X_{21},X_{22},...,X_{2n_2}\: \text{iid}\: N\left(\mu_2, \sigma_2^2\right)\)

La media de cada una de estas muestras —que es una combinación lineal de variables aleatorias normales— tiene a su vez distribución normal.

\[

\overline{X}_1\thicksim N\left(\mu_1,\;\sigma_1^2/n_1\right)

\]

\[

\overline{X}_2\thicksim N\left(\mu_2,\;\sigma_2^2/n_2\right)

\]

La diferencia de estas medias también es una variable aleatoria normal:

\[

\left(\overline{X}_1-\overline{X}_2\right)\thicksim N\left(\mu_1-\mu_2,\;\frac{\sigma_1^2}{n_1}+\frac{\sigma_2^2}{n_2}\right)

\]

Estandarizando:

\[

\frac{\Big(\overline{X}_1-\overline{X}_2\Big)-\Big(\mu_1-\mu_2\Big)}

{\sqrt{\frac{\sigma_1^2}{n_1}+\frac{\sigma_2^2}{n_2}}} \thicksim N\left(0,\;1\right)

\]

Se busca un estadístico de prueba que permita contrastar el siguiente juego de hipótesis:

\[

H_0:\mu_1=\mu_2\Leftrightarrow \mu_1-\mu_2=0

\]

\[

H_a:\mu_1\ne\mu_2\Leftrightarrow \mu_1-\mu_2\ne0

\]

Cuando la hipótesis nula es cierta, la variable aleatoria anterior adquiere la siguiente forma:

\[

\frac{\overline{X}_1-\overline{X}_2}

{\sqrt{\frac{\sigma_1^2}{n_1}+\frac{\sigma_2^2}{n_2}}} \thicksim N\left(0,\;1\right)

\]

En la sección 5.2.1.1 se mostró que si las varianzas fueran iguales \(\left(\sigma_1^2=\sigma_2^2=\sigma^2\right),\) sería pertinente estimar \(\sigma^2\) combinando las varianzas muestrales (cf. expresión 5.3). No obstante, cuando las varianzas son heterogéneas \(\left(\sigma_1^2\ne\sigma_2^2\right)\) —al no existir una varianza común, \(\sigma^2\)— esta estimación deja de ser aplicable.

Behrens fue el primero en proponer, en 1929, una prueba para comparar las medias de dos poblaciones normales con varianzas heterogéneas. En 1935, Fisher reenfocó este problema en el marco teórico de las distribuciones fiduciales, desarrollando una solución que coincidía con la de Behrens.

En honor a estos dos autores, al problema que surge cuando se comparan medias de dos poblaciones normales con varianzas heterogéneas se le conoce como problema de Behrens-Fisher.

Puesto que en este caso no sería pertinente estimar una varianza común, \(\sigma^2,\) cada una de las varianzas poblacionales se estima mediante su mejor estimador insesgado (cf. sección 3.9.1.1.2), dando lugar a la siguiente expresión:

\[

\frac{\overline{X}_1-\overline{X}_2}

{\sqrt{\frac{S_1^2}{n_1}+\frac{S_2^2}{n_2}}}

\]

Welch (1938) demostró que este estadístico sigue una distribución aproximadamente \(t\) con \(\nu\) gl, siendo \(\nu\) un parámetro desconocido que se estima mediante la fórmula de los grados de libertad efectivos, la cual también fue deducida en otro contexto por Satterthwaite (1946), por lo que se le conoce como la aproximación de Welch-Satterthwaite.

El estadístico de la prueba de Welch se expresa así:

\[

t_\text{c} = \frac{\Big(\overline{X}_1-\overline{X}_2\Big)}

{\sqrt{\frac{S_1^2}{n_1}+\frac{S_2^2}{n_2}}} \overset{H_0}{\overset{\cdot}{\thicksim}} t_{(\nu)}

\tag{5.7}\]

Donde \(\nu\) se estima mediante la aproximación de Welch-Satterthwaite, así10:

\[

\widehat\nu=\dfrac{\left(\dfrac{S_1^2}{n_1}+\dfrac{S_2^2}{n_2}\right)^2}

{\dfrac{\left(\dfrac{S_1^2}{n_1}\right)^2}{n_1-1}+\dfrac{\left(\dfrac{S_2^2}{n_2}\right)^2}{n_2-1} }

\tag{5.8}\]

Al contraste de hipótesis basado en la expresión 5.7 se le conoce como prueba de Welch.

En los textos clásicos era común denotar el estadístico de prueba de la expresión 5.7 como \(T_\text{c}\) o \(t’_\text{c}\;\), para distinguirlo del estadístico de prueba de la expresión 5.5 que se utiliza en la prueba estándar de \(t.\)

En la actualidad, la tendencia consiste en simplificar la notación, usando \(t_\text{c}\) (o simplemente \(t\)) para cualquiera de estos estadísticos de prueba, enfatizando la metodología en el contexto de la prueba.

Puesto que los grados de libertad efectivos usualmente tienen una parte decimal, una práctica común ha sido redondearlos al entero inferior (función piso o parte entera), con lo cual, a la vez que se resuelve el problema de llevar los grados de libertad a un valor obtenible en tablas, se le “ayuda” un poco a la prueba, disminuyendo la probabilidad de error tipo I.

En la actualidad no hay ninguna razón para ello, puesto que existen muchas aplicaciones informáticas, v. gr., R, que permiten obtener los valores críticos de una distribución \(t\) con grados de libertad no enteros.

Por otra parte, debe tenerse en cuenta que, si bien el redondeo al entero inferior disminuye la tasa de error tipo I, también disminuye la potencia de la prueba.

El hecho de que una prueba esté basada en una distribución aproximada no la hace peor que una prueba análoga basada en una distribución exacta.

Así, por ejemplo, al comparar diferentes pruebas para inferir sobre una proporción binomial, se ha encontrado que “aproximado es mejor que exacto”, tal y como lo destacan Agresti y Coull (1998) (cf. sección 4.4.2).

En el mismo sentido, las diferentes pruebas y estrategias destinadas a inferir sobre la diferencia de medias de dos poblaciones normales deben someterse a evaluación bajo diferentes condiciones, mediante ensayos de simulación.

Producto de tales evaluaciones, Zimmerman (2004) y Delacre et al. (2017) coinciden en señalar que, en la mayoría de casos, el uso directo de la prueba de Welch, es decir, sin que esté condicionado al resultado de una prueba de homogeneidad de varianzas, da lugar a tasas de error más cercanas a la nominal y mayores potencias (cf. sección 5.2).

En consecuencia, se recomienda usar siempre la prueba de Welch para inferir sobre la diferencia de medias de dos poblaciones normales.

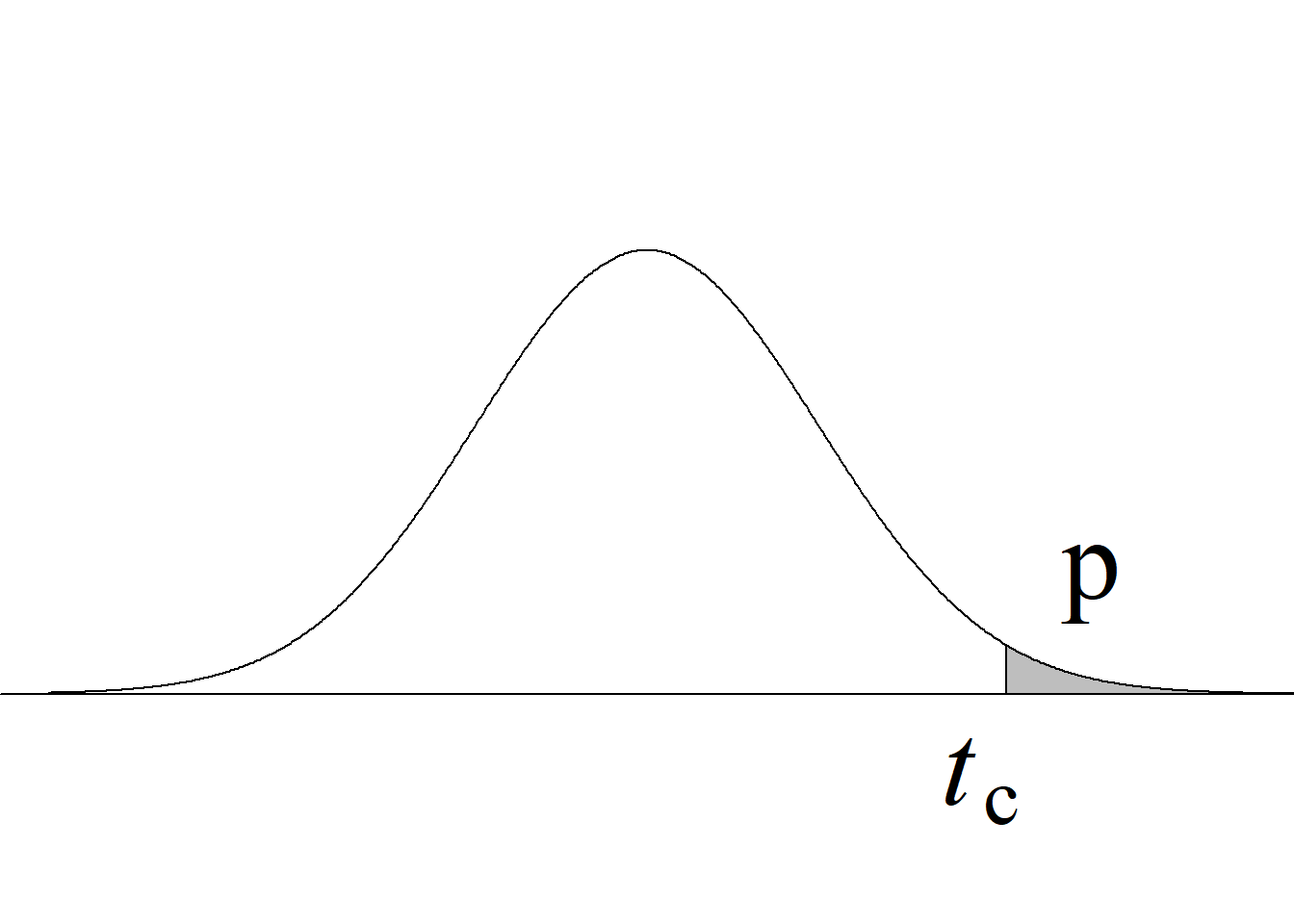

La tabla 5.5 y la figura 5.10 resumen los criterios de rechazo para diferentes tipos de pruebas.

| Tipo de prueba | Criterio de rechazo de \(H_0\) para un nivel de significancia \(\alpha\) | Valor p |

|---|---|---|

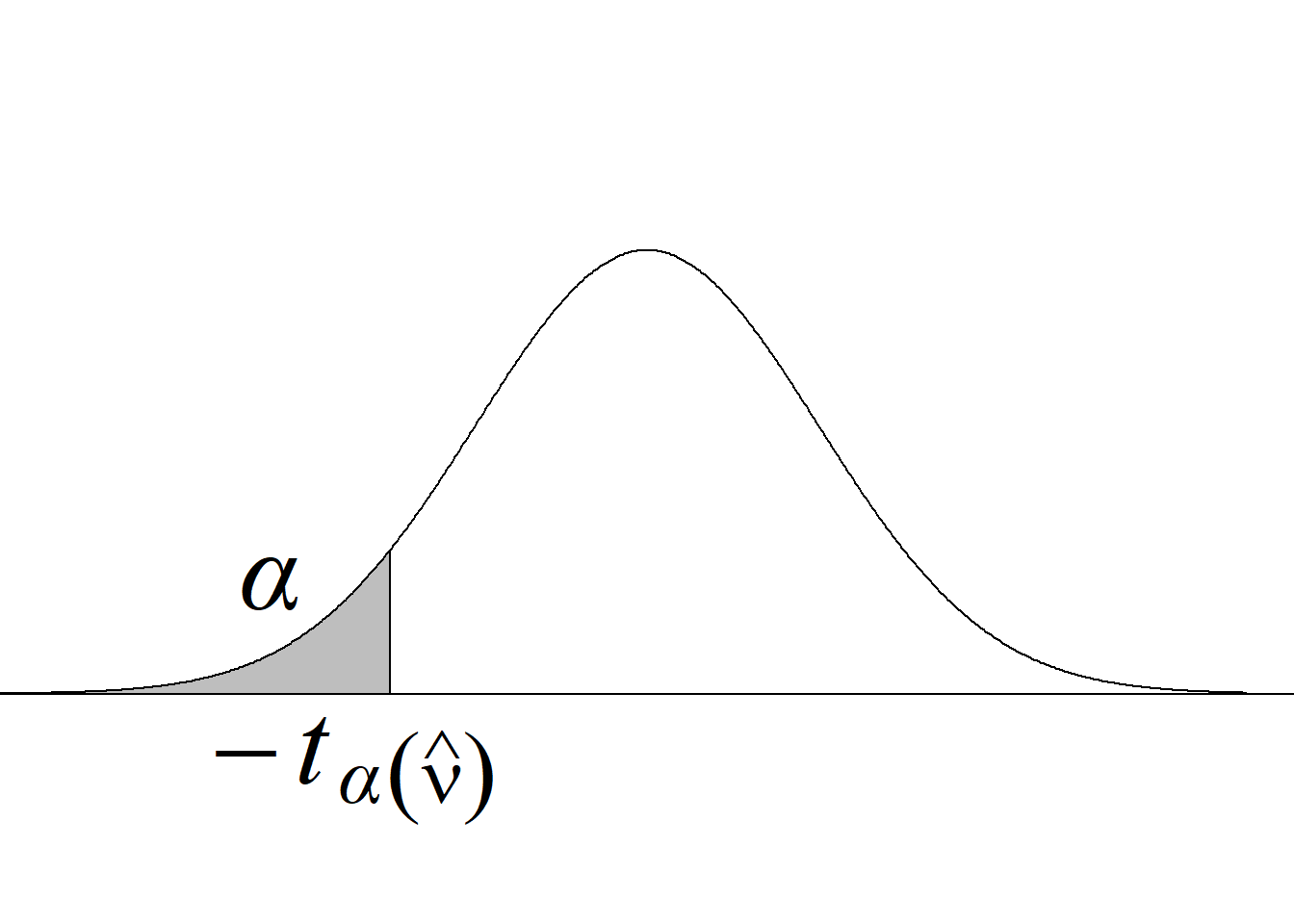

| Cola izquierda \(H_0:\mu_1\ge\mu_2\) \(H_a:\mu_1<\mu_2\) |

\(t_\text{c}\le−t -{\alpha(\widehat\nu)}\) |

\(P(t_{(\widehat\nu)} < t_\text{c})\) |

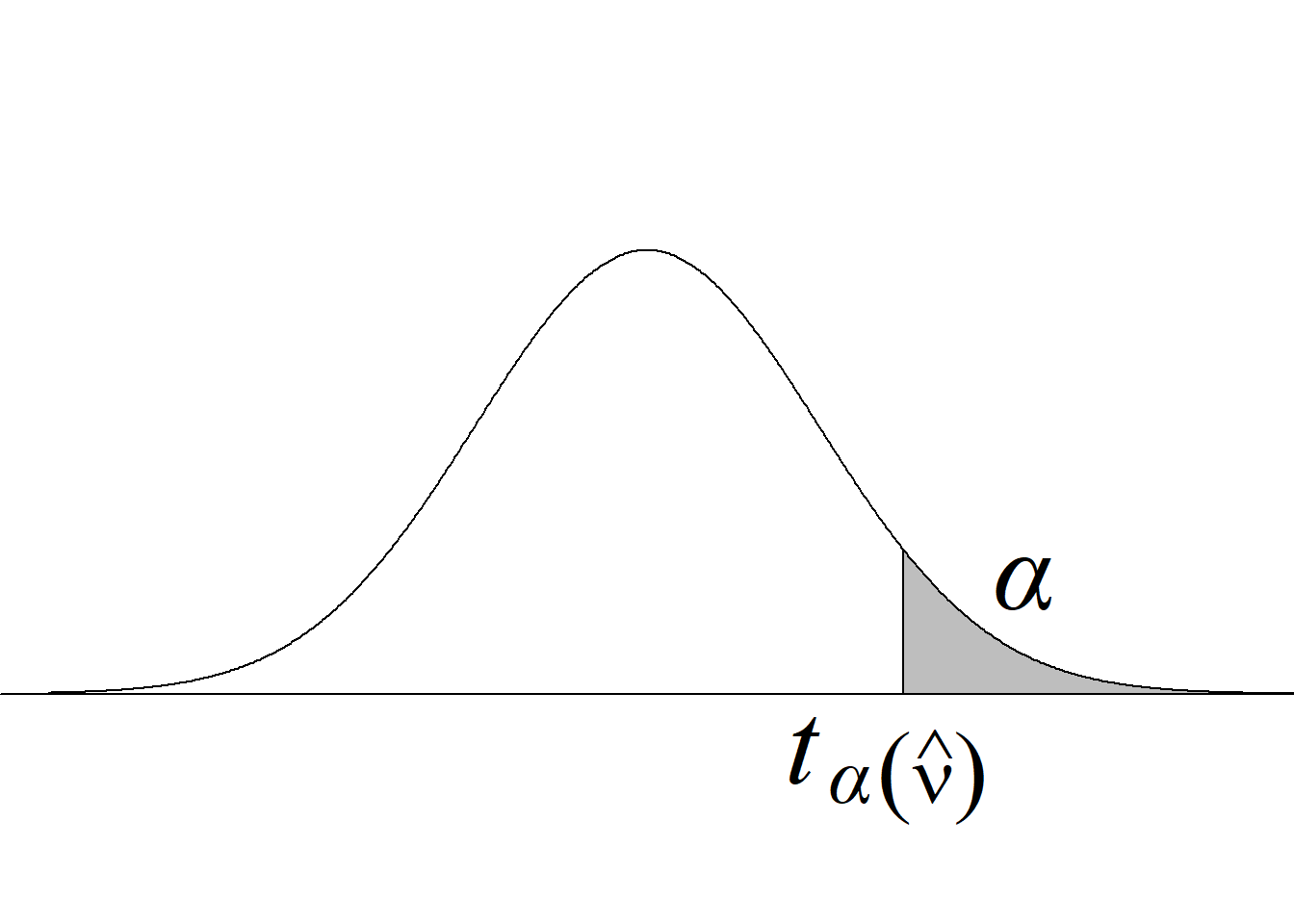

| Cola derecha \(H_0:\mu_1\le\mu_2\) \(H_a:\mu_1>\mu_2\) |

\(t_\text{c}\ge t_{\alpha(\widehat\nu)}\) |

\(P(t_{(\widehat\nu)} > t_\text{c})\) |

| Dos colas \(H_0:\mu_1=\mu_2\) \(H_a:\mu_1\ne\mu_2\) |

\(|t_\text{c}|\ge t_{\alpha/2(\widehat\nu)}\) |

\(2 \, P(t_{(\widehat\nu)} > |t_\text{c}|)\) |

5.2.2.1 Intervalo de confianza para la diferencia de dos medias normales, usando muestras independientes, con varianzas heterogéneas

Un intervalo de confianza del \(100(1−\alpha)\,\%\) para la diferencia de dos medias, \(\mu_1 − \mu_2,\) basado en la prueba de Welch, está dado por la siguiente expresión:

\[

\Big(\overline{X}_1-\overline{X}_2\Big)

\pm t_{\alpha/2(\widehat\nu)} \sqrt{\frac{S_1^2}{n_1}+\frac{S_2^2}{n_2}}

\tag{5.9}\]

Ejemplo 5.3

Se realiza una investigación para evaluar las posibles causas de un síndrome detectado en abejas angelita (Tetragonisca angustula). Se cree que las colonias ubicadas en bosque húmedo tropical (bh-T) podrían tener un mayor riesgo que las ubicadas en bosque húmedo premontano (bh-PM).

Se ubican 10 colonias en bh-T y 8 en bh-PM; en cada una de ellas, se realiza un registro visual durante 30 minutos contabilizando los individuos que manifiestan el síndrome.

Los resultados se presentan en la tabla 5.6.

| bh-T | 15 | 17 | 8 | 11 | 10 | 11 | 5 | 12 | 14 | 11 |

| bh-PM | 6 | 11 | 13 | 6 | 8 | 9 | 7 | 10 |

Para probar si las colonias ubicadas en bh-T tienen un mayor riesgo que las ubicadas en bh-PM, se plantea el siguiente juego de hipótesis.

\[

H_0: \mu_{\text{bh-T}}\le \mu_{\text{bh-PM}}

\] \[

H_a: \mu_{\text{bh-T}} > \mu_{\text{bh-PM}}

\]

Existen dos formas equivalentes de plantear un juego de hipótesis unilateral para la comparación de dos parámetros; una de ellas da lugar a una prueba de cola izquierda, mientras que la otra corresponde a una prueba de cola derecha.

El juego de hipótesis planteado anteriormente —que da lugar a una prueba de cola derecha— equivale al siguiente juego de hipótesis de cola izquierda:

\[

H_0: \mu_{\text{bh-PM}}\ge \mu_{\text{bh-T}}

\] \[H_a: \mu_{\text{bh-PM}} < \mu_{\text{bh-T}}\]

Ambos planteamientos corresponden a la misma pregunta y conducen exactamente al mismo resultado11.

Esto no debe confundirse, sin embargo, con lo ilustrado en el ejemplo 4.4, donde lo que se plantea no es la misma pregunta desde lados opuestos, sino que se considera la posibilidad de formular una pregunta diferente, dando lugar a una prueba en la que los tipos de error y el control que se ejerce sobre los mismos quedan definidos de distinta manera.

A primera vista puede parecer extraño usar el conteo de individuos como insumo en una prueba de comparación de medias de dos poblaciones normales.

Aunque el modelo exacto para la variable aleatoria que representa el número de individuos con el síndrome es el Poisson12, la normal brinda una buena aproximación cuando \(\lambda \ge 7\) (Correa-Londoño y Castillo-Morales, 2000).

Vale la pena llamar la atención sobre el uso de submuestreo cuando el registro de la información muestral es complejo y/o costoso. En la sección 6.1.7.1 se aborda nuevamente este tópico.

En el presente ejemplo, la muestra correspondiente a la población bh-T consta de 10 colonias, y la correspondiente a la población bh-PM, de 8. La lectura real de cada unidad muestral sería el número de abejas afectadas por el síndrome en cada una de las colonias. Puesto que dicha lectura implicaría la destrucción de las colonias, puede encontrarse conveniente muestrear cada unidad muestral, esto es, hacer un submuestreo.

El objetivo del submuestreo es obtener, a partir de un menor número de lecturas, una estimación del valor de la variable en la unidad muestral. Aunque el objetivo es claro, la estrategia dependerá de las características del ensayo y de la muestra.

En general, si la característica de interés se manifiesta homogéneamente sobre la unidad muestral, podrá usarse una submuestra de menor tamaño que si esta se manifiesta de forma heterogénea. Cada ensayo tiene particularidades que el investigador deberá resolver acorde con su experiencia y buen tino.

Así, en el ejemplo planteado, el investigador tendrá que resolver si la observación en el exterior de la colmena sí brinda una adecuada estimación de su estado interno. Tendrá que considerar, por ejemplo, si el síndrome que se está estudiando puede afectar la movilidad o la disposición de las abejas para salir al exterior, lo cual, de ser así, sesgaría los resultados, dando lugar a una subestimación del número de individuos con el síndrome. Tendrá que considerar asimismo cuál es la hora más adecuada para realizar las observaciones y cuál lapso de tiempo puede proporcionar una mejor estimación.

Para contrastar el juego de hipótesis planteado, se calculan los grados de libertad efectivos y el estadístico de prueba, a partir de las expresiones 5.8 y 5.7, respectivamente.

\[ \widehat\nu=\frac{\left(\frac{S_1^2}{n_1}+\frac{S_2^2}{n_2}\right)^2} {\frac{\left(\frac{S_1^2}{n_1}\right)^2}{n_1-1}+\frac{\left(\frac{S_2^2}{n_2}\right)^2}{n_2-1}} =\frac{\left(\frac{11.82}{10}+\frac{6.21}{8}\right)^2} {\frac{\left(\frac{11.82}{10}\right)^2}{10-1}+\frac{\left(\frac{6.21}{8}\right)^2}{8-1}} =15.89 \]

\[ t_\text{c} = \frac{\overline{X}_1-\overline{X}_2} {\sqrt{\frac{S_1^2}{n_1}+\frac{S_2^2}{n_2}}} =\frac{11.4-8.75} {\sqrt{\frac{11.82}{10}+\frac{6.21}{8}}} =1.893 \]

La región de rechazo para el juego de hipótesis planteado (de cola derecha) está constituida por los valores mayores o iguales que \(t_{0.05(15.89)}\) (cf. tabla 5.5 y figura 5.10 (b)). El valor crítico superior se obtiene en R mediante la siguiente instrucción:

qt(0.05, 15.89, lower.tail = F)[1] 1.746625| \(\,\) Puesto que \(\hspace{-1.5em}\) |

\(t_\text{c}\) \(1.893\) |

\(>\) \(>\) |

\(t_{0.05(15.89)}\) \(1.747\) |

\(\,\) \(\hspace{-1.5em}\Rightarrow\) se rechaza \(H_0\) con \(α = 0.05\) |

Puede afirmarse, con una probabilidad máxima de error de 0.05, que la afectación media por el síndrome es superior en bh-T que en bh-PM.

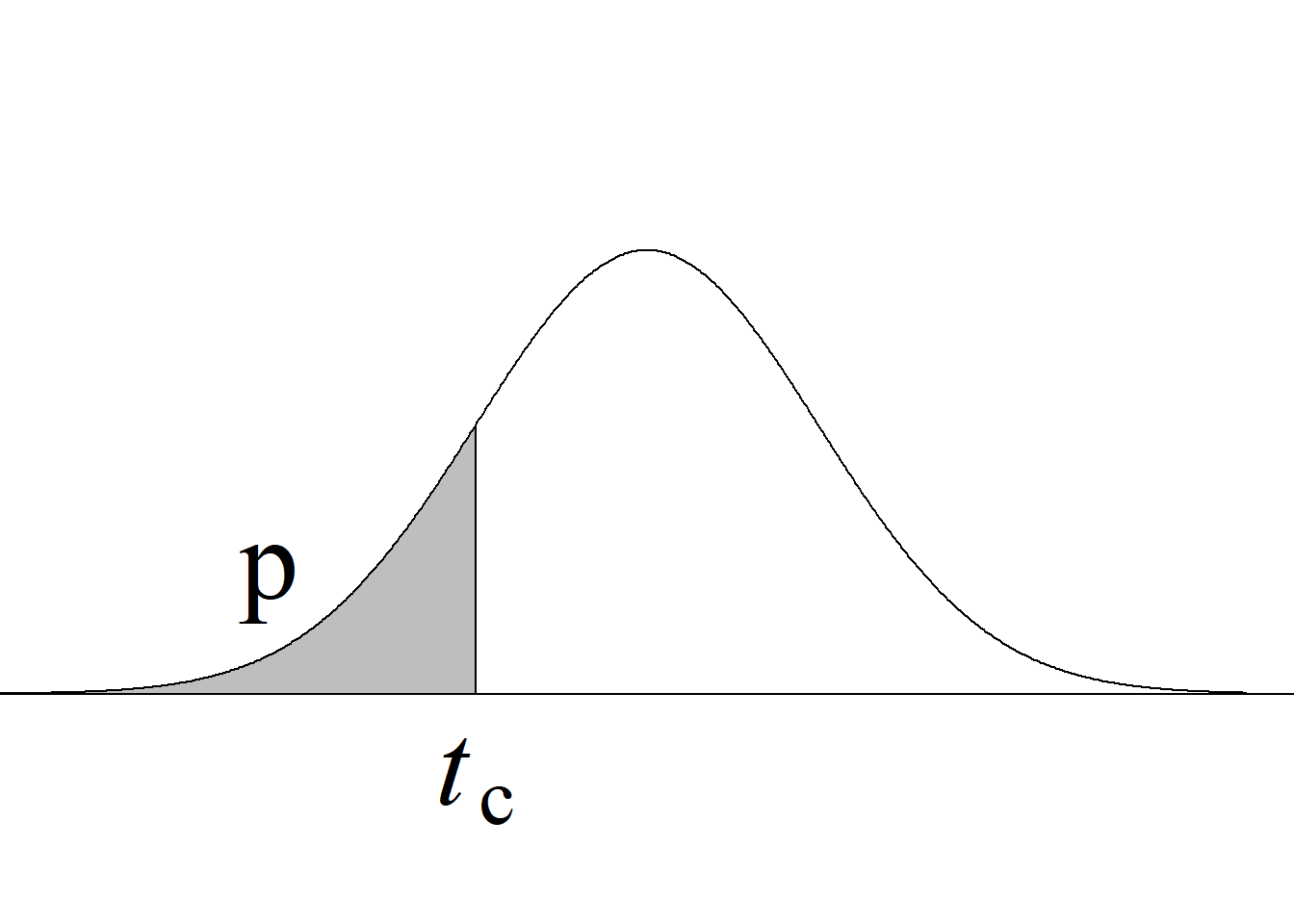

El valor p se obtiene como el área a la derecha del estadístico de prueba (cf. tabla 5.5 y figura 5.10 (e)):

pt(1.893, 15.89, lower.tail = FALSE)[1] 0.03835871| \(\,\) Puesto que \(\hspace{-1.5em}\) |

\(\text{p}\) \(0.038\) |

\(<\) \(<\) |

\(\alpha\) \(0.05\) |

\(\,\) \(\hspace{-1.5em}\Rightarrow\) se rechaza \(H_0\) |

La probabilidad de obtener, bajo la hipótesis nula, resultados muestrales iguales o más extremos que los actuales es 0.038. Por tanto, se rechaza la hipótesis nula y se concluye que la afectación media por el síndrome es mayor en bh-T que en bh-PM.

El estimador puntual de la diferencia está dado por la diferencia entre las correspondientes medias muestrales, así:

\[

\overline{X}_{\text{bh-T}}-\overline{X}_{\text{bh-PM}}=11.4-8.75=2.65

\]

Asimismo, puede obtenerse un intervalo de confianza unilateral inferior del 95 %, para la diferencia \(\mu_{\text{bh-T}} - \mu_{\text{bh-PM}},\) adaptando expresión 5.9:

\[

\begin{align}

\text{IC}_{\mu_{\text{bh-T}} - \mu_{\text{bh-PM}}}:\quad&\Big(\overline{X}_1-\overline{X}_2\Big)-t_{\alpha(\widehat\nu)} \sqrt{\frac{S_1^2}{n_1}+\frac{S_2^2}{n_2}}\\[1.4em]

=&\Big(\overline{X}_{\text{bh-T}}-\overline{X}_{\text{bh-PM}}\Big)-t_{0.05(15.89)} \sqrt{\frac{S_{\text{bh-T}}^2}{n_{\text{bh-T}}}+\frac{S_{\text{bh-PM}}^2}{n_{\text{bh-PM}}}}\\[1.4em]

=&\left(11.4-8.75\right)-1.7466 \sqrt{\frac{11.82}{10}+\frac{6.21}{8}}\\[1.4em]

=&0.205

\end{align}

\]

Se tiene una confianza del 95 % en que la afectación media de las abejas angelita por el síndrome en el bh-T supera la afectación media que estas presentan en el bh-PM en al menos 0.205 individuos por colonia.

5.2.2.2 Uso de R para realizar inferencia sobre la diferencia de dos medias normales, usando muestras independientes

El siguiente script de R facilita la realización de los procedimientos inferenciales del ejemplo 5.3.

La primera línea importa la información de la tabla 5.6, la cual está contenida en el archivo ejemplo 5.3.xlsx.

Las líneas 2 y 3 realizan la prueba de Shapiro-Wilk para evaluar la normalidad de cada una de las dos muestras. Este es el resultado de la ejecución de la línea 2:

Shapiro-Wilk normality test

data: data$bh.T

W = 0.97161, p-value = 0.9053Puesto que p = 0.9053, no se detectan desviaciones severas del supuesto de normalidad para la muestra bh-T.

Y este es el resultado de la ejecución de la línea 3:

Shapiro-Wilk normality test

data: data$bh.PM

W = 0.94124, p-value = 0.6233Puesto que p = 0.6233, no se detectan desviaciones severas del supuesto de normalidad para la muestra bh-PM.

Para la parte central del contraste se utiliza la función t.test{stats} (línea 4). Entre los argumentos que esta función trae por defecto está: la diferencia de las dos medias es cero (mu = 0), la confianza del intervalo es 95 % (conf.level = 0.95), las varianzas son heterogéneas (var.equal = FALSE) y la prueba es de dos colas (alternative = two.sided).

Puesto que para el presente ejemplo se está contrastando una prueba de cola derecha, es necesario indicarlo explícitamente (alternative = "greater").

Cuando los argumentos de las funciones para R traen algún valor por defecto, es común que dicho valor corresponda al más frecuente o al recomendado.

Ese es el caso del argumento var.equal, cuyo valor por defecto es FALSE, con lo cual se realiza la prueba de Welch para comparar medias de dos poblaciones normales, lo que está acorde con las recomendaciones de Zimmerman (2004) y Delacre et al. (2017).

Consecuentemente, cuando no tenga mucha claridad sobre el efecto que pudiera tener la asignación de algún valor particular a un argumento, debería dejarlo con su valor por defecto.

Desde luego, una mejor opción consiste en entender el efecto que tiene cada uno de los posibles valores del argumento y elegir el más conveniente.

La ejecución de la línea 4 del script produce el siguiente resultado:

Welch Two Sample t-test

data: bh.T and bh.PM

t = 1.8933, df = 15.892, p-value = 0.03833

alternative hypothesis: true difference in means is greater than 0

95 percent confidence interval:

0.2053584 Inf

sample estimates:

mean of x mean of y

11.40 8.75 5.2.3 Comparación de medias usando muestras pareadas

En contraste con las muestras independientes, en las que las observaciones de una de las muestras no guardan relación con las de la otra (cf. ejemplos 5.2 y 5.3), en las muestras pareadas cada una de las observaciones de una muestra se relaciona con una observación en la otra muestra.

En estos casos, la muestra total está conformada por pares de observaciones, que pueden quedar constituidos naturalmente o estructurarse a criterio del investigador.

Un ejemplo de las muestras pareadas constituidas naturalmente se da en los denominados estudios antes-después, en los que se evalúa una característica sobre un grupo de unidades muestrales antes de una intervención o tratamiento, y posteriormente —tras la intervención— vuelve a evaluarse la característica sobre el mismo grupo.

En este caso, la primera muestra está conformada por el conjunto de lecturas obtenidas antes de la asignación del tratamiento, mientras que la segunda muestra consta de las lecturas registradas sobre las mismas unidades después de la asignación del tratamiento.

A cada una de las lecturas que se registran antes de la intervención le corresponde una lectura después de la intervención, con lo cual, la muestra pareada total consta de pares de observaciones antes-después.

El análisis de este tipo de ensayos se basa en comparar la lectura de cada unidad muestral antes de la intervención con la lectura de esa misma unidad muestral después de la intervención, de manera que cada unidad muestral contenga su propio referente o testigo.

Este tipo de comparación intraunidades permite controlar los factores de confusión asociados con diferencias entre las unidades.

Se denomina factor de confusión a cualquier condición cambiante o disímil entre grupos que se comparan, que —sin tratarse del factor cuyo efecto se pretende evaluar— puede dar lugar a una parte o a la totalidad de los cambios observados en la respuesta, y cuyo efecto no es separable del efecto del factor de interés.

Este concepto —de alta relevancia en el diseño de experimentos— se amplía en la sección 6.1.2.

Para ilustrar el concepto de los factores de confusión, considérese un ensayo mediante el cual se desea evaluar la efectividad de una dieta de reducción de peso en humanos, usando muestras independientes.

En adición a la dieta —que es el factor de interés y que se postula como causante de la reducción de peso— hay otros factores que pueden propiciar o dificultar la reducción de peso, como la actividad física, la edad y la condición metabólica, entre otros.

Al realizar el ensayo con base en muestras independientes, podría suceder que los participantes de uno de los grupos reunieran un conjunto de condiciones que —sin importar la dieta— propiciaran la reducción de peso.

Si tal grupo coincidiera con el que se somete a la dieta de reducción, no sería posible saber si las diferencias observadas con respecto al grupo control fueron debidas a la dieta, al conjunto de condiciones secundarias o a una combinación de dieta y factores secundarios.

Análogamente, si el grupo que reúne las condiciones favorables actuara como grupo control, sería más difícil detectar un posible efecto benéfico de la dieta evaluada.

En cualquier caso, el conjunto de condiciones favorables (o desfavorables) actuaría como factor de confusión.

Si bien es cierto que un especialista podría tratar de prevenir una situación como la descrita, balanceando los participantes de los dos grupos con base en los niveles de cada uno de los factores que considere más relevantes, difícilmente podría garantizar un efectivo balance de todos estos.

Probablemente tendría en cuenta que la proporción de hombres y mujeres fuera similar en los dos grupos, que la distribución de edades fuera asimismo similar y que las condiciones metabólicas promedio de los dos grupos fueran comparables; también podría incorporar elementos relacionados con la actividad física.

Sin embargo, no podría balancear estos factores por separado, sino que tendría que hacerlo de tal manera que las diferentes combinaciones sexo-edad-condición metabólica-actividad física quedaran balanceadas entre los dos grupos comparados.

Aun si todos los factores relevantes hubieran sido considerados, el balance obtenido difícilmente sería tan eficiente como el que se obtendría mediante el pareamiento antes-después, que garantiza que el grupo sometido a la dieta es exactamente igual al grupo que no estaba sometido a la dieta.

La estrategia antes-después permite mitigar los potenciales factores de confusión asociados con variaciones entre los individuos, siempre que tales factores permanezcan relativamente constantes a lo largo del estudio.

Los estudios antes-después se basan en el postulado de que los factores secundarios antes de la intervención son muy similares a los exhibidos por el grupo después de la intervención.

En muchas ocasiones, la satisfacción de este postulado depende del tiempo que transcurra entre el antes y el después de la intervención. Mientras mayor sea el tiempo entre las dos lecturas, mayor será la posibilidad de que surjan otros factores de confusión asociados con el tiempo.

Aunque las observaciones antes-después resultan muy intuitivas para entender la conformación de muestras paredas, no son las únicas que dan lugar a pares de observaciones naturalmente constituidas.

Considérese un ensayo mediante el cual se pretende comparar la efectividad de dos protectores solares de uso tópico. Para ello podría protegerse uno de los brazos de cada participante con uno de los productos, y el otro brazo —como par natural— con el otro producto. Tras un periodo determinado de exposición a la radiación solar se tomarían lecturas que den cuenta del estado de la piel en ambos brazos.

Lógicamente, las lecturas que se registren para cada individuo en cada uno de sus dos miembros superiores constituyen pares de observaciones. Esto permitiría controlar la gran mayoría de los factores asociados con variaciones dermatológicas entre los diferentes individuos. Asimismo, se controlarían factores asociados con el tiempo y el nivel de exposición, el cual podría variar entre individuos.

Para controlar el potencial factor de confusión asociado con el costado, por la mayor exposición que podría tener el brazo izquierdo en conductores de vehículos que tienen el volante al lado izquierdo, la asignación de los productos entre las dos extremidades debería realizarse al azar.

En general, siempre que sea posible debe aleatorizarse la asignación de los tratamientos entre los dos elementos del par.

Debe tenerse presente, sin embargo, que no siempre es factible aplicar aleatorización, tal y como sucede en los estudios antes-después13.

En adición a los estudios en los que los pares de observaciones quedan naturalmente constituidos, pueden diseñarse ensayos con muestra pareadas en los que el investigador conforma las parejas de unidades muestrales según su criterio. Esta estrategia amplía el abanico de posibilidades para el diseño de ensayos en investigación aplicada.

En estos casos, el investigador elige pares de unidades, de manera que los miembros de cada par sean muy similares en todos aquellos factores que —en adición al factor principal— puedan afectar la respuesta. Con ello se evita que los factores secundarios actúen como factores de confusión.

Para ilustrarlo, consideremos un estudio realizado por Márquez, López, Correa, Pareja y Giraldo (2003), en el que se evaluó el efecto de la exposición a agentes potencialmente genotóxicos sobre la integridad del genoma.

El equipo de investigación sabía que el daño genético también depende de factores como la edad, el género, la raza, el consumo de medicamentos y los hábitos, los cuales podrían actuar como factores de confusión.

Con el fin de reforzar los conceptos presentados en esta sección, se invita a reflexionar alrededor de las siguientes cuestiones, en el contexto del estudio de Márquez et al. (2003). Seguidamente, se invita a desplegar el contenido de la caja para contrastar las reflexiones con la discusión que allí se presenta:

¿Cómo evitar que los factores secundarios actúen como factores de confusión?

¿Será más conveniente usar muestras independientes o muestras pareadas?

¿Sería viable la estrategia antes-después?

Esta lógica de homogenización no está limitada a la comparación de dos condiciones:

El concepto de bloqueo que se presenta en la sección 7.2 es una generalización del concepto de pareamiento.

Se usan pares de observaciones cuando se requiere comparar dos grupos o condiciones, homogenizando por las condiciones que podrían actuar como factores de confusión.

Si fueran a compararse tres, cuatro o \(n\) grupos, se usarían ternas, cuádruplas o \(n\text{-tuplas},\) en lugar de pares.

A los grupos de unidades experimentales homogenizadas con base en uno o más factores secundarios se les denomina genéricamente bloques.

5.2.3.1 Prueba de hipótesis para la comparación de medias, usando muestras pareadas

Considérese un par de muestras aleatorias pareadas provenientes de poblaciones normales:

\(X_{11},X_{12},...,X_{1n}\: \text{iid}\: N\left(\mu_1,\; \sigma_1^2\right)\quad\) y \(\quad X_{21},X_{22},...,X_{2n}\: \text{iid}\: N\left(\mu_2,\; \sigma_2^2\right)\)

El primer subíndice de las variables aleatorias representa la población; el segundo, la variable. Así, por ejemplo, \(X_{21}\) representa la variable aleatoria 1 de la población 2.

Cada una de las variables de la población 1 está pareada con una variable de la población 2, en correspondencia con el segundo subíndice. Así, por ejemplo, \(X_{25}\) es la variable de la segunda población que se empareja con la variable \(X_{15}\) de la primera población.

Si bien las variables aleatorias que conforman la muestra aleatoria de cada población son independientes, las variables emparejadas entre poblaciones no lo son, debido al pareamiento.

En razón del pareamiento, la varianza de la diferencia entre dos variables emparejadas no depende únicamente de las varianzas marginales, sino también de su covarianza, así.

\[

\begin{align}

V(X_{1i}-X_{2i})&=V(X_{1i})+V(X_{2i})-2\;\text{Cov}(X_{1i}, X_{2i})\\[0.7em]

&= \sigma_1^2+ \sigma_2^2-2\;\text{Cov}(X_{1i}, X_{2i})

\end{align}

\]

La covarianza positiva que existe entre variables adecuadamente pareadas —al restarse en la expresión anterior— da lugar a una reducción en la varianza de las diferencias. Es por ello que —cuando se aplica adecuadamente el criterio de pareamiento— esta estrategia resulta más eficiente que la basada en muestras independientes.

En los diseños con pareamiento, se asume que esta estructura de dependencia es la misma para todos los pares, es decir, que la covarianza entre las variables emparejadas es la misma para cualquier par:

\[

\text{Cov}(X_{1i}, X_{2i})=\text{Cov}(X_{1}, X_{2})\;\forall\; i=1,2,\dotsc,n

\]

El conjunto de diferencias entre variables aleatorias emparejadas conforma a su vez una muestra aleatoria normalmente distribuida:

\[

X_{11}-X_{21},X_{12}-X_{22},...,X_{1n}-X_{2n}\: \text{iid}\: N\left(\mu_1-\mu_2,\; \sigma_1^2+\sigma_2^2-2\;\text{Cov}(X_{1}, X_{2})\right)

\]

Con el fin de simplificar la escritura, definimos una notación basada en \(\delta\) para representar los elementos derivados de las diferencias entre las dos muestras, así:

\[

\begin{align}

X_{1i}-X_{2i}&:=\delta_i\\[0.7em]

\mu_1-\mu_2&:=\mu_\delta\\[0.7em]

\sigma_1^2+\sigma_2^2-2\;\text{Cov}(X_{1}, X_{2})&:=\sigma_\delta^2

\end{align}

\]

La muestra aleatoria de diferencias de variables aleatorias puede escribirse simplificadamente así:

\[

\delta_1,\delta_2,...,\delta_n\: \text{iid}\: N\left(\mu_\delta,\; \sigma_\delta^2\right)

\tag{5.10}\]

La muestra aleatoria representada mediante la expresión 5.10 es equivalente a la usada para contrastar la hipótesis sobre la media de una población normal (cf. expresión 4.1)). En consecuencia, aplican los mismos desarrollos presentados en la sección 4.2.1).

Y es que, en efecto, el juego de hipótesis para comparar las medias de dos poblaciones normales con muestras pareadas es equivalente al juego de hipótesis para contrastar que la media del vector diferencia es cero.

El promedio de las \(n\) diferencias también es una variable aleatoria con distribución normal:

\[

\overline\delta\thicksim N\left(\mu_\delta,\; \frac{\sigma_\delta^2}{n}\right)

\]

Estandarizando, se obtiene una variable aleatoria normal con media cero y varianza uno:

\[

\frac{\overline\delta-\mu_\delta}{\sqrt{\frac{\sigma_\delta^2}{n}}}\thicksim N\left(0,\;1 \right)

\]

Puesto que la varianza poblacional, \(\sigma_\delta^2,\) es desconocida, se estima a partir de su mejor estimador insesgado (cf. sección 3.9.1.1.2), usando para su cálculo la expresión 2.2:

\[

S^2_\delta=\frac{\sum\limits_{i=1}^{n}{\delta}_i^2- \frac{\left(\, \sum\limits_{i=1}^{n}{\delta}_i \right)^2} {n}} {n-1}

\]

Al remplazar la varianza poblacional por su estimador en la variable aleatoria estandarizada, se obtiene una variable aleatoria que sigue una distribución \(t\) con \(n−1\) gl:

\[

\frac{\overline\delta-\mu_\delta}{\sqrt{\frac{S_\delta^2}{n}}}\thicksim t_{\left(n-1\right)}

\tag{5.11}\]

Considérese el siguiente juego de hipótesis para la comparación de las medias:

\[

H_0:\mu_1=\mu_2\Leftrightarrow \mu_1-\mu_2=0 \Leftrightarrow \mu_\delta=0

\]

\[

H_a:\mu_1\ne\mu_2\Leftrightarrow \mu_1-\mu_2\ne0 \Leftrightarrow \mu_\delta\ne 0

\]

Al imponer el cumplimiento de la hipótesis nula en la expresión 5.11, se obtiene el siguiente estadístico de prueba:

\[

t_\text{c}=\frac{\overline\delta}{S_\delta/\sqrt{n}}\overset {H_0}\thicksim t_{\left(n-1\right)}

\tag{5.12}\]

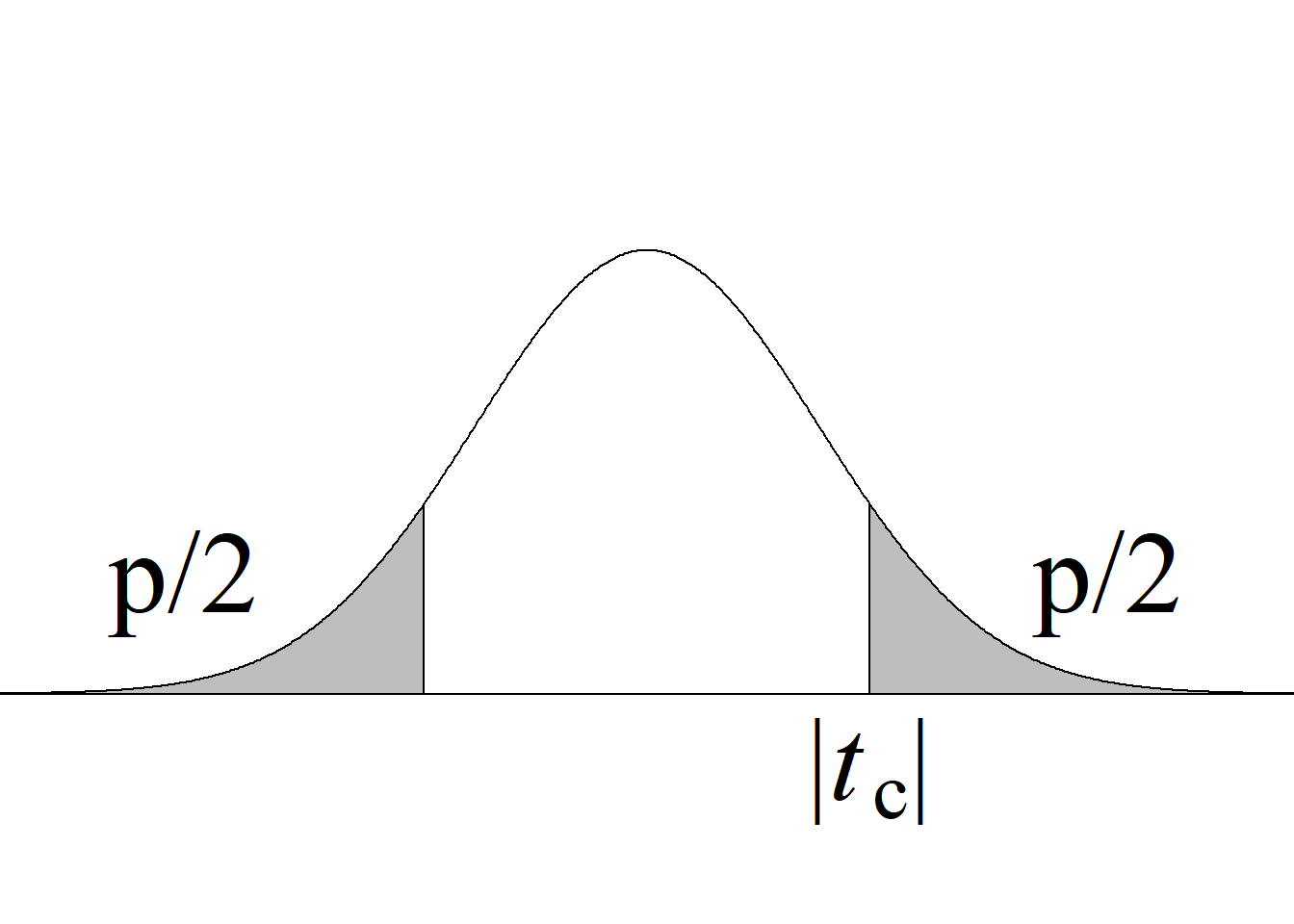

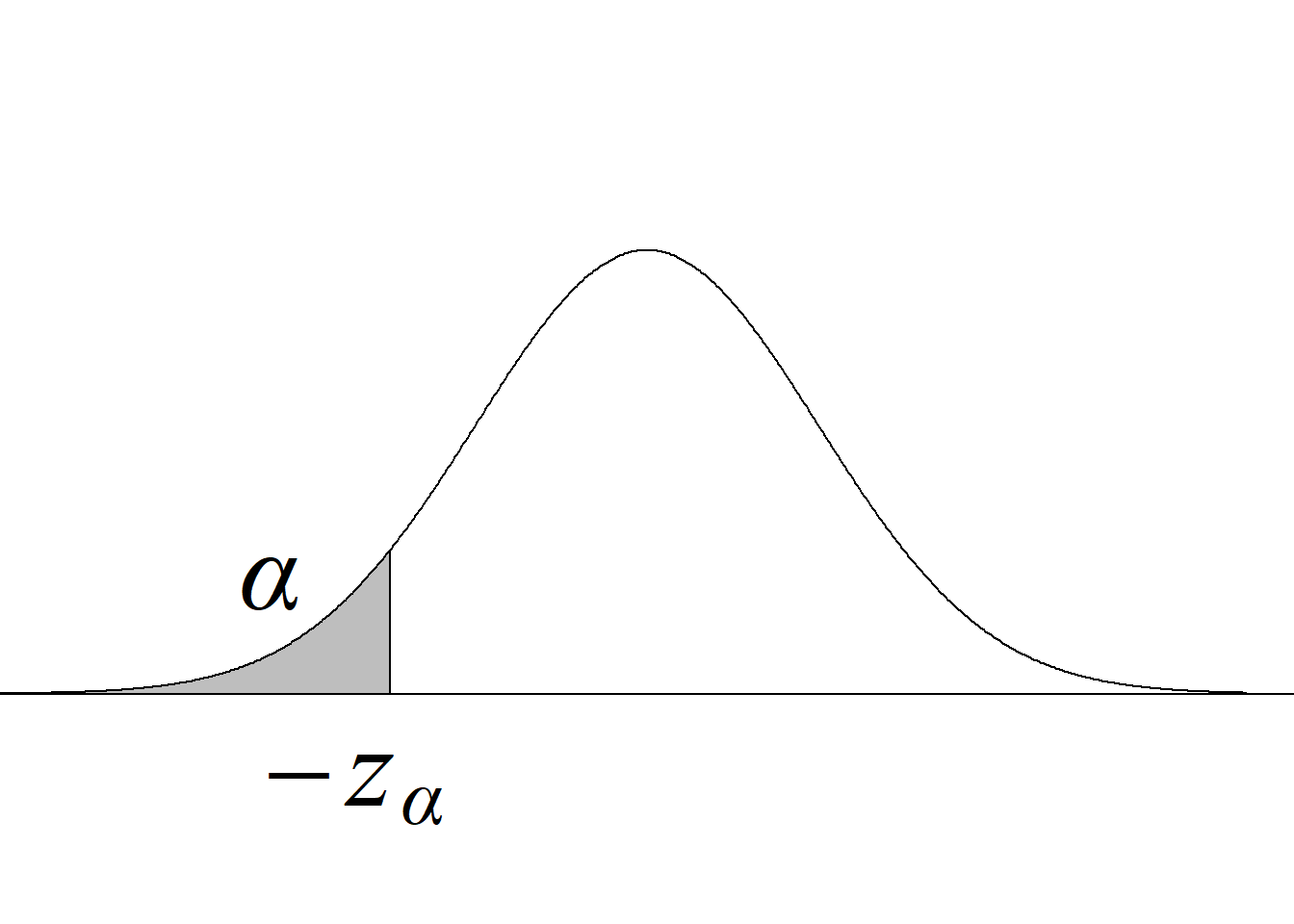

La tabla 5.7 y la figura 5.11 ilustran la forma en la que se usa el estadístico de prueba para definir el criterio de rechazo y calcular el valor p en los diferentes tipos de pruebas.

| Tipo de prueba | Criterio de rechazo de \(H_0\) para un nivel de significancia \(\alpha\) | Valor p |

|---|---|---|

| Cola izquierda \(H_0:\mu_\delta\ge0\) \(H_a:\mu_\delta<0\) |

\(t_\text{c}\le−t_{\alpha(n-1)}\) |

\(P(t_{(n-1)} < t_\text{c})\) |

| Cola derecha \(H_0:\mu_\delta\le0\) \(H_a:\mu_\delta>0\) |

\(t_\text{c}\ge t_{\alpha(n-1)}\) |

\(P(t_{(n-1)} > t_\text{c})\) |

| Dos colas \(H_0:\mu_\delta=0\) \(H_a:\mu_\delta\ne0\) |

\(|t_\text{c}|\ge t_{\alpha/2(n-1)}\) |

\(2 \, P(t_{(n-1)} > |t_\text{c}|)\) |

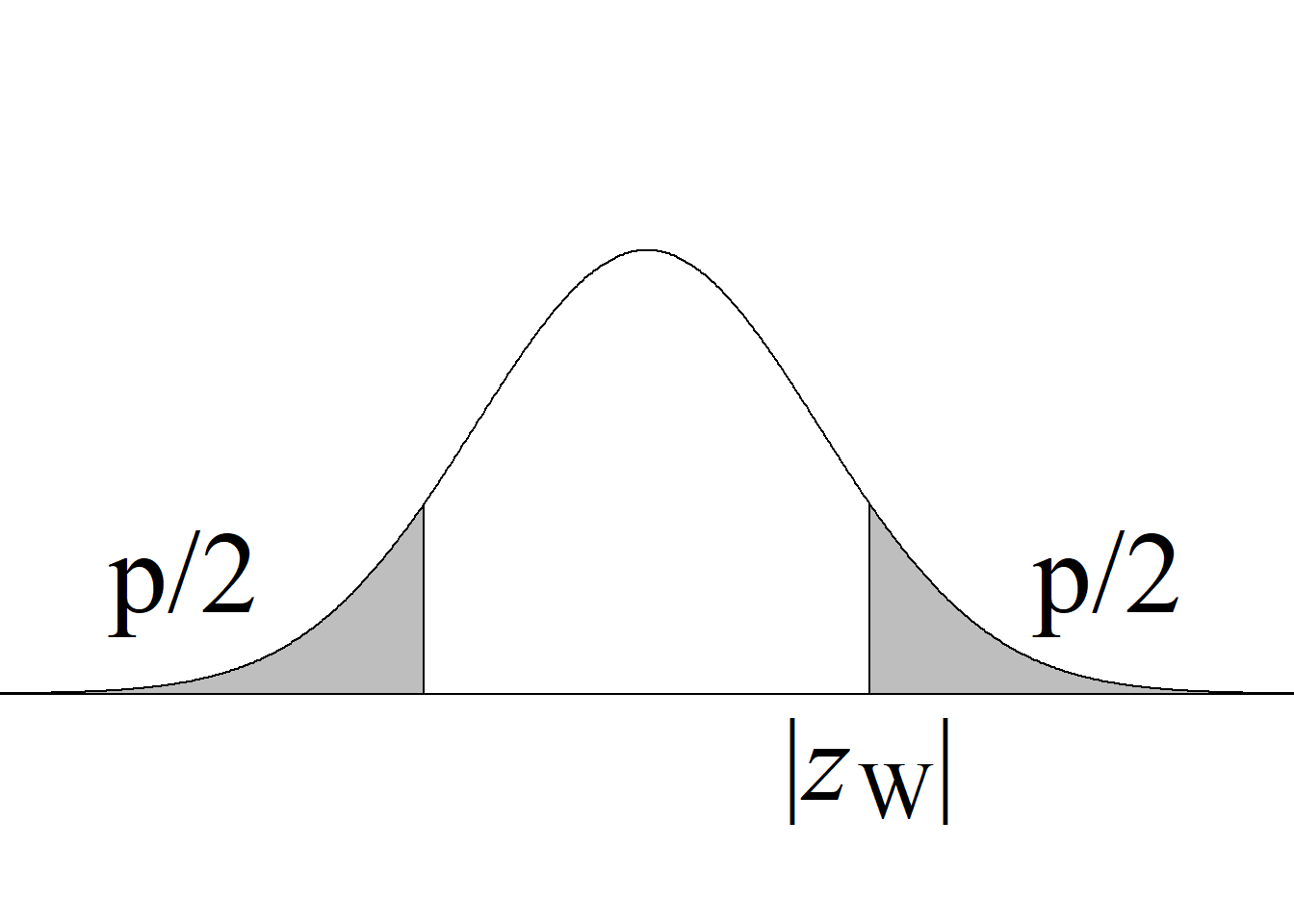

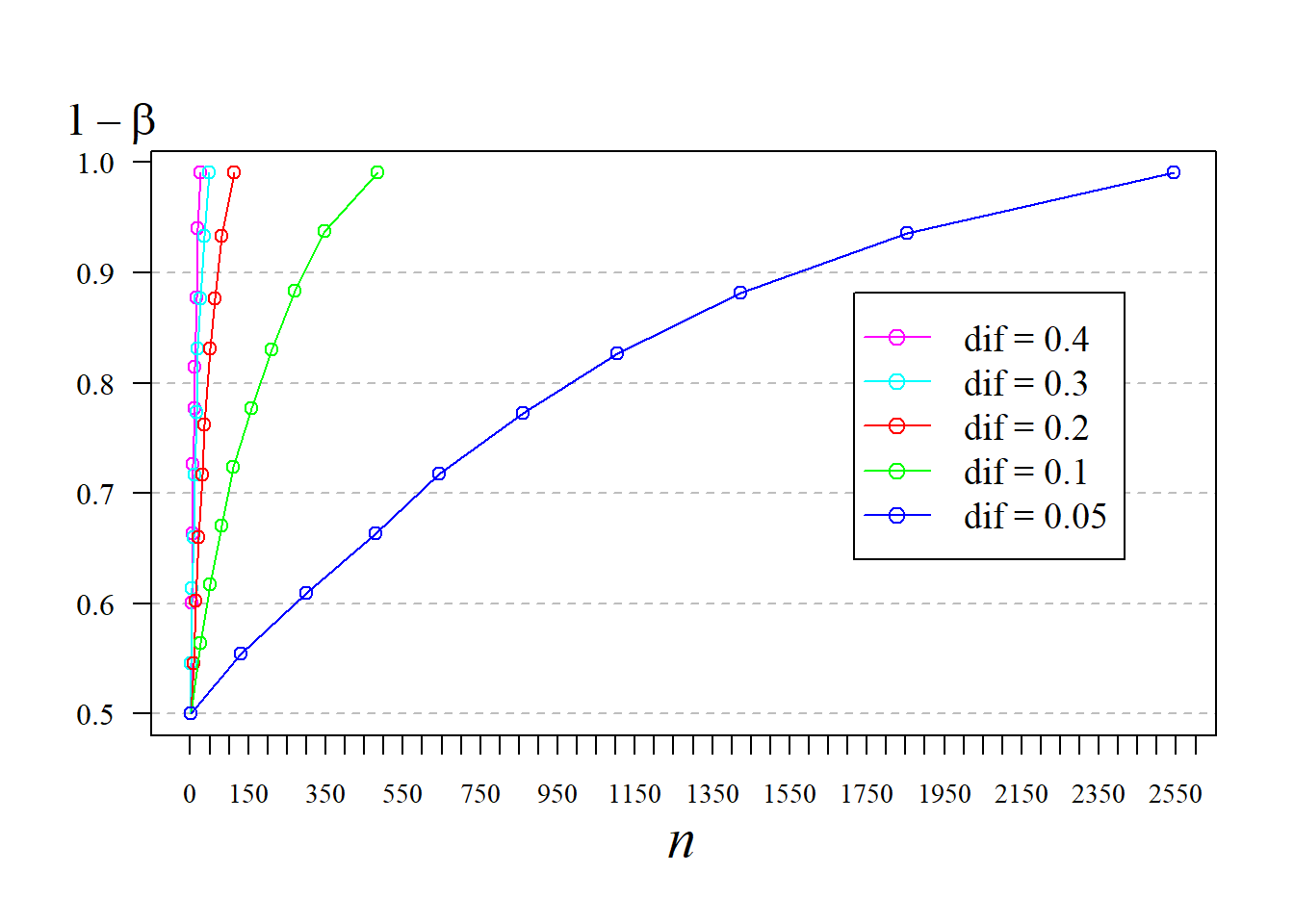

Los criterios presentados en la tabla 5.7 y la figura 5.11 para la comparación de las medias de dos poblaciones normales usando muestras pareadas son iguales a los presentados en la tabla 4.1 y la figura 4.1 para contrastar un juego de hipótesis sobre la media, \(\mu,\) de una población normal (cf. sección 4.2.1).