6 INTRODUCCIÓN AL DISEÑO DE EXPERIMENTOS

Los experimentos diseñados surgen en el marco de la inferencia estadística, sobre la cual se discute ampliamente en el capítulo 3 y muy particularmente en la sección 3.9.

La inferencia estadística clásica o frecuentista comprende el conjunto de herramientas mediante las cuales se realizan afirmaciones sobre parámetros poblacionales desconocidos, usando información muestral, con la mediación de un modelo probabilístico.

En el capítulo 4 se presentan las técnicas más usadas para responder preguntas sobre alguno de los parámetros que suelen utilizarse en la práctica investigativa para caracterizar poblaciones, esto es, la media, la varianza y la proporción. En tales casos, se usa la información suministrada por una muestra que se extrae de la población objetivo.

En el capítulo 5 se presentan las técnicas más usadas para la comparación de dos poblaciones, a través de sus parámetros. Se comparan varianzas, medias y proporciones. Para la realización de tales comparaciones se usan dos muestras: una de cada población.

En el presente capítulo se generalizan algunas de las técnicas presentadas en los capítulos precedentes, con el fin de comparar más de dos poblaciones a través de sus parámetros, lo que implica la obtención de una muestra por cada población.

Si bien cada una de las comparaciones entre múltiples parámetros proporciona información valiosa en contextos específicos, las pruebas de comparación de medias son, sin lugar a dudas, las más usadas en investigación.

Existen generalizaciones de la prueba de homogeneidad de varianzas que permiten comparar múltiples varianzas. Sin embargo, estas desempeñan un papel secundario y suelen utilizarse como herramientas diagnóstico para evaluar las condiciones requeridas para la realización de las pruebas de comparación de medias.

En cuanto al parámetro de la binomial, aunque se dispone de procedimientos específicos para la comparación de múltiples proporciones (cf. sección 5.4.2), en la práctica investigativa, tales situaciones suelen abordarse con base en la misma generalización que se utiliza para la comparación de medias.

En consecuencia, la generalización más importante de las técnicas inferenciales clásicas, en el contexto del diseño experimental, es la que se utiliza para la comparación de múltiples medias de poblaciones normales.

Aunque las técnicas que se presentan en este y en varios de los capítulos siguientes constituyen generalizaciones de las utilizadas con una y dos poblaciones, y comparten con ellas parte de su fundamento teórico, incorporan elementos adicionales que exigen ampliar algunas de las conceptualizaciones introducidas previamente.

Podría pensarse que los métodos inferenciales propios del diseño experimental son más complejos, pues implican la comparación simultánea de múltiples poblaciones. Sin embargo, la estructura que proporciona el diseño permite organizar dichas comparaciones de manera sistemática y eficiente.

6.1 Conceptos asociados con el diseño de experimentos

Como paso previo a la presentación de los conceptos asociados con los experimentos y su diseño, se define el experimento como una de las categorías resultantes de clasificar los estudios, según la intervención ejercida por el investigador. Seguidamente, se presentan algunos conceptos centrales de la experimentación diseñada.

6.1.1 Tipos de estudios, según el nivel de intervención

Muchos estudios pueden representarse mediante el esquema de la figura 6.1.

Aunque las denominaciones que se listan dentro de cada caja son equivalentes, su frecuencia de uso depende del contexto, haciendo que algunas expresiones —aunque correctas— puedan sonar extrañas al referirse a métodos particulares. El resaltado o atenuado de los elementos refleja su frecuencia de uso en el ámbito de los diseños experimentales.

Si bien los elementos de la caja izquierda son variables, muy a menudo se registran en escalas nominales u ordinales (cf. sección 1.2.1). Por tal motivo, resulta más natural designarlos como factores o tratamientos.

Incluso cuando tales variables se registran en una escala numérica, el modelo de análisis presentado en este capítulo omite dicha información, tomando cada nivel como una categoría diferente de una variable nominal (cf. sección 6.2).

Las denominaciones variable independiente, variable predictora o variable explicativa son más comunes en el contexto de análisis de regresión, en el que tales variables se miden en una escala numérica, y el método de análisis sí considera dicha información.

Por su parte, la denominación variable dependiente para el elemento del lado derecho es más usada en análisis de regresión, como contraparte de la variable independiente. En el contexto de los ensayos que se exploran en este capítulo, es más común referirse a este componente como respuesta o variable respuesta.

Nótese que la caja izquierda puede contener una o múltiples variables, mientras que la caja derecha solamente contiene una variable.

Es común que los ensayos generen múltiples respuestas. Sin embargo, en el contexto univariante se analizan una a una.

Las técnicas de análisis univariante usan un modelo probabilístico independiente para cada una de las variables respuesta registradas en el ensayo.

Este análisis no es incompatible con el uso adicional —cuando sea del caso— de técnicas bivariadas o multivariadas para explorar asociaciones entre las diferentes respuestas.

En la figura 6.1 resulta destacable el rol del material experimental como integrador de la relación entre las variables. No se hipotetiza una asociación abstracta entre variables, sino el efecto de unos tratamientos que actúan sobre un material experimental afectando una de sus características: la respuesta.

Las pruebas estadísticas permiten declarar significancia de efectos.

La significancia, sin embargo, no implica por sí sola el establecimiento de relaciones de causalidad.

Los estudios en los que las variables tienen un rol asimétrico o diferenciado, como los representados en la figura 6.1, se clasifican a su vez en observacionales y experimentales, dependiendo del nivel de control o intervención ejercido por el investigador sobre los tratamientos.

En los estudios observacionales, el investigador se limita a observar, medir o registrar la respuesta de un fenómeno determinado, sin controlar ni modificar ninguno de los factores que pudieran tener un efecto sobre dicha respuesta.

En contraste, en los estudios experimentales, el investigador interviene, modifica, controla y establece los niveles de los tratamientos, acorde con sus requerimientos, para evaluar la respuesta bajo tales configuraciones.

Los estudios observacionales son muy comunes en investigaciones propias de las ciencias sociales, de la salud y del comportamiento, donde hay más restricciones para intervenir los hipotéticos factores causales.

Así, por ejemplo, un investigador de las ciencias médicas que deseara realizar un ensayo para respaldar la hipotética relación entre el hábito de fumar y el cáncer gástrico, no podría, por obvias razones éticas, intervenir el grupo de participantes, definiendo quiénes han de fumar y quiénes no.

En contraste, los estudios experimentales son más frecuentes en las investigaciones propias de las ciencias básicas y aplicadas, donde suelen existir menos limitaciones en el establecimiento y control de los hipotéticos factores causales.

Si, por ejemplo, un investigador de las ciencias agrarias deseara evaluar el efecto de diferentes densidades de siembra sobre el rendimiento de un cultivo, no tendría ninguna limitación para establecer parcelas con las diferentes densidades que deseara evaluar, siempre que contara, desde luego, con suficiente espacio y material vegetal.

Cuando se trabaja con personas, en adición a las limitaciones de carácter ético, las posibles alteraciones en el comportamiento también restringen el uso de los estudios experimentales. La aplicación consciente y dirigida de un estímulo sobre un grupo de individuos puede tener un efecto diferente al que dicho estímulo tendría si se presentara de manera natural.

El sesgo de deseabilidad social consiste en la tendencia de algunos individuos a tratar de responder acorde con lo que se supone que se espera de ellos. En tal sentido, los individuos sometidos a un tratamiento destinado a mejorar cierta habilidad podrían dedicar un esfuerzo extra en pro de mejorar la habilidad en cuestión, lo cual podría sesgar las conclusiones.

En otros casos, sin importar el área de investigación, las condiciones propias de los fenómenos estudiados hacen imposible un acercamiento experimental.

Un sociólogo que deseara investigar las dinámicas de las poblaciones que han sufrido desplazamiento forzado no podría realizar una aproximación experimental. Asimismo, un ecólogo que deseara comparar las dinámicas de dos ecosistemas no tendría más alternativa que observar dichas dinámicas en entornos que hubieran surgido de los procesos naturales propios de tales ecosistemas.

En el contexto del presente capítulo y los sucesivos, se utilizan indistintamente las expresiones experimento y estudio experimental en referencia a todos aquellos ensayos que se realizan con ánimo inferencial, en los que el investigador define y controla los niveles del factor cuyo efecto sobre la respuesta es motivo de evaluación.

El diseño de experimentos comprende el conjunto de protocolos que definen la manera adecuada de realizar tales estudios. A los ensayos que surgen en este contexto, también se les denomina experimentos diseñados.

Aunque la clasificación de los estudios en observacionales y experimentales es una de las más extendidas en estadística aplicada y metodología científica, no es la única.

Así, por ejemplo, Hurlbert (1984) desarrolla una clasificación cuasi equivalente a la observacional/experimental, usando las denominaciones experimento mensurativo y experimento manipulativo, correspondientemente.

Asimismo, Hurlbert (1984) hace notar que la diferencia esencial es la misma que existe entre muestreo y experimentación: indica que lo concerniente a los experimentos mensurativos (estudios observacionales) suele compilarse en libros cuyo título habla de muestreo (sampling), mientras que lo relativo a los experimentos manipulativos (estudios experimentales) se desarrolla en libros cuyo título contiene el sustantivo diseño (design).

6.1.2 Factores de confusión

Aunque los factores de confusión pueden presentarse tanto en estudios observacionales como experimentales, en general, los estudios observacionales están más expuestos a estos.

Retomemos el ejemplo del investigador que desea evaluar la hipótesis de que el tabaquismo es un factor que incrementa el riesgo de cáncer gástrico. Descartada la opción de un estudio experimental, podría pensarse que para respaldar dicha hipótesis bastaría con comparar la prevalencia de cáncer gástrico en dos grupos: uno de fumadores y otro de no fumadores.

No obstante, más allá del factor de interés (el ser o no ser fumador) habría otros factores que podrían influir en el resultado, actuando como factores de confusión. Entre tales factores podrían mencionarse los hábitos alimentarios, el consumo de bebidas alcohólicas y el estrés.

Si, por ejemplo, en el grupo de fumadores los hábitos alimentarios fueran menos saludables que en el grupo de control, el consumo de bebidas alcohólicas más frecuente y los niveles de estrés más altos, estos actuarían como factores de confusión, sesgando el resultado y restándole validez.

Si, a partir de un estudio observacional, se encontrara que la prevalencia de cáncer gástrico es mayor en el grupo de fumadores que en el de no fumadores, sería difícil saber cuál o cuáles factores contribuyeron a dicho resultado: si se debió al hábito de fumar, a alguno o algunos de los factores no controlados que podrían estar asociados con los grupos comparados o a una combinación del factor de interés con los demás factores.

Teniendo en cuenta que, en el escenario planteado, no sería posible realizar un ensayo experimental, por los efectos deletéreos que ello podría conllevar sobre la salud de los participantes, supóngase que un investigador decide trabajar con ratas de laboratorio, sometiendo un grupo de estas a la inhalación de humo de tabaco y dejando el otro grupo libre de tal exposición.

Mediante este procedimiento podrían controlarse algunos de los posibles factores de confusión mencionados: los dos grupos recibirían exactamente el mismo alimento y no habría lugar a confusión por consumo de bebidas alcohólicas. No obstante, no se tendría garantía de estar controlando todos los posibles factores de confusión. Por mencionar solo uno, valga considerar el relativo al estrés. Podría suceder que las ratas sometidas a inhalación forzada de humo de tabaco experimentaran niveles más altos de estrés que las ratas del grupo control, en cuyo caso, el estrés sería un factor de confusión.

Además del estrés u otros posibles factores de confusión no vislumbrados, habría muchos otros aspectos que sería necesario considerar en un estudio como el planteado: ¿será comparable la sensación que experimentan los individuos que fuman por el placer que les produce y los individuos que se encuentran dentro de una cámara saturada con humo de tabaco?, ¿podría esta sensación diferencial sesgar los resultados?, ¿será igual el efecto en individuos sometidos a una exposición aguda que en aquellos con exposición crónica?, ¿constituyen las ratas un modelo adecuado para este tipo de estudios, pudiendo generalizarse los hallazgos a poblaciones humanas? La validez de este hipotético estudio tendría que argumentarse con base en las respuestas a esta y otras preguntas.

Supóngase ahora un estudio cuyo objetivo sea evaluar la efectividad de un medicamento. En principio podría considerarse el desarrollo de tal estudio mediante un esquema experimental, es decir, suministrando el medicamento a un grupo de pacientes, mientras que, para fines de comparación, otro grupo se mantendría como testigo, sin el medicamento.

Este diseño permitiría ejercer un mejor control sobre los posibles factores de confusión, mediante el balanceo de los dos grupos, teniendo en cuenta todos aquellos factores que, de acuerdo con el conocimiento y la experiencia del investigador, pudieran influir en el resultado.

Aunque un estudio como el planteado podría ser blanco de cuestionamientos éticos, por privar al grupo testigo del potencial efecto benéfico del medicamento evaluado, obviaremos este asunto para discutir cómo, aun en un estudio experimental como este, que permite controlar múltiples factores de confusión, podrían surgir otros factores de confusión.

En algunos ensayos médicos en los que se interviene una situación, la disposición sicológica de los pacientes puede convertirse en factor de confusión.

Los pacientes que saben o creen que se les suministró el tratamiento suelen tener una mejor disposición sicológica que aquellos que saben o creen que no se le suministró el tratamiento, lo que en cierto tipo de afecciones podría poner en ventaja a los primeros sobre los últimos, al grado de verse reflejado en los resultados. En este caso, el estado de ánimo actuaría como factor de confusión.

La necesidad de estrategias para controlar tales situaciones explica por qué en medicina son tan populares los estudios ciegos, en los que los pacientes no saben si pertenecen al grupo tratado o al grupo control. Esto evita que la disposición sicológica de los pacientes actúe como factor de confusión.

Desde luego, también debe considerarse la disposición sicológica de los médicos encargados de evaluar la respuesta.

Para evitar que los médicos realicen evaluaciones subjetivas intentando ver mejoría en los pacientes tratados y estancamiento o retroceso en los no tratados, suelen usarse estudios doble ciego, en los que ni los pacientes tratados ni los médicos evaluadores saben a qué grupo pertenece cada individuo.

En una situación en la que se considerara que los analistas también podrían sesgar los resultados, podría resultar conveniente que estos recibieran la información de manera codificada o enmascarada, con lo cual se tendría un estudio triple ciego.

Cuando únicamente los sujetos del tratamiento desconocen a qué grupo pertenecen, el estudio suele denominarse simple ciego.

Con respecto a tales denominaciones, Letelier, Manríquez y Claro (2004) indican que, dados los múltiples actores que suelen intervenir en los estudios, existen diversas interpretaciones entre los investigadores, editores de revistas biomédicas y autores de textos sobre métodos de investigación, en referencia a los ensayos en los que alguno o algunos de sus diferentes actores han sido objeto de técnicas de enmascaramiento de los tratamientos.

Consecuentemente, en lugar de tales denominaciones, recomiendan indicar explícitamente en todos los casos cuáles de los múltiples participantes fueron “ciegos”, es decir, quiénes desconocían la forma en que se aplicó la intervención sobre los grupos estudiados.

Una de las estrategias de enmascaramiento más usadas sobre los sujetos del tratamiento es el placebo, el cual consiste en un tratamiento que tenga exactamente la misma apariencia del tratamiento de interés, pero que difiera de este en lo esencial.

Si se estuviera ensayando, por ejemplo, un medicamento, el grupo no tratado debería recibir un producto lo más parecido posible al producto evaluado, teniendo en cuenta no solo el aspecto, en cuanto a presentación, textura, color, sabor, olor, temperatura y cualquier otra propiedad que pertinente, sino también en cuanto a la vía y frecuencia de administración. Lógicamente, el placebo carecería del principio activo cuyo efecto se deseara evaluar.

Con la administración de un placebo, se busca equiparar la disposición sicológica de los participantes, a fin de evitar que esta actúe como factor de confusión.

Aunque la acepción más común del placebo es la de un seudomedicamento, el término es generalizable a cualquier estrategia dirigida a darle a un tratamiento control la misma apariencia del tratamiento evaluado, de manera que todos los individuos crean estar recibiendo el mismo tratamiento.

Es importante usar un placebo siempre que la disposición de los sujetos pueda influir en los resultados. Podría pensarse que esta estrategia solo tendría lugar en estudios con personas; sin embargo, los especialistas en comportamiento animal podrían tener otra opinión al respecto. La pertinencia de incluir placebos en estudios con animales dependerá de la especie, de la naturaleza del efecto evaluado y de la respuesta que se registre.

En general, los estudios ciegos1, con el posible uso de placebo, pueden y deben usarse en cualquier situación en la que la disposición de los participantes, de los evaluadores o de cualquier otro actor del proceso pueda sesgar los resultados.

En un estudio con animales en el que no se considerara necesario aplicar una estrategia de enmascaramiento sobre los animales (placebo), pero sí sobre los evaluadores, cobraría especial relevancia la recomendación de Letelier et al. (2004), referente a la denominación de los estudios ciegos. ¿Cómo se llamaría un estudio con tales características? ¿Simple ciego o doble ciego?

Puesto que la estrategia de enmascaramiento estaría siendo usada únicamente sobre uno de los actores del ensayo (los evaluadores) podría pensarse en llamarlo simple ciego; no obstante, dicha denominación podría hacer creer que únicamente se usó estrategia de enmascaramiento sobre los animales. En consecuencia, resulta más claro indicar explícitamente cuál de los actores del ensayo desconocía la membresía de los individuos a los grupos de interés.

Aun en los estudios en los que se descarte un posible efecto por disposición sicológica de los participantes, pueden requerirse estrategias para equiparar aspectos secundarios a la aplicación de los tratamientos, de manera que estos sean comparables entre sí en lo esencial.

Así, por ejemplo, en un ensayo en el que la inoculación de un patógeno implique una punción en un tejido vegetal, sería necesario someter todos los tratamientos, incluso los que no consideren inoculación, al mismo protocolo, con punción incluida. Esto balancearía los tratamientos en lo concerniente a la punción y al protocolo de inoculación, descartando que estos pudieran actuar como factores de confusión. A tales acciones se les denomina genéricamente estrategias de control de factores de confusión.

Aunque, en general, los estudios experimentales permiten un mejor control de los potenciales factores de confusión, no garantizan su control absoluto.

Cuando la disposición de los participantes en un estudio pueda sesgar los resultados, es conveniente aplicar técnicas de enmascaramiento de la membresía de los sujetos a los diferentes grupos, mediante los denominados estudios ciegos.

La principal técnica de enmascaramiento para los sujetos del estudio consiste en suministrar un placebo al grupo control, con el fin de equilibrar la disposición sicológica entre los participantes de los grupos comparados.

Aun cuando el posible efecto sicológico de los participantes esté descartado —como en la mayoría de los estudios agrarios—, suele ser posible y necesario aplicar otras estrategias de control de factores de confusión.

6.1.3 Validez interna

Dado que la realización de inferencias válidas depende en gran parte del adecuado control de los posibles factores de confusión, la validez interna está determinada por el conjunto de acciones y condiciones que permiten ejercer dicho control en el estudio.

La validez interna es un concepto cualitativo. Cuando las condiciones en las que se realiza un estudio permiten ejercer un adecuado control sobre los principales factores de confusión, se dice que este tiene alta validez interna.

En contraste, los estudios que presentan fallas en el control de los posibles factores de confusión tienen baja validez interna.

En general, los protocolos experimentales empleados en ciencias básicas y aplicadas dan lugar a estudios con alta validez interna.

La validez interna es un requerimiento esencial de cualquier estudio en investigación.

Un estudio con baja validez interna, al no permitir inferencias válidas, no constituye un soporte adecuado para el avance científico.

6.1.4 Validez externa

Al igual que la validez interna, se trata de un concepto cualitativo. Cuanto mayor sea la validez externa de un estudio, mayor será su alcance. En contraste, el alcance de un estudio con baja validez externa será restringido.

La validez externa está ligada a las características del material experimental y a las condiciones en que se realice el estudio.

Las conclusiones de un estudio en el que se someta un material experimental muy específico a la acción de los tratamientos, bajo condiciones experimentales muy puntuales, difícilmente podrán generalizarse a poblaciones amplias. En tales casos, su alcance quedará restringido a las subpoblaciones del material experimental particular y a las condiciones en que se realizó el ensayo.

La validez externa resulta cuestionable, por ejemplo, cuando se realizan ensayos de laboratorio cuyas conclusiones pretenden generalizarse a situaciones de campo.

La validez externa de los procesos inferenciales es la contraparte de la denominada representatividad en los procesos de muestreo.

Aunque ambos conceptos se refieren a la congruencia entre la muestra y la población, pudiendo pensarse que basta con obtener una muestra representativa para tener alta validez externa, los procesos muestrales clásicos y los experimentos diseñados siguen vías opuestas.

Mientras que en los métodos de muestreo se parte de una población claramente definida2 y, acorde con las circunstancias, se plantean estrategias para extraer una muestra de dicha población que recoja, de la manera más fidedigna posible, sus características esenciales (representatividad), en los experimentos diseñados es común partir de la muestra, buscando que esta refleje las características esenciales de una población (validez externa), que muchas veces es difusa, desconocida o que incluso puede no existir (cf. figura 6.2).

Esta circunstancia exige un esfuerzo de abstracción por parte del investigador para enfocar adecuadamente los alcances y posibilidades de generalización de sus resultados.

A diferencia de la validez interna, que constituye una condición indispensable para la obtención de inferencias estadísticas válidas, la validez externa es un atributo cuyo grado de importancia depende de los objetivos del estudio.

Un trabajo con alcance restringido puede aportar evidencia sólida y valiosa, siempre que su validez interna esté garantizada.

6.1.5 Ventajas de los estudios experimentales

Como se ha señalado, los estudios observacionales constituyen una aproximación fundamental en múltiples áreas del conocimiento, especialmente cuando existen restricciones éticas, prácticas o estructurales que impiden la manipulación de los factores de interés. En tales contextos, representan no solo una alternativa viable, sino con frecuencia la única vía posible para abordar determinados fenómenos.

No obstante, cuando las condiciones lo permiten, los estudios experimentales ofrecen ventajas metodológicas que los convierten en el soporte más robusto para la contrastación de hipótesis causales.

Los estudios experimentales generalmente son más eficientes que los observacionales para controlar y separar el efecto de los factores de interés del de otros factores secundarios que también afectan la respuesta. En otras palabras, posibilitan un mejor control de potenciales factores de confusión, dando lugar a estudios con mayor validez interna.

La aleatorización es el mecanismo más usado para dicho fin (cf. sección 6.1.11). En el capítulo 7 se discuten los esquemas de aleatorización más utilizados en el diseño de experimentos.

Otra de las ventajas de los estudios experimentales radica en la posibilidad que ofrecen de suponer y muestrear poblaciones hipotéticas, aun cuando las mismas no existan en la naturaleza.

Esta posibilidad surge del hecho de que el investigador no está restringido a observar los factores considerados causales, tal y como se presentan en su estado natural, sino que puede disponerlos como le resulte más conveniente para contrastar las hipótesis de interés.

Cada vez que se ensaya una nueva condición o ajuste en un proceso productivo, se está infiriendo sobre una población inexistente.

Un investigador podría evaluar un nuevo sustrato para la producción de bioetanol, aun si dicho sustrato nunca antes hubiese sido usado para dicho fin. En tal sentido, estaría infiriendo sobre una población que aún no existe. Si los resultados del ensayo fueran promisorios, bien podría escalarse el proceso, dando lugar a una población en la que se produzca bioetanol a partir de dicho sustrato.

Algo análogo sucede en los procesos de fitomejoramiento, donde se evalúan ciertos materiales, bajo condiciones en las cuales dichos genotipos quizá no no se encuentren naturalmente. Como resultado de dicho proceso podrían generarse poblaciones con el material o materiales que exhiban las respuestas más deseables.

Aunque los estudios experimentales no siempre son viables, bien sea por la naturaleza de los factores estudiados, por cuestiones éticas, económicas o de posible alteración de los resultados, estas limitantes suelen ser menos restrictivas en numerosos ámbitos de las ciencias básicas y aplicadas. Por tal motivo, y teniendo en cuenta su mayor eficiencia para el control de los potenciales factores de confusión, los estudios experimentales son el soporte más común de la investigación en dichas áreas.

Una de las misiones de los asesores estadísticos consiste en seleccionar el diseño experimental más adecuado para cada situación, es decir, aquel que permita un control eficaz de los factores de confusión y posibilite contrastar las hipótesis de interés con la mayor precisión y al menor costo posible.

Las principales ventajas de los estudios experimentales con respecto a los observacionales son:

Permiten un mejor control de los factores de confusión, lo que generalmente se traduce en mayor validez interna.

Permiten suponer y muestrear poblaciones inexistentes o aún no realizadas en la práctica.

6.1.6 Tratamientos

Tratamiento es una denominación genérica para cada una de las categorías estudiadas, sin importar su naturaleza. Aunque en algunos experimentos médicos pueda referirse a las diferentes estrategias de manejo de una enfermedad, no se limita a ello.

En un experimento diseñado para evaluar el efecto de la luz sobre la producción de café, los tratamientos podrían ser con sombrío y libre exposición. Estas corresponden a dos categorías del factor manejo de la luz.

También es común usar el término tratamientos, en plural, como sinónimo de factor, especialmente cuando el experimento tiene un único factor. Para la presente situación bien podría decirse que se tienen dos tratamientos de manejo de la luz, consistentes en sombrío y libre exposición.

Cuando se establecen los tratamientos en un estudio experimental, queda definido un número igual de poblaciones. Para el presente ejemplo una de las poblaciones sería la de las plantaciones de café a libre exposición y la otra la de las plantaciones de café con sombrío.

La evaluación del efecto de las diferentes estrategias de manejo de la luz sobre la producción media de café es equivalente a lo estudiado en el capítulo 5, donde se evalúa, por ejemplo, el efecto de dos niveles de pH sobre la síntesis de PHA (ejemplo 5.2) o el efecto de enlatar los tomates sobre su contenido medio de hierro (ejemplo 5.4). Lo que difiere es principalmente el lenguaje específico utilizado en cada escenario.

Lo que en el contexto experimental es la variable respuesta o la respuesta, en el capítulo 5 se denomina simplemente la variable, sin ningún calificativo adicional. Esto se debe a que el modelo conceptual desarrollado en el capítulo 5 no considera la relación entre dos variables, sino el posible cambio en el parámetro de centralidad de una variable cuando esta se evalúa en dos condiciones específicas.

Asimismo, lo que en el contexto de los experimentos diseñados se ha definido como tratamientos, en el capítulo 5 suele denominarse grupos, aunque en ocasiones, también en el contexto de comparación de dos poblaciones, se hace referencia a este elemento como tratamiento o factor.

La denominación grupo, a pesar de su ambigüedad —y justamente gracias a ella— puede resultar conveniente, pues evita entrar en disquisiciones teóricas para precisar si se hace referencia a la muestra de campo, a la muestra teórica, a la población de campo o a la población teórica (cf. sección 3.9). Todo lo anterior queda recogido diciendo que se comparan dos grupos. Esta denominación también suele utilizarse en el contexto de los experimentos diseñados.

La situación planteada anteriormente —es decir, la de un experimento con dos tratamientos— corresponde con las presentadas en el capítulo 5, no solo en el ámbito conceptual, sino también en el operativo. El método de análisis que se desarrolla en la sección 6.2 es una generalización de la prueba de \(t\) descrita en la sección 5.2.1; al tratarse de una generalización, puede usarse para comparar más de dos grupos.

Si en la investigación que busca averiguar el efecto de manejo de la luz sobre la producción de café se quisiera evaluar más de dos modalidades de dicho factor, bien podría abordarse mediante un experimento diseñado, usando el método de análisis descrito en la sección 6.2. El investigador podría tener interés, por ejemplo, en evaluar el efecto de los tratamientos sombrío, semisombra y libre exposición sobre la producción de café.

En un estudio para evaluar el efecto de antioxidantes en la conservación de semen porcino, los tratamientos podrían ser vitamina E, quercetina y vitamina E + quercetina. El investigador puede elegir los tratamientos, de acuerdo con sus necesidades, sin que sea necesario que cada tratamiento esté restringido a una categoría básica del factor. No hay, por tanto, limitación alguna para definir un tratamiento a partir de la combinación de otros tratamientos, si se considerara que dicha estrategia es viable y promisoria.

En estudios más complejos, como aquellos que involucran sistemas silvopastoriles, cada uno de los tratamientos podría quedar definido con base en la conglomeración de los factores que caracterizan cada uno de los sistemas de interés; es decir que para la definición de cada tratamiento se tendría en cuenta cuáles son los componentes del sistema arbóreo, su densidad de siembra y distribución, el componente pastura, el componente animal, así como el manejo propio de cada sistema.

Debe tenerse presente, sin embargo, que un estudio con estas características tendría necesariamente una validez externa restringida. Las conclusiones serían aplicables únicamente a sistemas que reproduzcan de manera simultánea el conjunto de condiciones estructurales que definen cada uno de los arreglos evaluados. En consecuencia, la población de referencia no estaría constituida por “los sistemas silvopastoriles” en general, sino por aquellos que compartan integralmente la configuración específica considerada en el estudio.

Adicionalmente, si se encontraran diferencias entre los sistemas comparados, no sería posible atribuirlas con claridad a un componente particular. Al evaluarse configuraciones completas y no factores aislados, los efectos observados corresponderían al resultado conjunto de múltiples elementos que actúan de manera simultánea, lo que limita la capacidad de identificar la contribución individual de cada uno de ellos3.

En nutrición vegetal es común utilizar la técnica del elemento faltante, en la cual los tratamientos se definen mediante la sustracción del elemento cuyo efecto se desea evaluar. Un ensayo de esta índole podría considerar los siguientes tratamientos: completo, sin N, sin P, sin K, sin Ca, sin Mg, sin S y sin B. Desde luego, el conjunto de tratamientos podrá variar según la especie y el sustrato.

Para evaluar el efecto de un extracto de nim (Azadirachta indica) en el control del gusano cogollero (Spodoptera frugiperda), se consideran tres concentraciones en partes por millón: 1000, 2000 y 3000. En este caso, a diferencia de los descritos anteriormente, los tratamientos se definen con base en algunos valores de una variable numérica (concentración). No obstante, el método de análisis de los experimentos diseñados (cf. sección 6.2) no considera la información numérica que pudiera estar involucrada en la definición de los tratamientos y sus correspondientes etiquetas, pudiendo usarse cualquier otro juego de etiquetas, tal como c1, c2 y c3 o a, b, c, sin que ello afecte el resultado.

Con frecuencia, cada tratamiento surge de las combinaciones de los niveles de dos o más factores. Si en el ensayo para evaluar productividad en café, adicionalmente al factor manejo de la luz, se quisiera evaluar el factor densidad de siembra, con 2500 plantas/ha, 5000 plantas/ha y 10000 plantas/ha, los tratamientos estarían constituidos por las 6 combinaciones de los 2 niveles de manejo de la luz y los 3 niveles de densidad, así:

sombrío, 2500 plantas/ha

sombrío, 5000 plantas/ha

sombrío, 10000 plantas/ha

libre exposición, 2500 plantas/ha

libre exposición, 5000 plantas/ha

libre exposición, 10000 plantas/ha

Si en el mismo ensayo adicionalmente se quisieran evaluar 4 estrategias de fertilización, se tendrían \(2\times3\times4=24\) tratamientos. Esta situación se cubre en el capítulo 10.

6.1.6.1 Controles

Con el fin de establecer referentes de comparación, a menudo resulta conveniente, e incluso necesario, considerar uno o más tratamientos control —tradicionalmente denominados tratamientos testigo en experimentación agraria—, que pueden ser de varios tipos: positivos, negativos, absolutos o relativos.

Este tratamiento se incluye justamente cuando se requiera controlar la idoneidad de las condiciones experimentales, pues permite descartar fallas en la conducción del experimento en caso de que los demás tratamientos no generen la respuesta esperada. En tal sentido, contribuye a controlar posibles falsos negativos.

Así, por ejemplo, en los ensayos de susceptibilidad de plantas a algún patógeno, debe incluirse un material cuya alta susceptibilidad a la enfermedad evaluada sea conocida. Si el control positivo no manifestara los síntomas de la enfermedad, habría que reconsiderar la viabilidad de las cepas y/o los protocolos de inoculación.

Un ensayo en el que se evaluaran diferentes patógenos podría exigir varios controles positivos. Aunque el análisis de los resultados puede contemplar la comparación entre estos y los demás tratamientos, en muchas ocasiones —cuando la uniformidad de su respuesta puede generar dificultades para el cumplimiento de los supuestos del análisis de varianza (cf. sección 6.3)— se incluyen únicamente para verificar la idoneidad de las condiciones experimentales.

La inclusión de un control negativo facilita detectar el efecto de factores no previstos sobre la respuesta.

En pruebas médicas de diagnóstico, por ejemplo, es usual incluir como parte del ensayo general una muestra sobre cuya negatividad se tenga certeza. Un resultado positivo en dicha muestra evidenciaría fallas en la conducción del ensayo, ya sea por contaminación, por problemas con el reactivo o por cualquier otra circunstancia, lo que obligaría a descartar el material comprometido y a repetir las pruebas realizadas bajo tales condiciones.

Los controles negativos disminuyen la posibilidad de falsos positivos.

En un estudio en el que se evalúen diversas sustancias para inhibir el crecimiento de un microorganismo podrían incluirse varios controles negativos, según los sustratos o solventes utilizados. Con ello se descarta que los efectos observados puedan atribuirse a dichos sustratos o solventes.

En un ensayo de fertilidad, el control absoluto consistiría en no aplicar fertilizante. En un experimento sobre el manejo de una enfermedad en un cultivo, implicaría no aplicar intervención alguna.

En tales casos, los controles absolutos podrían brindar información relevante en etapas tempranas de la investigación, cuando se esté evaluando si se justifica aplicar fertilizante o implementar alguna estrategia de control de enfermedades.

No obstante, en etapas avanzadas de la investigación, cuando ya se tenga certeza de que el cultivo exige fertilización y requiere estrategias de manejo de enfermedades para evitar pérdidas significativas o incluso totales, no sería conveniente incluir controles absolutos.

En otros casos, los ensayos no admiten la inclusión de un control absoluto, dada la imposibilidad de observar el proceso bajo tales condiciones.

Así ocurre, por ejemplo, cuando se evalúan diferentes sustratos para el cultivo de un microorganismo, pues no es posible considerar un tratamiento que contemple su crecimiento sin medio de cultivo alguno.

En un ensayo de variedades, el control relativo sería la variedad más frecuentemente usada en una localidad determinada4.

Es muy importante que los ensayos incluyan controles relativos siempre que ello sea posible, puesto que estos constituyen el referente de comparación para los nuevos tratamientos.

Lógicamente, no todos los ensayos admiten controles relativos, en particular los correspondientes a los procesos de innovación, en los que no se cuenta con ningún referente.

Conviene advertir que las denominaciones anteriores no obedecen a un único criterio de clasificación ni constituyen categorías necesariamente excluyentes. Mientras que los controles positivos y negativos se definen en función del comportamiento esperado de la respuesta bajo determinadas condiciones experimentales, los controles absolutos y relativos se caracterizan por el tipo de intervención realizada o por su relación con la práctica habitual en la población objetivo. En consecuencia, un mismo tratamiento podría recibir distintas denominaciones según el aspecto que se desee resaltar, lo que dificulta la construcción de una tipología exhaustiva y mutuamente excluyente.

Dada la cantidad de controles o referentes que pueden surgir en un experimento, en ocasiones las denominaciones presentadas pueden quedarse cortas, e incluso hay casos en los que no resulta del todo claro cuál sea la denominación más adecuada.

Si en un estudio sobre la inhibición del crecimiento de un hongo mediante extractos bacterianos se incluyera un tratamiento en el que el hongo estuviera solo en el sustrato, sin extracto bacteriano alguno, ¿cómo habría de denominarse dicho tratamiento? ¿Control negativo, por cuanto al no aplicar extracto bacteriano no debería observarse inhibición en el crecimiento del hongo? ¿Control positivo, dado que el hongo se evalúa bajo las condiciones en las que debería crecer sin impedimento alguno?

Análogamente a lo recomendado por Letelier et al. (2004) en referencia a los estudios ciegos (cf. sección 6.1.2), consideramos que, en lugar de precisar o restringir las acepciones de las denominaciones presentadas —o de generar nuevas etiquetas— con la expectativa de que todos los usuarios de nuestras investigaciones adopten nuestros mismos criterios, resulta más conveniente explicar con claridad en qué consisten los tratamientos de control incluidos en un experimento.

De hecho, conviene recordar que, cualquiera que sea la denominación de tales grupos —o incluso si no reciben ninguna en particular—, estos son tratamientos, y en muchas ocasiones se analizan conjuntamente con los demás tratamientos.

Más allá de cualquier clasificación, los tratamientos control cumplen una función esencial: permiten aislar el efecto de interés frente a posibles factores de confusión.

Siempre que sea posible y pertinente, debería contemplarse su inclusión en el diseño experimental.

6.1.7 Unidad experimental

Cuando se evalúa un medicamento sobre un conjunto de pacientes, la unidad experimental es el paciente. Análogamente, si se suministra un tratamiento hormonal a un grupo de búfalas, la unidad experimental es cada búfala. Cuando se realiza una poda de raíz en árboles de café, la unidad experimental es cada árbol.

Aunque esta aproximación —en la que la unidad experimental es un individuo— es la más directa, no es la única posible. El hecho de que la denominación del concepto incluya el término unidad no convierte automáticamente a los individuos en unidades experimentales.

El aspecto clave que distingue a las unidades experimentales es la independencia de las respuestas que se evalúan en ellas.

En muchas ocasiones, la unidad experimental puede ser una fracción de lo que para otros fines se consideraría una unidad.

Este escenario es muy común en experimentos con plantas, en los que no necesariamente se toma el árbol completo como unidad experimental. Al evaluar podas aéreas, la unidad experimental podría ser una rama. En un ensayo de patogenicidad, la unidad experimental podría ser una hoja o una rodaja de hoja.

Aunque esta situación es menos común en animales o personas, en la sección 5.2.3, al hacer referencia a las muestras pareadas, se menciona una hipotética situación en la que se ensayan dos protectores solares de uso tópico, realizando sendas aplicaciones en los miembros superiores de un individuo. En tal caso, cada brazo del individuo constituye una unidad experimental.

En la evaluación de tres diluyentes para la criopreservación de semen bovino, podría dividirse el eyaculado de un toro en tres partes, para evaluar cada uno de los diluyentes en un tercio del eyaculado. En este caso, cada tercio del eyaculado constituye una unidad experimental.

En otras ocasiones, la unidad experimental surge de la integración de varios elementos. En ensayos agronómicos de campo, la unidad experimental suele estar constituida por un conjunto de plantas, denominado parcela. La unidad experimental en un ensayo de nutrición animal podría ser el grupo de animales en una jaula. Para los ensayos con insectos, la unidad experimental a menudo está conformada por un grupo de individuos. En los ensayos de viabilidad o de germinación suele tomarse un grupo de semillas como unidad experimental.

Existen varias razones para utilizar unidades experimentales conformadas por la integración de elementos. Para su análisis, a estas razones las denominaremos distribucionales, de validez externa, de previsión y de reducción de la variabilidad.

La razón distribucional consiste en establecer condiciones que propicien la convergencia a la distribución normal, en virtud del teorema central del límite (cf. teorema 3.1).

Cuando la aplicación del tratamiento da lugar a una respuesta binaria de cada uno de los elementos, (cf. sección 3.6.1), se hace necesario tomar un conjunto de tales elementos, de manera que la respuesta consistente en el número de éxitos del conjunto —que sigue una distribución binomial (cf. sección 3.6.2)— pueda aproximarse a la normal, posibilitando la aplicación de la técnica de análisis expuesta en la sección 6.2.

Una situación similar surge cuando la respuesta sobre cada elemento es de tipo Poisson, es decir, cuando se evalúa el número de eventos que se presentan en una región espacial o temporal, con independencia del número de eventos que puedan presentarse en cualquier otra región disjunta5, en particular, cuando el valor esperado de tales variables es pequeño, i. e., \(\lambda<5.\)

En general, siempre que se prevea que la distribución de las respuestas sobre los elementos individuales se aparte significativamente de la normal, será conveniente usar unidades experimentales conformadas por un grupo de elementos, analizando la respuesta media de tales unidades experimentales.

Otro criterio para usar unidades experimentales conformadas por conjuntos de elementos, incluso cuando no hay respuestas binarias, Poisson o de otro tipo diferente a la normal es la razón de validez externa.

Cuando la población objetivo está conformada por grupos de elementos cuyas respuestas puedan diferir de las que se obtendrían de los elementos aislados, se hace necesario trabajar con unidades experimentales que reproduzcan la dinámica de tales grupos.

Si un sistema de producción de gallinas ponedoras suele manejarse con base en una densidad de cinco gallinas por jaula, todo ensayo que se realice para evaluar el efecto de algún otro factor (dietas, por ejemplo), deberá estar basado en unidades experimentales conformadas por grupos de cinco gallinas en una jaula, con lo cual se propicia la validez externa, en lo que a densidad se refiere.

Lógicamente, si el factor que se desea evaluar es precisamente la densidad, esta habrá de modificarse acorde con los tratamientos.

En sistemas de producción agroindustriales, el rendimiento de las unidades productivas difiere del que se obtendría de sumar los rendimientos que generaría individualmente cada uno de los elementos que conforman dichas unidades al ser plantado aisladamente, debido a la competencia, el microambiente y otras interacciones que se generan al interior de las unidades productivas.

Consecuentemente, deben tomarse unidades experimentales en las que se reproduzcan tales condiciones. El tamaño de tales unidades experimentales o parcelas depende del tipo y la magnitud de tales interacciones, lo cual a su vez depende del tipo de cultivo, así como de la respuesta y los tratamientos que se evalúen.

La otra razón para usar unidades experimentales conformadas por un conjunto de elementos tiene que ver con la previsión de eventualidades. En consecuencia, la hemos denominado razón de previsión.

Cuando hay alta probabilidad de mortalidad o daño de los elementos durante el desarrollo del experimento, el uso de unidades experimentales conformadas por varios elementos puede proteger contra la pérdida de la unidad experimental.

En tales casos, debe analizarse si las causas de la mortalidad o daño de los elementos son imputables a los tratamientos o no. Si así fuera, esto tendría que verse reflejado en la respuesta de la unidad experimental, para lo cual podría tomarse, por ejemplo, la suma de las respuestas individuales. En caso contrario, podría tomarse la respuesta media de los elementos sobrevivientes.

Finalmente está la razón de reducción de la variabilidad. Las respuestas de las unidades experimentales conformadas por varios elementos presentan menor variabilidad que las lecturas de los elementos individuales. Esto se traduce en una mayor potencia de la prueba para comparación de medias (cf. sección 6.1.9).

El uso de unidades experimentales conformadas por un conjunto de elementos es una estrategia que conlleva varias ventajas:

Propicia la convergencia de las respuestas a la distribución normal

Incrementa la validez externa

Protege contra la eventual pérdida de elementos

Disminuye la variabilidad de las respuestas

6.1.7.1 Submuestreo

En ocasiones, puede ser recomendable o incluso necesario evaluar la respuesta sobre una muestra de cada unidad experimental, en lugar de hacerlo sobre la totalidad de esta.

Esta estrategia se presentó en el ejemplo 5.3, donde se muestreó cada una de las unidades muestrales; es decir, se muestreó la muestra. De ahí la denominación de submuestreo.

En el presente contexto, el conjunto de unidades experimentales sometido a un tratamiento es equivalente a las muestras mencionadas en el capítulo 5, por lo que igualmente se habla de submuestreo6.

Las lecturas de las subunidades se usan para estimar la respuesta de la correspondiente unidad experimental. Aunque con frecuencia se usa la media para tal fin, consideramos que la mediana puede resultar más adecuada en estas situaciones, dado que ofrece estimaciones más estables en presencia de valores extremos (cf. sección 2.1.1.2).

Un ejemplo de esta estrategia se da al realizar conteos de microorganismos. En tales casos, por la dificultad subyacente en contabilizar los microorganismos sobre toda la unidad experimental, se contabilizan las UFC en un número determinado de campos en la unidad experimental y se toma la media o la mediana de dichas lecturas.

La estrategia del submuestreo podría parecer contraria a la de usar unidades experimentales conformadas por la integración de elementos (cf. sección 6.1.7). No obstante, el hecho de que en un experimento se utilicen unidades experimentales constituidas por varios elementos no implica que sea necesario evaluar la totalidad de estos, en particular si dicha estrategia se usa para propiciar la validez externa o para mantener el balance ante la eventual pérdida de elementos7.

Así, al evaluar un tratamiento para el control de una plaga en un cultivo, resulta conveniente que las unidades experimentales sean parcelas que reproduzcan las condiciones en las que suele presentarse la plaga y en las que se aplicaría el tratamiento en la población objetivo (validez externa). No obstante, dado lo dispendioso que puede resultar el registro de la respuesta en todos los elementos que conforman cada unidad experimental, puede recurrirse al muestreo para estimar la respuesta de interés en cada una de ellas.

Al realizar submuestreo, es preferible usar la mediana como estimador de la respuesta en la unidad experimental, dada su robustez frente a valores extremos.

6.1.8 Replicación y conceptos afines

La replicación ha sido reconocida como un principio central de la experimentación científica desde la primera mitad del siglo xx, con la consolidación de la estadística aplicada al diseño de experimentos.

Una afirmación realizada en 1930 por Fisher y Wishart, reproducida por Hurlbert (1984), lo expresa con claridad:

En la actualidad a nadie se le ocurriría evaluar la respuesta a un tratamiento mediante la comparación de dos parcelas: una tratada y la otra sin tratar.

Esta aseveración resulta fácil de asimilar en el escenario planteado: en un ensayo de campo, si se observaran diferencias (o la ausencia de estas) entre dos parcelas, no sería posible discernir si obedecen al tratamiento o a otros factores que podrían diferir entre las parcelas —como el microclima, los suelos, el drenaje, la microbiota, el nivel de fertilidad o el historial de manejo—, o bien a la combinación de estos con el tratamiento.

Además, con una sola parcela por condición (tratamiento/sin tratamiento) no sería posible determinar si las respuestas observadas representan el comportamiento típico bajo tales condiciones o si corresponden a casos extremos. En otras palabras, sin replicación no sería posible valorar la consistencia de las respuestas.

La replicación proporciona una base sólida para estimar la variabilidad inherente a los sistemas estudiados, permitiendo realizar comparaciones confiables entre tratamientos.

En ausencia de replicación, los resultados de un ensayo carecen del sustento necesario para ser interpretados con rigor científico.

La replicación es el concepto; las réplicas son los valores específicos mediante los cuales se cristaliza este concepto para cada tratamiento.

Si en un experimento cada tratamiento se asigna de manera independiente a tres unidades experimentales, se considera que dicho tratamiento tiene tres réplicas. Si un tratamiento se aplicara a una única unidad experimental, tendría una réplica; sin embargo, en tal caso no existiría replicación del tratamiento.

No existe consenso sobre la diferencia —si es que la hay— entre réplica y repetición. Algunos autores presentan un único concepto, definiéndolo mediante uno de estos términos. Otros, que también conciben un único concepto, utilizan indistintamente ambos términos como sinónimos. Hay quienes proponen dos conceptos claramente diferenciados, e incluso quienes lo hacen, pero invirtiendo las correspondencias entre las definiciones y los términos.

Puesto que lo relevante es el concepto, más que el término, en el presente texto se utiliza el término réplica, sin descalificar otras denominaciones o distinciones.

La construcción de intervalos de confianza exige contar con réplicas. Entre más réplicas se tengan, mayor será la precisión de los intervalos y la potencia de las comparaciones.

Además de las réplicas de cada tratamiento, el experimento completo también puede replicarse, ya sea por diferentes investigadores, en diferentes momentos o lugares, y utilizando diferente material experimental. De ahí surge el concepto de replicabilidad.

La falta de replicabilidad de un ensayo no necesariamente implica sesgo o alteración de los resultados por parte del investigador, pudiendo deberse a condiciones particulares que rodearon el experimento inicial. Sin embargo, constituye una seria limitación, pues impide fundamentar aplicaciones o implementaciones a partir de las conclusiones originales.

Cuando la replicabilidad de un experimento se pone en duda, el alcance de sus conclusiones queda automáticamente limitado, por más significativos que hayan podido ser los resultados.

La repetibilidad es un concepto estrechamente relacionado con el de replicabilidad, pero circunscrito a condiciones más controladas.

La falta de repetibilidad indicaría que las diferencias observadas (o ausencia de estas) en algunos de los ensayos —o quizá en todos— son manifestaciones de factores aleatorios no controlados.

La falta de repetibilidad entre ensayos obligaría a una reconceptualización teórica, no siendo adecuado fundamentar ninguna acción en los resultados de algún ensayo particular.

Cuando un experimento no logra ser repetible, la confianza en sus resultados queda comprometida.

Para que las conclusiones de una serie de ensayos sean generalizables, es indispensable que sean consistentes entre sí.

Aunque el concepto de reproducibilidad no se asocia directamente con la fase experimental, sino más bien con el análisis de los datos, se incluye en esta sección para establecer un paralelo con los conceptos presentados anteriormente.

En ocasiones, la falta de reproducibilidad es debida a la no disponibilidad de los datos originales o del código utilizado para el procesamiento de la información.

En tales casos, los resultados carecen de transparencia.

La tabla 6.1 sintetiza la idea central de la replicación junto con los conceptos afines discutidos en esta sección. La concurrencia de estos criterios le confiere confianza, alcance, fiabilidad y trasparencia a la experimentación estadística.

| Concepto | Idea central | Lema asociado |

|---|---|---|

| Replicación | Evaluar cada tratamiento varias veces en unidades independientes para estimar la variabilidad y permitir comparaciones confiables | ¡Sin replicación, no hay experimentación estadística! |

| Réplicas | Número de unidades experimentales independientes en las que se evalúa cada tratamiento | ¡Sin réplicas, no hay confianza! |

| Replicabilidad | Consistencia de los resultados cuando el experimento completo se repite en otros contextos (investigadores, lugares, momentos, material) | ¡Sin replicabilidad, no hay alcance! |

| Repetibilidad | Consistencia de los resultados cuando el experimento se repite bajo las mismas condiciones (mismo lugar, equipos, técnicos, material comparable) | ¡Sin repetibilidad, no hay fiabilidad! |

| Reproducibilidad | Posibilidad de obtener los mismos resultados numéricos al repetir un análisis sobre los mismos datos, incluso con otro analista o software | ¡Sin reproducibilidad, no hay trasparencia! |

6.1.9 Error experimental

La denominación de este concepto es un tanto desafortunada, puesto que puede hacer pensar en fallas asociadas con la conducción del experimento o en los tipos de error propios de las pruebas de hipótesis (cf. tabla 3.4).

No obstante, el error experimental se refiere a variabilidad, acorde con lo presentado en la sección 2.1.2.1.

Desde un punto de vista conceptual —e incluso operacional—, el error experimental es un promedio ponderado de las varianzas dentro de cada tratamiento.

El error experimental puede verse como una generalización de la varianza combinada, \(S^2_\text{p},\) usada como estimador de la varianza común de dos poblaciones normales cuyas medias se comparan mediante una prueba de \(t\) (cf. expresión 5.3).

La expresión equivalente a \(S^2_\text{p}\) para calcular el error experimental en un ensayo con \(k\) tratamientos y \(r_i\) réplicas para el \(i\)-ésimo tratamiento es la siguiente:

\[

\text{EE}=\frac{(r_1-1)S_1^2+(r_2-1)S_2^2+\dotsb+(r_k-1)S_k^2}

{\sum\limits_{i=1}^{k}r_i-k}

\tag{6.1}\]

Si bien el error experimental es equivalente —tanto en lo conceptual como en lo operacional— a la varianza combinada, \(S^2_\text{p},\) presentada en la sección 5.2.1.1, la expresión 6.1 rara vez se utiliza para su cálculo. En la sección 6.2.3 se presenta una estrategia operacional más práctica para su obtención (cf. nota 6.2).

No obstante, la expresión 6.1 permite visualizar lo que representa el error experimental, facilitando analizar cuáles son sus fuentes y qué estrategias pueden seguirse para su control.

En la sección 6.1.8 se indicó que la replicación es necesaria para valorar la consistencia de las respuestas asociadas con cada tratamientos. Esta consistencia —entendida como la similitud entre las respuestas de diferentes unidades experimentales sometidas a un mismo tratamiento— se mide a través de la varianza dentro de cada grupo, es decir, el error experimental.

De este modo, la noción intuitiva de consistencia introducida anteriormente adquiere una formulación matemática: sin replicación no sería posible estimar dicha varianza y, por tanto, no sería posible valorar la consistencia de las respuestas.

Mientras menor sea el error experimental, más consistentes serán los resultados y menor será la incertidumbre de los procesos inferenciales. Por el contrario, una alta variación en las respuestas dentro de un mismo tratamiento denota una menor consistencia y, por tanto, una incertidumbre mayor en los procesos inferenciales.

El análisis de varianza, la técnica inferencial que se presenta en la sección 6.2, supone que las respuestas a los diferentes tratamientos presentan una misma consistencia, lo que se expresa como el supuesto de homogeneidad de varianzas (cf. sección 6.3.3).

Si dicho supuesto es válido, también resulta válido obtener una estimación de la variabilidad promedio dentro de los tratamientos, usando la expresión 6.1.

El error experimental constituye el referente de la consistencia, precisión o variabilidad interna de los tratamientos, y permite valorar la incertidumbre de las inferencias que se realizan sobre las medias poblacionales a partir de los resultados de un experimento.

Un error experimental bajo produce estimaciones más precisas.

6.1.10 Papel de las réplicas

La precisión de las estimaciones no solo se ve afectada por la magnitud del error experimental, sino también por el número de réplicas. A mayor número de réplicas, mayor será la precisión de las estimaciones.

Considérese un intervalo de confianza del \(100(1−\alpha)\,\%\) para la diferencia entre dos medias, \(\mu_1 − \mu_2,\) cuando se tienen varianzas homogéneas, el cual está dado por la siguiente expresión (cf. expresión 5.6):

\[

\left(\overline{X}_1-\overline{X}_2\right)\pm t_{\alpha/2\left(n_1+n_2-2\right)}

\sqrt{S_\text{p}^2\left(\frac{1}{n_1}+\frac{1}{n_2}\right)}

\]

En el contexto de los experimentos diseñados, un intervalo de confianza equivalente para la diferencia de medias de dos tratamientos está dado por la siguiente expresión (cf. sección 8.4.1):

\[

\left(\overline{Y}_{1\bullet}-\overline{Y}_{2\bullet}\right)\pm t_{\alpha/2\left(\text{gle}\right)}

\sqrt{\text{CME}\left(\frac{1}{r_1}+\frac{1}{r_2}\right)}

\]

Nótese que las réplicas de los tratamientos (\(r_1\) y \(r_2\)), equivalentes a los tamaños de muestra (\(n_1\) y \(n_2\)), aparecen en el denominador del término que se suma y se resta a la diferencia de medias muestrales para construir el intervalo. Consecuentemente, para un error experimental dado (representado por \(\text{CME}\): cf. sección 6.2), mientras mayor sea el número de réplicas, más estrechos serán los intervalos de confianza, es decir que las inferencias serán más precisas.

Dada la relación existente entre intervalos de confianza y pruebas de hipótesis (cf. sección 4.5), un mayor número de réplicas implica una mayor potencia en las comparaciones; es decir, se hace más probable declarar diferencias significativas que correspondan con diferencias reales entre las medias poblacionales.

En general, a mayor número de réplicas, mayor será la precisión en las estimaciones y mayor será la potencia de las pruebas.

Aunque la precisión de las estimaciones y la potencia son características deseables, el incremento en el número de réplicas también implica, en general, tiempos de experimentación más largos, costos más elevados y mayores dificultades operativas que pueden traducirse en errores de manejo del experimento y de registro de la información.

En consecuencia, el número de réplicas de un experimento es un aspecto que debe definirse conjuntamente entre el estadístico y el investigador, considerando las particularidades del ensayo y buscando la máxima eficiencia posible. En la ?sec-mead se presentan algunas pautas para ello.

6.1.11 Aleatorización

La aleatorización es exclusiva de los estudios experimentales, no solo porque su definición involucra los conceptos de tratamientos y unidades experimentales, sino también por la dificultad de realizar una acción equivalente en los estudios observacionales.

Aun si se adapta el lenguaje —tomando los diferentes niveles del factor en los estudios observacionales como equivalentes de los tratamientos, y las unidades observacionales como equivalentes a las unidades experimentales—, en los estudios observacionales sigue siendo inviable realizar una asignación al azar de los diferentes niveles del factor sobre las unidades observacionales.

Esta imposibilidad o dificultad en la manipulación de los niveles del factor para asignarlos sobre las unidades es lo que caracteriza los estudios observacionales. En la sección 6.1.1 se ilustró esta limitación al considerar un ensayo para respaldar la hipotética relación entre el hábito de fumar y el cáncer gástrico, donde, por obvias razones, no era posible intervenir el grupo de participantes, definiendo quiénes habrían de fumar y quiénes no.

La aleatorización constituye el principal mecanismo de los estudios experimentales para controlar potenciales factores de confusión. Gracias a ella, los estudios experimentales gozan, en general, de mayor validez interna que los estudios observacionales.

Mediante la aleatorización se espera que, en caso de que existan factores secundarios asociados con las unidades experimentales que puedan tener efecto sobre la respuesta, sus niveles queden repartidos entre los diferentes grupos.

En el hipotético experimento mencionado en la sección 6.1.2, consistente en evaluar el efecto de la exposición al humo de tabaco sobre el cáncer gástrico en ratas de laboratorio, supóngase que se cuenta con 20 ratas. Un posible experimento consiste en someter 10 de esas ratas —elegidas al azar— a la inhalación de humo de tabaco, dejando las otras 10 como grupo control, sin inhalación.

Un correcto mecanismo de aleatorización debe garantizar que cualquiera de las 20 ratas tenga exactamente la misma probabilidad de ser asignada a cualquiera de los dos grupos experimentales. Con esto se espera que, en caso de existir factores genéticos que hagan que algunos individuos sean más propensos que otros a desarrollar el cáncer gástrico, los niveles de tales factores queden distribuidos al azar entre los dos grupos, disminuyendo la posibilidad de que actúen como factores de confusión.

Desde un punto de vista didáctico, una de las mejores maneras de ilustrar el proceso de aleatorización consiste en enumerar las ratas de 1 a 20. Paralelamente, se generan etiquetas equivalentes en cartones u otro soporte físico, que se introducen en un recipiente que impida su visualización. A continuación, se extraen 10 de tales etiquetas al azar; las correspondientes ratas se asignan a uno de los grupos y las demás ratas se asignan al otro grupo.

Lógicamente, este proceso puede ser poco práctico, especialmente en experimentos grandes. Durante mucho tiempo fueron muy populares las tablas de números aleatorios, con base en las cuales se realizaban los procesos de aleatorización. En la actualidad, tales procesos suelen realizarse con alguna ayuda informática.

En R se usa la siguiente instrucción para seleccionar 10 números diferentes del 1 al 20. ¡Compruébelo!

sample(1:20, 10)Si se estuviera diseñando un experimento con base en la técnica del elemento faltante, usando los 8 tratamientos descritos en la sección 6.1.6, con cuatro réplicas por tratamiento, se requerirían 32 unidades experimentales.

La aleatorización podría estar basada en los resultados de ejecutar la siguiente instrucción en R, asignando el primer tratamiento a las unidades identificadas con los cuatro primeros números generados, el segundo tratamiento a las cuatro siguientes y así sucesivamente hasta aplicar todos los tratamientos sobre las unidades experimentales.

sample(1:32, 32)Los escenarios anteriores ejemplifican una de las modalidades de la aleatorización: aleatorización en la asignación de los tratamientos sobre las unidades experimentales. Esta modalidad se corresponde con lo expresado en la definición 6.16.

En ensayos agronómicos en los que se tiene la parcela como unidad experimental, el proceso de aleatorización queda reflejado en la disposición espacial de las parcelas. Se le denomina, por tanto, aleatorización espacial.

Supóngase que se desean evaluar cuatro tratamientos \((\text{A},\) \(\text{B},\) \(\text{C}\) y \(\text{D}),\) con tres réplicas, para lo cual se requieren 12 parcelas. El esquema más equilibrado consiste en asignar cada tratamiento a 3 unidades experimentales al azar, tal y como se ilustra en la figura 6.3.

Los ensayos de campo exigen particular atención, por las diferencias en microclima, fisiografía y suelos que pueden existir entre las parcelas. Se espera que la magnitud de tales diferencias sea directamente proporcional a la distancia, es decir, que estas diferencias sean más marcadas entre parcelas distantes que entre parcelas vecinas, dando lugar a un gradiente.

Cuando no se sabe si tales condiciones cambiantes están presentes, y mucho menos el gradiente o dirección de máximo cambio de estas, la aleatorización espacial, consistente en distribuir las unidades experimentales al azar en el espacio disponible, evita que tales gradientes, en caso de existir, favorezcan o desfavorezcan algún tratamiento particular.

En tal sentido, la aleatorización espacial protege contra posibles factores de confusión asociados con la posición de la unidad experimental.

Si en el ensayo agronómico que se ilustra en la figura 6.3 hubiese algún gradiente (pendiente, fertilidad, humedad, profundidad efectiva, densidad del suelo, radiación solar, etc.) que resultara favorable para las unidades ubicadas a la izquierda y desfavorable para las ubicadas a la derecha8, este afectaría aleatoriamente algunas réplicas de algunos tratamientos, sin sesgar el resultado.

Este efecto protector de la aleatorización contra posibles factores de confusión no se tendría si los tratamientos estuvieran ordenados, quedando, por ejemplo, las tres réplicas del tratamiento \(\text{A}\) en la primera columna, las de \(\text{B}\) en la segunda, etc.

La aleatorización espacial también protege contra el sesgo por alteraciones externas que, sin estar intrínsecamente asociadas con la posición de la unidad experimental, pueden aparecer en una dirección determinada. Este sería el caso, por ejemplo, de vientos que soplaran en una dirección determinada o algún foco de una plaga o enfermedad que surgiera en un punto dado.

Aunque la posibilidad de gradientes o cambios asociados con la posición de las unidades experimentales es mayor en ensayos de campo que en ensayos de invernadero o de laboratorio, en estos últimos pueden actuar factores de confusión más sutiles, como la intensidad de la luz, la aireación, la temperatura o la humedad relativa, manteniéndose presente, además, la posibilidad de alteraciones por factores externos, tales como la contaminación.

Consecuentemente, estos ensayos, así como cualquier otro en el que las unidades experimentales ocupen una posición fija, también deben someterse a un proceso de aleatorización espacial, con el fin de controlar posibles factores de confusión asociados con la posición de las unidades experimentales.

En muchos experimentos, las unidades experimentales, a pesar de no estar fijas en un primer momento, como las parcelas en los ensayos de campo, van a ocupar una posición fija una vez se inicie el ensayo. Este sería el caso de unidades experimentales conformadas por macetas, bolsas, bandejas y cajas de petri, entre otras.

En tales casos, también es necesario realizar aleatorización espacial. Sería muy pobre el control sobre los factores de confusión si el investigador se limitara a aleatorizar la asignación de los tratamientos sobre las unidades experimentales, ubicando luego las unidades experimentales de manera ordenada, con todas las réplicas de un mismo tratamiento contiguas entre sí.

Lógicamente, la aleatorización espacial solo es aplicable cuando las unidades experimentales ocupan una posición fija durante el desarrollo del experimento.

Si se consideran, por ejemplo, los ensayos con animales que no están sometidos a confinamiento, la aleatorización se aplica únicamente al momento de asignar los tratamientos a las unidades experimentales disponibles. Durante el desarrollo del experimento, los animales podrán desplazarse, acorde con el manejo dispuesto para estos.

En muchos ensayos, particularmente en los que dependen de equipos para su realización, no es posible realizar todas las corridas experimentales simultáneamente.

En tales casos, se calibra el equipo a las condiciones exigidas por un tratamiento, se realiza el proceso experimental y finalmente se toma la lectura de la variable o variables respuesta. Una vez finalizada esta corrida experimental, se recalibra el equipo para las condiciones experimentales de una segunda corrida y se repite todo el proceso hasta concluir todas las corridas experimentales.

En tales casos, es necesario realizar una aleatorización temporal, es decir, ejecutar las corridas en un orden aleatorio, de manera que se controlen los posibles factores de confusión asociados con el tiempo.

A pesar de ser muchos los factores secundarios que pueden variar a lo largo del tiempo, estos pueden agruparse en las siguientes categorías: condiciones medioambientales, condiciones imputables al equipo o instrumento y condiciones asociadas con el evaluador. La variabilidad de tales factores depende de la duración del ensayo y de las características del mismo.

El potencial de las condiciones medioambientales para actuar como factores de confusión es especialmente alto en campo, en invernaderos o en galpones. No obstante, tales condiciones también podrían alterar algunos ensayos de laboratorio.

Los equipos y herramientas pueden verse afectados por el desgaste acumulativo de piezas o componentes, dando lugar a variaciones sistemáticas9 en los resultados.

Cuando las lecturas pueden verse afectadas por el criterio, la pericia, el entrenamiento o el cansancio que el operario va acumulando a lo largo del tiempo, tales factores también pueden aportar confusión.

En cualquier caso, se espera que las corridas experimentales más cercanas en el tiempo compartan condiciones más homogéneas de los factores secundarios que aquellas más distantes en el tiempo. Por tal motivo, debe evitarse la contigüidad temporal de las diferentes réplicas de cada tratamiento.

Mediante la aleatorización temporal se busca romper cualquier posible asociación entre los tratamientos y los factores secundarios asociados con el tiempo, evitando que estos actúen como factores de confusión.

La tabla 6.2 resume los diferentes tipos de aleatorización y la protección que ofrecen.

| Tipo | Protección |

|---|---|

| Aleatorización en la asignación de los tratamientos sobre las unidades experimentales | Contra factores de confusión asociados con las unidades experimentales |

| Aleatorización espacial | Contra factores de confusión asociados con la posición de las unidades experimentales |

| Aleatorización temporal | Contra factores de confusión asociados con el momento de ejecución |

Todos los estudios experimentales deben someterse a los tipos de aleatorización que les sean aplicables, acorde con su naturaleza.

El primer paso de aleatorización generalmente consiste en asignar los tratamientos de manera aleatoria sobre las unidades experimentales disponibles. Un segundo paso puede consistir en una aleatorización espacial o temporal.

En ocasiones, los niveles del factor son inherentes a las unidades experimentales, lo que impide realizar el proceso de aleatorización.

Cuando se evalúa, por ejemplo, el efecto del factor sexo sobre una respuesta cualquiera, no es posible partir de un grupo de unidades experimentales asexuadas, asignándole al azar un nivel del factor sexo (macho o hembra) a cada una de ellas. Lo mismo sucede cuando se evalúan razas, variedades, clones, cepas o cualquier otra característica intrínseca a la unidad experimental.

¡Exactamente!

La aleatorización es un mecanismo propio de los estudios experimentales. Si no es posible realizar una asignación aleatoria de los tratamientos sobre las unidades experimentales, se trata de un estudio observacional.

No obstante, este aspecto suele pasar desapercibido, dado que el modelo de análisis es el mismo que se emplea para los estudios experimentales.

Shadish, Cook y Campbell (2002) definen los cuasiexperimentos como ensayos que comparten propósitos y detalles estructurales con los experimentos, diferenciándose de estos únicamente en la falta de aleatorización.

Aunque resulta tentador aplicar esta denominación a los ensayos descritos anteriormente, Shadish et al. (2002) conceptualizan los cuasiexperimentos en el contexto de las ciencias sociales, mencionando como posibles causas para la ausencia de aleatorización el hecho de que los individuos que participan en el ensayo se autoseleccionen en alguno de los grupos de interés o que sean asignados de manera subjetiva por el administrador del experimento, quien decide cuáles individuos han de recibir cada tratamiento.

Esta situación difiere de la descrita anteriormente, en la que no se trata de fallas o limitaciones en el proceso de aleatorización, sino de una imposibilidad estructural de aplicarla. En tal sentido, no encontramos conveniente denominarlos cuasiexperimentos.

En los estudios cuasiexperimentales descritos por Shadish et al. (2002) existe la posibilidad de un sesgo de selección que actúe como factor de confusión, por lo que estos estudios presentan, en general, menor validez interna que los estudios experimentales.

Los estudios en los que los tratamientos son inherentes a las unidades experimentales —aunque son observacionales10— no son susceptibles al sesgo de selección y suelen realizarse en condiciones más controladas que las de muchos otros estudios observacionales, por lo que su validez interna suele ser comparable a la de los estudios experimentales, con posible disminución en su validez externa.

Aunque, en los casos descritos, la imposibilidad de aleatorizar podría suplirse mediante la obtención de muestras aleatorias de las correspondientes poblaciones objetivo, esto tampoco se cumple en la práctica.

Una muestra verdaderamente aleatoria de los machos y las hembras de una especie determinada exigiría contar con un marco de muestreo de la población objetivo, en el que cada individuo tuviera la misma probabilidad de ser seleccionado. Desde luego, esto es igualmente irrealizable.

En la práctica se trabaja con muestras disponibles, es decir, con los animales que se tengan en la estación experimental, con el material vegetal que pueda adquirirse o con las cepas con las que cuente el laboratorio, según sea la naturaleza del ensayo.

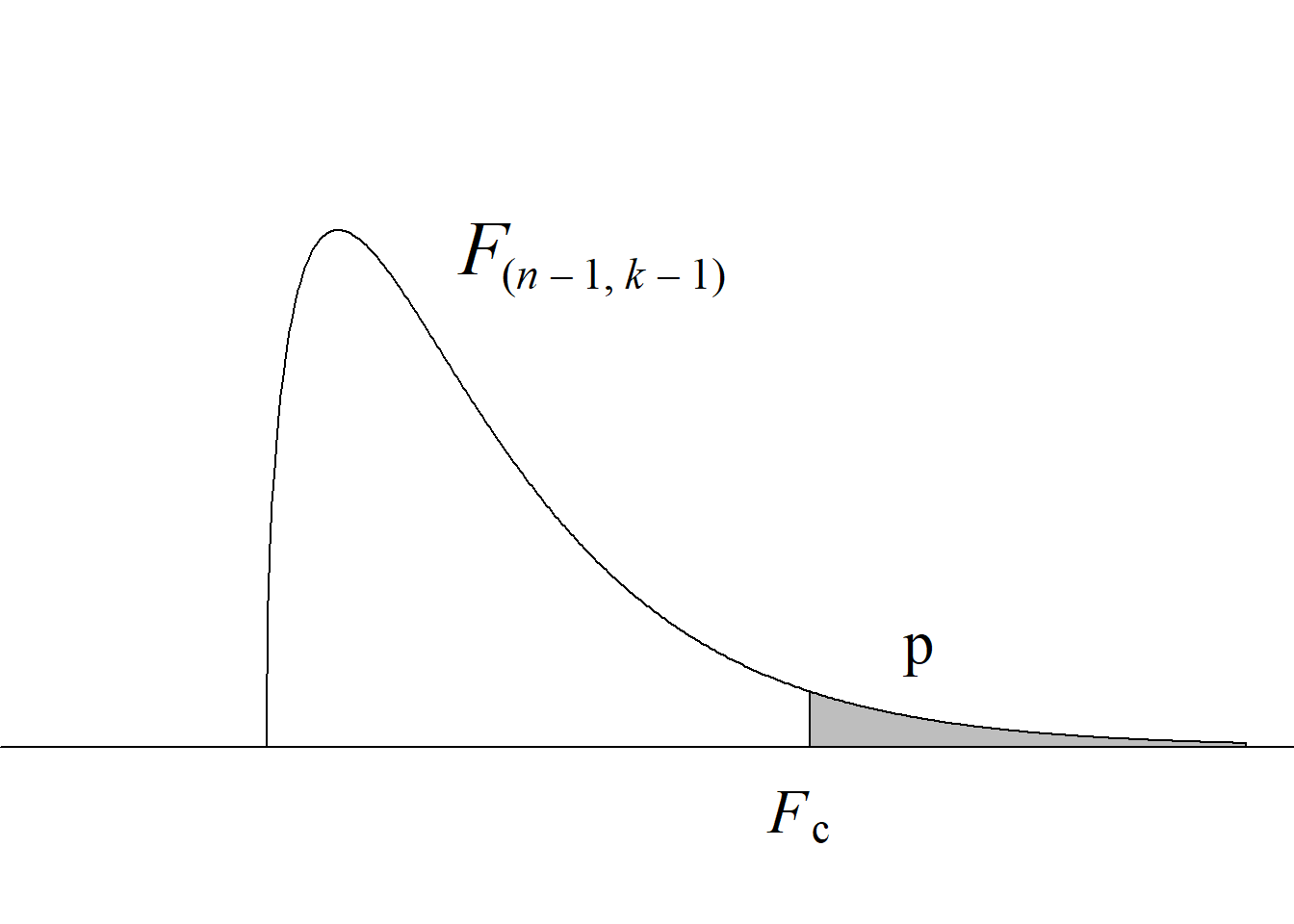

En estos casos, es necesario analizar a profundidad si el material experimental disponible sí representa plenamente las características de las poblaciones objetivo; de no ser así, la validez externa quedaría comprometida.