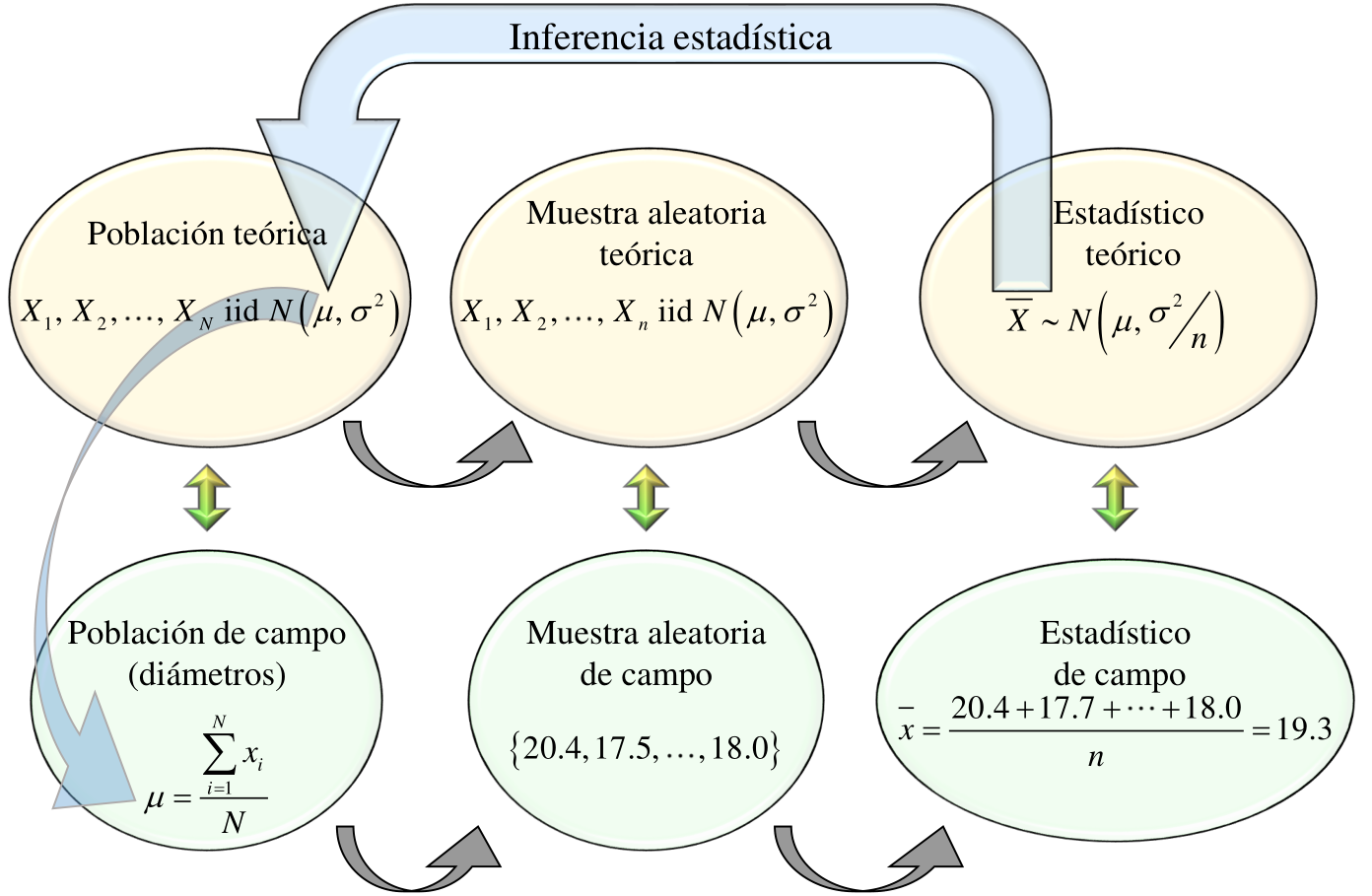

3 INFERENCIA ESTADÍSTICA

La inferencia constituye el eje central de las técnicas estadísticas aplicadas a la investigación científica. Son los métodos inferenciales los que hacen posible generalizar la información obtenida a partir de una o más muestras hacia las correspondientes poblaciones de referencia.

Aunque la inferencia estadística se sustenta en constructos matemáticos, estos no constituyen un fin en sí mismos. Su papel es modelar probabilísticamente los datos obtenidos en campo o en el laboratorio y la manera en que dichos datos se vinculan —a través del modelo— con la población de interés, que es, en última instancia, el objetivo central de cualquier investigación aplicada.

En este sentido, y sin entrar aún en los mecanismos internos que la gobiernan, la inferencia estadística puede entenderse como el conjunto de herramientas que permiten extender los hallazgos muestrales a la población de referencia, bajo un control explícito de la incertidumbre asociada a dicho proceso.

Dado que la inferencia estadística está basada en conceptos probabilísticos, se hace necesario realizar algunas elaboraciones previas al respecto. Aunque se trata de una temática amplia, las elaboraciones que aquí se desarrollan se concentran exclusivamente en aquellos aspectos que sirven de fundamento a los métodos inferenciales, dejando deliberadamente de lado otros aspectos que pueden consultarse en textos especializados en probabilidad, como el de Blanco (2010).

Como antesala a la introducción formal de la probabilidad, se presentan algunos elementos básicos que sustentan las construcciones probabilísticas empleadas en la inferencia estadística. Una vez establecido este marco, el capítulo aborda algunas distribuciones de probabilidad frecuentemente utilizadas como base de los métodos inferenciales, para culminar con la presentación de las dos formas fundamentales de la inferencia estadística: la estimación y las pruebas de hipótesis.

3.1 Experimento aleatorio

Experimento 1: Lanzar un dado y anotar el resultado.

Experimento 2: Extraer una carta de la baraja y registrar el palo (símbolo).

Experimento 3: Revisar el envés de una hoja y anotar el número de larvas de un insecto.

Experimento 4: Inocular esporas de un hongo en PDA, usando una caja de Petri de 9 cm de diámetro, y evaluar su crecimiento al sexto día.

Todas las descripciones anteriores corresponden a experimentos aleatorios, por cuanto los resultados que estos generan no pueden determinarse antes de haber ejecutado el experimento.

Los dos primeros ejemplos siguen la línea clásica, en la que la probabilidad suele estar asociada con los juegos de azar. Esto se explica por el hecho de que fueron justamente los juegos de azar los que llevaron a grandes pensadores franceses del siglo xvii como Blaise Pascal y Pierre de Fermat a sentar las bases de la teoría matemática de la probabilidad.

Aunque dicha teoría, alimentada con los desarrollos posteriores, sigue vigente y aún se utiliza para resolver no solo problemas relacionados con juegos de azar, sino también otros fenómenos con igual comportamiento probabilístico, son los dos últimos ejemplos los que mejor reflejan los experimentos que usualmente conciernen a la investigación aplicada.

3.2 Espacio muestral

Al espacio muestral se le denota con la letra \(S\) (sample space).

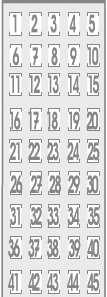

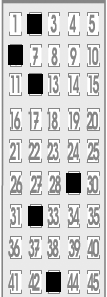

Considérese el experimento aleatorio consistente en lanzar un dado y registrar el resultado. El correspondiente espacio muestral podría quedar definido de la siguiente manera:

\[ S_{1\text{A}}=\{⚀, ⚁, ⚂, ⚃, ⚄, ⚅\} \]

Este sería el espacio muestral para el más común de los dados, el cual consta de seis caras marcadas con uno, dos, tres, cuatro, cinco o seis puntos. No obstante, existen dados que se apartan de dicho estándar, pudiendo tener cualquier marca en sus caras e incluso un número de caras diferente de seis.

El espacio muestral para un hipotético dado de ocho lados marcado con las primeras ocho letras del alfabeto griego sería el siguiente:

\[ S_{1\text{B}}=\{\alpha, \beta, \gamma, \delta, \varepsilon, \zeta, \eta, \theta\} \]

Al lanzamiento de un dado de seis caras marcado con números del 1 al 6 le correspondería el siguiente espacio muestral:

\[ S_{1\text{C}}=\{1, 2, 3, 4, 5, 6\} \]

Para el experimento que consiste en extraer una carta de la baraja y registrar el palo, el espacio muestral dependerá del tipo de baraja. Suponiendo que se trate de la baraja inglesa, se tendría un espacio muestral conformado por los elementos: pica, corazón, trébol y diamante, ya sea representados a través de sus nombres o de sus símbolos.

\[ S_{2}=\{\spadesuit, \, \large \color{red}♥ \normalsize \color{black} ,\, \clubsuit, \, \large \color{red} ♦\color{black}\normalsize\} \]

El espacio muestral para el experimento aleatorio consistente en revisar el envés de una hoja y anotar el número de larvas de un insecto es:

\[ S_{3}=\{1, 2, 3,...\} \]

Para el experimento consistente en inocular esporas de un hongo en PDA, usando una caja de Petri de 9 cm de diámetro, se tiene el siguiente espacio muestral:

\[ S_{4}=\{x\,|\,0\le x \le9\} \]

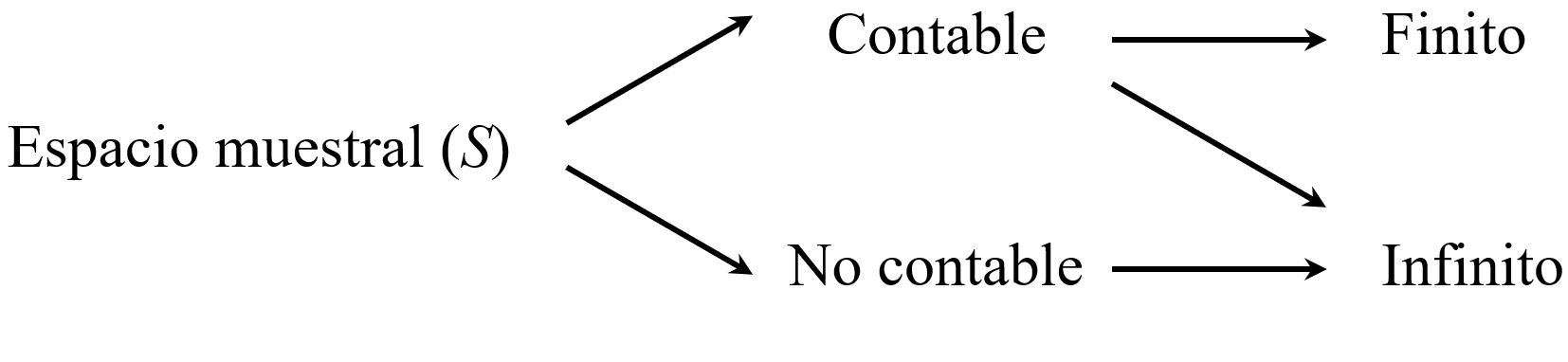

Tal y como se observa en los anteriores ejemplos, los espacios muestrales pueden ser de diferente naturaleza: los hay contables y no contables y también los hay finitos e infinitos.

Los espacios muestrales \(S_{1\text{A}},\) \(S_{1\text{B}},\) \(S_{1\text{C}},\) \(S_{2}\) y \(S_3\) son contables, puesto que es posible enumerar cada uno de sus elementos. El espacio muestral \(S_4\) es no contable; ante la imposibilidad de enumerar todos los elementos, estos se definen mediante una regla. La definición del espacio muestral \(S_4\) se lee como el conjunto de todos los valores de \(x,\) tales que \(x\) sea mayor o igual que cero y menor o igual que 9.

Por otra parte, los primeros cuatro espacios muestrales son finitos: \(S_{1\text{A}}\) tiene \(6\) elementos; \(S_{1\text{B}}, 8;\) \(S_{1\text{C}}, 6\) y \(S_2, 4.\) Los dos últimos espacios muestrales son infinitos.

Conviene detenerse en el espacio muestral \(S_3,\) el cual, aun siendo contable, es infinito. En este caso, los posibles resultados del experimento pueden enumerarse uno a uno, pero no existe un valor máximo que —desde el punto de vista teórico— limite el número de larvas que podrían observarse.

Aunque en la práctica una hoja no pueda albergar un número arbitrariamente grande de larvas, esta restricción es de naturaleza empírica y no define el espacio muestral. No es posible establecer un número \(M\) tal que resulte imposible observar más de \(M\) larvas en todos los casos. En ausencia de un límite superior bien definido, el conjunto de resultados posibles debe considerarse infinito. En situaciones como esta, el espacio muestral se clasifica como contable e infinito.

Por su parte, \(S_4\) ejemplifica un espacio muestral no contable, el cual no consta de una serie de elementos individualizables, sino de todos los posibles valores en un intervalo o segmento de línea. Todos los espacios muestrales no contables son infinitos.

Los espacios muestrales pueden ser contables o no contables. Los espacios muestrales contables pueden ser finitos o infinitos. Todos los espacios muestrales no contables son infinitos (figura 3.1).

3.3 Evento

Para el experimento aleatorio consistente en lanzar un dado de seis caras marcado con números del 1 al 6 y registrar el resultado, cuyo espacio muestral es \(S_{1\text{C}},\) puede definirse, por ejemplo, el evento de obtener un número impar, el cual tendría los siguientes elementos.

\[ E_{1\text{C}.1}=\{1, 3, 5\} \]

A partir del mismo espacio muestral, podría definirse el evento de obtener un número mayor o igual que 3, el cual estaría conformado por los siguientes elementos.

\[ E_{1\text{C}.2}=\{3, 4, 5, 6\} \]

En el contexto del experimento consistente en registrar el crecimiento de un hongo en una caja de Petri de 9 cm de diámetro, cuyo espacio muestral es \(S_4,\) un investigador podría estar interesado en las cepas que presenten un crecimiento superior a 5 cm, durante el periodo de observación. Este evento puede definirse así:

\[ E_{4}=\{x\,|\,5 < x \le9\} \]

No es necesario que los eventos sean subconjuntos propios no vacíos del espacio muestral. Un subconjunto vacío o todo el espacio muestral también constituyen eventos válidos.

Si para el experimento con espacio muestral \(S_{1\text{C}}\) se define el evento de obtener un número mayor o igual que 7, el correspondiente conjunto sería vacío. Si, a partir del mismo espacio muestral, se define el evento de obtener un número mayor o igual que 1, el evento queda constituido por todos los elementos del espacio muestral.

Asimismo, es posible definir eventos de tal manera que cada uno de los puntos de un espacio muestral contable constituya un evento.

Para evitar confusiones, aclaremos lo concerniente a la nomenclatura:

\(S\) denota el espacio muestral genérico de un experimento.

\(S_1, S_2,..., S_\text{k}\) se usan en este texto para hacer referencia a los espacios muestrales de experimentos particulares: el espacio muestral del experimento 1, \(...,\) el espacio muestral del experimento \(\text{k}.\)

\(S_{1\text{A}},\) \(S_{1\text{B}}\) y \(S_{1\text{C}}\) se usan en este texto para hacer referencia a los espacios muestrales asociados con las diferentes variantes del experimento del dado.

\(E\) denota un evento, en términos genéricos.

\(E_1, E_2,..., E_\text{k}\) se usan en este texto para referirse a eventos particulares dentro de experimentos particulares: un evento particular correspondiente al experimento 1, \(...,\) un evento particular correspondiente al experimento \(\text{k}.\)

\(E_{1\text{C}.1},..., E_{1\text{C}.2}\) se usan cuando se definen diferentes eventos dentro de un experimento particular: el primer subíndice o conjunto de subíndices antes del punto se refiere(n) al experimento; el subíndice después del punto especifica el evento. Así, \(E_{1\text{C}.1}\) se leería como el primer evento del experimento \(1\text{C}.\)

No se usa ninguna nomenclatura especial para referirse a un experimento; simplemente se le denomina experimento y se especifica mediante sus características.

3.4 Probabilidad

La probabilidad puede conceptualizarse como el nivel de certidumbre de que ocurra un evento. Este nivel de certidumbre en muchas ocasiones surge de consideraciones subjetivas y, cuando se usa en la cotidianidad, suele expresarse con un valor porcentual, siendo 0 % la probabilidad de un evento imposible y 100 % la de un evento seguro.

Aunque este acercamiento al concepto de probabilidad pueda bastar para expresar nuestras creencias, en la práctica investigativa se requieren definiciones más formales. A continuación, se presentan dos definiciones, que corresponden a diferentes momentos históricos. La primera de ellas —denominada definición clásica— surge tempranamente, asociada con los comienzos de la teoría probabilística y los juegos de azar. La segunda definición aparece posteriormente, en un marco más amplio, que es el que permite estructurar los métodos de la estadística inferencial.

3.4.1 Probabilidad: Definición clásica

Esta definición tiene varias debilidades; la primera de ellas radica en su circularidad, pues se basa en el concepto que pretende definir: plausibilidad no es más que una forma alternativa de expresar la probabilidad.

Adicionalmente, esta definición solo aplicaría en experimentos con espacios muestrales contables y finitos, constituidos por elementos que tengan exactamente la misma probabilidad.

No obstante las debilidades señaladas, esta definición se mantiene vigente por su formulación intuitiva, que no exige ningún nivel de abstracción, y porque resulta adecuada para resolver preguntas en ámbitos particulares, como el de los juegos de azar.

Cuando se usa la definición clásica para el cálculo de probabilidades, estas suelen interpretarse en términos frecuentistas, esto es, como la forma límite de la frecuencia relativa del evento en cuestión.

Para el presente ejemplo, se esperaría que, si el experimento se realiza un gran número de veces, la frecuencia relativa del evento planteado sea 0.1667, esto es, que el evento se satisfaga en el 16.67 % de los lanzamientos.

En lugar de los porcentajes que suelen usarse en la cotidianidad para referirse a la certidumbre de un evento, las probabilidades toman valores en el intervalo \([0, 1],\) siendo esta la manera formal de expresarlas.

3.4.2 Probabilidad: Definición axiomática

Esta definición, formulada por el matemático ruso Andréi Kolmogórov en 1933, además de estar libre de las debilidades anotadas para la definición clásica, cuenta con la solidez suficiente para fundamentar todos los desarrollos basados en probabilidades, incluyendo, desde luego, la inferencia estadística.

Tal y como su nombre lo indica, esta definición se basa en la verificación de una serie de axiomas o postulados que deben satisfacerse para tener una función de probabilidad.

El primer axioma establece que ningún evento tiene probabilidad negativa, por lo que se le denomina axioma de no negatividad. El símbolo \(\subseteq\) indica que \(E\) puede ser cualquier subconjunto de \(S;\) no necesariamente un subconjunto propio, es decir que \(E\) puede ser un evento cualquiera, acorde con la definición presentada anteriormente (cf. tip 3.1).

El segundo axioma establece que la probabilidad del espacio muestral es 1, por lo que se le denomina axioma de normalización.

Como corolario de los axiomas 1 y 2, se desprende que la probabilidad de cualquier evento es un número real en el intervalo \([0,\,1]\).

El tercer axioma se refiere a eventos mutuamente excluyentes, es decir, a eventos que no pueden satisfacerse de manera simultánea.

Este axioma establece que la probabilidad de cualquier conjunto de eventos mutuamente excluyentes se calcula a partir de la suma de las probabilidades de tales eventos. Por tal razón se le denomina axioma de aditividad.

3.5 Variable aleatoria

Las variables aleatorias suelen representarse con letras mayúsculas. A cada uno de los posibles valores, resultados o realizaciones de la variable aleatoria se le denota con la correspondiente letra minúscula.

Así, si la variable aleatoria está representada por \(X,\) sus posibles valores se representan por \(x.\)

El conjunto de todos los posibles valores \(x\) que puede tomar una variable aleatoria \(X\) constituye su rango o recorrido. Dicho conjunto se denota \(\mathcal{X}.\)

Sin importar que un espacio muestral pueda estar conformado por elementos no numéricos, tal y como lo ilustran \(S_{1\text{A}},\) \(S_{1\text{B}}\) y \(S_2,\) las variables aleatorias mapean tales elementos en el espacio de los reales.

Consecuentemente, las variables aleatorias usadas en inferencia estadística siempre son numéricas. Así, por ejemplo, el recorrido de la variable aleatoria \(X\) que contabiliza el número de puntos de cada uno de los elementos del espacio muestral \(S_{1\text{A}}\) es \(\mathcal{X}=\{1, 2, 3, 4, 5, 6\}.\) A los elementos del conjunto \(\mathcal{X}\) se les denota \(x.\)

Contrario a lo que el nombre podría sugerir, las variables aleatorias no son las que registra el investigador en campo o en el laboratorio; son conceptos matemáticos (funciones) que permiten modelar probabilísticamente el comportamiento de aquellas.

Ejemplo 3.1

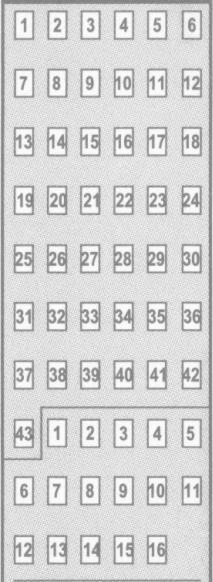

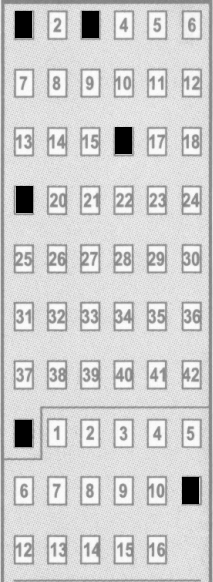

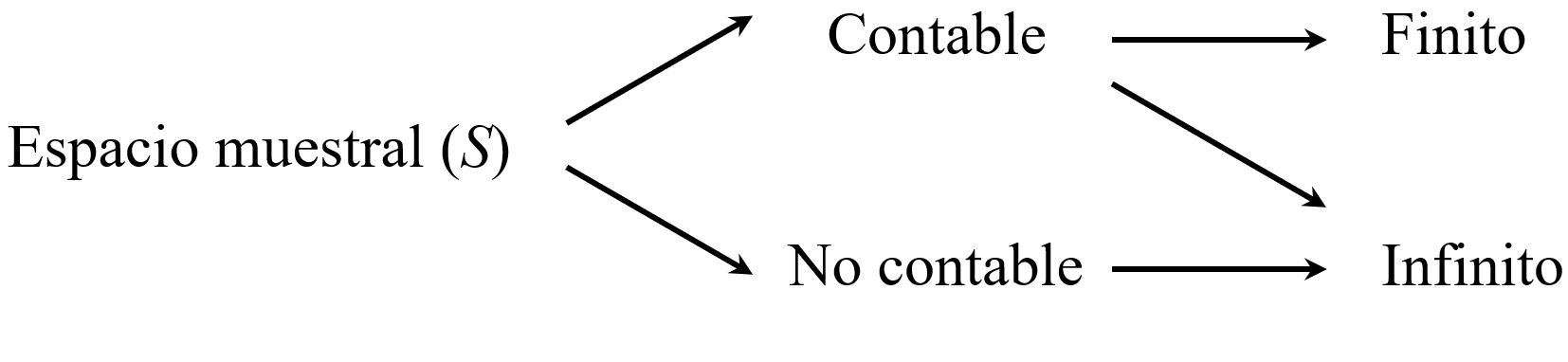

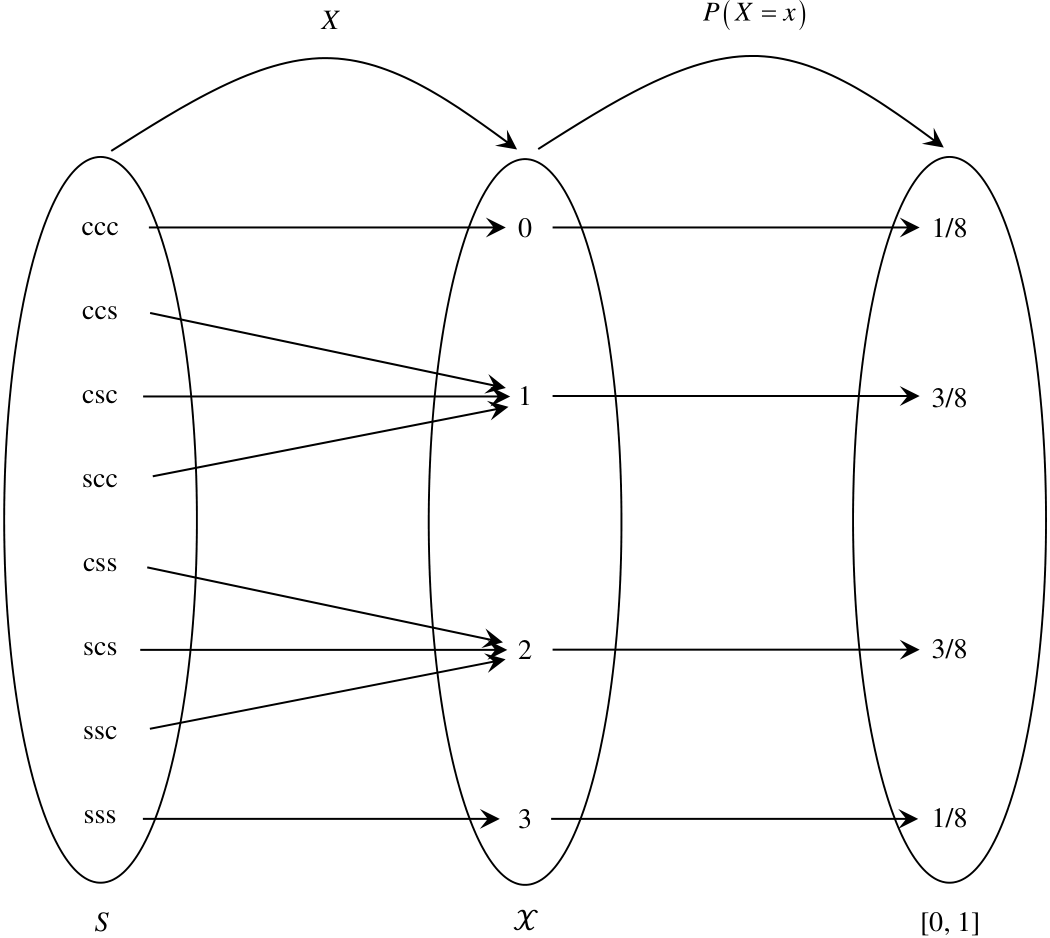

Considérese a continuación un experimento aleatorio consistente en lanzar 3 monedas. Obviando la gran diversidad de monedas existentes y las marcas que estas tengan, los dos lados de la moneda pueden denominarse genéricamente cara y sello. La figura 3.4 representa la relación entre espacio muestral, variable aleatoria y probabilidad.

El conjunto de la izquierda es el espacio muestral \(S,\) el cual contiene todos los posibles resultados del experimento, expresados en términos de caras \((\text{c})\) y sellos \((\text{s}).\) Obsérvese que el espacio muestral no tiene que estar conformado por valores numéricos.

Si se supone que las monedas están hechas de un material homogéneo, que han sido fabricadas mediante un proceso estándar, que no han sufrido deformaciones y que las marcas en cada uno de sus lados (la cara y el sello) no generan desbalances significativos, puede considerarse que los eventos definidos por cada uno de los diferentes elementos del espacio muestral son equiprobables. Consecuentemente —por definición clásica— la probabilidad de cada punto muestral es 1/8.

Si se define \(X\) como la variable aleatoria que contabiliza el número de sellos, esta variable aleatoria es una función con dominio en \(S\) y con rango en el subconjunto \(\mathcal{X}= \{0, 1, 2, 3\}\) de los reales. La probabilidad de que la variable aleatoria \(X\) tome determinado valor en su rango \(\mathcal{X},\) que se denota como \(P(X = x),\) se obtiene a partir de las probabilidades de los correspondientes puntos muestrales.

Así, por ejemplo, la probabilidad de que no aparezca ningún sello, \(P(X = 0),\) corresponde a la probabilidad del evento constituido por el punto muestral \(\text{ccc},\) la cual es 1/8. Análogamente, \(P(X = 3) = P(\{\text{sss}\})=1/8.\)

Por otra parte, \(P(X = 1) = P(\{\text{ccs}\}\cup\{\text{csc}\}\cup\{\text{scc}\}),\) que por el tercer axioma de probabilidad es \(P(\{\text{ccs}\}) + P(\{\text{csc}\}) + P(\{\text{scc}\}) = 3/8.\) Análogamente, \(P(X = 2) =3/8.\)

Las variables aleatorias constituyen un puente entre el espacio muestral y las probabilidades.

Las funciones de probabilidad —acorde con la definición axiomática— toman los eventos, que son subconjuntos del espacio muestral, como punto de partida. La variable aleatoria, como función que le asigna un número real a los resultados del espacio muestral, determina la forma en la que ciertos subconjuntos del espacio muestral (eventos) se describen en términos numéricos, permitiendo asociarles probabilidades.

Las siguientes relaciones ilustran lo indicado con base en el presente ejemplo:

\[

\begin{align}

P(\text{cero sellos}) &= P(X = 0) = 1/8\\[0.7em]

P(\text{un sello}) &= P(X = 1) = 3/8\\[0.7em]

P(\text{dos sellos}) &= P(X = 2) = 3/8\\[0.7em]

P(\text{tres sellos}) &= P(X = 3) = 1/8

\end{align}

\]

Aunque inicialmente resulta ilustrativo calcular la probabilidad de que una variable aleatoria tome un valor determinado, a través del cálculo de las probabilidades de los correspondientes eventos, en la práctica las probabilidades se calculan de manera directa mediante una función \(f (x),\) que tiene por dominio todos los posibles valores de la variable aleatoria, y una probabilidad entre 0 y 1 por rango.

\[ f(x):\mathcal{X}\rightarrow[0, 1] \]

Obsérvese que \(\mathcal{X}\) —el conjunto de todos los posibles valores de la variable aleatoria \(X\)— es el rango o recorrido de la variable aleatoria como función, pero es el dominio o soporte de \(f(x).\)

En las técnicas aplicadas de la estadística inferencial, las variables aleatorias adquieren un rol central, mientras que los espacios muestrales y sus eventos pasan a segundo plano. En la práctica, son las variables aleatorias las que siempre se asocian con el cálculo de probabilidades y con su correspondiente interpretación.

Cada variable aleatoria se encuentra asociada con una función \(f(x)\) que define su comportamiento probabilístico. La relación entre \(X\) y \(f(x)\) es tan estrecha que suele hablarse indistintamente de las propiedades de \(X\) o de \(f(x).\)

En la mayoría de ejemplos prácticos, sí.

Las variables aleatorias discretas suelen tener como dominio espacios muestrales contables.

Las variables aleatorias continuas tienen como dominio espacios muestrales no contables.

Es posible, sin embargo, elaborar contraejemplos —aunque sean un tanto artificiales— que hacen inviable definir la naturaleza de las variables aleatorias a partir de la de los espacios muestrales que les sirven como dominio.

No obstante, si le resulta más intuitivo pensar en la naturaleza de las variables aleatorias con base en el espacio muestral que actúa como dominio, no se preocupe: su intuición no lo engaña.

3.6 Distribuciones de probabilidad discretas

Las variables cuyo rango es un conjunto contable de valores reales se denominan variables aleatorias discretas. La función que define el comportamiento probabilístico de tales variables se denomina función masa de probabilidad.

Algunas funciones masa de probabilidad sencillas pueden expresarse en forma tabular, como se muestra a continuación para el experimento consistente en lanzar tres monedas y contabilizar el número de sellos ejemplo 3.1.

| \(x\) | 0 | 1 | 2 | 3 |

| \(P(X=x)=f(x)\) | 1/8 | 3/8 | 3/8 | 1/8 |

Aunque existen infinitas funciones que satisfacen las condiciones descritas anteriormente —siendo, por tanto, funciones de probabilidad—, solo unas cuantas son de particular interés por su aptitud para la modelación de fenómenos naturales y, por ende, para la inferencia estadística aplicada. A continuación, se presentan las distribuciones de probabilidad discretas más utilizadas para dicho fin.

3.6.1 Distribución Bernoulli

La evaluación de cada una de las variables que se describen a continuación constituye un experimento Bernoulli.

Sexo: {macho, hembra}

Estado sanitario: {sano, enfermo}

Estado vital: {vivo, muerto}

Germinación: {germina, no germina}

Mutación genética: {presente, ausente}

Estado de una vaca: {llena, vacía}

Resultado de un examen: {aprobado (resultado ≥ 3.0), reprobado (resultado < 3.0)}

Peso de una semilla: {pesada (peso ≥ 5 g), liviana (peso < 5 g)}

Tal y como se ilustra en los dos últimos ejemplos, siempre es posible dicotomizar (particionar el espacio muestral en dos) los resultados de un experimento aleatorio, sin importar que en principio este genere una respuesta con más de dos categorías o incluso una respuesta continua.

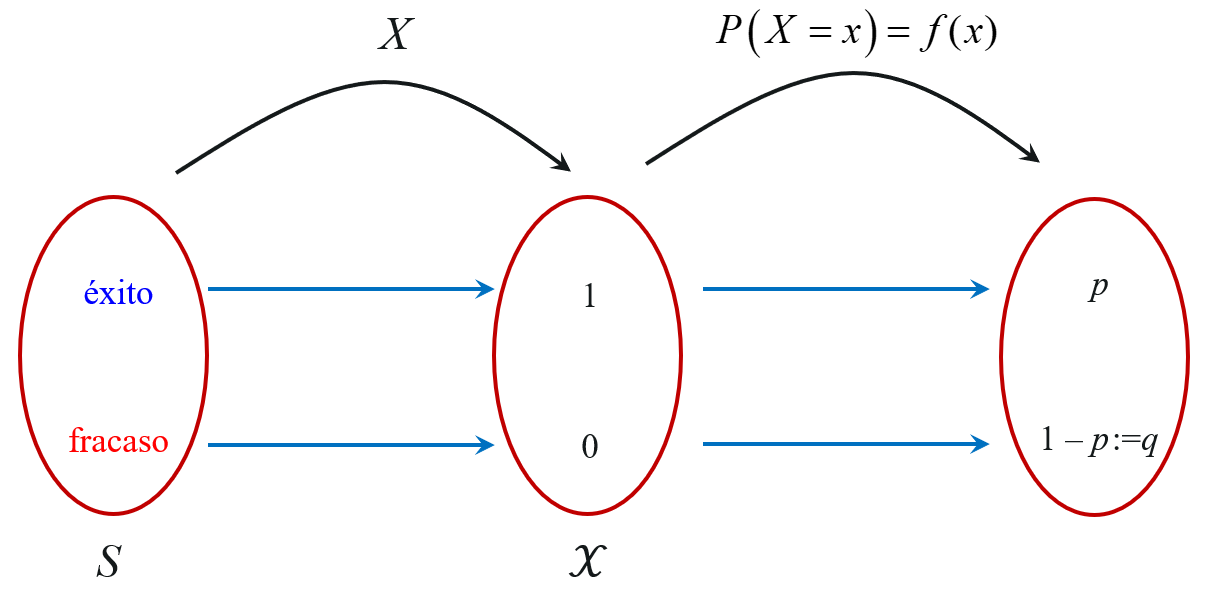

El espacio muestral de todo experimento Bernoulli está conformado por dos puntos, los cuales se definen genéricamente como éxito y fracaso.

Las etiquetas éxito y fracaso están desprovistas de cualquier connotación ética o sicológica; su uso tiene que ver exclusivamente con la forma en que se haya descrito el evento.

Así, por ejemplo, si en una prueba de viabilidad aplicada a una semilla, se define el evento de obtener una semilla no viable, tal resultado tendrá la etiqueta de éxito, mientras que el resultado complementario (viable) será el fracaso.

Sin importar si los elementos del espacio muestral son numéricos o no, la variable aleatoria Bernoulli —al igual que todas las variables aleatorias— siempre toma valores numéricos.

La función masa de probabilidad de una variable aleatoria Bernoulli puede expresarse en forma tabular así:

| \(x\) | 0 | 1 |

| \(P(X=x)=f(x)\) | \(q\) | \(p\) |

Aunque la forma tabular podría bastar para definir la presente distribución, esta modalidad de expresión puede resultar poco práctica, insuficiente o incluso imposible de usar para la mayoría de las demás distribuciones.

En consecuencia, las funciones de probabilidad se expresan mediante una forma funcional, que recoge las particularidades de la tabla (en caso de existir una), tal y como la que se muestra a continuación para la función masa de probabilidad de una variable aleatoria Bernoulli.

\[

f(x)=p^xq^{1-x},\quad x=0, 1

\tag{3.1}\]

La probabilidad de que la variable aleatoria \(X\) tome un valor particular se obtiene evaluando la función masa de probabilidad en dicho valor:

\[

\begin{align}

P(X=0)&=f(0)=p^0q^{1-0}=q\\[0.7em]

P(X=1)&=f(1)=p^1q^{1-1}=p

\end{align}

\]

Se verifica que \(f(x)\ge0 \:\forall\: x\). Asimismo, puede corroborarse que la suma de probabilidades sobre el soporte de \(f(x)\) es 1:

\[

\sum\limits_{\mathcal{X}}f(x)=f(0)+f(1)=q+p=(1-p)+p=1

\]

Para indicar que \(X\) es una variable aleatoria que registra el resultado de un experimento Bernoulli y que, por tanto, su comportamiento probabilístico puede condensarse en la expresión 3.1, se utiliza la siguiente notación:

\[

X \thicksim \text{Bernoulli}(p)

\]

La expresión anterior se lee así: “\(X\) se distribuye Bernoulli con parámetro \(p\)”, o así: “\(X\) sigue una distribución Bernoulli con parámetro \(p\)”, o así: “\(X\) es Bernoulli con parámetro \(p\)”.

De manera análoga a como las estadísticas caracterizan las muestras (cf. sección 2.1), las variables aleatorias con sus correspondientes distribuciones probabilísticas están caracterizadas por uno o más parámetros1.

La distribución Bernoulli tiene un único parámetro: \(p\). Puesto que el parámetro \(p\) pude tomar infinitos valores en el intervalo \([0,\,1]\), existen infinitas distribuciones Bernoulli. Luego, cuando se menciona una distribución probabilística dada sin especificar el valor de su(s) parámetro(s), se hace referencia a uno cualquiera de los miembros de dicha familia.

3.6.2 Distribución binomial

Un experimento binomial surge de la realización independiente de \(n\) experimentos Bernoulli.

Si cualquiera de los experimentos descritos en la sección 3.6.1 se realiza independientemente \(n\) veces, se tiene un experimento binomial. Así, por ejemplo, si en lugar de realizar la prueba de germinación sobre una única semilla, se realizan pruebas independientes sobre 100 semillas, se tiene un experimento binomial con \(n\) = 100.

La independencia entre los diferentes experimentos Bernoulli que conforman el experimento binomial implica que ninguno de los resultados de un experimento Bernoulli particular se vea afectado por el resultado de cualquier otro de los experimentos Bernoulli. En tal sentido la probabilidad de un resultado en cualquiera de los experimentos parciales depende únicamente del parámetro \(p,\) sin que las realizaciones obtenidas en otros experimentos alteren dicha probabilidad.

La independencia es un aspecto que merece particular atención por parte del investigador, pues no siempre se ejecutan todas las acciones necesarias para propiciarla.

Si en el ensayo de germinación al que se hace referencia, las 100 semillas están en contacto entre sí, en un recipiente común, con un sustrato común y sometidas a un protocolo común, difícilmente podrían considerarse los resultados obtenidos como independientes entre sí.

Aunque ajeno al contexto investigativo, el siguiente ejemplo permite ilustrar el concepto de ensayos independientes.

En la práctica investigativa los experimentos binomiales suelen realizarse sobre poblaciones infinitas o cuasi infinitas, por lo que el investigador no tendrá que preocuparse por violar la independencia entre ensayos al estar realizando experimentos Bernoulli sin remplazo.

Sin embargo, sí deberá concentrarse en evitar que la respuesta de una unidad experimental esté ligada a la respuesta de otras unidades.

A fin de ilustrar la construcción de la función masa de probabilidad binomial, supóngase que se someten 3 insectos a la acción de un extracto vegetal y se evalúan sus correspondientes estados vitales (vivo, muerto) después de 10 minutos.

Aunque, tal y como se indicó anteriormente, la asignación de las etiquetas de éxito y fracaso está desprovista de cualquier connotación ética o sicológica, esta debe realizarse acorde con el evento de interés. Así, si el investigador desea estimar la efectividad del producto, deberá enfocarse en los insectos que mueren, etiquetando tal resultado como éxito, en cuyo caso, el resultado de un insecto vivo será un fracaso; si, por el contrario, en un estudio de resistencia, el investigador estuviera más interesado en los insectos que viven, debería invertir la asignación de las etiquetas.

Aunque una adecuada definición del éxito puede facilitar las interpretaciones, al hacerlas más directas, es posible extraer exactamente la misma información sobre el fenómeno subyacente, usando cualquiera de las dos distribuciones resultantes, puesto que estas son complementarias.

Para el presente ejemplo, considérese el resultado de un insecto muerto \((\text{m})\) como éxito y el de un insecto vivo \((\text{v})\) como fracaso.

Este experimento tiene asociado el siguiente espacio muestral:

\[

S = \{\text{vvv, vvm, vmv, mvv, vmm, mvm, mmv, mmm}\}

\]

Por información de la casa productora del extracto, se sabe que la probabilidad de éxito es \(p\); luego, la probabilidad de fracaso será \(q = 1 − p\).

La siguiente tabla presenta cada uno de los puntos del espacio muestral, con su correspondiente probabilidad.

Puesto que cada punto muestral está conformado por tres ensayos independientes, la probabilidad de cada punto muestral puede obtenerse multiplicando las probabilidades de tales ensayos. Seguidamente, las probabilidades se presentan mediante una nomenclatura general, en términos de \(p\) y de \(q\) con un exponente.

| Punto muestral | Probabilidad del punto muestral | ||

|---|---|---|---|

| \(\text{vvv}\) | \(q\cdot q\cdot q\) | \(q^3\) | \(p^0q^3\) |

| \(\text{vvm}\) | \(q\cdot q\cdot p\) | \(pq^2\) | \(p^1q^2\) |

| \(\text{vmv}\) | \(q\cdot p\cdot q\) | \(pq^2\) | \(p^1q^2\) |

| \(\text{mvv}\) | \(p\cdot q\cdot q\) | \(pq^2\) | \(p^1q^2\) |

| \(\text{vmm}\) | \(q\cdot p\cdot p\) | \(p^2q\) | \(p^2q^1\) |

| \(\text{mvm}\) | \(p\cdot q\cdot p\) | \(p^2q\) | \(p^2q^1\) |

| \(\text{mmv}\) | \(p\cdot p\cdot q\) | \(p^2q\) | \(p^2q^1\) |

| \(\text{mmm}\) | \(p\cdot p\cdot p\) | \(p^3\) | \(p^3q^0\) |

Consecuentemente con la definición 3.19, el presente ensayo, con la asignación de etiquetas definida, tendrá asociada una variable aleatoria binomial, \(X,\) que contabiliza el número de insectos muertos.

La probabilidad de observar un número determinado de insectos muertos se obtiene sumando las probabilidades de los puntos muestrales que satisfacen dicha condición.

\[

\begin{align}

P(X=0)&=P(\{\text{vvv}\})=p^0q^3\\[0.7em]

P(X=1)&=P(\{\text{vvm, vmv, mvv}\})=p^1q^2+p^1q^2+p^1q^2=3p^1q^2\\[0.7em]

P(X=2)&=P(\{\text{vmm, mvm, mmv}\})=p^2q^1+p^2q^1+p^2q^1=3p^2q^1\\[0.7em]

P(X=3)&=P(\{\text{mmm}\})=p^3q^0

\end{align}

\]

Los factoriales aparecen en las definiciones de combinaciones y de permutaciones, que se usan profusamente en los cursos básicos de estadística. Los ejercicios que se resuelven en tales contextos son bastante entretenidos; puede encontrar una buena muestra de estos en el texto de Walpole et al. (2012).

Aunque en el contexto investigativo, estos conceptos no suelen aparecer de forma aislada3, no está de más saber cómo podrían obtenerse en R.

El factorial de un número en R se calcula mediante la función factorial, así:

factorial(5)[1] 120El resultado del coeficiente binomial, que en el contexto de la combinatoria se expresa como la selección de \(x\) elementos a partir de un grupo de \(n,\) se calcula así:

choose(5, 2)[1] 10El anterior resultado corresponde a este desarrollo:

\[

{{5}\choose{2}}=\frac{5!}{2!\left(5-2\right)!}=

\frac{5\times 4\times 3!}{2!3!}=

\frac{20}{2}=10

\]

La definición presentada anteriormente para \(n!,\) aunque intuitiva, deja algunas preguntas sin respuesta.

¿Cuál es el factorial de de 0?

Respuesta: \(0!=1\)

¿Cuál es el factorial de un entero negativo o de un valor no entero?

Respuesta: No está definido.

Las anteriores respuestas quedan incorporadas en una definición más completa del factorial.

¿Si el factorial únicamente está definido para valores enteros, por qué se obtiene el siguiente resultado en R?

factorial(1.5)[1] 1.32934Esto es debido a que la función factorial de R se basa en la relación existente entre el factorial y la distribución gamma: \(n!=\Gamma(n+1)\) (cf. expresión 3.8). Luego, cuando se pide el resultado de factorial(1.5), R internamente calcula gamma(2.5) (¡compruébelo!).

Para el presente ejemplo se estaría formulando la siguiente pregunta: ¿de cuántas maneras puede presentarse una situación en la que resulten muertos \(x\) insectos de un grupo de \(n\)? Si esta pregunta se formulara, por ejemplo, para \(x=2,\) la respuesta sería que el número de maneras en que puede presentarse un resultado de 2 insectos muertos cuando se evalúan 3 es 3: \(\text{vmm},\) \(\text{mvm}\) y \(\text{mmv}.\) Esto permite escribir cada una de las probabilidades más sucintamente:

\[

\begin{align}

P(X=0)&={{3}\choose{0}}p^0q^3\\[1.4em]

P(X=1)&={{3}\choose{1}}p^1q^2\\[1.4em]

P(X=2)&={{3}\choose{2}}p^2q^1\\[1.4em]

P(X=3)&={{3}\choose{3}}p^3q^0

\end{align}

\]

La expresión general para calcular la probabilidad de que la variable aleatoria \(X\) tome un valor determinado \(x,\) en un ensayo binomial de tamaño \(n,\) con probabilidad de éxito \(p,\) está dada por:

\[

P(X=x)=f(x)=\binom{n}{x} p^x q^{n-x}, \quad x=0,1,2,\dotsc,n

\tag{3.2}\]

Si una variable aleatoria \(X\) tiene una función masa de probabilidad como la de la expresión 3.2, se dice que \(X\) sigue una distribución binomial con parámetros \(n\) y \(p,\) y se denota así:

\[

X \thicksim \text{bin}(n,\,p)

\]

La distribución binomial está caracterizada por dos parámetros: \(n\) y \(p.\) El parámetro \(n\) —que representa el número de ensayos Bernoulli— puede tomar cualquier valor entero mayor o igual que 1. El parámetro \(p\) —que representa la probabilidad de éxito— puede tomar cualquier valor en el intervalo \([0,1].\)

Cuando \(n = 1\), es decir, cuando se realiza un único ensayo Bernoulli, la distribución binomial es equivalente a la distribución Bernoulli.

Aunque las funciones de probabilidad están determinadas por sus parámetros, en ocasiones estos no son interpretables de manera directa.

Para la caracterización de las funciones de probabilidad se utilizan algunas funciones de los parámetros, denominadas genéricamente momentos4. De estos, los más importantes son el primer momento al origen, denominado esperanza matemática, valor esperado o media, y el segundo momento central, denominado varianza.

En virtud de la estrecha relación que existe entre las variables aleatorias y sus correspondientes funciones de probabilidad, es equivalente hablar de una u otra cuando se discuten sus propiedades.

Por tanto, es correcto hablar de los momentos de una función de probabilidad o de los momentos de la correspondiente variable aleatoria.

La media de una variable aleatoria es equivalente a la media ponderada de una muestra, usando las probabilidades como factor de ponderación. Refleja el valor medio o esperado de la variable en cuestión si se obtuvieran muchas realizaciones de la misma, es decir, si se realizaran muchos experimentos aleatorios que dieran lugar a valores concretos de la misma.

No obstante, a diferencia de la media aritmética que cambia de muestra a muestra, la esperanza matemática es una constante asociada con cada variable aleatoria, que depende únicamente de los parámetros de su función de probabilidad.

La varianza de una variable aleatoria es el valor esperado de las desviaciones cuadráticas entre cada posible realización de la variable aleatoria y su media. Es equivalente a la varianza de una muestra. Expresa el grado de dispersión de la variable aleatoria, con respecto a su media. Al igual que la esperanza, la varianza de una variable aleatoria es una constante asociada con la misma.

\[

\text{si}\: X \thicksim \text{bin}(n,\, p)\;\;\Rightarrow\;\; E(X)=np,\; V(X)=npq

\]

La interpretación de la esperanza es bastante intuitiva. Así, por ejemplo, para una variable aleatoria \(X\), con distribución \(\text{bin}(10,\,0.7),\) la esperanza es 7. Retomando el experimento de muestreo con remplazo en una tula con 7 fichas blancas y 3 negras, \(X\) representaría el número de fichas blancas cuando se realizan 10 extracciones. Desde luego, el resultado de la variable aleatoria \(X\) en una serie particular puede ser cualquier valor entero entre 0 y 10, con algunos de tales resultados más probables que otros. No obstante, si se repitiera muchas veces el experimento de realizar 10 extracciones y contabilizar el número de fichas blancas, la media de \(X\) sería 7.

Puede usarse la función de generación de muestras seudoaleatorias (cf. sección 3.8) para constatar, por ejemplo, que el valor esperado de una variable aleatoria \(\text{bin} (10,\,0.7)\) es 7.

Para ello, se genera una muestra de tamaño cien, mil o un millón (cualquier número grande) y se obtiene su promedio, tal y como se ilustra a continuación.

- 1

- Muestra aleatoria de tamaño 1000, basada en una \(\text{bin}(n=10,\,p=0.7)\)

- 2

- Media de las 1000 realizaciones de la variable aleatoria

¿Cómo se ve afectado el desempeño de la simulación por el tamaño de las muestras?

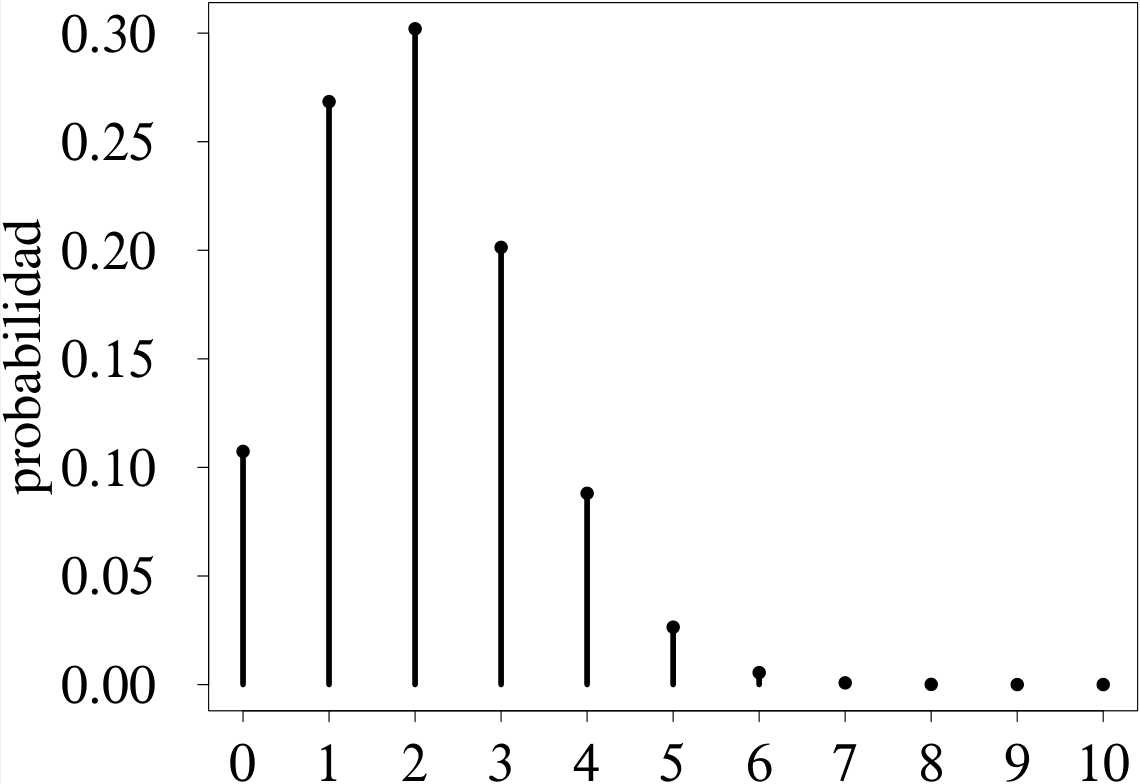

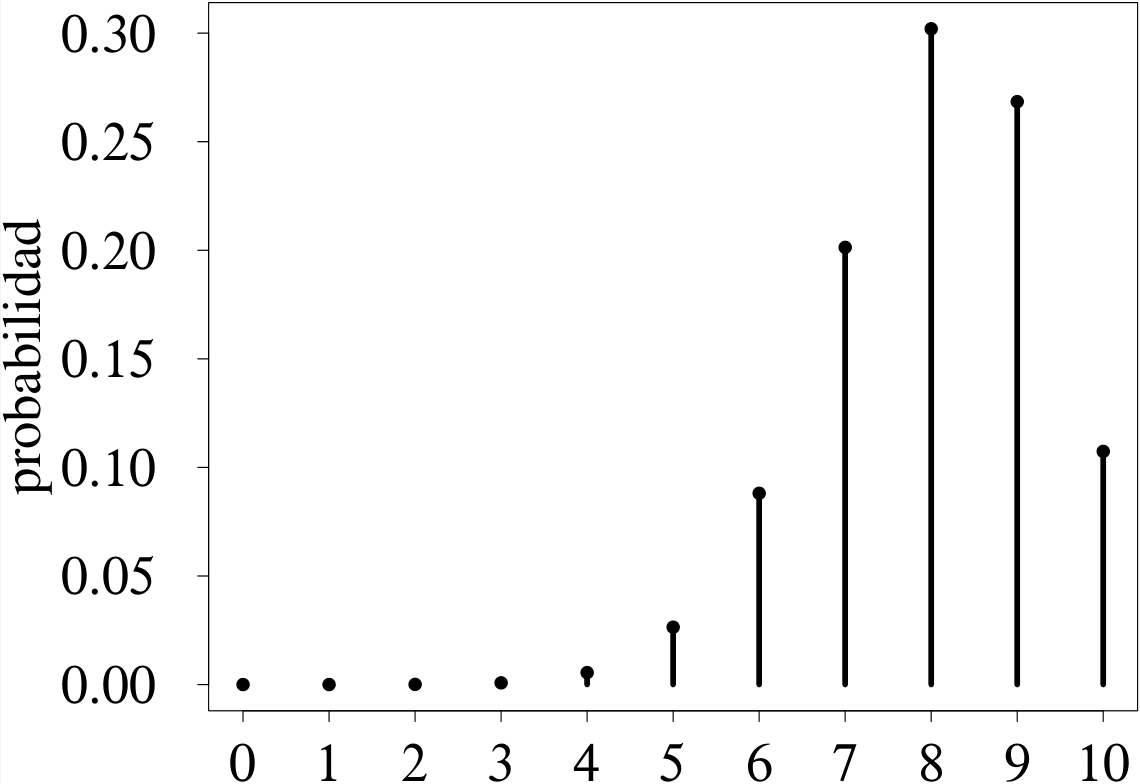

Las funciones masa de probabilidad pueden representarse gráficamente ubicando los posibles valores de \(X\) en la abscisa y la correspondiente probabilidad en la ordenada. Suelen utilizarse barras verticales, cuya altura representa la probabilidad de cada punto. Los parámetros \(n\) y \(p\) determinan el aspecto de la distribución binomial. La figura 3.6, conformada por dos miembros de la familia binomial con un valor común de \(n\) permite visualizar la manera en la que el parámetro \(p\) afecta la forma de la distribución.

Cuando \(p < 0.5,\) la distribución tiene asimetría a la derecha (figura 3.6 (a)), mientras que \(p > 0.5\) da lugar a distribuciones con asimetría a la izquierda (figura 3.6 (b)) (cf. sección 2.1.3.1). La asimetría es mayor cuanto más cerca esté \(p\) de 0 o de 1.

Los gráficos que conforman la figura 3.6 ilustran que la definición del éxito y el fracaso, más allá de facilitar la interpretación, es irrelevante en lo que a información se refiere.

Supóngase que se está evaluando el sexo de un organismo, en una población con 20 % de machos y 80 % de hembras. Si se evalúan 10 individuos, la variable aleatoria que contabiliza los machos sigue una distribución binomial con \(n = 10\) y \(p = 0.2\) (figura 3.6 (a)), mientras que la variable aleatoria que contabiliza las hembras sigue una distribución binomial con \(n = 10\) y \(p = 0.8\) (figura 3.6 (b)).

Supóngase, ahora, que se desea calcular la probabilidad del evento consistente en que de los 10 individuos evaluados 3 sean machos y 7 hembras. Si se usa la etiqueta éxito para los machos (y, por tanto, fracaso para las hembras), dicha probabilidad se calcula así:

\[

P(X=3)={{10}\choose{3}}0.2^3\,0.8^7=0.2013266

\]

Si la etiqueta éxito se asigna a las hembras (y, por tanto, fracaso a los machos), la probabilidad del evento indicado se calcula así:

\[

P(X=7)={{10}\choose{7}}0.8^7\,0.2^3=0.2013266

\]

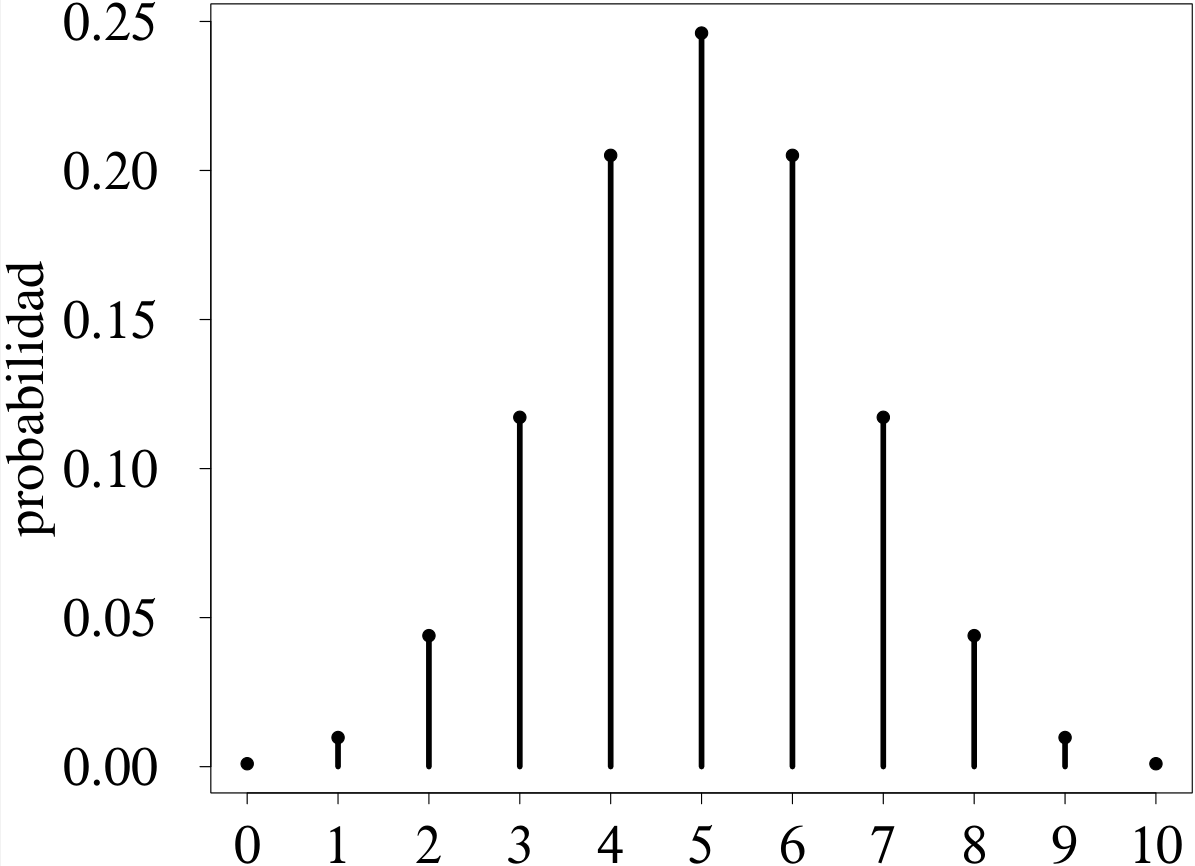

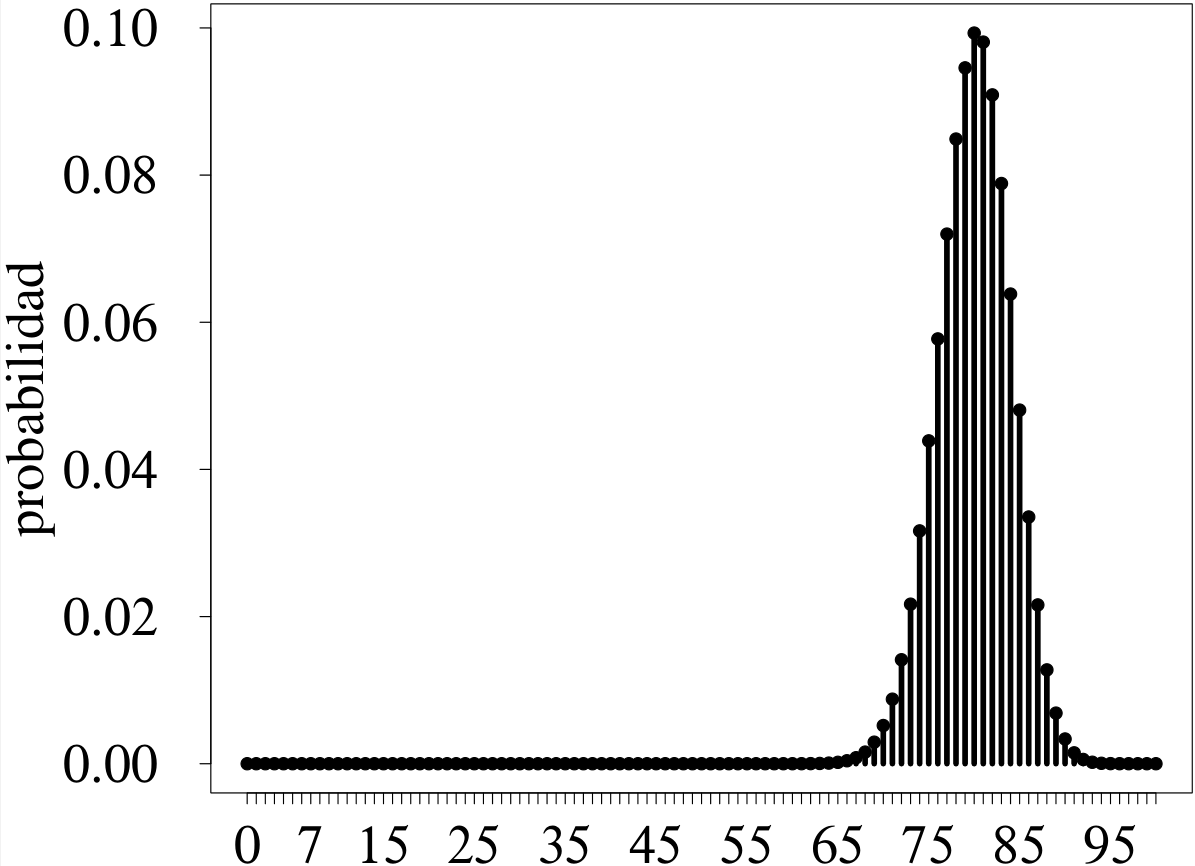

La figura 3.7 ilustra el efecto del parámetro \(n\) en la forma de la distribución.

La figura 3.7 (a) muestra la distribución de una variable aleatoria binomial con \(p = 0.5,\) la cual siempre es simétrica, sin importar el tamaño del experimento. Esta distribución se usa para modelar el comportamiento probabilístico de una variable aleatoria que contabiliza el número de éxitos de \(n\) ensayos Bernoulli independientes, cada uno con un espacio muestral conformado por dos puntos muestrales equiprobables, como serían los que corresponden al lanzamiento de una moneda equilibrada.

Para el caso ilustrado, con \(n = 10,\) la esperanza del número de éxitos es 5, valor al que le corresponde la máxima probabilidad. Las probabilidades disminuyen de manera simétrica a medida que se alejan de la esperanza. Así, por ejemplo, \(P(X = 4)\) \(=\) \(P(X = 6).\)

La figura 3.7 (b) muestra cómo se simetriza la distribución para experimentos grandes. Contrástese esta distribución con la presentada en la figura 3.6 (b). Aunque podría pensarse, por la larga cola de la izquierda, que la simetría alcanzada es dudosa, tales valores aportan muy poco a la distribución por ser bastante improbables: \(P(X\le 69) < 0.01.\)

Aunque, usando una hoja de cálculo, no es difícil obtener \(P(X = x)\) mediante la expresión 3.2, puede hacerse de manera más directa usando la función dbinom en R, cuyos argumentos son x, size y prob, siendo x la realización de la variable aleatoria \(X\) cuya probabilidad se desea calcular; size, el tamaño del experimento binomial, es decir, \(n\), y prob, la probabilidad de éxito, es decir, \(p\). Si \(X \thicksim \text{bin}(n,\, p),\) \(P(X = 3)\) se obtiene en R así:

dbinom(3, 10, 0.2)[1] 0.2013266\[ F(x)=P(X\le x)=\sum\limits_{i=0}^{x}{{n}\choose{i}}p^iq^{n-i}, \quad x=0,1,2,\dotsc,n \]

Considérese una variable aleatoria \(X\thicksim \text{bin}(n=15,\,p=0.4).\) La probabilidad de que esta variable tome un valor menor o igual a 5 se expresa así:

\[ F(5)=P(X\le 5)=\sum\limits_{i=0}^{5}{{15}\choose{i}}0.4^i\,0.6^{15-i} \]

Para su obtención, se suman las probabilidades de los correspondientes puntos, así:

\[ \begin{align} P(X=0)&=0.0004702\\[0.7em] P(X=1)&=0.0047019\\[0.7em] P(X=2)&=0.0219420\\[0.7em] P(X=3)&=0.0633879\\[0.7em] P(X=4)&=0.1267758\\[0.7em] P(X=5)&=0.1859378 \end{align} \]

\[

\mathbf{\,\,\,P(X\le5)=0.4032156}

\]

Las funciones de distribución acumuladas constituyen una herramienta muy útil para el cálculo de probabilidades. Las tablas que durante mucho tiempo se utilizaron, y que aún aparecen en muchos textos, están construidas con base en funciones de distribución (cf. sección 3.8). En R, se usa la función pbinom, con los argumentos q, size y prob, siendo q el valor hasta el cual se desea acumular la probabilidad; size, el tamaño del experimento binomial, y prob, la probabilidad de éxito. La probabilidad cuyo cálculo se ilustró anteriormente se obtiene así:

pbinom(5, 15, 0.4)[1] 0.4032156

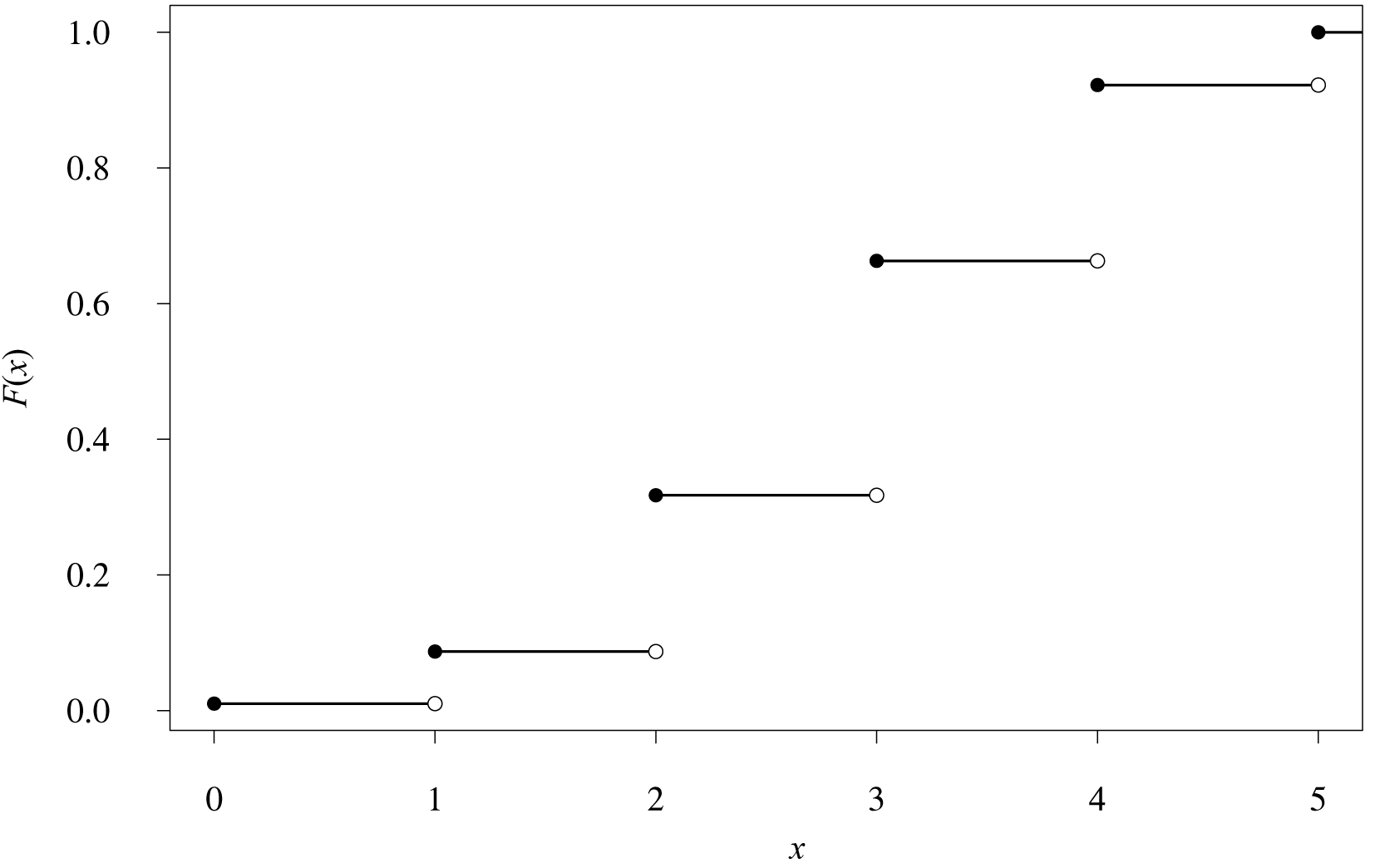

La figura 3.8, correspondiente a la función de distribución de una variable aleatoria \(\text{bin}(n=5,\,p=0.6)\) facilita la visualización del carácter acumulativo de estas funciones.

Como consecuencia de que los valores que una variable aleatoria discreta puede tomar estén circunscritos a una serie determinada, sin la posibilidad de que se presente ningún valor intermedio entre pares de valores adyacentes de la serie, sus correspondientes funciones de distribución son funciones escalonadas, tales como la representada en la figura 3.8, correspondiente a una variable aleatoria binomial con \(n = 5\) y \(p = 0.6.\)

Puede observarse, por ejemplo, que el valor de dicha función para cualquier valor en el intervalo \([2,\,3)\) es 0.31744. Esto implica que cualquiera de las siguientes probabilidades es exactamente la misma: \(P(X\le 2)\) \(=\) \(P(X \le 2.5)\) \(=\) \(P(X \le 2.99)\) \(=\) \(0.31744\) (¡compruébelo!). Cuando el valor del argumento llega a 3, la función salta a 0.66304. Nótese que la función de distribución acumulada es el equivalente teórico del polígono de frecuencias acumuladas descrito en la sección 2.3.3.

3.7 Distribuciones de probabilidad continuas

Las variables cuyo rango es un conjunto no contable de valores reales se denominan variables aleatorias continuas. La función que define el comportamiento probabilístico de tales variables se denomina función densidad de probabilidad, función de densidad, densidad de probabilidad o simplemente densidad.

Aunque, en general, las funciones densidad de probabilidad se definen en los reales, esto no implica que el recorrido de cualquier variable aleatoria continua sea el rango completo de los reales. Bien pueden definirse funciones que valgan cero para cualquier valor por fuera de su soporte.

En las funciones masa de probabilidad (variables aleatorias discretas), la segunda condición exige que la suma sobre cada uno de los puntos que conforman el rango de la variable aleatoria sea 1. Para el caso de las variables aleatorias continuas, al no estar conformadas por puntos discretos, sino por un continuo de valores, se usa la integral.

Puesto que las funciones densidad de probabilidad están representadas por curvas, la segunda condición establece que el área total bajo tales curvas es 1. Esto es equivalente a exigir que la probabilidad del espacio muestral sea 1.

La tercera condición representa quizá la diferencia más relevante entre variables aleatorias discretas y continuas. En el caso discreto se calculan probabilidades puntuales. Las funciones de probabilidad están conformadas por el conjunto de tales puntos de probabilidad. En tal sentido puede entenderse su denominación como funciones masa de probabilidad.

En el caso continuo, por la naturaleza misma de las variables, que pueden tomar infinitos valores entre cualquier par de valores por cercanos que se encuentren entre sí, no se calculan probabilidades puntuales; de hecho, la probabilidad de cualquier punto particular es igual a cero.

Para entender el concepto de probabilidad cero para cualquier valor individual también puede resultar útil considerar una variable de campo cualquiera que pueda tomar valores en un continuo.

Considérese, por ejemplo, el diámetro de un tallo y la probabilidad de observar un tallo particular cuyo diámetro sea exactamente igual a 5 centímetros, pudiendo afirmarse que la probabilidad es cero. De nuevo, esta afirmación resulta desconcertante y antintuitiva.

No obstante, si prescindiendo de las limitaciones tecnológicas y prácticas se supone que se cuenta con un instrumento de precisión infinita, sería imposible que dicho instrumento arrojara un valor de 5, seguido de infinitos ceros en todas sus posiciones decimales; una lectura de 5.000… que tuviera cualquier valor diferente de cero en la millonésima posición decimal, sería realmente un valor mayor que 5; de igual manera un valor de 4.999… seguido de infinitas cifras 9, sería realmente un valor menor que 5.

Es por lo anterior que para el caso de variables aleatorias continuas no se calculan probabilidades de valores puntuales, sino la probabilidad de que la variable tome algún valor en un intervalo determinado. Este acercamiento supera las limitaciones expuestas anteriormente.

Así, si para el hipotético caso del tallo de 5 cm de diámetro, en lugar de preguntar por la probabilidad de dicho punto, se reformula la pregunta como la probabilidad de observar un tallo entre 4.9 y 5.1, será perfectamente viable observar tallos que satisfagan dicha condición, sin que un hipotético instrumento de infinita precisión constituya un impedimento para ello.

Aunque resulta paradójico pensar que una suma de infinitos elementos iguales a cero llegue a ser uno, puede ayudar la conceptualización de la integral como una serie infinita de sumas de Riemann. En la sección 2.3.2, al presentar el histograma de frecuencias, se anotó que las frecuencias relativas se asociaban realmente con el área de las barras; no con sus alturas. Adicionalmente, en la sección 3.4.1 se menciona que las probabilidades suelen interpretarse en términos frecuentistas, como la forma límite de las frecuencias relativas de un evento.

En tal sentido, en un histograma de frecuencias con muchísimos intervalos la base de las barras tendería a cero y consecuentemente, el área individual de cada una de las barras —y la probabilidad que representan— tendería también a cero. Sin embargo, la suma de todas las áreas sería 1.

La tercera propiedad establece que la probabilidad de que una variable aleatoria continua tome algún valor en un intervalo dado se obtiene mediante la correspondiente integral definida en dicho intervalo. Dicha integral representa, asimismo, el área bajo la curva entre los límites establecidos.

Luego, a diferencia del caso discreto, donde la probabilidad de que la variable aleatoria tome un valor en un intervalo se obtiene sumando puntos de probabilidad, en el caso continuo la probabilidad de que la variable aleatoria tome un valor dentro de un intervalo se obtiene como el área bajo la curva entre los límites definidos por el intervalo.

Esto explica que a las correspondientes funciones de probabilidad se les denomina funciones densidad de probabilidad.

Para el caso continuo todas las siguientes probabilidades son equivalentes:

\[

P(a < X < b) = P(a \le X < b) = P(a < X \le b) = P(a \le X \le b)

\]

Estas identidades surgen del hecho de que la probabilidad de cualquier valor puntual sea igual a cero. En consecuencia, resulta irrelevante incluir o no el punto en el intervalo, lo cual, desde luego, sí marca diferencias en el caso discreto.

Teniendo en cuenta este aspecto y buscando simplicidad, en el caso continuo suelen obviarse los signos de igualdad, expresando siempre las probabilidades en intervalos abiertos.

Puesto que el área bajo cualquier curva de densidad de probabilidad es 1, se satisfacen las siguientes relaciones.

\[

F(x)=1-S(x)

\]

\[

\,S(x)=1-F(x)

\tag{3.5}\]

3.7.1 Distribución normal

Puede afirmarse sin lugar a dudas que la distribución normal es la que juega un papel más importante en los métodos inferenciales clásicos. Su importancia surge del hecho de que puede usarse, ya sea de manera directa o indirecta, para modelar el comportamiento probabilístico de muchas variables de campo y laboratorio.

Aunque esta distribución suele estar ligada con el matemático alemán Carl Friedrich Gauss, no fue este el único pensador en contribuir a la misma. Es necesario acreditar por igual a los matemáticos franceses Abraham de Moivre y Pierre-Simon Laplace. De hecho, fue De Moivre, en 1733, el primero en llegar a su formulación matemática, en búsqueda de una aproximación a la distribución binomial.

En la sección 3.1 se mencionó la contribución realizada por Pascal y Fermat, en el siglo xvii, estimulados por las preguntas que surgían de los juegos de azar. En ese mismo contexto, ya en el siglo xviii, De Moivre buscaba calcular, por ejemplo, la probabilidad de obtener 60 o más sellos al realizar 100 lanzamientos de una moneda.

Aunque la pregunta planteada tiene que ver con un experimento binomial y la expresión matemática mediante la cual podía responderse esta pregunta era conocida, su cálculo no era sencillo usando las herramientas computacionales disponibles en la época.

\[

\sum_{i=60}^{100}{{100}\choose{i}}0.5^i\,0.5^{100-i}=\sum_{i=60}^{100}\frac{100!}{i!(100-i)!}0.5^i\,0.5^{100-i}

\]

De Moivre notó que en experimentos binomiales con \(p = 0.5\) y \(n\) grande, las distribuciones de probabilidad adquirían una forma de curva acampanada como la ilustrada en la figura 3.7 (a). Buscando una expresión matemática de tales curvas, que le permitiera obtener de manera sencilla una aproximación de las probabilidades requeridas, De Moivre desarrolló la distribución normal.

En 1810, Laplace generalizó las ideas de De Moivre, estableciendo las bases de lo que posteriormente daría lugar a uno de los resultados más importantes de la estadística aplicada: el teorema central del límite.

Cuando se mencionaba anteriormente que la distribución normal podía usarse para modelar de manera indirecta el comportamiento de variables de campo, se hacía referencia justamente al teorema central del límite. Usando métodos de simulación Monte Carlo, Correa-Londoño y Castillo-Morales (2000) realizaron un estudio, en el que analizaron la convergencia a la distribución normal de los promedios basados en diferentes tamaños de muestra, a partir de algunas de las distribuciones que más a menudo se suponen en la práctica investigativa.

Al hacer referencia a este teorema, algunos autores lo denominan incorrectamente “teorema del límite central”, argumentando que el adjetivo “central” no hace referencia al teorema, sino al límite.

El nombre del teorema en cuestión fue acuñado por George Pólya, en 1920, quien, en su artículo original, escrito en alemán, lo llama zentralen Grenzwertsatz, quedando claro que el adjetivo “central” (zentralen) se refiere al teorema del límite (Grenzwertsatz).

En el resumen de su artículo, Pólya indica que la ocurrencia de la densidad de probabilidad gaussiana que surge en muchas situaciones de experimentación repetida puede explicarse por el teorema límite, el cual juega un rol central en el cálculo de la probabilidad.

Otro tópico que condujo al desarrollo de la distribución normal fue el relacionado con las tempranas mediciones astronómicas realizadas en el siglo xvii y los errores asociados con estas. Galileo había notado que tales errores se distribuían simétricamente y que los errores pequeños eran más frecuentes que los de gran magnitud. Sin embargo, no fue hasta 1809 que Gauss desarrolló la distribución probabilística para describir adecuadamente tales errores. Por tal razón, a la distribución normal suele denominársele gaussiana.

Si \(X\) es una variable aleatoria con función densidad de probabilidad:

\[

f(x)=\frac{1}{\sigma\sqrt{2\pi}}e^{-\frac{\left(x-\mu\right)^2}{2\sigma^2}},\quad-\infty<x<\infty,

\]

se dice que \(X\) sigue una distribución normal, con parámetros \(\mu\) y \(\sigma^2,\) y se denota así:

\[

X \thicksim N\left(\mu,\,\sigma^2\right)

\]

Aunque los parámetros de las distribuciones no siempre son interpretables de forma directa, en la normal sí lo son.

\[

\text{si}\;X\thicksim N\left(\mu,\,\sigma^2\right)\;\;\Rightarrow\;\;E(X)=\mu,\;V(X)=\sigma^2

\]

En español, esta letra se llama mi, tal como la registra la Real Academia Española. Esta denominación, además de contar con respaldo normativo, refleja con mayor fidelidad la pronunciación del griego moderno.

Tradicionalmente se ha pronunciado mu, por influencia del inglés, que adoptó la grafía del griego, pero no su sonido.

La forma miu, tomada directamente del inglés (/mjuː/), es ajena tanto al griego como al español, por lo que no debe usarse.

El parámetro \(\mu\) es la media, mientras que \(\sigma^2\) es la varianza. La esperanza, \(\mu,\) puede tomar cualquier valor en los reales, mientras que la varianza, \(\sigma^2,\) toma exclusivamente valores positivos.

Los valores de estos parámetros caracterizan a los miembros de la familia normal. En la figura 3.9 se observa que la curva está centrada en \(\mu\), razón por la que se le denomina parámetro de localización o de posición. Por su parte, \(\sigma^2\) determina el ancho y altura de la curva, por lo que suele denominársele parámetro de escala: mientras mayor sea \(\sigma^2\), más dispersa será la distribución.

Nótese que para representar las funciones densidad de probabilidad de la figura 3.9 solo se usa el eje de la abscisa, que corresponde al dominio o soporte de la función, es decir, los posibles valores que puede tomar la variable aleatoria. No suele incluirse el eje para la ordenada, correspondiente a \(f(x)\), dado que puede inducir a una interpretación errónea, pues a diferencia de las funciones masa de probabilidad, en las que \(f(x) = P(X = x),\) en las funciones densidad de probabilidad, \(f(x)\) no tiene una interpretación práctica.

En las funciones masa de probabilidad, \(f(x)=P(X=x),\) pero en las funciones densidad de probabilidad \(f(x)\ne P(X=x).\)

A pesar de que la normal es una familia conformada por infinitos miembros, todos ellos suelen referenciarse a un miembro común. Para comprender este proceso de referenciación, es importante establecer que cualquier transformación de una variable aleatoria da lugar a una nueva variable aleatoria, cuyo comportamiento probabilístico en ocasiones puede describirse de manera explícita y sencilla.

Considérese una variable aleatoria cualquiera —no necesariamente normal— \(X\), tal que \(E(X)=\mu\) y \(V(X)=\sigma^2.\) Si se le resta una constante cualquiera \(m\) a \(X,\) se obtiene una nueva variable aleatoria, con esperanza \(\mu−m;\) la varianza sigue siendo la misma. Esta propiedad puede usarse para centrar en cero cualquier variable aleatoria, es decir, para generar una nueva variable aleatoria con media cero. Para ello, basta con restarle la media, así:

\[

\text{si}\;E(X)=\mu\;\;\Rightarrow\;\;E(X-\mu)=0

\]

Por otra parte, cuando se transforma una variable aleatoria, dividiéndola por una constante, se obtiene una nueva variable aleatoria, cuya varianza es igual a la varianza de la variable original, dividida entre la constante elevada al cuadrado. Al aplicar esta transformación, la esperanza no cambia. Esta propiedad puede usarse para obtener variables aleatorias con varianza 1, dividiendo por la desviación estándar. A este proceso se le denomina estandarización:

\[

\text{si}\;V(X)=\sigma^2\;\;\Rightarrow\;\; V(X/\sigma)=1

\]

Aunando las dos transformaciones anteriores, se tiene la posibilidad de centrar y estandarizar cualquier variable aleatoria, restándole su media y dividiéndola por su desviación estándar, así:

\[

\begin{align}

\text{si}\;E(X)=\mu\quad &\text{y}\quad V(X)=\sigma^2\\[1.4em]

\Rightarrow\;\;E\!\left(\frac{X-\mu}{\sigma}\right)=0

\quad &\text{y}\quad V\!\left(\frac{X-\mu}{\sigma}\right)=1

\end{align}

\]

Aunque las anteriores propiedades de la esperanza y la varianza son generales para cualquier variable aleatoria y no tienen implicaciones distribucionales, para el caso particular de la distribución normal, se cumple que cualquier transformación lineal de una variable aleatoria normal es a su vez una variable aleatoria normal5. Se tiene, por tanto, el siguiente resultado:

\[

\text{si}\;X\thicksim N\left(\mu,\,\sigma^2\right)\;\;\Rightarrow\;\;

Z=\left(\frac{X-\mu}{\sigma}\right)\thicksim N\left(0,\,1\right)

\tag{3.6}\]

Así, pues, a partir de cualquier variable aleatoria con distribución normal, puede generarse una nueva variable aleatoria normalmente distribuida, con media cero y varianza 1. Dicha variable, que sirve como referente de cualquier variable aleatoria normalmente distribuida, se denota por \(Z\) y se le conoce como normal estándar.

La relación existente entre la normal estándar y cualquier otra variable aleatoria normal se utiliza extensamente en los textos básicos para calcular probabilidades asociadas con cualquier variable aleatoria normal. No obstante, más allá de servir de referente para el cálculo de las probabilidades de cualquier distribución normal, lo que convierte a la normal estándar en una poderosa herramienta es el papel que desempeña en muchas técnicas inferenciales.

Hasta hace muy poco, la mayoría de textos de estadística incluían tablas con valores de la función de distribución acumulada de la normal estándar6 (cf. sección 3.8), las cuales facilitaban la obtención de las probabilidades, sin necesidad de realizar en cada ocasión el correspondiente proceso de integración de la función densidad de probabilidad (cf. expresión 3.4). En R, tales probabilidades pueden calcularse fácilmente, usando la función pnorm{stats}, que incluye los argumentos mean, para especificar la media y sd para la desviación estándar.

Tal y como se ha indicado, cuando de normales se trata, la normal estándar es el miembro de la familia que cumple un rol protagónico en los procesos inferenciales. Es por ello que los valores por defecto de los argumentos de la función pnorm corresponden a los parámetros de una normal estándar (mean = 0, sd = 1).

El argumento sd de la función pnorm no representa la varianza, sino la desviación estándar.

Aunque este detalle es irrelevante para la normal estándar, en la cual \(\sigma^2 = \sigma = 1,\) debe tenerse presente con otros miembros de la familia normal, para asegurar que se está usando el parámetro correcto.

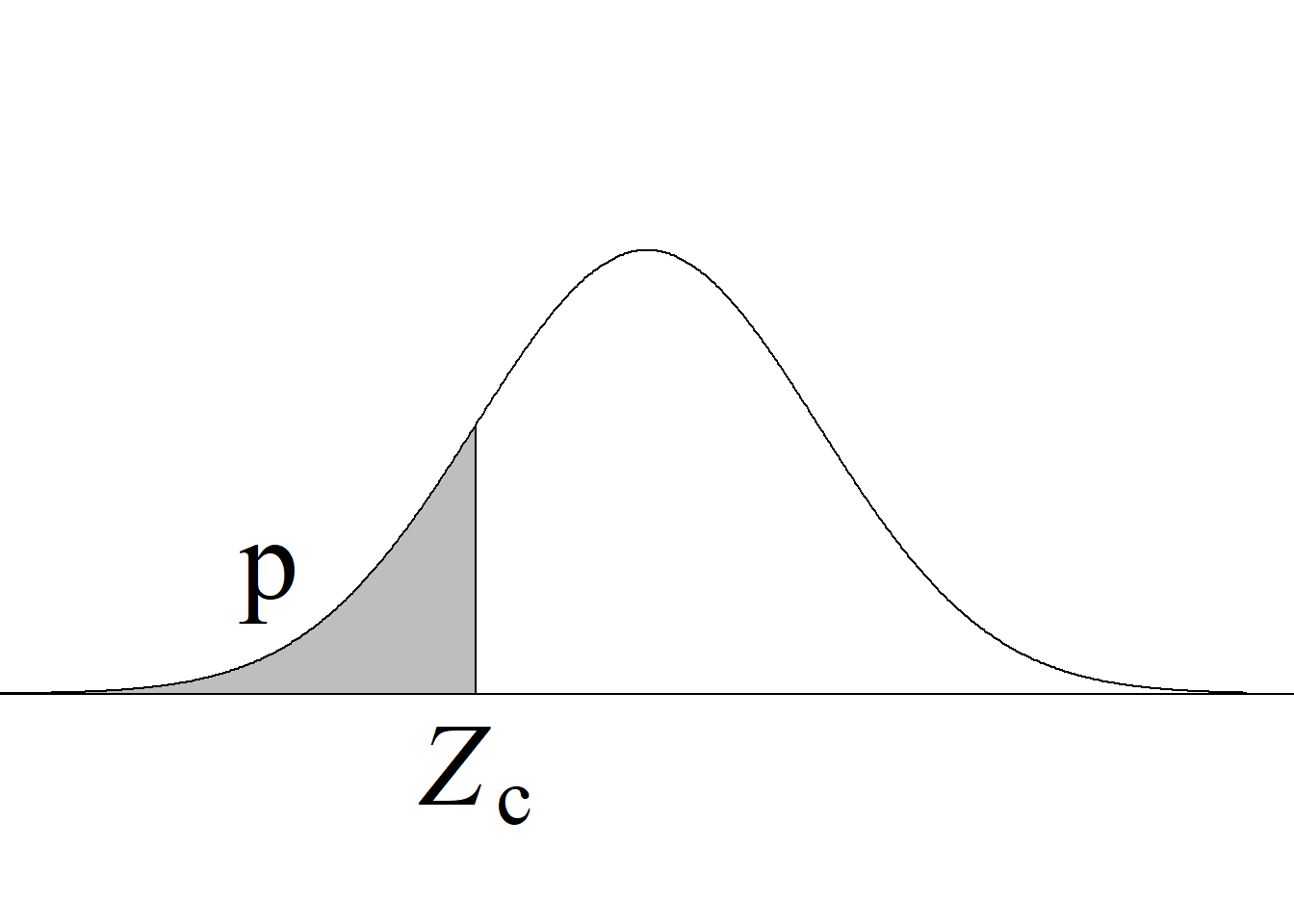

El primer argumento de la función pnorm es el cuantil (q)7, es decir, el valor hasta el cual se acumula el área o la probabilidad. Por tanto, cuando se usa la función pnorm con un único argumento, se obtiene la probabilidad acumulada hasta dicho valor en una normal estándar. Para obtener, por ejemplo, \(P(Z<1),\) se usa:

pnorm(1)[1] 0.8413447Aprovechando la relación existente entre la función de distribución y la función de supervivencia (cf. expresión 3.5), puede obtenerse por diferencia la probabilidad de obtener un valor de \(Z\) mayor que un valor determinado, lo cual equivale al procedimiento que se usaba cuando se calculaban las probabilidades a partir de tablas.

Las funciones que facilitan el cálculo de probabilidades en R (pnorm y muchas otras con un propósito análogo) incluyen el argumento lógico lower.tail, cuyo valor por defecto es TRUE, mediante el cual se especifica que las probabilidades se calculan desde la cola izquierda, es decir, acumulando. Cuando el valor de este argumento se cambia a FALSE, se está indicando que no es hacia la cola izquierda, sino hacia la derecha que deben calcularse las probabilidades, es decir, función de supervivencia.

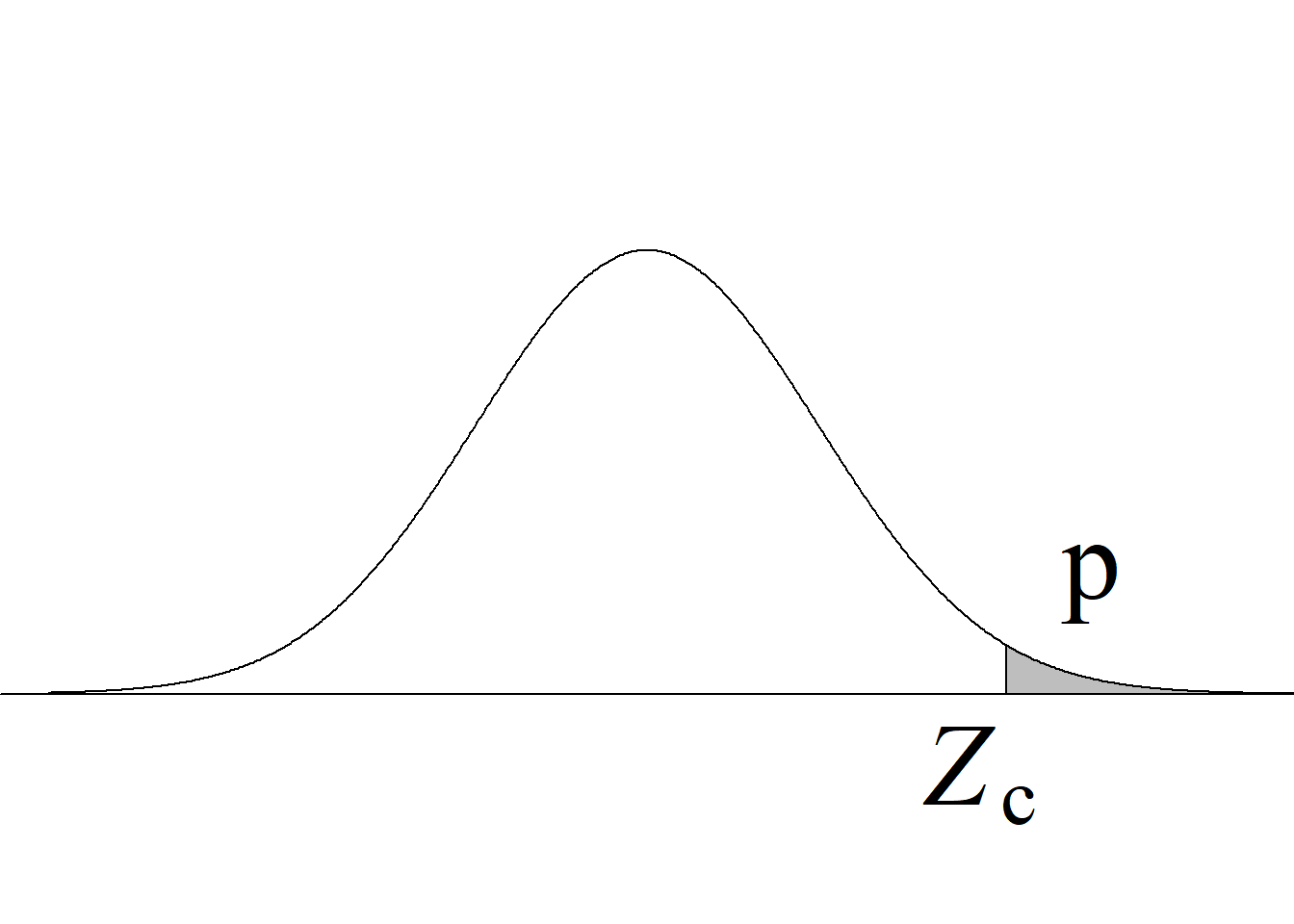

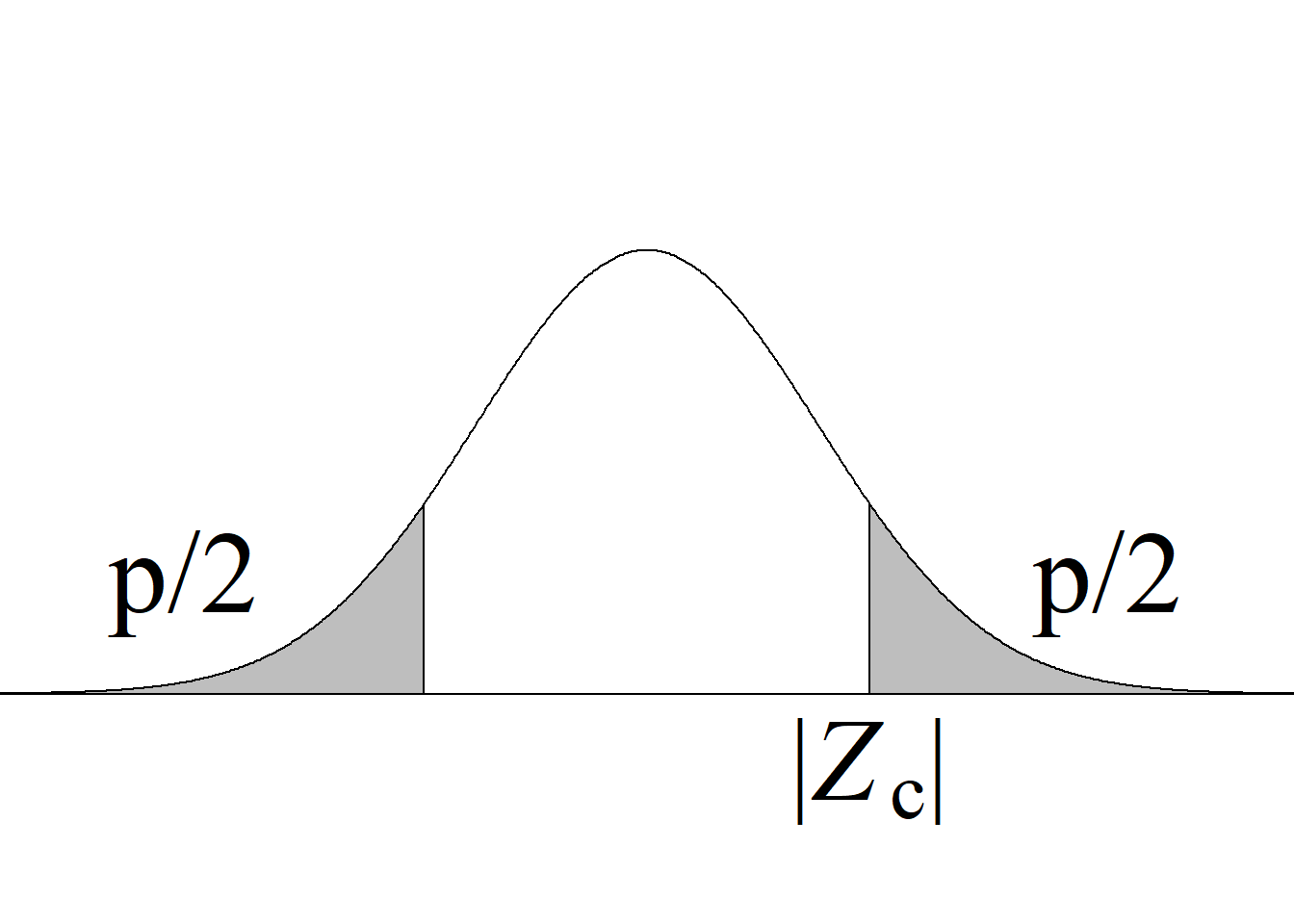

La figura 3.10 resume las relaciones expuestas.

En ocasiones se requiere usar las funciones inversas de \(F(X)\) o de \(S(X),\) de manera que, al ingresar una probabilidad como argumento, se obtenga el valor de la variable aleatoria que acumula dicha probabilidad o que deja esa área a la derecha, respectivamente. A las inversas de las funciones de distribución acumuladas se les denomina genéricamente funciones cuantil8. Nótese la similitud entre tales funciones y la definición de los cuantiles muestrales presentada en la sección 2.1.4.

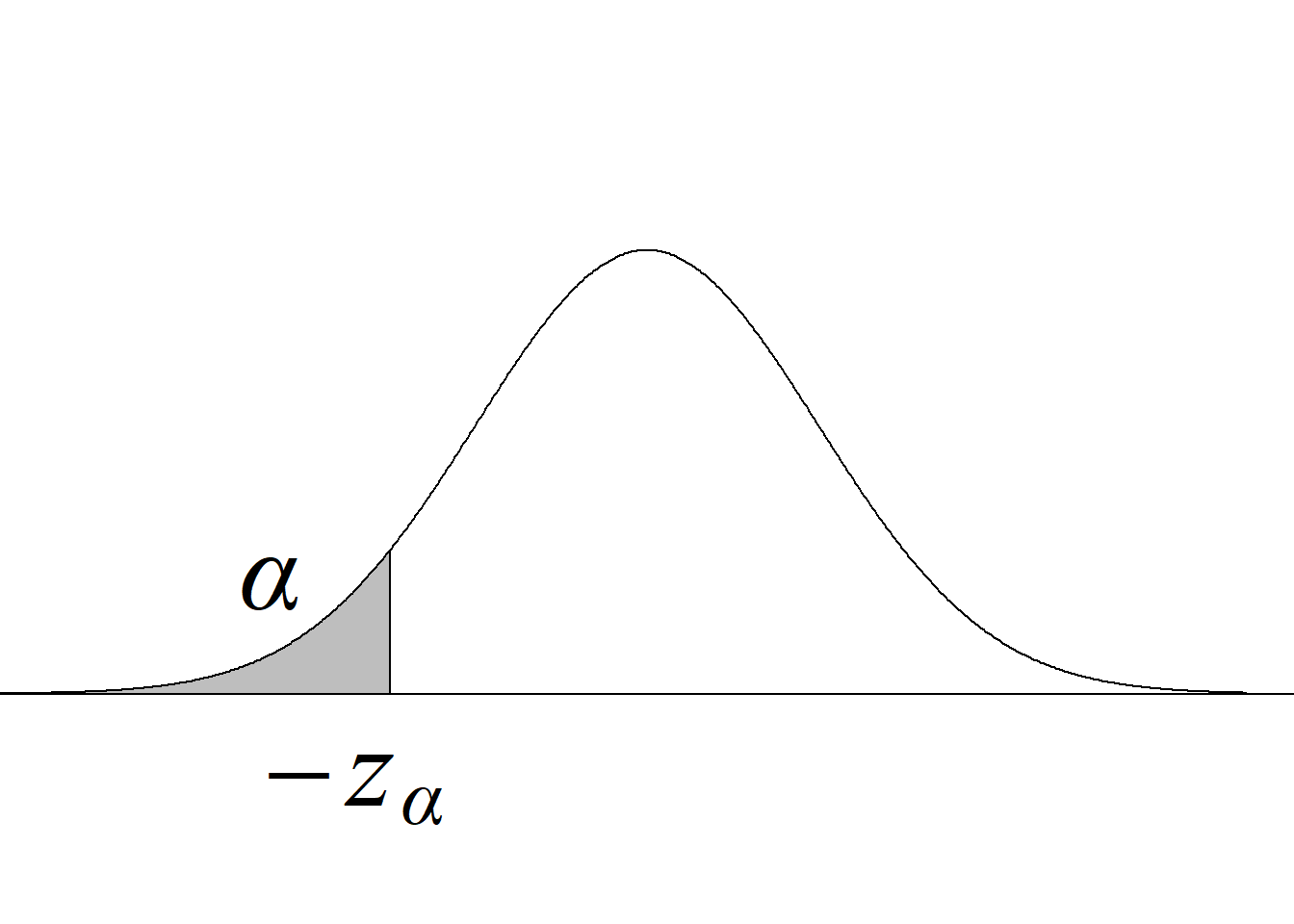

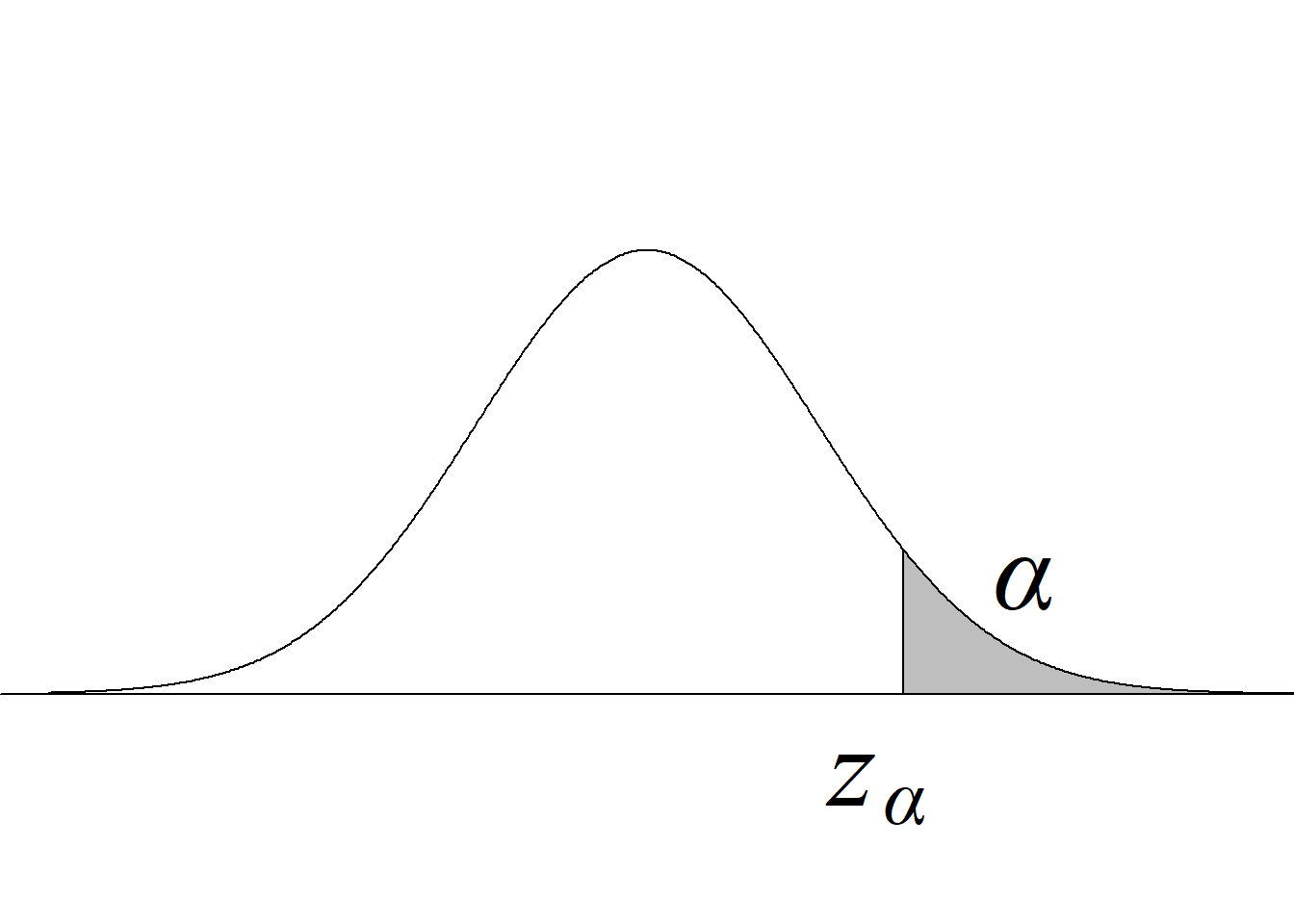

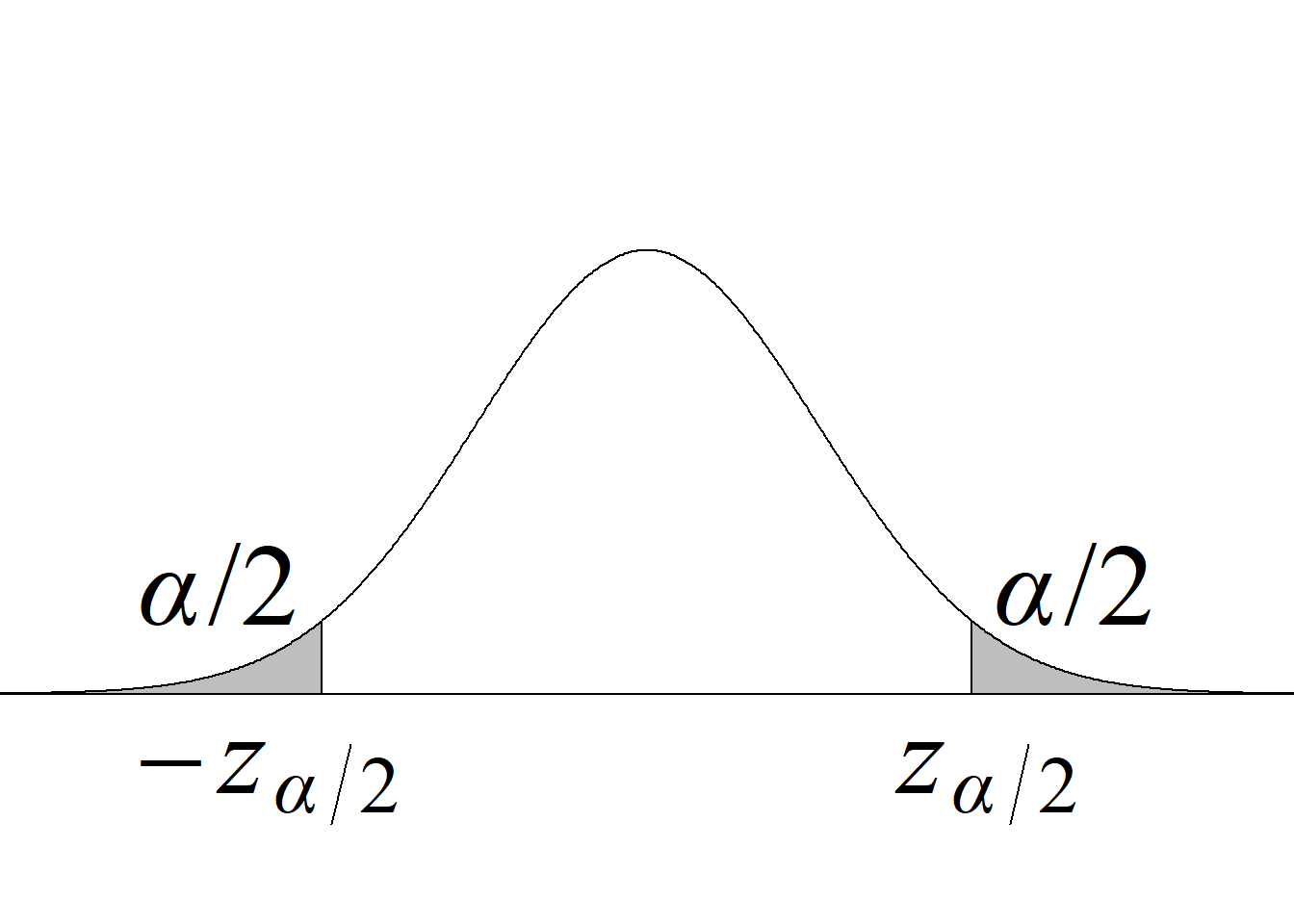

En R, la función cuantil correspondiente a la normal es qnorm; usando el argumento lower.tail = F, se obtiene la inversa de la función de supervivencia. A los valores resultantes de invertir las funciones de distribución y de supervivencia suele denominárseles valores críticos inferiores y valores críticos superiores, respectivamente, por el uso que se hace de los mismos en los procesos inferenciales, tal y como se ilustra en los siguientes capítulos.

Retomando el escenario que se presenta en la figura 3.10, un usuario podría tener interés, por ejemplo, en averiguar cuál es el valor de una variable aleatoria normal estándar que acumula un área de 0.8413 o, en otras palabras, cuál es el valor de una variable aleatoria normal estándar tal que la probabilidad de obtener valores menores sea 0.8413. Para averiguarlo, se escribe qnorm(0.8413), con lo cual se obtiene un resultado que es aproximadamente 1.

Si se desea averiguar cuál es el valor de una variable aleatoria normal estándar que deja un área de 0.1587 a su derecha o, en otras palabras, cuál es el valor de una variable aleatoria normal estándar tal que la probabilidad de obtener valores mayores sea 0.1587, se escribe qnorm(0.1587, lower.tail = F). La figura 3.11, en la que se grafica la función de distribución acumulada de la normal estándar, ilustra las relaciones descritas.

Nótese que, a diferencia de lo indicado para la función densidad de probabilidad —que no suele incluir el eje de la ordenada—, cuando se grafica la función de distribución acumulada sí se incluye un eje en la ordenada, el cual representa la probabilidad acumulada hasta \(z,\) es decir, \(P(Z < z)\) (cf. expresión 3.4).

La figura 3.12 muestra la relación entre la función densidad de probabilidad (figura 3.12 (a)) y la función de distribución acumulada (figura 3.12 (b)) de una variable aleatoria normal estándar.

Mientras que en la función densidad de probabilidad se calcula el área bajo la curva, en la función de distribución se lee directamente en la ordenada el área que se acumula desde \(-\infty\) hasta el valor de la variable, es decir, \(P(Z < z).\)

Para obtener en R una muestra seudoaleatoria de tamaño \(k\) a partir de una distribución normal estándar, se usa la instrucción rnorm(k). Si se quiere obtener una muestra basada en una normal con parámetros diferentes de los de la normal estándar, estos pueden indicarse mediante argumentos adicionales.

Ya se ha indicado que la importancia de la distribución normal tiene que ver con su papel en los procesos inferenciales. A continuación se presenta una triada de distribuciones de probabilidad continuas estrechamente ligadas con la distribución normal: la ji cuadrado, la \(t\) y la \(F\) (secciones 3.7.2, 3.7.3 y 3.7.4)), que, aunque no se usan —como la normal— para modelar directamente el comportamiento probabilístico de variables de campo, permiten modelar algunos estadísticos que surgen de los procesos muestrales, motivo por el que suele denominárseles distribuciones derivadas del muestreo. Estas tres distribuciones, al igual que la normal estándar, desempeñan roles esenciales en la mayoría de métodos inferenciales clásicos.

3.7.2 Distribución ji cuadrado

La formulación matemática de esta distribución fue desarrollada por el geodesta alemán Friedrich Helmert en 1876, quien describió el comportamiento probabilístico de una suma de variables aleatorias normales estándar elevadas al cuadrado. No obstante, fue el estadístico inglés Karl Pearson quien la popularizó en 1900, al formular una prueba de bondad de ajuste cuyo estadístico seguía esta distribución.

Pearson denota su estadístico de prueba mediante la vigesimosegunda letra del alfabeto griego elevada a la segunda potencia. En consecuencia, la prueba propuesta ha pasado a la posteridad como prueba ji cuadrado de Pearson, y a la distribución del correspondiente estadístico de prueba se le denomina ji cuadrado.

El nombre de esta distribución proviene de la vigesimosegunda letra del alfabeto griego, \(\chi,\) que en español se denomina ji.

Por influencia del inglés, donde la letra \(\chi\) se denomina chi (pronunciada /kai/) y la distribución chi-squared, en muchos textos en español se adoptó la denominación chi-cuadrado.

No obstante, en este libro se utiliza la denominación ji cuadrado, sin guion, por corresponder a la lectura literal en español de \(\chi^2,\) esto es, “ji al cuadrado”.

Gorroochurn (2016) sugiere que la formulación de Helmert tuvo precedentes. Tanto Irénée-Jules Bienaymé, en 1853, como Ernst Abbe, en 1863, realizaron contribuciones importantes en torno a la distribución de sumas de variables aleatorias elevadas al cuadrado. Estas contribuciones sentaron las bases conceptuales para la formulación exacta de la distribución ji cuadrado que posteriormente presentaría Helmert.

\[

\text{si}\; Z_i\:\text{iid}\:N(0,\,1),\quad i=1, 2, \dotsc,\nu\;\;\Rightarrow\;\;\sum_{i=1}^{\nu}Z_i^2\thicksim\chi_{(\nu)}^2

\tag{3.7}\]

La sigla iid se lee igual e independientemente distribuidas. Esta condición usualmente se satisface cuando se toma una muestra aleatoria de una población normal. La letra griega \(\nu\) (pronunciada ni) es el parámetro único de la distribución ji cuadrado y se le denomina grados de libertad (gl).

Suele suceder que no se le preste mucha atención a esta denominación la primera vez que aparece formalmente —aquí, en la distribución ji cuadrado—. Se toma simplemente como lo que se ha anunciado: el parámetro de esta distribución.

Sin embargo, esta no será la última vez aparezca, puesto que las distribuciones \(t\) y \(F,\) derivadas de la ji cuadrado, también incluyen este parámetro (secciones 3.7.3 y 3.7.4)). Asimismo, aparecerá en la mayoría de las técnicas inferenciales que se desarrollan a partir del capítulo 4, cobrando particular relevancia en el contexto del análisis de varianza (cf. sección 6.2). Es en tales contextos en los que el investigador suele preguntarse sobre el significado de los grados de libertad. Y puesto que tales aplicaciones a menudo aparecen alejadas de los contextos básicos, se dificulta trazar el recorrido hasta su origen.

En su aparición inicial, los grados de libertad indican cuántas variables aleatorias normales estándar independientes participan en la definición de la variable aleatoria ji cuadrado. Por ejemplo, si se toma una variable aleatoria normal estándar y se eleva al cuadrado, se obtiene una variable aleatoria ji cuadrado con un grado de libertad, \(\chi_{(1)}^2.\) Si se suman los cuadrados de \(\nu\) variables aleatorias normales estándar independientes, se obtiene una variable aleatoria ji cuadrado con \(\nu\) grados de libertad, \(\chi_{(\nu)}^2.\)

En contextos inferenciales, los grados de libertad representan las piezas o unidades de información independientes. Si bien la cantidad de información está relacionada con el tamaño de la muestra, la estimación de parámetros introduce restricciones que reducen los grados de libertad. Por lo tanto, los procesos inferenciales nunca están basados en \(n\) grados de libertad totales, sino en una cantidad reducida tras ajustar por las estimaciones necesarias.

Tener un alto número de grados de libertad es una condición deseable en los procesos inferenciales. En general, mientras más grados de libertad tenga una prueba, mayor será su precisión y potencia estadística, lo que permite detectar efectos verdaderos con mayor probabilidad.

La función densidad de probabilidad de una variable aleatoria \(\chi_{(\nu)}^2\) es:

\[

\begin{equation}

f(x)=

\begin{cases}

\frac{1}{2^{\nu/2}\Gamma\left(\nu/2\right)}x^{\frac{\nu}{2}-1}e^{-\frac{x}{2}} & \text{si}\:x>0,\\

\\

0 & \text{en los demás casos}.

\end{cases}

\end{equation}

\]

Donde \(\Gamma\) representa la función gamma, la cual está definida así:

\[

\begin{equation}

\Gamma(x)=

\begin{cases}

(x-1)! & \text{si } x \text{ es entero},\\

\\

\int\limits_{0}^{\infty}t^{x-1}e^{-t}\:dt & \text{si } x \text{ no es entero}.

\end{cases}

\end{equation}

\tag{3.8}\]

La esperanza y la varianza de las variables aleatorias ji cuadrado dependen de los grados de libertad:

\[

\text{si}\;X\thicksim\chi_{(\nu)}^2\;\;\Rightarrow\;\; E(X)=\nu,\:V(X)=2\nu

\]

El soporte de las variables aleatorias ji cuadrado son los reales positivos, puesto que están conformadas por la suma cuadrática de una serie de variables aleatorias normales estándar. Aunque la función densidad de probabilidad es asimétrica, dicha asimetría disminuye para valores altos del parámetro \(\nu\), tal y como se ilustra en la figura 3.13.

R incluye funciones que permiten obtener los valores de la correspondiente función de distribución, de la función de supervivencia, así como de sus respectivas inversas.

Para la función de distribución acumulada se usa pchisq(q, df), siendo q el valor hasta el cual se desea acumular la probabilidad en una distribución ji cuadrado con df grados de libertad. Así, por ejemplo, si se tiene una variable aleatoria ji cuadrado con 7 gl y se desea calcular la probabilidad de obtener un valor menor que 3.5, se usa:

pchisq(3.5, 7)[1] 0.1647745Para calcular la probabilidad de obtener un valor mayor (función de supervivencia), se le agrega el argumento lower.tail = F a la función pchisq.

pchisq(3.5, 7, lower.tail = F)[1] 0.8352255Para averiguar cuál es el valor que deja a su izquierda un área de 0.025, en una distribución ji cuadrado con 4 gl, se usa la función cuantil (qchisq):

qchisq(0.025, 4)[1] 0.4844186Para calcular el valor de una variable aleatoria ji cuadrado con 13 gl que deja a su derecha un área de 0.05, se agrega el argumento lower.tail = F en la función cuantil:

qchisq(0.05, 13, lower.tail = F)[1] 22.362033.7.3 Distribución \(t\)

Aunque existen registros que indican que esta distribución fue derivada por Friedrich Helmert y Jacob Lüroth en 1876, su incorporación efectiva a la práctica estadística está marcada por un artículo presentado en 1908 por el estadístico inglés William Sealy Gosset, quien en aquel entonces trabajaba en la cervecería irlandesa Guinness, razón por la cual publicó su trabajo con el seudónimo de Student.

Posteriormente, Ronald Aylmer Fisher contribuyó decisivamente a su formalización y difusión, siendo quien introdujo y consolidó la denominación “\(t\) de Student” en su obra Statistical Methods for Research Workers, publicada en 1925 (Eisenhart, 1979). En la literatura moderna, esta distribución también se conoce simplemente como distribución \(t.\)

La distribución \(t\) está asociada al muestreo de poblaciones normales. Surge como el cociente entre una variable aleatoria normal estándar y la raíz cuadrada de una variable aleatoria ji cuadrado escalada por sus grados de libertad.

Si \(Z\thicksim N(0,\,1)\) y \(U\thicksim\chi_{(\nu)}^2,\) siendo \(Z\) y \(U\) independientes entre sí:

\[

\frac{Z}{\sqrt{U/\nu}}\thicksim t_{(\nu)}

\]

La función densidad de probabilidad de una variable aleatoria \(t_{(\nu)}\) es:

\[

f(t)=\frac{\Gamma\left(\frac{\nu+1}{2}\right)}{\Gamma\left(\frac{\nu}{2}\right)\sqrt{\pi\nu}\left(1+\frac{t^2}{\nu}\right)^{(\nu+1)/2}},\quad -\infty<t<\infty

\]

Donde \(\Gamma\) representa la función gamma (cf. expresión 3.8).

El parámetro \(\nu\) de la distribución \(t\) coincide con el parámetro de la distribución ji cuadrado que le da origen. Dicho parámetro se denomina grados de libertad (gl) y representa el número de variables aleatorias normales estándar independientes involucradas en su definición (cf. tip 3.2).

La esperanza y la varianza de una variable aleatoria \(t\) se definen a partir de su parámetro \(\nu.\)

\[

\text{si}\; t\thicksim t_{(\nu)}\;\;\Rightarrow\;\; E(t) = 0,\: \text{para}\:\nu>1\;\;\text{y}\;\; V(t)=\frac{\nu}{\nu-2}, \:\text{para}\:\nu>2

\]

Al igual que la normal estándar, la distribución \(t\) es simétrica, con forma de campana y centrada en cero, aproximándose asintóticamente al eje horizontal cuando se aleja de la media en cualquier dirección.

Las probabilidades en las colas de la distribución \(t\) son mayores que en la distribución normal estándar; en consecuencia, se dice que la \(t\) es una distribución de colas pesadas o leptocúrtica (cf. sección 2.1.3.2). Esta diferencia se hace más pequeña en la medida en que aumentan sus grados de libertad. En muchos de los textos que incluyen valores tabulares de la distribución \(t,\) estos se presentan únicamente para distribuciones que tengan hasta 30 gl; para valores de \(\nu\) por encima de 30, se aproximan mediante los correspondientes valores de la distribución normal estándar.

La figura 3.14 —en la cual \(\nu=\infty\) equivale a la normal estándar— ilustra este comportamiento.

Usando R es posible obtener valores de la función de distribución, de la función de supervivencia, así como de sus respectivas inversas. Para la función de distribución acumulada se usa pt(q, df), siendo q el valor hasta el cual se desea acumular la probabilidad en una distribución \(t\) con df gl.

Teniendo en cuenta lo anterior, intente definir la instrucción en R para realizar el siguiente cálculo.

Probabilidad de obtener un valor menor que −2 en una distribución \(t\) con 10 gl

pt(-2, 10)Para calcular la probabilidad de obtener un valor mayor (función de supervivencia), se agrega el argumento lower.tail = F.

Intente definir el código R que permite responder la siguiente pregunta:

¿Cuál es el valor que deja a su izquierda un área de 0.025, en una distribución \(t\) con 30 gl?

qt(0.025, 30)Y esta otra:

¿Cuál es el valor de una variable aleatoria \(t\) con 2 gl que deja a su derecha un área de 0.01?

qt(0.01, 2, lower.tail = F)3.7.4 Distribución \(F\)

Como parte de los desarrollos asociados con el análisis de varianza, el estadístico inglés Ronald Aylmer Fisher desarrolló en la década de 1920 un estadístico que hoy se conoce como \(F.\) No obstante, fue Snedecor quien posteriormente consideró que era más conveniente tabular la razón de varianzas; a dicha razón la llamó \(F\) en honor a Fisher. Por tal motivo a esta distribución suele denominársele \(F\) de Snedecor, \(F\) de Fisher o \(F\) de Fisher-Snedecor.

La distribución \(F\) surge de la razón entre dos variables aleatorias ji cuadrado independientes entre sí, dividiendo cada una de ellas entre sus grados de libertad. La variable aleatoria \(F\) hereda los grados de libertad de ambas distribuciones. A tales parámetros se les llama grados de libertad del numerador y grados de libertad del denominador.

\[

\begin{align}

\text{si}\; \chi_{m}^2 \thicksim \chi_{(m)}^2,\: \chi_{n}^2 \thicksim \chi_{(n)}^2\;\;&\text{y}\;\;

\chi_{m}^2 \: \text{y} \: \chi_{n}^2\;\text{son independientes},\\[1.4em]

\frac{\chi_{m}^2/m}{\chi_{n}^2/n} &\thicksim F_{(m,\,n)}

\end{align}

\tag{3.9}\]

La función densidad de probabilidad de una variable aleatoria \(F_{(m,\,n)}\) es:

\[

f(x)=\frac{\left(\frac{m}{n}\right)^{m/2}\:\Gamma\left(\frac{m+n}{2}\right)}{\Gamma\left(\frac{m}{2}\right)\Gamma\left(\frac{n}{2}\right)}

\frac{x^{(m/2)-1}}{\left(1+\frac{m}{n}x\right)^{(m+n)/2}},\quad x>0

\]

Donde \(\Gamma\) representa la función gamma, tal y como se definió en la expresión 3.8.

\[

\begin{align}

&\text{si}\;F \thicksim F_{(m,\,n)}\\[1.4em]

\Rightarrow\;\; E(F)&=\frac{n}{n-2},\;\;\text{para}\; n>2,\\[1.4em]

V(F)&=\frac{2n^2(m+n-2)}{m(n-2)^2(n-4)},\;\; \text{para}\; n>4

\end{align}

\]

Al tratarse de la razón entre dos variables aleatorias cuyo rango es positivo, la variable aleatoria \(F\) solamente toma valores positivos. En la figura 3.15 se aprecia la diversidad de formas que puede asumir esta distribución, en función de sus parámetros.

La obtención de los valores de la correspondiente función de distribución, de la función de supervivencia, así como de sus respectivas inversas es un asunto sencillo, usando R. Para la función de distribución acumulada se usa pf(q, df1, df2), siendo q el valor hasta el cual se desea acumular la probabilidad en una distribución \(F\) con df1 y df2 grados de libertad para el numerador y el denominador, respectivamente.

Intente definir el código R que permite responder la siguiente pregunta:

¿Cuál es probabilidad de obtener un valor menor que 0.5 en una distribución \(F\) con 15 y 10 gl?

pf(0.5, 15, 10)Para calcular la probabilidad de obtener un valor mayor (función de supervivencia), se agrega el argumento lower.tail = F.

Para averiguar cuál es el valor de una variable aleatoria \(F\) que acumula una probabilidad determinada se usa la correspondiente función cuantil: qf.

Intente definir el código R que permite responder la siguiente pregunta:

¿cuál es el valor que deja a su izquierda un área de 0.1, en una distribución \(F\) con 7 y 19 gl?

qf(0.1, 7, 19)Y esta otra:

¿Cuál es el valor de una variable aleatoria \(F\) con 8 y 4 gl que deja a su derecha un área de 0.05?

qf(0.05, 8, 4, lower.tail = F)3.8 Probabilidades y valores críticos en R

Gracias a las facilidades que ofrecen programas como R, las tablas estadísticas pasaron a ser herramientas del pasado. Y aunque fueron de mucha utilidad en su momento —como también lo fueron las calculadoras y las reglas de cálculo— dejan de tener sentido en la actualidad.